Cada mañana, millones de personas realizan un ejercicio intuitivo de predicción: consultan el tiempo y deciden si llevarse un paraguas. Se trata de un acto de mitigación de riesgos basado en datos actuales. Sin embargo, cuando trasladamos esta lógica a la adquisición de sistemas de defensa o de infraestructuras críticas, la intuición no resulta de gran utilidad.

La estimación de costes no es un simple cálculo contable, sino una compleja combinación de arte y ciencia. Técnicamente, la definimos como una «instantánea de probabilidad» basada exclusivamente en la información disponible en un momento determinado.

Si cambian las suposiciones iniciales, la estimación variará inevitablemente. No es que el modelo sea erróneo, sino que ha mutado la realidad.

Como señaló el físico y premio Nobel Niels Bohr:

«Predecir es muy difícil, especialmente cuando se trata del futuro».

Lección 1: tus predecesores no eran incompetentes (y por qué eso importa).

Existe un mito persistente entre la alta dirección: que utilizar datos históricos para proyectar costes equivale a heredar las ineficiencias y los errores de los gestores anteriores. Se teme que, si el pasado fue accidentado, el futuro será un reflejo de esos fallos.

Nada más lejos de la realidad técnica. La búsqueda y la normalización de datos históricos son pilares de cualquier estimación científicamente fundamentada. Las desviaciones en proyectos pasados rara vez se deben a la incompetencia; suelen ser respuestas adaptativas a eventos externos e imprevisibles que escapan al control del director del programa. Al analizar el pasado, no buscamos replicar el error, sino comprender la volatilidad. En este sentido, la honestidad intelectual nos obliga a aceptar una máxima del sector:

«No cometerás los mismos errores que tus predecesores, ¡cometerás los tuyos propios!».

Esta perspectiva permite a los directivos sénior comprender que la gestión de proyectos complejos no consiste en eliminar la incertidumbre, sino en gestionarla mediante modelos cuantitativos transparentes y defendibles.

Lección 2: El «iceberg» de los costes del ciclo de vida.

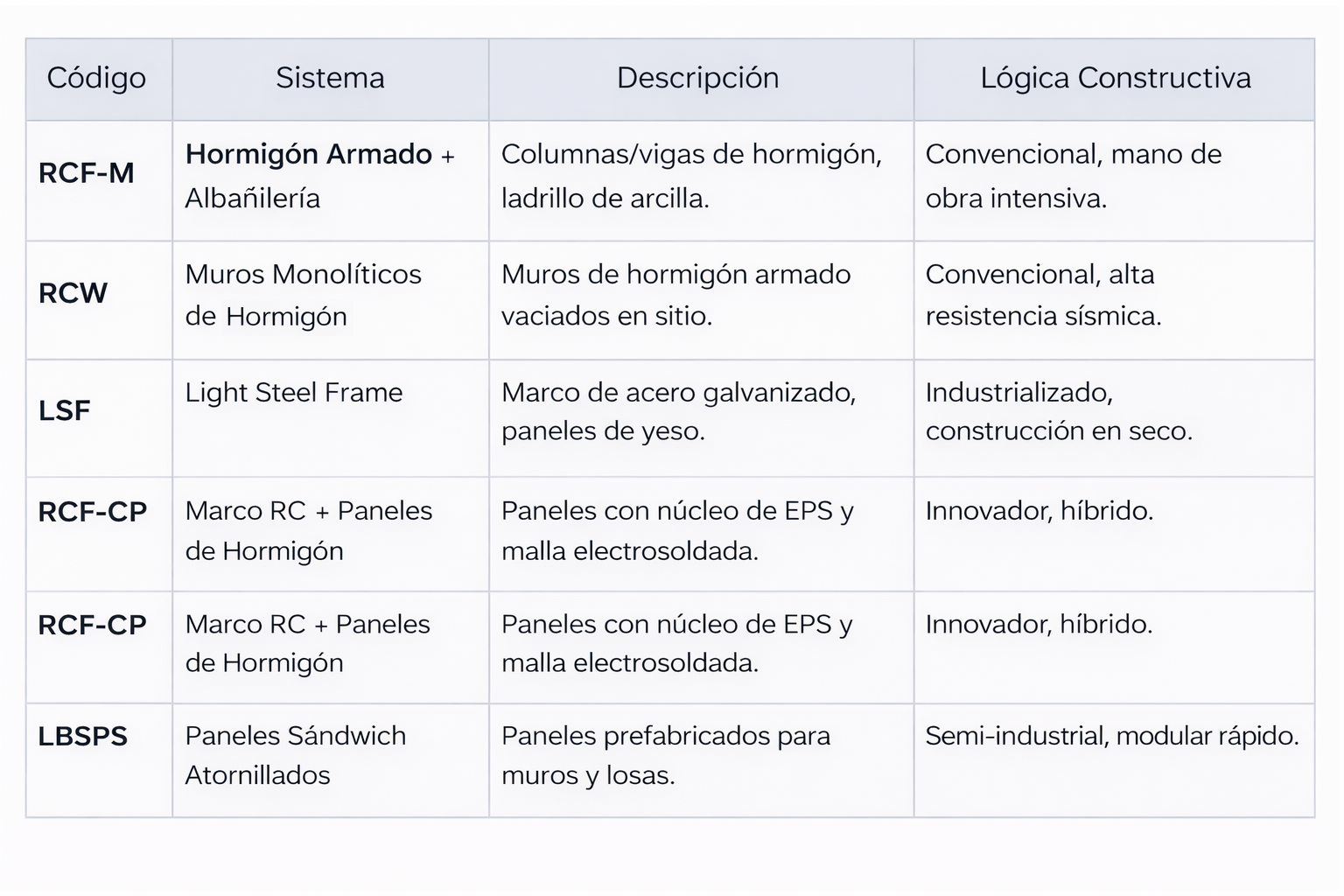

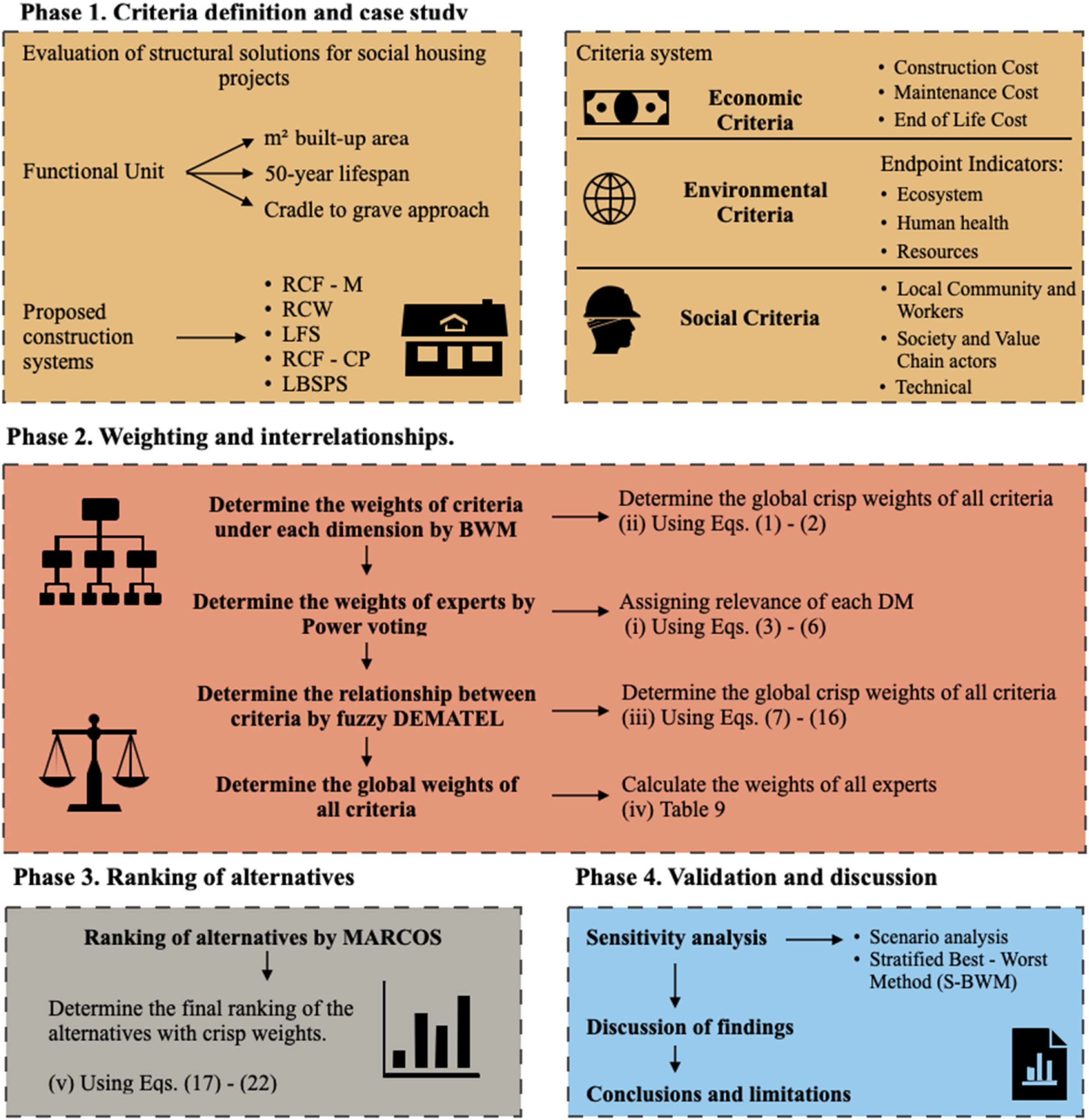

Uno de los errores estratégicos más comunes en proyectos de infraestructura es centrarse exclusivamente en el “precio de etiqueta”, es decir, en el coste de construcción. En la consultoría de proyectos complejos se utiliza el análisis del coste del ciclo de vida (Life Cycle Cost Estimate, LCCE) para comprender el verdadero esfuerzo económico que conlleva una infraestructura desde su concepción hasta su retirada o renovación.

Un LCCE permite visualizar todos los recursos necesarios a lo largo del tiempo y suele estructurarse en cuatro grandes fases:

- Diseño y desarrollo (estudios previos, ingeniería, proyectos y ensayos).

- Inversión inicial (construcción y puesta en servicio).

- Operación y mantenimiento (explotación, conservación, energía, personal, reparaciones).

- Fin de vida o disposición (desmantelamiento, renovación o sustitución).

La metáfora del iceberg de los costes resulta especialmente útil para comprender este enfoque. La construcción visible —la parte que suele atraer toda la atención— es solo la punta del iceberg. Bajo la superficie se encuentran los costes acumulados durante décadas de operación y mantenimiento, que en muchos casos pueden representar la mayor parte del gasto total.

Sin embargo, un análisis riguroso exige reconocer que no existe una estructura de costes universal. La distribución del gasto depende en gran medida del tipo de activo y de su modelo de explotación.

Por ejemplo:

- En infraestructuras digitales vinculadas a la ingeniería civil, como plataformas de gestión del tráfico o sistemas de control ferroviario, una parte muy significativa del coste puede concentrarse en el desarrollo tecnológico inicial, en el que la ingeniería y el software son determinantes.

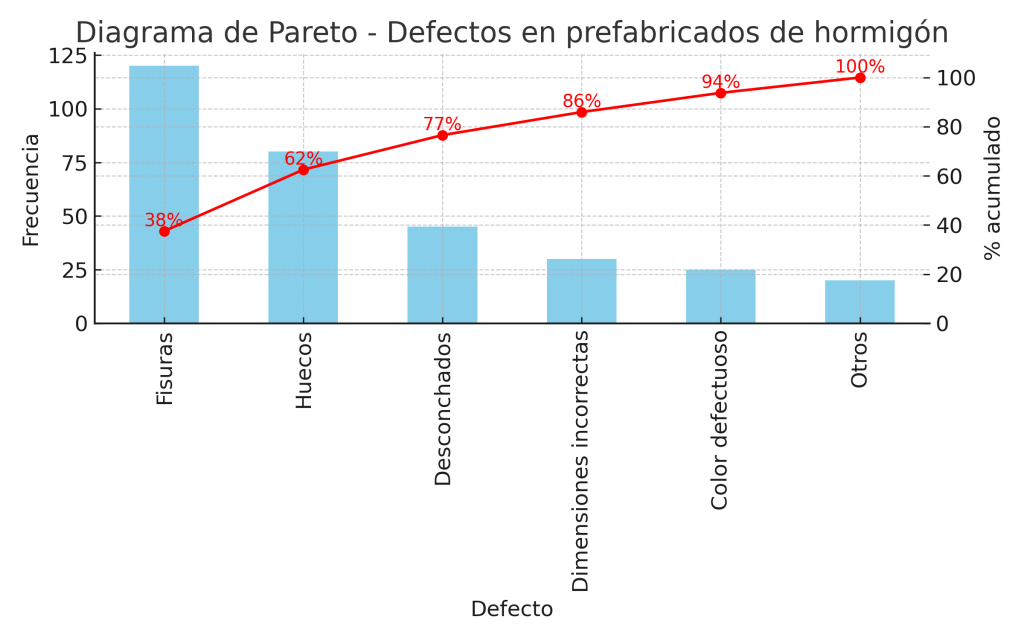

- En infraestructuras estandarizadas y repetitivas, como determinados tramos de carreteras o estructuras prefabricadas, el peso principal suele recaer en la fase de inversión inicial, donde materiales, maquinaria y ejecución concentran la mayor parte del presupuesto.

- En infraestructuras intensivas en operación, como redes ferroviarias, aeropuertos, presas o grandes instalaciones hidráulicas, los costes dominantes suelen concentrarse en la fase de operación y mantenimiento: conservación, inspecciones, energía, personal especializado y renovación periódica de equipos.

La lección estratégica es clara: evaluar una infraestructura únicamente por su coste de construcción puede conducir a decisiones subóptimas. Incorporar una visión de ciclo de vida permite diseñar activos más eficientes, reducir costes futuros y tomar decisiones de inversión con una perspectiva verdaderamente estratégica.

Lección 3: La inercia estratégica de los «costes hundidos».

El cerebro humano tiene una vulnerabilidad bien conocida: la tendencia a intentar “salvar” un proyecto problemático solo porque ya se ha invertido mucho en él. En economía y gestión de proyectos, este fenómeno se conoce como la falacia del coste hundido.

En términos estrictamente financieros, el dinero gastado en el pasado ya no debería influir en las decisiones futuras, porque no puede recuperarse. Lo relevante para quien toma decisiones no es cuánto se ha gastado, sino cuánto costará terminar el proyecto a partir de ahora. Por eso, una de las métricas clave es el coste por completar (cost to go), es decir, el dinero adicional necesario para completar una infraestructura.

Veamos un ejemplo sencillo aplicado a la ingeniería civil. Imaginemos la construcción de una autovía o un gran puente cuyo presupuesto inicial se ha visto superado:

- Estado actual del proyecto: ya se han invertido 200 millones de euros (coste hundido).

- Coste estimado para terminar la obra: 100 millones adicionales.

- Coste total final: 300 millones.

Ahora aparece una alternativa técnica: rediseñar el proyecto desde cero con otra solución constructiva, cuyo coste total sería de 250 millones.

Si miramos únicamente el coste total, la nueva solución (250 M€) parece más eficiente que el proyecto actual (300 M€). Sin embargo, desde el punto de vista financiero, el análisis correcto es otro.

El dinero ya invertido —los 200 millones— es un coste hundido y no puede recuperarse. La decisión debe basarse únicamente en el capital adicional necesario:

- Terminar el proyecto actual requiere 100 millones adicionales.

- Empezar una nueva solución requiere una nueva inversión de 250 millones.

Si ambas infraestructuras ofrecen un resultado equivalente en servicio, seguridad y prestaciones, la opción racional sería terminar el proyecto existente, ya que requiere mucho menos capital adicional.

Superar la inercia estratégica de los costes hundidos exige disciplina analítica: centrarse exclusivamente en los costes y beneficios futuros y no en el peso psicológico de lo ya gastado. En proyectos de infraestructura —donde las inversiones son muy elevadas y los plazos son largos— esta distinción es crucial para evitar decisiones económicamente ineficientes.

Lección 4: ¿Coste o precio? La distinción que lo cambia todo.

En el lenguaje coloquial, son sinónimos, pero en la estrategia de adquisiciones son conceptos totalmente distintos. El coste es la medición de los recursos consumidos para producir un bien. El precio es lo que el mercado está dispuesto a pagar y se ve afectado por el margen de beneficio, la competencia y el valor percibido. Nuestra máxima es que la profesión de la estimación se centra en los costes, no en el precio.

Para ilustrar esta complejidad, analicemos algo tan simple como una cabeza de lechuga. Para un consumidor, el precio es una cifra que ve en el estante. Para un estimador, el «coste» es un desglose multicapa que incluye el cultivo y la siembra, la irrigación y el mantenimiento, el proceso de cosecha, el embalaje en planta y, por último, la logística de transporte. Solo comprendiendo estas capas podemos evaluar si el precio de un sistema complejo es razonable o si estamos asumiendo riesgos financieros ocultos.

Lección 5: la «segunda opinión» como salvaguarda estratégica.

En muchos proyectos de ingeniería civil, la estimación independiente de costes (ICE, Independent Cost Estimate) suele percibirse por los directores de proyecto como una revisión incómoda o incluso como una señal de desconfianza hacia el trabajo del equipo interno. Sin embargo, en proyectos complejos —infraestructuras ferroviarias, grandes presas, túneles o corredores logísticos— contar con una segunda opinión técnica sobre los costes se ha consolidado como una práctica clave de gestión del riesgo.

Una estimación independiente no busca cuestionar al equipo del proyecto, sino aportar una visión externa y metodológicamente rigurosa que reduzca los sesgos inevitables de los equipos profundamente implicados en el diseño y la planificación. En proyectos de obra civil, donde intervienen múltiples disciplinas, contratistas y condicionantes regulatorios, es frecuente que el entusiasmo técnico o la presión por aprobar un proyecto conduzca a estimaciones demasiado optimistas.

Por ejemplo, en la planificación de una línea ferroviaria de alta velocidad, un equipo promotor puede basar su estimación en rendimientos teóricos de obra o en condiciones geotécnicas favorables. Una evaluación independiente puede introducir escenarios alternativos: variaciones en los costes de materiales, incertidumbres geológicas en los túneles o desviaciones en la productividad de los equipos. Del mismo modo, en la construcción de grandes infraestructuras hidráulicas o viarias, una revisión externa puede detectar partidas infravaloradas relacionadas con desvíos de servicios, con la gestión ambiental o con riesgos constructivos.

Las instituciones públicas que financian grandes infraestructuras han aprendido que la calidad de las estimaciones de costes es decisiva para la viabilidad de los proyectos. Como advierte la Government Accountability Office (GAO):

«La capacidad de generar estimaciones de costes fiables es necesaria para apoyar los procesos presupuestarios. Sin ella, existe el riesgo de sufrir sobrecostes, incumplimientos de plazos y deficiencias en el rendimiento, lo que implica que el Gobierno no pueda financiar tantos programas como pretendía».

En este contexto, la estimación independiente de costes funciona como una salvaguarda estratégica: no solo mejora la calidad de las previsiones económicas, sino que también fortalece la credibilidad de los proyectos ante financiadores, administraciones y la ciudadanía. En un sector donde las decisiones de inversión comprometen recursos durante décadas, disponer de una segunda opinión rigurosa no es una señal de debilidad, sino de buena gobernanza.

Conclusión: el «Estándar del Estudiante de Secundaria».

Una estimación de alta calidad no se mide por su capacidad de «acertar» el número final, sino por su trazabilidad y auditabilidad. En nuestro sector, aplicamos lo que se conoce como «Estándar del Estudiante de Secundaria»: el análisis debe ser lo suficientemente transparente y lógico como para que un estudiante con conocimientos básicos de aritmética pueda seguir los argumentos, formular suposiciones y obtener el mismo resultado.

Al final del día, quien controla las suposiciones controla el análisis. Al evaluar sus proyectos actuales, pregúntese: ¿sus estimaciones son cajas negras de complejidad innecesaria o documentos trazables que reflejan el coste real del ciclo de vida? La transparencia no es solo una buena práctica, sino la brújula que separa el éxito estratégico del desastre presupuestario.

Aquí puedes escuchar una conversación sobre los aspectos de mayor interés de este tema.

El vídeo resume bien los conceptos más importantes.

Referencias:

Mislick, G. K., & Nussbaum, D. A. (2015). Cost estimation: Methods and tools. John Wiley & Sons.

Yepes, V. (2022). Gestión de costes y producción de maquinaria de construcción. Universidad Politécnica de Valencia.

Curso:

Curso de gestión de costes y producción de la maquinaria empleada en la construcción.

Esta obra está bajo una licencia de Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0 Internacional.