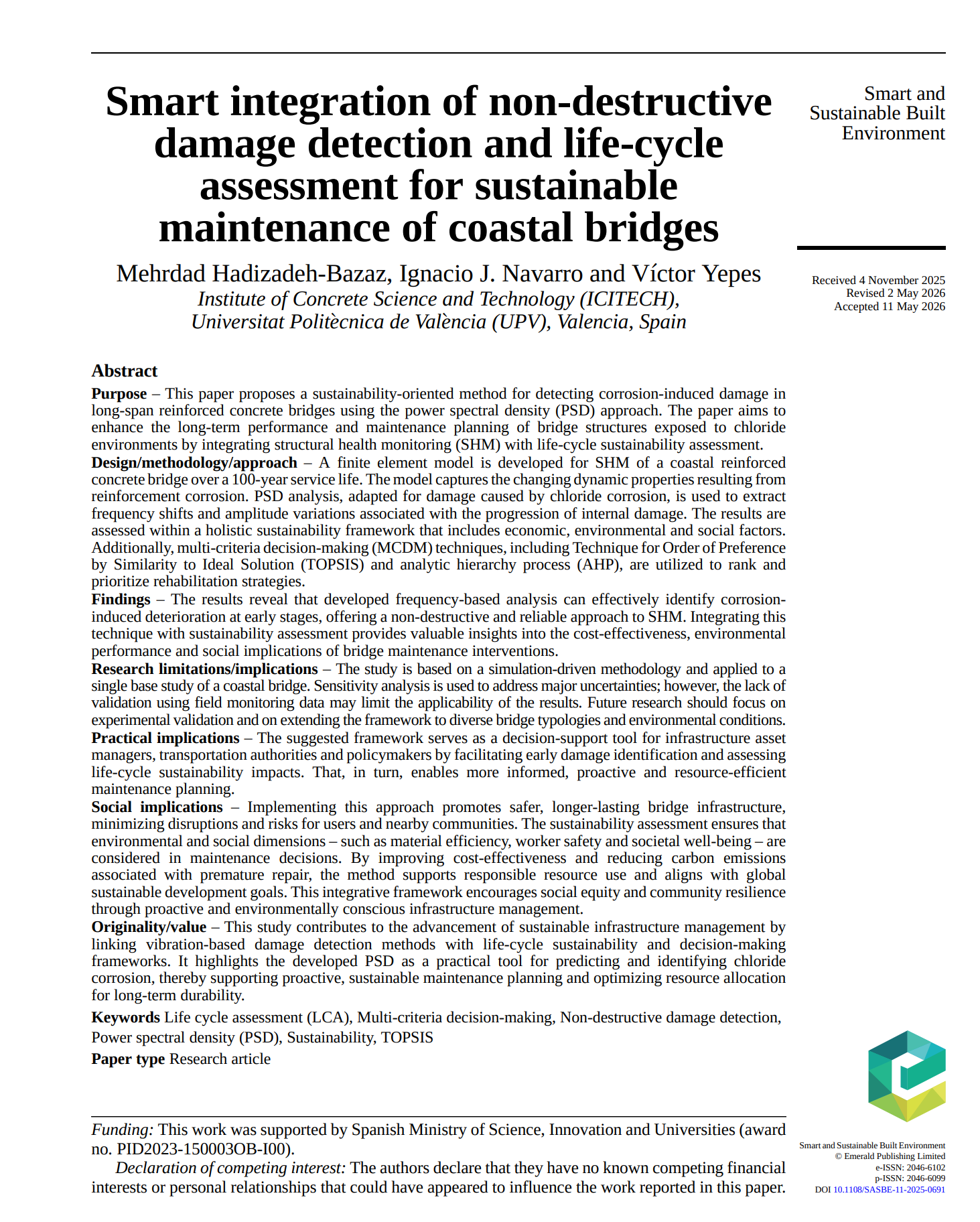

Acaban de publicar un artículo en Smart and Sustainable Built Environment, una de las revistas ubicadas en el primer cuartil del JCR. Este documento técnico sintetiza una investigación avanzada sobre el mantenimiento sostenible de puentes de hormigón armado en entornos costeros, sometidos a una degradación acelerada por la corrosión inducida por cloruros. La propuesta principal se basa en un enfoque integral que combina el monitoreo de la salud estructural (SHM) mediante el análisis de la densidad espectral de potencia (PSD), las evaluaciones de sostenibilidad del ciclo de vida (LCSA) y la toma de decisiones multicriterio (MCDM).

Acaban de publicar un artículo en Smart and Sustainable Built Environment, una de las revistas ubicadas en el primer cuartil del JCR. Este documento técnico sintetiza una investigación avanzada sobre el mantenimiento sostenible de puentes de hormigón armado en entornos costeros, sometidos a una degradación acelerada por la corrosión inducida por cloruros. La propuesta principal se basa en un enfoque integral que combina el monitoreo de la salud estructural (SHM) mediante el análisis de la densidad espectral de potencia (PSD), las evaluaciones de sostenibilidad del ciclo de vida (LCSA) y la toma de decisiones multicriterio (MCDM).

Los principales hallazgos demuestran que la implementación de métodos no destructivos basados en vibraciones, como el PSD, permite identificar el deterioro en etapas tempranas con mayor precisión que los métodos convencionales. Los resultados indican que este enfoque puede reducir los costes de mantenimiento y reparación hasta un 40 % a lo largo de una vida útil de 100 años, lo que supone una disminución significativa de los impactos ambientales y de los riesgos sociales para los trabajadores y las comunidades locales.

La investigación se enmarca en el proyecto RESILIFE, que dirijo como investigador principal en la Universitat Politècnica de València. A continuación, se presenta un resumen del trabajo y de la información de contexto.

La pregunta de investigación que abordamos fue la siguiente:

¿Cómo podemos superar las limitaciones de los modelos de deterioro predefinidos y de las inspecciones visuales mediante la integración de la monitorización de la salud estructural (SHM) basada en vibraciones y de un análisis de sostenibilidad del ciclo de vida para optimizar el mantenimiento?

Hasta ahora, la literatura científica abordaba la detección de daños y la sostenibilidad de forma independiente; nuestro trabajo es la «orquestación de ciencias» que los une en un solo marco de decisión.

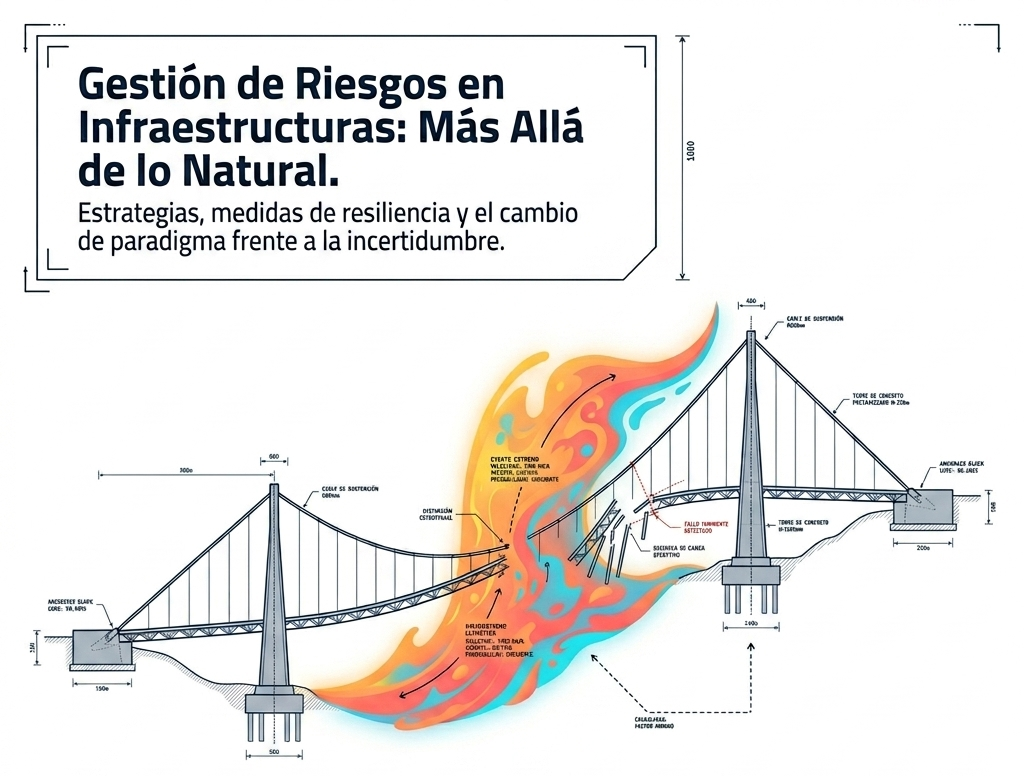

Contexto y problemática de la infraestructura costera.

La industria de la construcción es responsable de aproximadamente el 30 % del consumo de energía mundial, del 40 % del consumo de recursos naturales y de cerca del 30 % de las emisiones de gases de efecto invernadero. En este contexto, los puentes costeros son activos críticos y costosos cuya durabilidad se ve comprometida por la penetración de iones de cloruro.

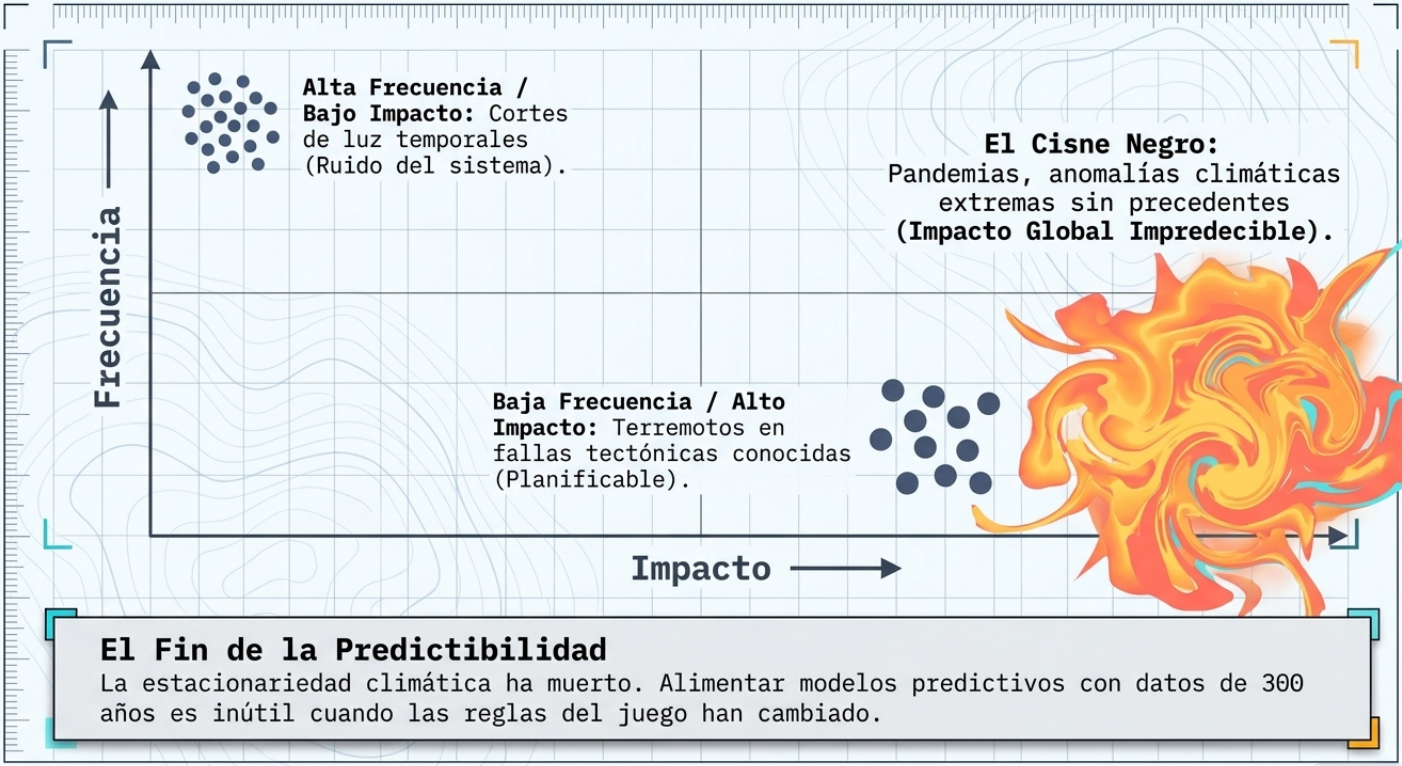

Desafíos identificados en el mantenimiento tradicional:

- Inadecuación de las estimaciones: Los métodos convencionales de estimación de costes y de mantenimiento resultan insuficientes para las necesidades complejas actuales.

- Detección tardía: los enfoques tradicionales a menudo no logran identificar el daño interno hasta que es visible o estructuralmente grave.

- Falta de integración: Existe una brecha significativa entre las técnicas de detección de daños en ingeniería estructural y los marcos de evaluación de sostenibilidad (economía y ecología).

Marco metodológico: el método PSD y la monitorización estructural.

La investigación propone el uso de la densidad espectral de potencia (PSD) como herramienta de identificación no destructiva basada en el dominio de la frecuencia.

Funcionamiento del método PSD:

- Análisis de señales: transforma la respuesta vibratoria de la estructura (estimulada de forma periódica o aleatoria) al dominio de la frecuencia mediante la transformada de Fourier.

- Relación rigidez-frecuencia: los picos en el espectro PSD corresponden a las frecuencias naturales de la estructura. La corrosión por cloruros reduce la sección transversal de las barras de refuerzo y aumenta el agrietamiento, lo que disminuye la rigidez local y altera estas frecuencias.

- Ventajas técnicas: es una función de segundo orden altamente no lineal y sensible a los parámetros estructurales, lo que permite localizar y cuantificar el daño con precisión.

El modelo de predicción de vida útil (Tuutti):

El marco utiliza el modelo de Tuutti para vincular la vida útil con la corrosión. Este proceso se divide en dos fases:

- Iniciación: tiempo hasta que los cloruros alcanzan el umbral crítico en el refuerzo (estimado mediante la segunda ley de Fick).

- Propagación: tiempo durante el cual la corrosión se extiende hasta causar daños graves o fallos.

Evaluación de la sostenibilidad del ciclo de vida (LCSA).

El estudio evalúa el impacto de las estrategias de mantenimiento en tres pilares fundamentales, integrados mediante bases de datos como Ecoinvent y programas informáticos como OpenLCA.

Evaluación de costes a lo largo del ciclo de vida (LCCA)

El análisis económico tiene en cuenta todos los gastos, desde la construcción hasta la eliminación final, y ajusta los costes futuros a su valor presente con una tasa de descuento del 5 %.

- Componentes del coste: inspección, reparación, demolición de partes dañadas, reciclaje de escombros e instalación de nuevo refuerzo.

- Resultado: el uso de PSD permite optimizar los tiempos de intervención y evitar reparaciones prematuras o fallos catastróficos.

Evaluación ambiental (E-LCA)

Utilizando el método ReCiPe, se analizan las categorías de impacto en tres puntos finales:

- Salud humana: reducción de la toxicidad y de los contaminantes.

- Ecosistemas: minimización de la ocupación del suelo y de la eutrofización.

- Recursos: eficiencia en el uso de materias primas y de energía.

Evaluación social (S-LCA).

Se emplea el complemento SOCA para evaluar las «horas de riesgo» de diversos grupos de interés.

- Grupos evaluados: trabajadores, comunidad local, sociedad y actores de la cadena de valor.

- Subcategorías: seguridad y salud, salarios justos, horas de trabajo y derechos indígenas.

Análisis de resultados: PSD frente a métodos convencionales.

El estudio aplicó el marco a un modelo simulado del puente de Galicia (España), de 1980 metros de longitud y 40 tramos, y obtuvo los siguientes resultados comparativos:

| Dimensión de impacto | Método convencional | Método PSD | Mejora/ahorro |

| Coste total (LCC) | 470,113.12 € | 248,001.19 € | ~222,111.92 € (40%) |

| Impacto ambiental (puntos) | Mayor impacto en todas las categorías | Reducción significativa | 14.33% (Tablero) / 29.62% (Columnas) |

| Riesgo social (horas de riesgo) | Muy elevado (ej. 200,365 para trabajadores) | Reducción drástica (ej. 45,650 para trabajadores) | Reducción de hasta el 32% |

Análisis de la toma de decisiones (AHP-TOPSIS).

Para consolidar estos datos, se utilizó el Proceso de Jerarquía Analítica (AHP) para asignar pesos a los criterios y la Técnica para el Orden de Preferencia por Similitud con la Solución Ideal (TOPSIS) para clasificar las estrategias.

El método basado en PSD obtuvo una puntuación de 1,00 (proximidad ideal), mientras que el método convencional obtuvo 0,00, lo que confirma la superioridad absoluta del enfoque inteligente.

Conclusiones e implicaciones prácticas.

La integración del análisis PSD con la evaluación de sostenibilidad transforma el mantenimiento de «reactivo» a «proactivo y eficiente en recursos».

Hallazgos fundamentales:

- Detección temprana: la sensibilidad del análisis basado en la frecuencia permite identificar deterioros antes de que comprometan la seguridad estructural.

- Robustez: el análisis de sensibilidad confirmó que los resultados son estables frente a variaciones en la tasa de descuento (3-7 %) y en los niveles de ruido de las señales (5-15 %).

- Sostenibilidad integral: el marco no solo ahorra capital financiero, sino que también reduce la huella de carbono y mejora el bienestar social al minimizar las interrupciones y los riesgos para la comunidad.

Recomendaciones para la gestión de activos:

Se sugiere que las autoridades de transporte y los gestores de infraestructura adopten sistemas de monitorización adaptativos basados en vibraciones. Aunque el estudio se basa en simulaciones, la «orquestación de ciencias» propuesta ofrece una hoja de ruta clara para lograr una infraestructura costera resiliente y alineada con los objetivos de desarrollo sostenible globales.

«El método basado en PSD va más allá de sus capacidades diagnósticas y ofrece un camino hacia prácticas de mantenimiento predictivas, preventivas y eficientes en términos de recursos.»

Referencia:

HADIZADEH-BAZAZ, M.; NAVARRO, I.J.; YEPES, V. (2026). Smart Integration of Non-Destructive Damage Detection and Life-Cycle Assessment for Sustainable Maintenance of Coastal Bridges. Smart and Sustainable Built Environment DOI 10.1108/SASBE-11-2025-0691

Esta obra está bajo una licencia de Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0 Internacional.