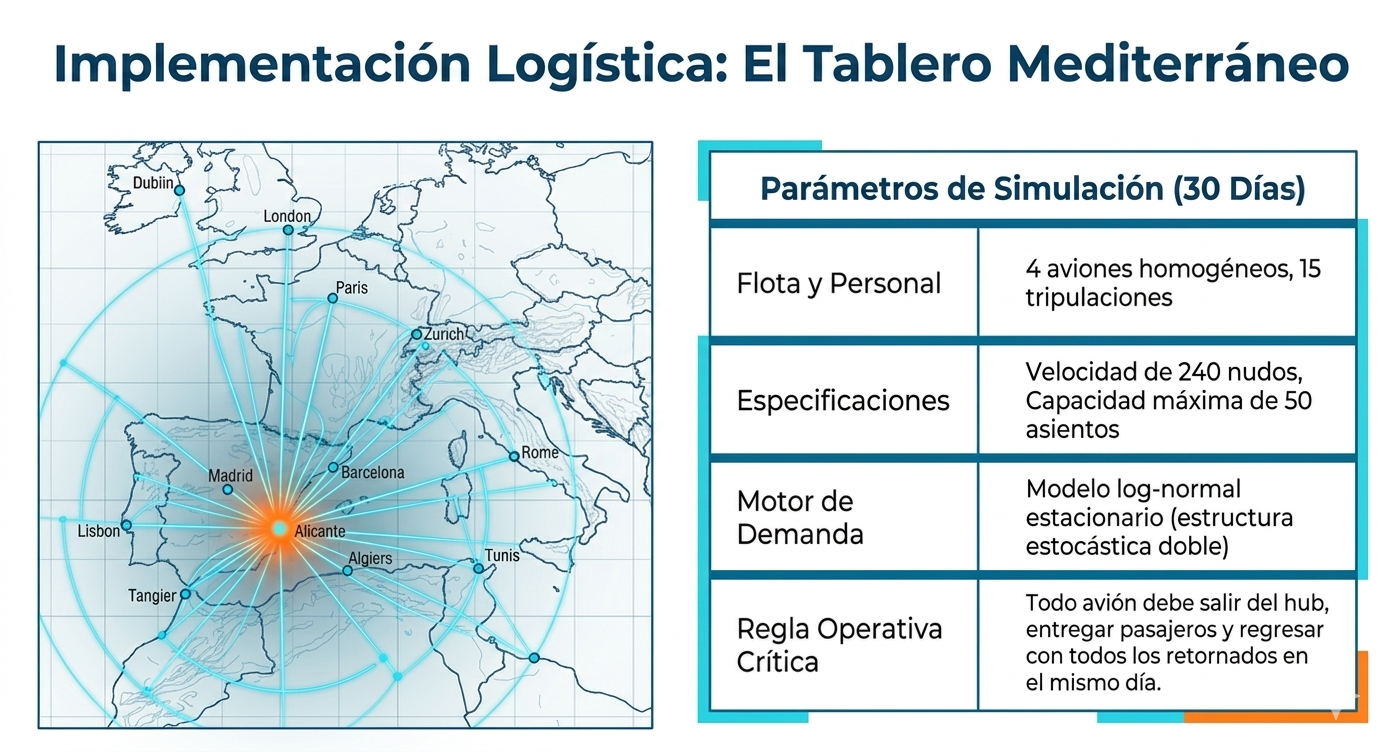

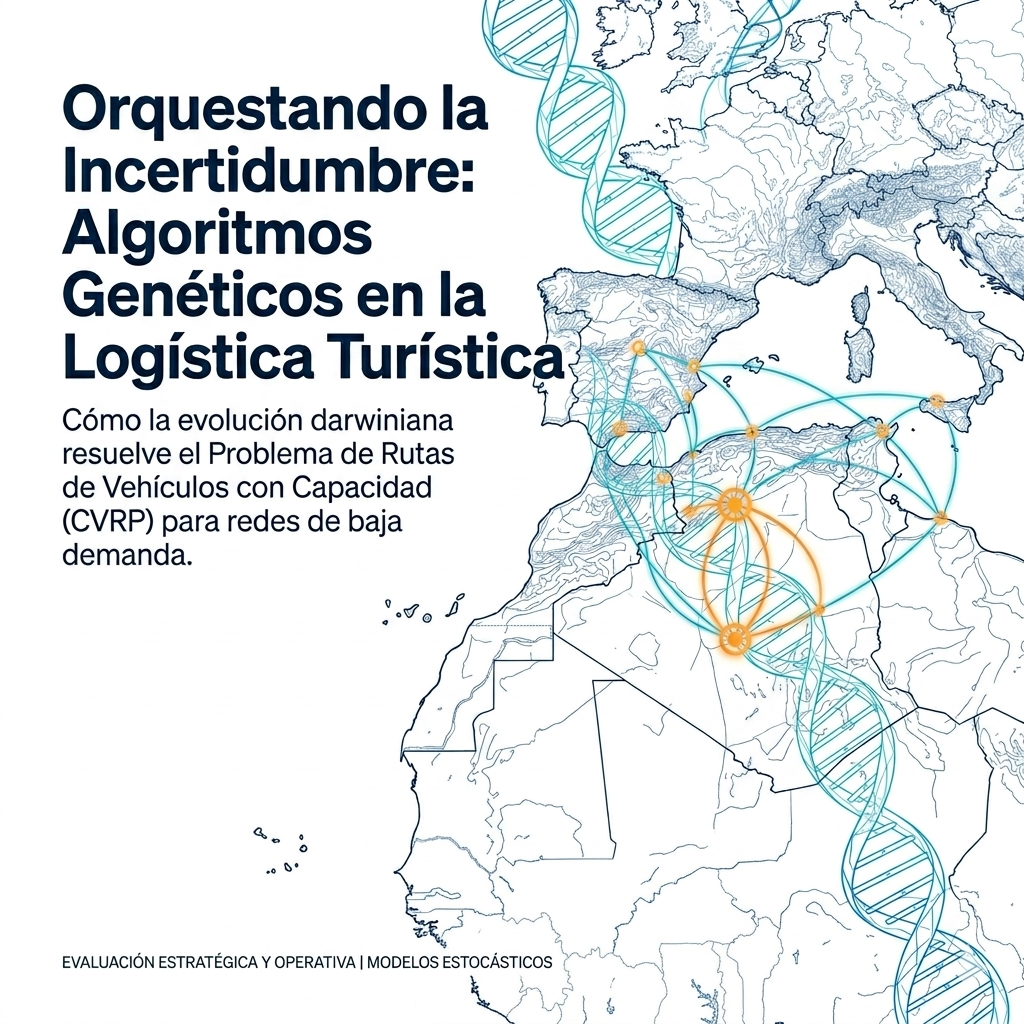

Gestionar la logística de un operador turístico consiste, en esencia, en intentar imponer orden a un sistema inherentemente caótico. El desafío es monumental: coordinar rutas a 30 destinos distintos desde un centro de operaciones como el de Alicante, con una flota limitada de cuatro aviones y quince tripulaciones, en el que cada asiento cuenta.

Gestionar la logística de un operador turístico consiste, en esencia, en intentar imponer orden a un sistema inherentemente caótico. El desafío es monumental: coordinar rutas a 30 destinos distintos desde un centro de operaciones como el de Alicante, con una flota limitada de cuatro aviones y quince tripulaciones, en el que cada asiento cuenta.

En este entorno de baja demanda, los costes son fijos, pero la realidad es volátil: las cancelaciones de última hora y las reservas inesperadas convierten los planes iniciales en papel mojado. ¿Cómo se puede determinar la rentabilidad cuando el escenario cambia cada minuto? La solución más avanzada no proviene de la programación lineal clásica, sino de los principios de la biología evolutiva.

Inspirado en el estudio de Medina y Yepes sobre la aplicación de algoritmos genéticos (AG) al problema de rutas de vehículos con capacidad (CVRP), este análisis desglosa cómo la «supervivencia del más apto» se traduce en una estabilidad financiera sin precedentes para el sector aéreo. Podéis descargar el artículo completo aquí.

La «naturaleza» como el mejor ingeniero de rutas.

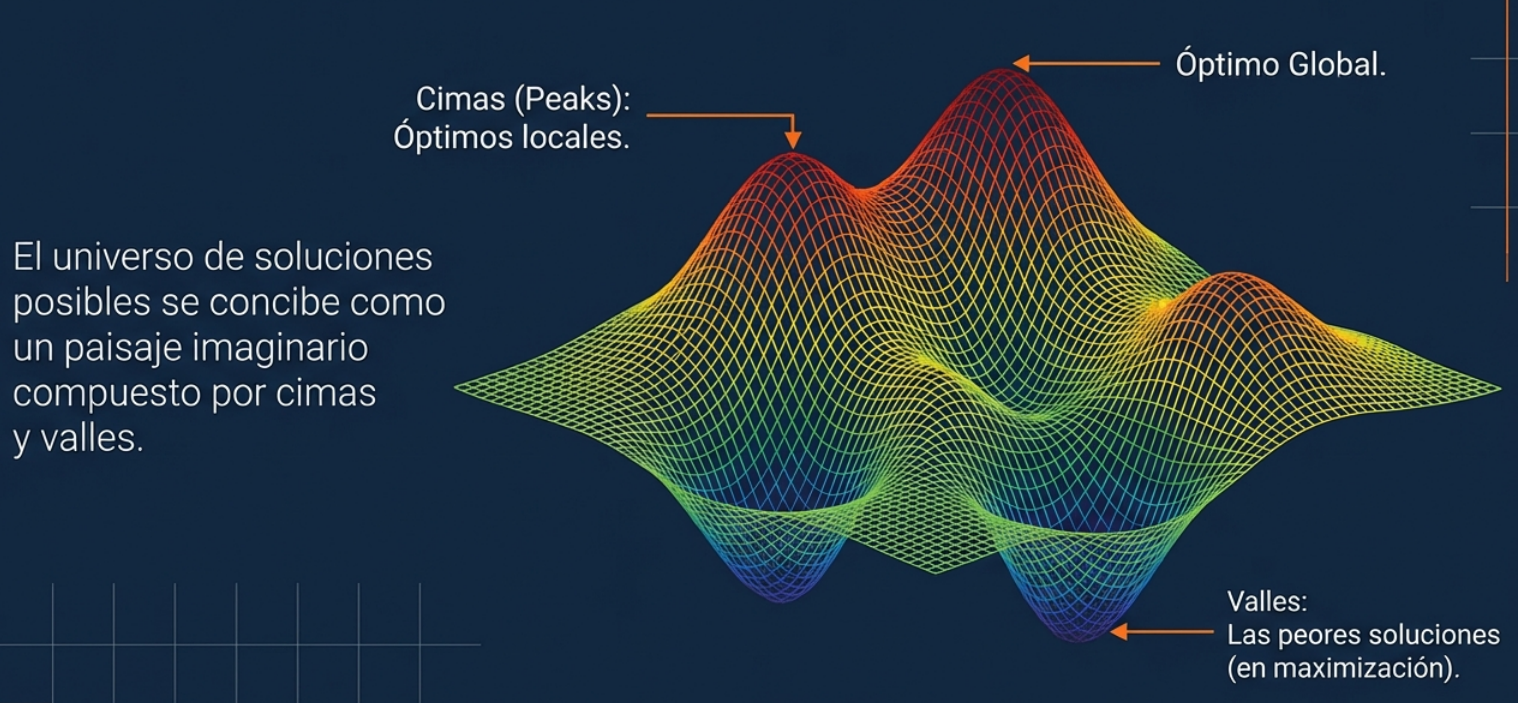

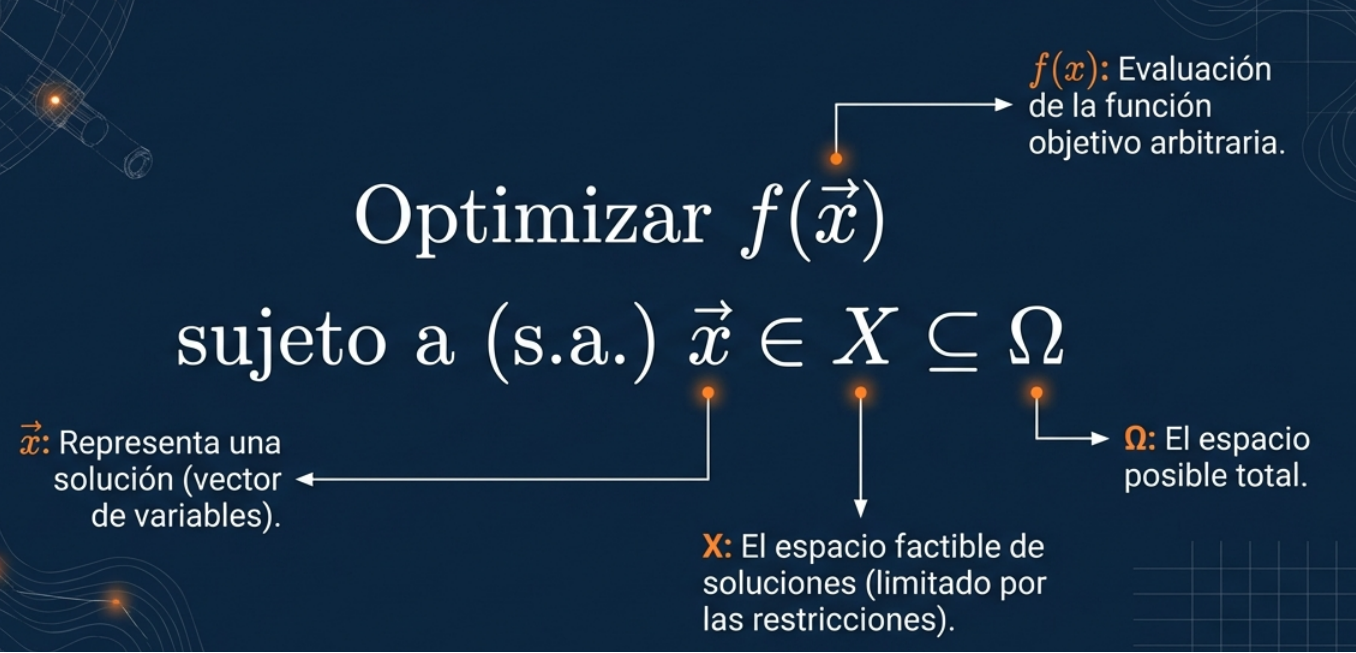

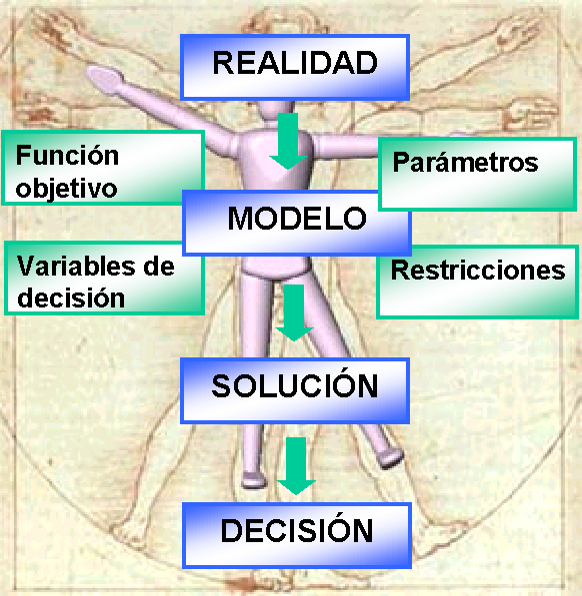

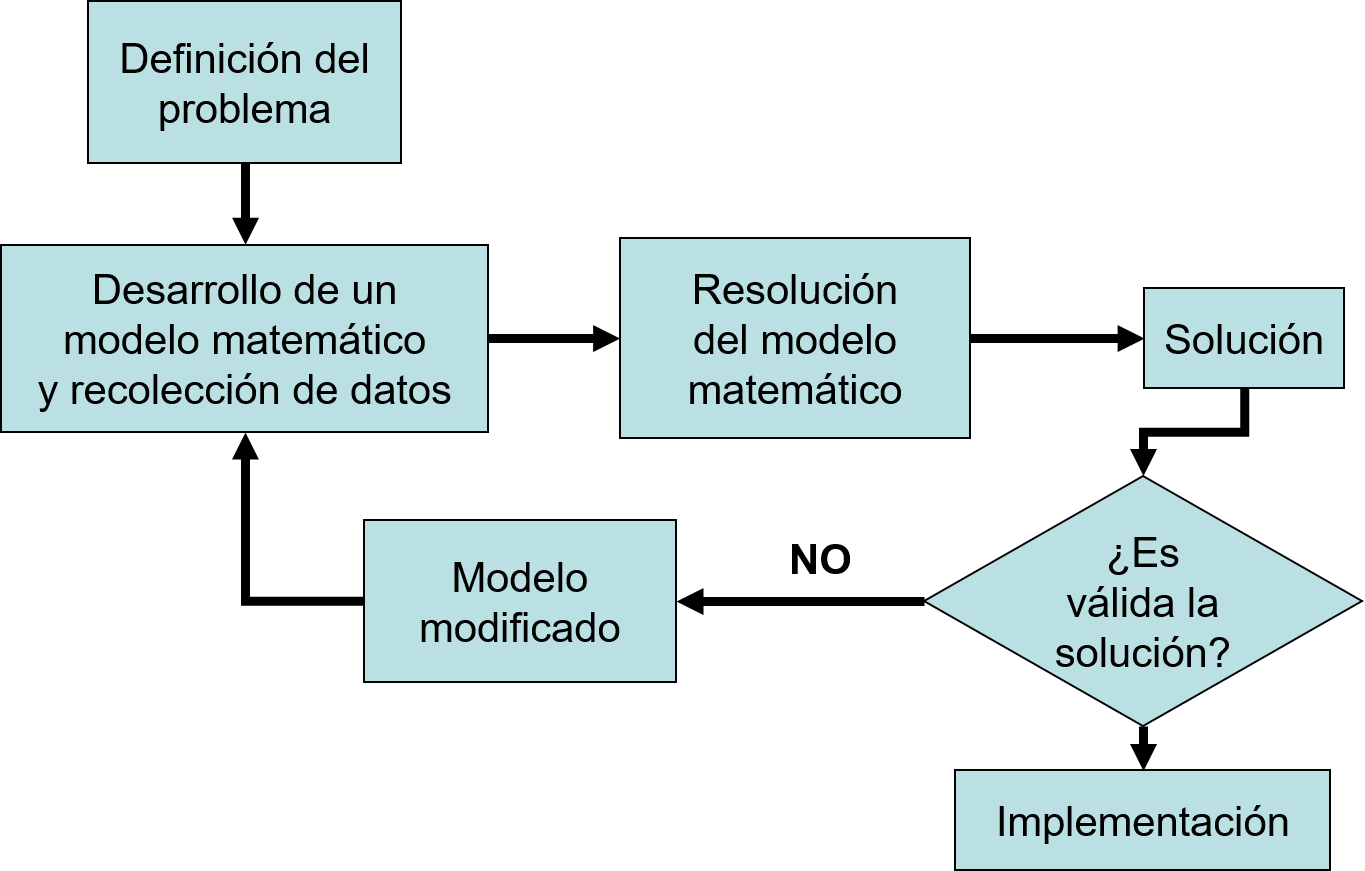

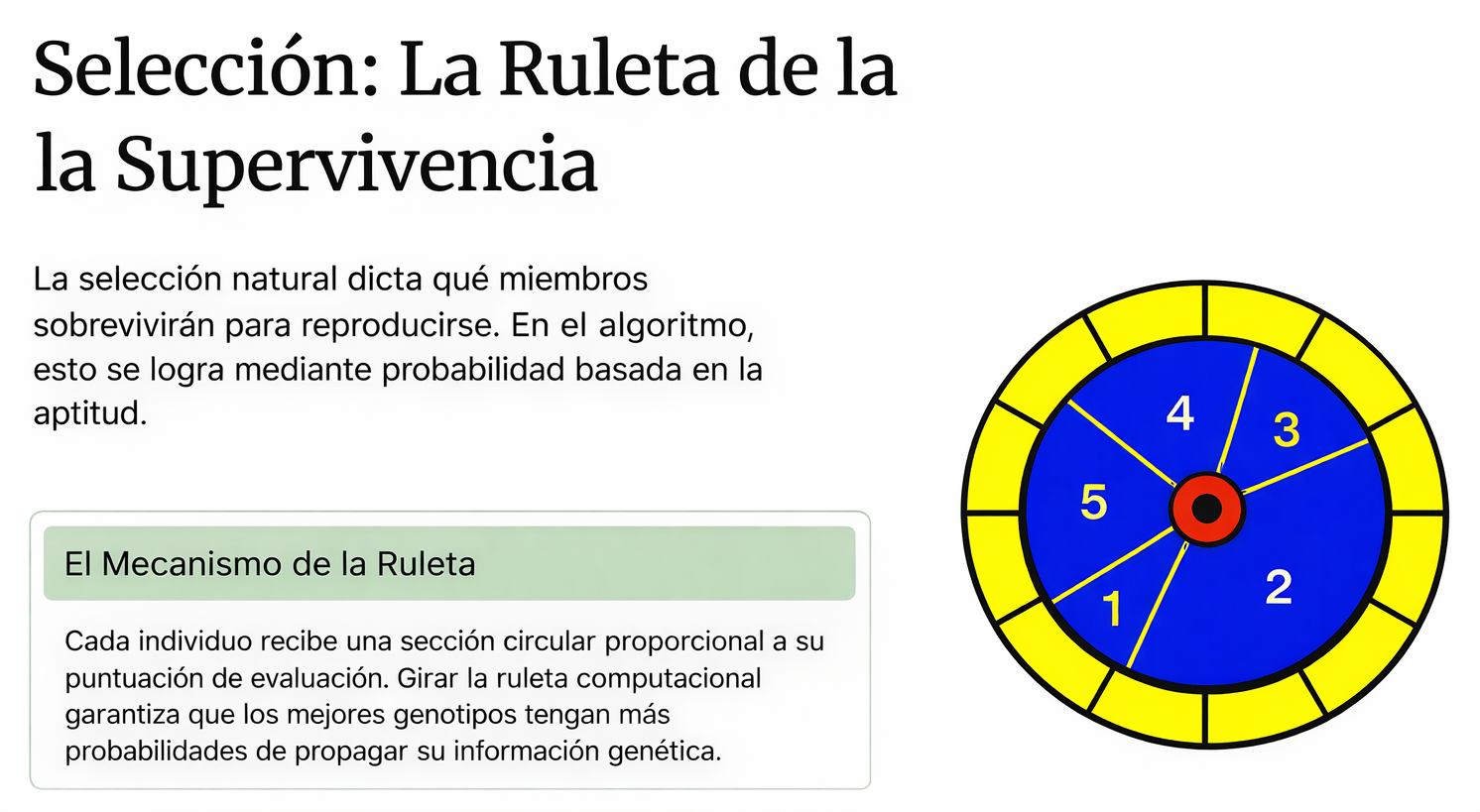

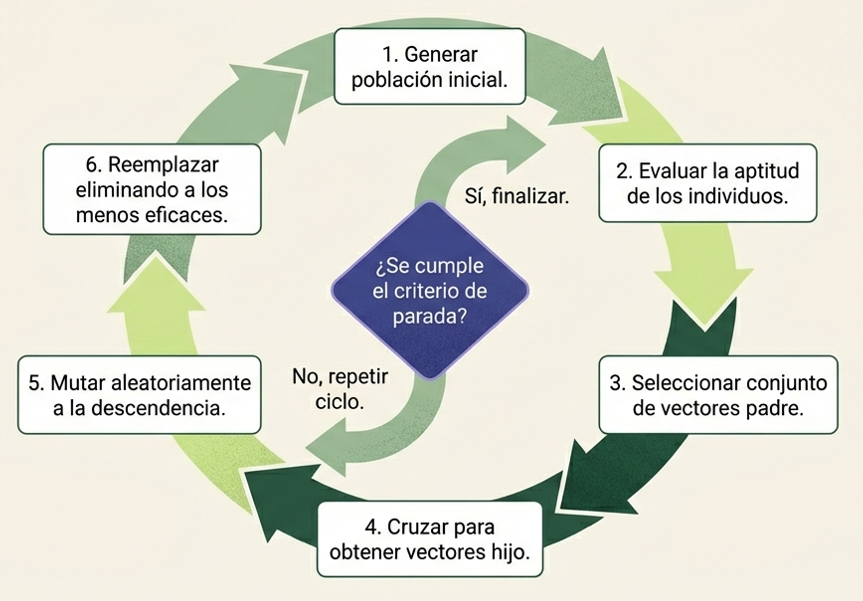

En logística avanzada, los métodos deterministas tradicionales se topan con un obstáculo insalvable cuando el número de destinos crece exponencialmente. Calcular la ruta óptima para una red que abarque de Casablanca a Venecia mediante fuerza bruta matemática resulta inmanejable en términos computacionales. Los algoritmos genéticos resuelven este problema emulando la evolución mediante los procesos de selección, cruce y mutación. En lugar de buscar una única respuesta perfecta, el sistema mantiene una «población» de soluciones que compiten entre sí.

Este enfoque permite gestionar restricciones ambiguas o contradictorias, como maximizar la ocupación frente a minimizar el tiempo de vuelo, de una forma que la matemática rígida no puede. El AG no solo busca, sino que también aprende a explorar.

«La característica específica de los AG es la exploración paralela y eficiente del espacio de soluciones, basada en la explotación de soluciones óptimas inducidas por los operadores de cruce y en la exploración de soluciones nuevas forzada por los operadores de mutación».

El poder de los «Tres Padres»: una recombinación genética única.

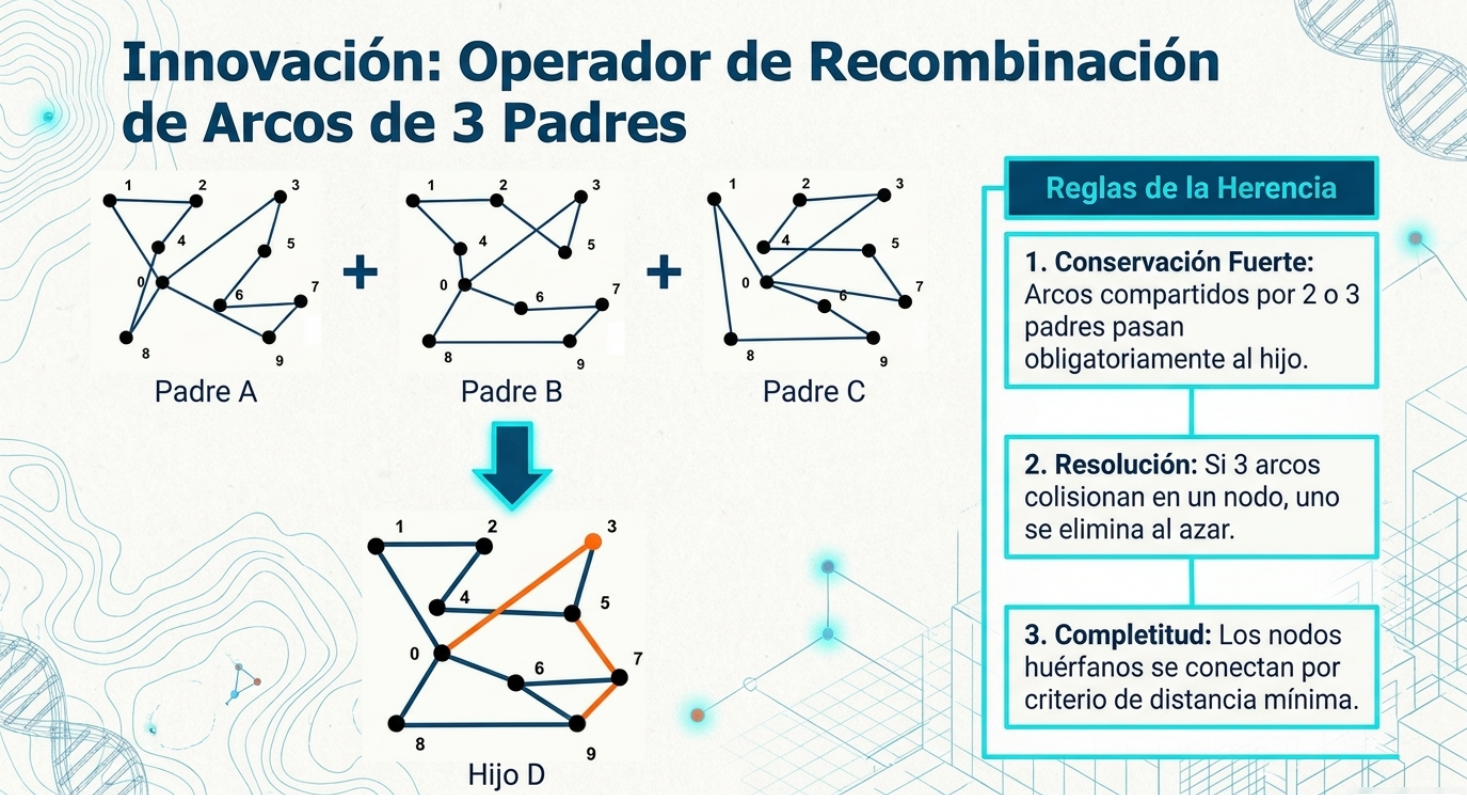

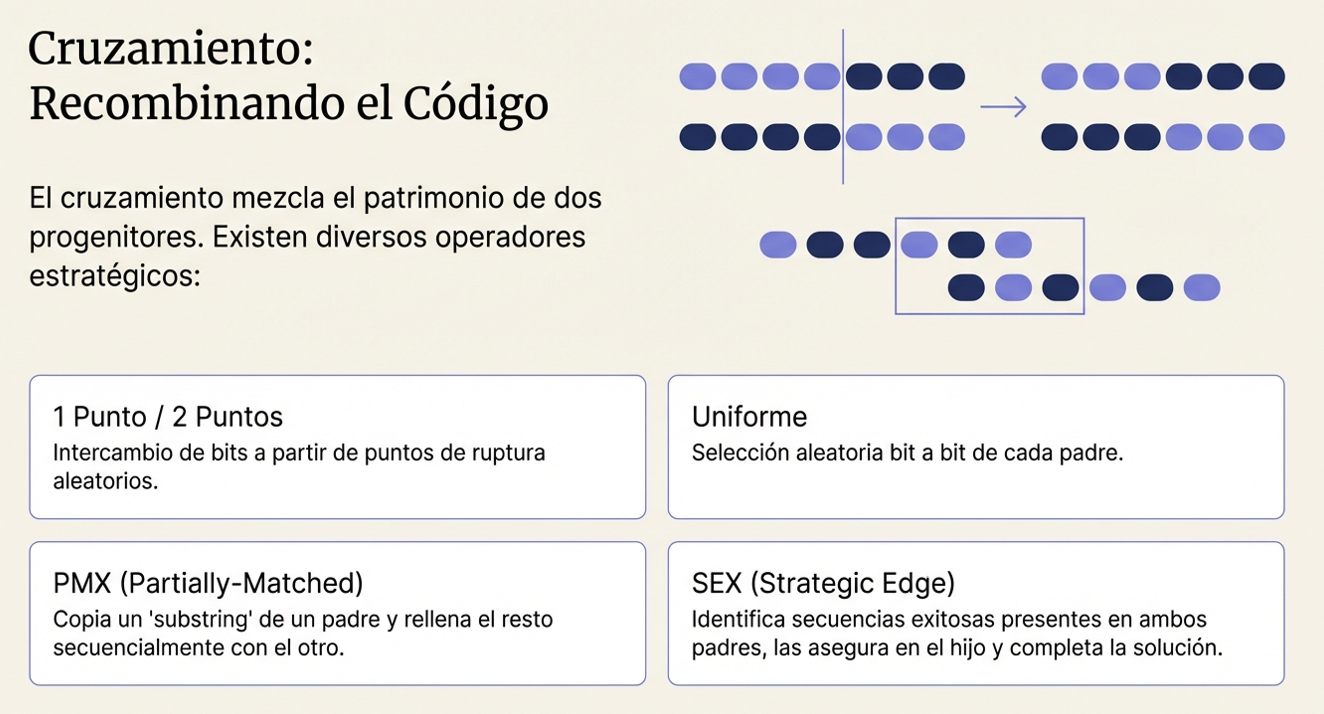

La gran innovación técnica que se destaca en el estudio es el uso de un operador de recombinación de tres progenitores (three-parent edge-mapped recombination operator). Mientras que en la genética biológica la herencia es dual, en la optimización de redes de distribución tres progenitores ofrecen una mayor riqueza de datos para generar una «descendencia» (una ruta) más robusta.

Este método extrae las mejores conexiones (arcos) de tres soluciones distintas. Si una conexión específica aparece en dos o tres de los «padres», se preserva en el «hijo» porque se considera una pieza de alta eficiencia. Para garantizar la viabilidad de la ruta, el algoritmo incluye una lógica de resolución de conflictos: si tres arcos convergen en un mismo nodo de la descendencia, el sistema elimina aleatoriamente uno de ellos para mantener la estructura de la red. Este enfoque de triple herencia permite alcanzar soluciones óptimas con una velocidad y precisión que superan con creces a los cruces tradicionales de dos progenitores.

De la incertidumbre del 43 % a la estabilidad del 2,7 %.

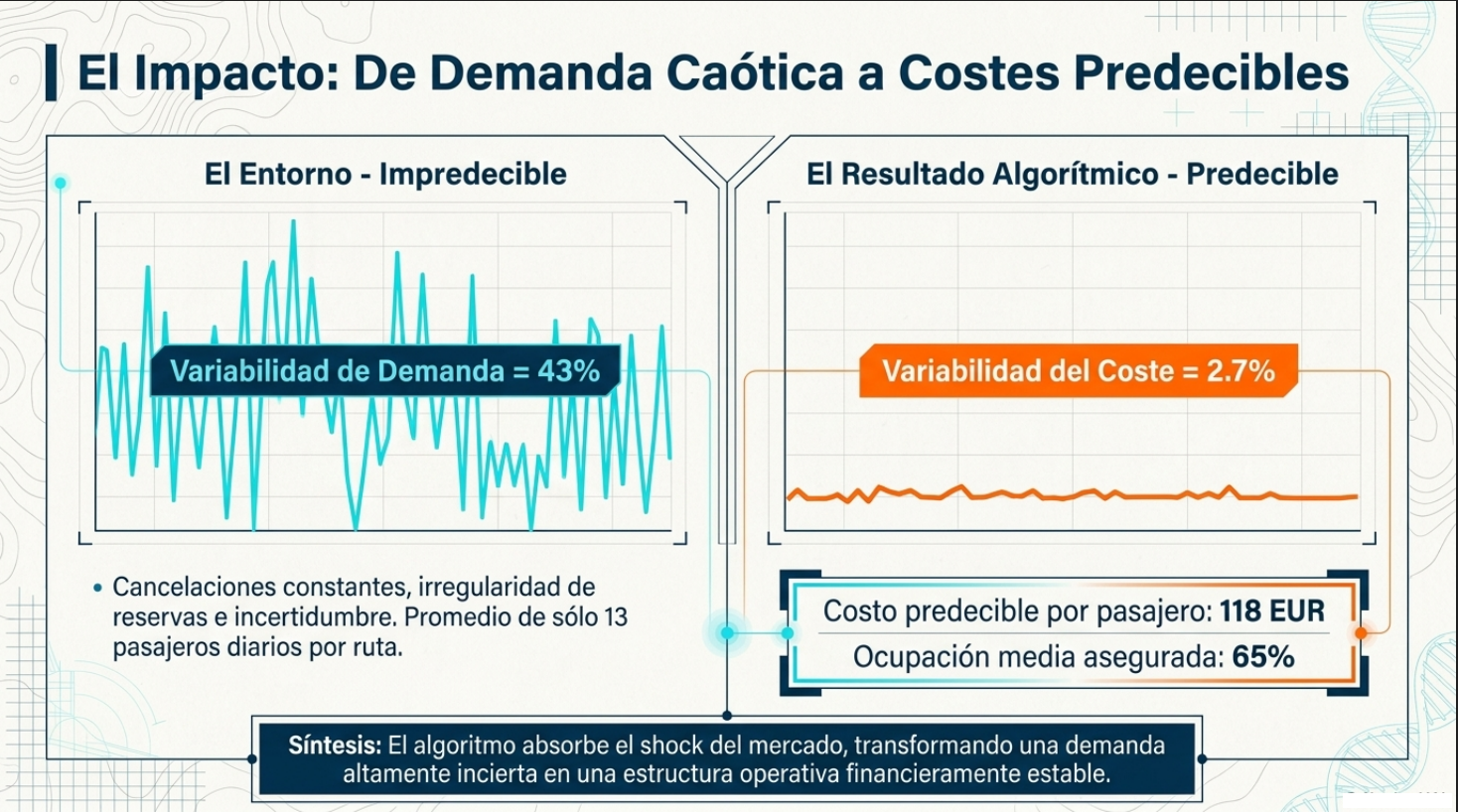

El impacto real de los AG se mide en la transformación de la volatilidad en previsibilidad. Al modelar la demanda de destinos como Ajaccio, Túnez o Malta mediante estructuras estocásticas, el estudio revela una capacidad asombrosa para absorber la incertidumbre. Con una flota de cuatro aviones de cincuenta asientos y quince tripulaciones, el sistema gestionó un volumen total de aproximadamente ochocientos pasajeros, con métricas de eficiencia envidiables.

Los datos son elocuentes: mientras que la demanda individual por destino presenta un coeficiente de variación del 43 % —una pesadilla operativa—, la optimización diaria reduce la variabilidad del coste por pasajero transportado a un asombroso 2,7 %. En la práctica, esto significa:

- Coste medio por pasajero: 118 EUR.

- Ocupación media de asientos: 65 %.

- Velocidad de crucero optimizada: 240 nudos.

El sistema es tan eficiente a la hora de reorganizar escalas y rutas en función de la demanda real que el impacto financiero final permanece prácticamente inalterado a pesar de las fluctuaciones del mercado.

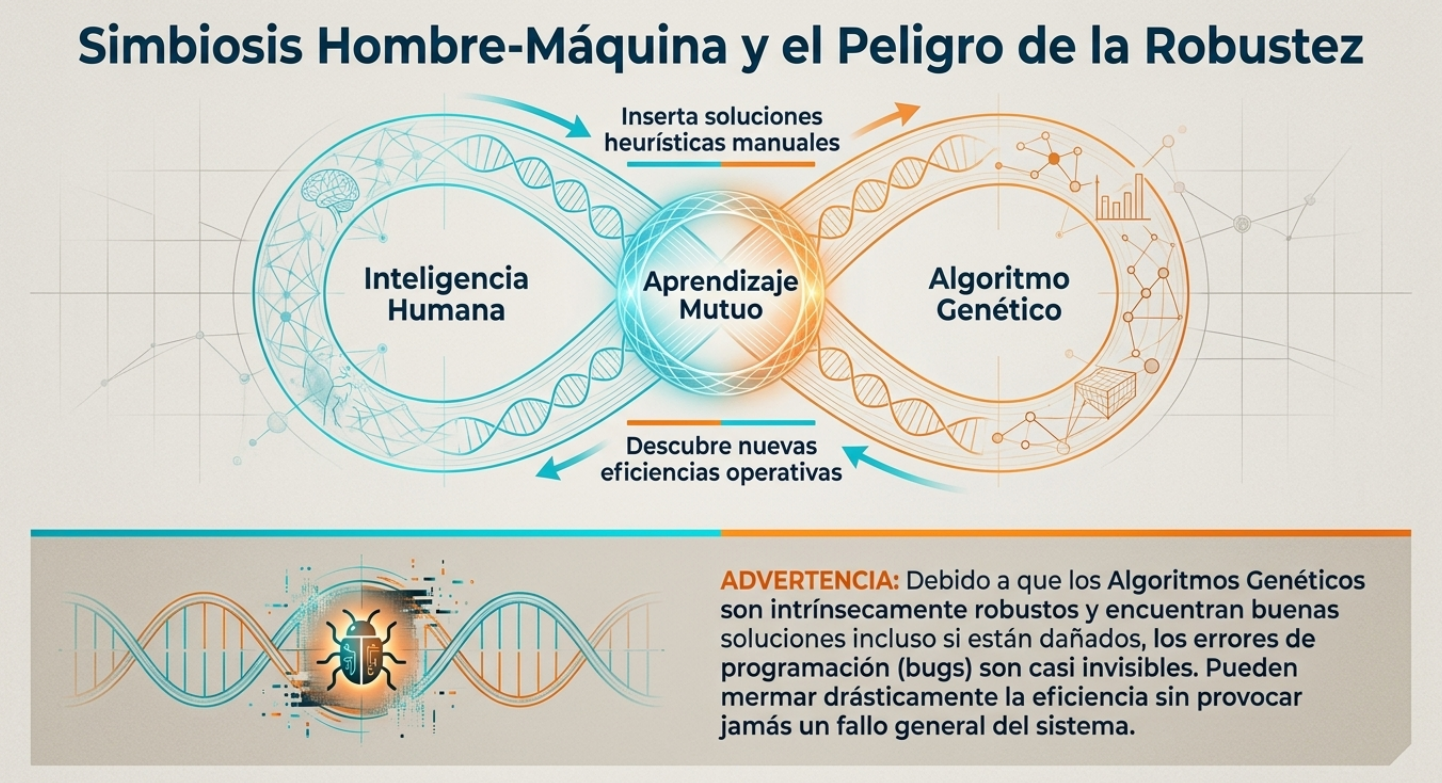

El «fantasma en la máquina»: el riesgo de la robustez excesiva.

Desde la perspectiva de la transformación digital, los AG presentan una paradoja fascinante: su robustez puede ser su mayor peligro. Diseñado para ofrecer siempre una solución viable, un código con errores profundos puede seguir funcionando y entregando resultados «aparentemente buenos» sin que el sistema se colapse.

El riesgo no es el fallo catastrófico, sino el equilibrio subóptimo. Un error oculto en el algoritmo podría estar dejando sobre la mesa un 5 % o un 10 % de beneficio potencial, camuflado por la capacidad del algoritmo para «sobrevivir» a sus propios defectos de programación. Esto subraya la importancia de la supervisión experta, ya que en los sistemas que evolucionan por sí mismos la validación humana es la única garantía de que no operamos con una ineficiencia invisible pero costosa.

El futuro es la interacción humano-máquina.

Los AGV no son herramientas de reemplazo, sino de colaboración. El estudio subraya la importancia de la interfaz gráfica, que permite al gestor logístico interactuar con el proceso en tiempo real. Un ser humano puede «inyectar» soluciones basadas en su experiencia o en su intuición clínica, y el algoritmo las asimilará y refinará a lo largo de miles de generaciones.

Esta sinergia es fundamental para integrar los «costes virtuales». Mientras la máquina optimiza distancias y consumo de combustible, el ser humano puede definir variables subjetivas pero críticas, como la inconveniencia política de un aeropuerto en tensión o la complejidad social de una escala concreta. Al traducir estas percepciones en valores en la función de coste, el sistema evoluciona hacia una estrategia proactiva capaz de simular escenarios futuros en lugar de simplemente reaccionar ante las cancelaciones diarias.

Conclusión: hacia una logística evolutiva.

El éxito de la red de Alicante, que conecta 30 destinos del Mediterráneo y de Europa occidental, confirma un cambio de paradigma: en la logística moderna, la flexibilidad es más valiosa que la precisión absoluta. Los modelos rígidos se quiebran ante la volatilidad de la demanda, pero los sistemas evolutivos se fortalecen con ella.

En un mercado que no perdona la ineficiencia, la pregunta para los líderes del sector es clara: ¿es mejor buscar una solución «perfecta» una sola vez o diseñar un sistema que evolucione constantemente ante cada nuevo desafío? La respuesta, como demuestran Medina y Yepes, radica en aprender de la naturaleza para conquistar los cielos.

En esta conversación puedes escuchar las ideas más interesantes sobre este tema.

Este vídeo resume los aspectos clave del artículo.

Evolutionary_Tourism_Logistics

Referencia:

MEDINA, J.R.; YEPES, V. (2003). Optimization of touristic distribution networks using genetic algorithms. SORT, 27(1): 95-112.

Esta obra está bajo una licencia de Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0 Internacional.