La educación técnica atraviesa una tensión paradójica que amenaza los cimientos del pensamiento crítico. En las asignaturas de modelización y diseño estructural de los grados y másteres en Ingeniería de Caminos y Civil, la inteligencia artificial generativa (IAG) ha pasado de ser una novedad a convertirse en un estándar operativo. Sin embargo, esta adopción generalizada esconde un riesgo sistémico: el «desempleo cognitivo».

La educación técnica atraviesa una tensión paradójica que amenaza los cimientos del pensamiento crítico. En las asignaturas de modelización y diseño estructural de los grados y másteres en Ingeniería de Caminos y Civil, la inteligencia artificial generativa (IAG) ha pasado de ser una novedad a convertirse en un estándar operativo. Sin embargo, esta adopción generalizada esconde un riesgo sistémico: el «desempleo cognitivo».

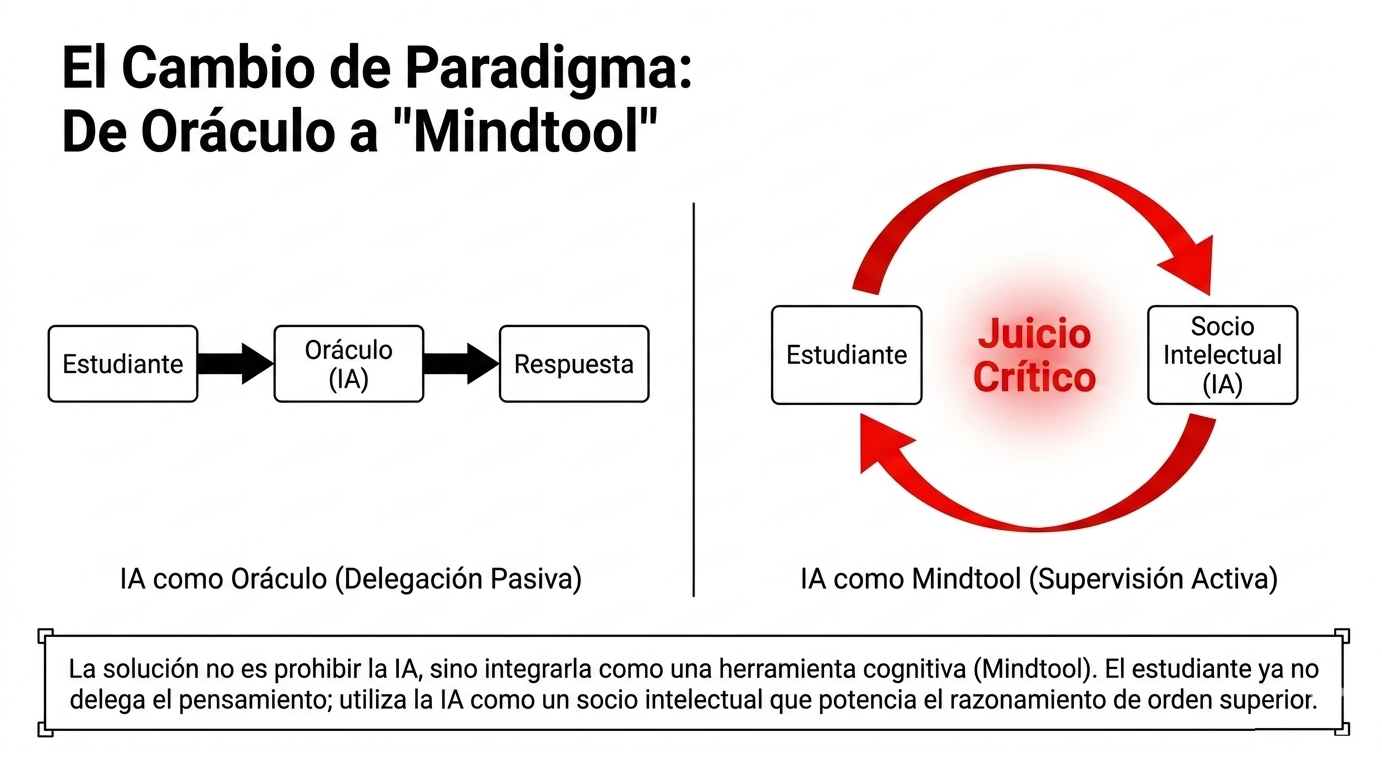

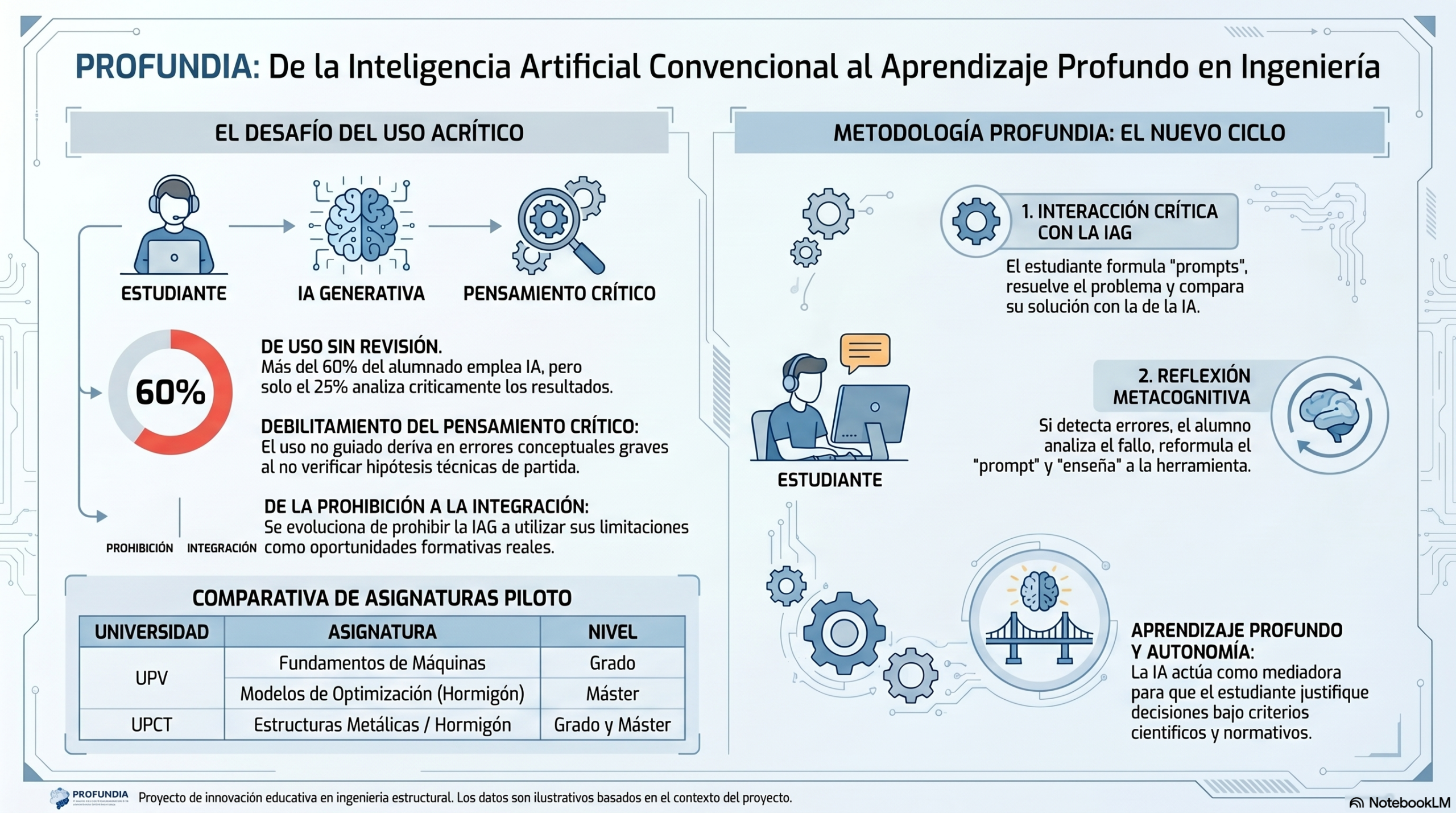

Datos recientes de la Universitat Politècnica de València (UPV) y la Universidad Politécnica de Cartagena (UPCT) revelan que, si bien el 60 % del alumnado utiliza estas herramientas, solo el 25 % revisa críticamente los resultados. La solución no consiste en imponer restricciones, sino en diseñar una arquitectura pedagógica que integre la IA como un «socio intelectual» bajo el enfoque de mindtools (Jonassen et al., 1999) para potenciar y no sustituir el pensamiento de orden superior.

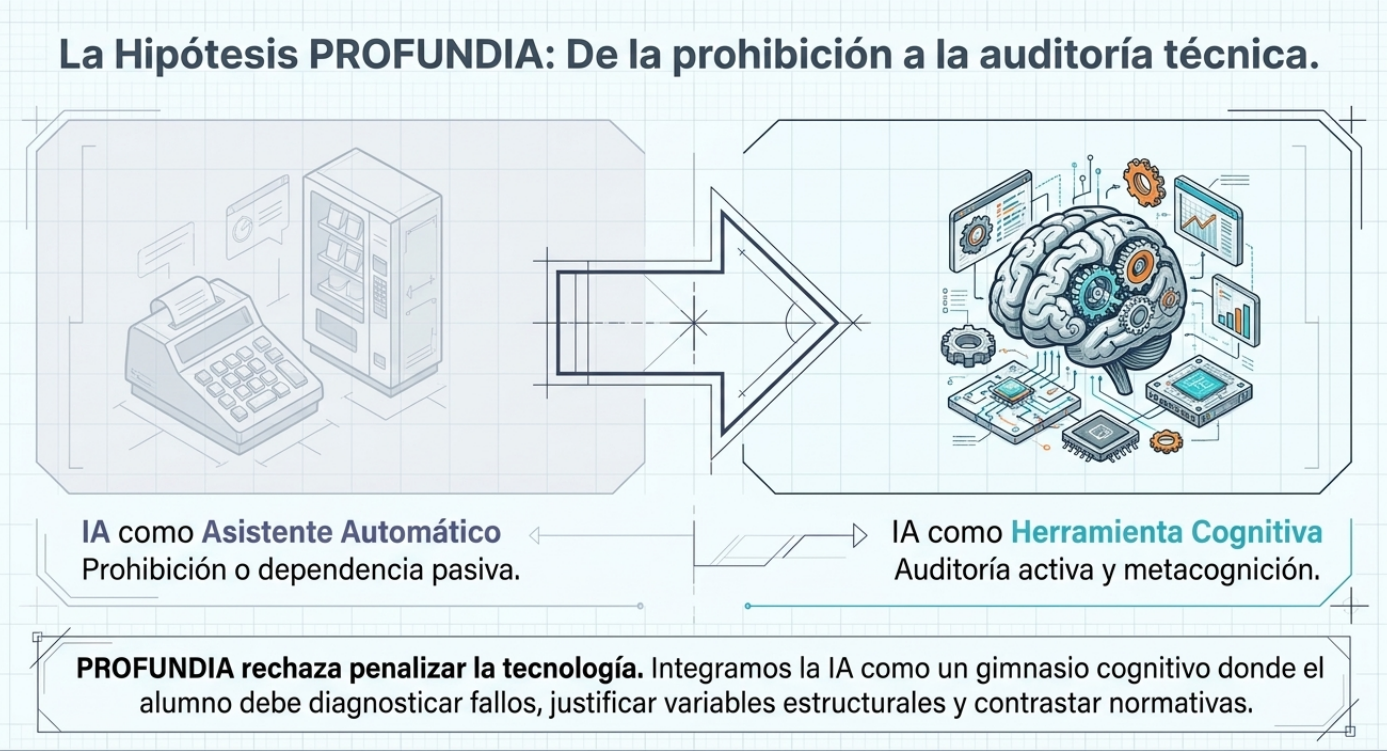

Ante este desafío nace el proyecto PROFUNDIA. Nuestra misión es clara: transformar la IA de un «atajo peligroso» en un motor de aprendizaje profundo que refuerce la autonomía del futuro ingeniero.

El éxito no radica en la tecnología, sino en la arquitectura de la auditoría humana.

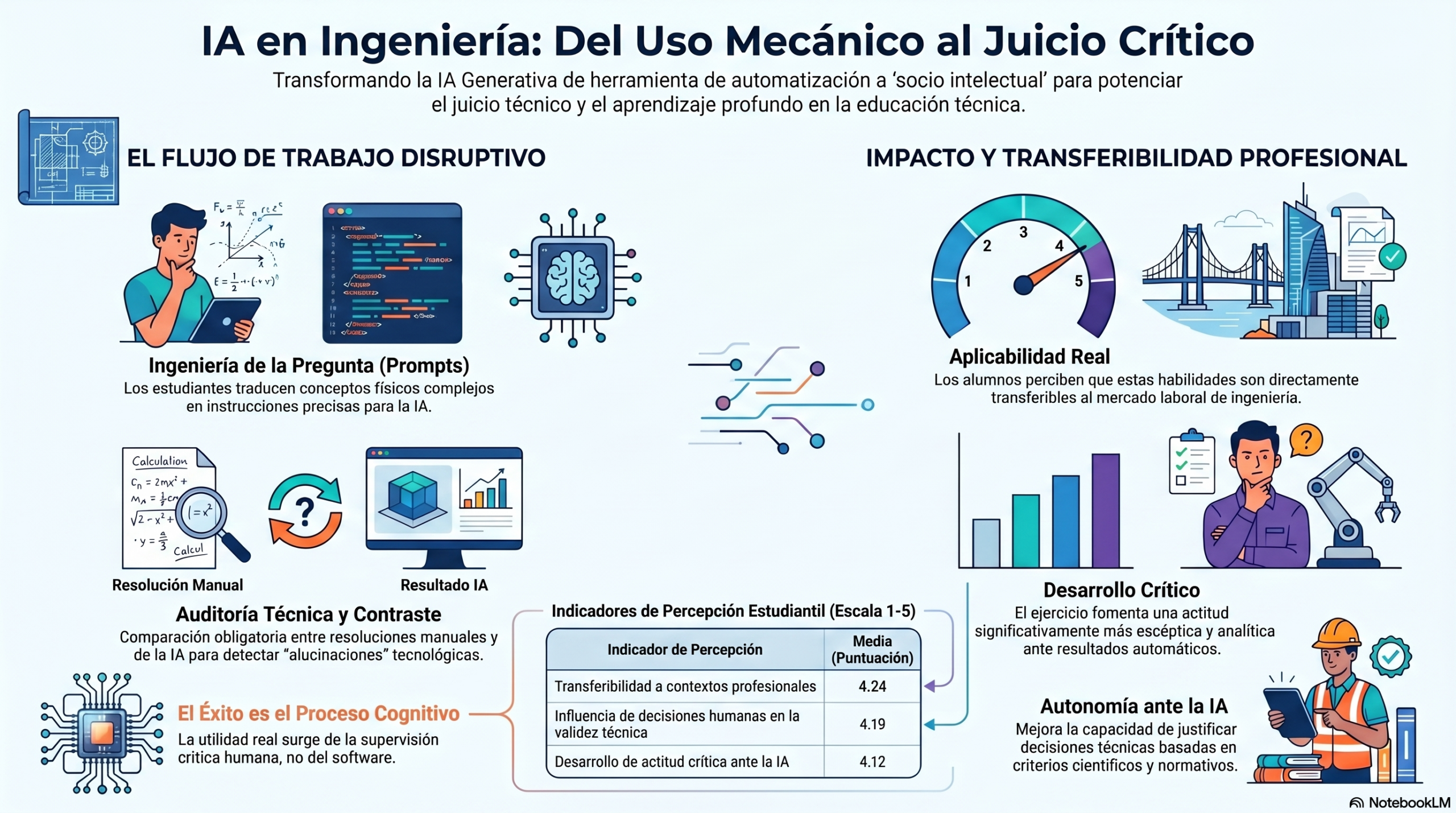

El hallazgo central de la investigación realizada sobre una muestra de 100 estudiantes subraya que la utilidad percibida de la IA no es una propiedad intrínseca del software, sino del proceso de supervisión. La resolución de problemas de alta responsabilidad física, en los que el error tiene consecuencias estructurales, depende de la capacidad de reformularlos y de una supervisión crítica.

En este nuevo paradigma, el valor profesional se desplaza del «saber hacer» procedimental —que puede automatizarse— al «saber validar». El éxito pedagógico está hoy condicionado por la arquitectura del proceso cognitivo de auditoría, en el que el ingeniero actúa como filtro final de la veracidad técnica.

«Los resultados obtenidos mediante análisis estadísticos multivariantes demuestran que el éxito no reside en el mero uso de la tecnología, sino en el proceso cognitivo de auditoría humana».

Ingeniería de la pregunta: el arte de iterar.

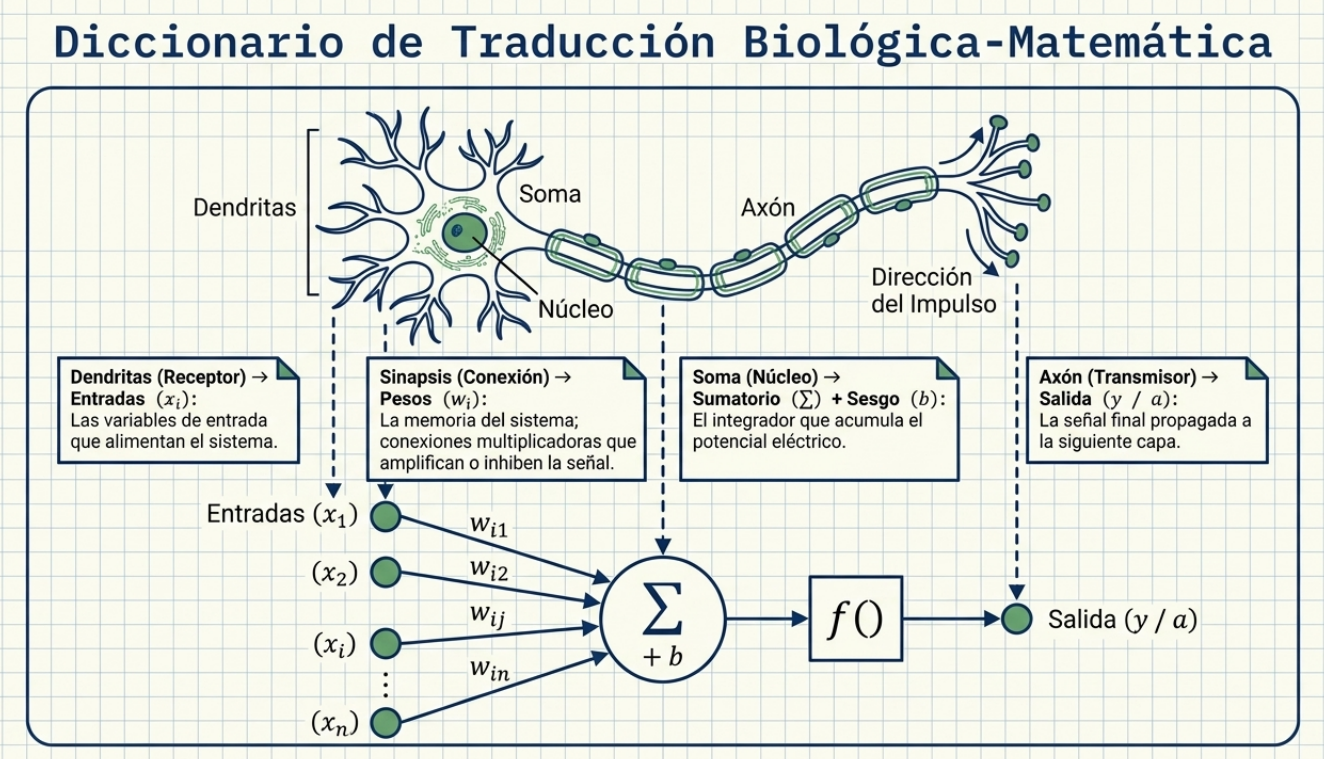

Uno de los pilares de la interacción estratégica es la «ingeniería de la pregunta». No se trata de un simple comando de texto, sino de un ejercicio de abstracción en el que el estudiante debe traducir variables estructurales y conceptos físicos en instrucciones lógicas. El estudio destaca que la clave de esta habilidad transversal no radica en el primer intento, sino en la capacidad de iterar.

El ítem 2 del estudio («Las iteraciones de los mensajes de texto me ayudaron a mejorar progresivamente la calidad») obtuvo una media de 4,11, lo que confirma que la calidad técnica surge de un diálogo dialéctico con la máquina. Este proceso de refinamiento constante combate la «complacencia tecnológica» y garantiza que el usuario mantenga el control sobre el resultado final.

El valor disruptivo de buscar deliberadamente el error.

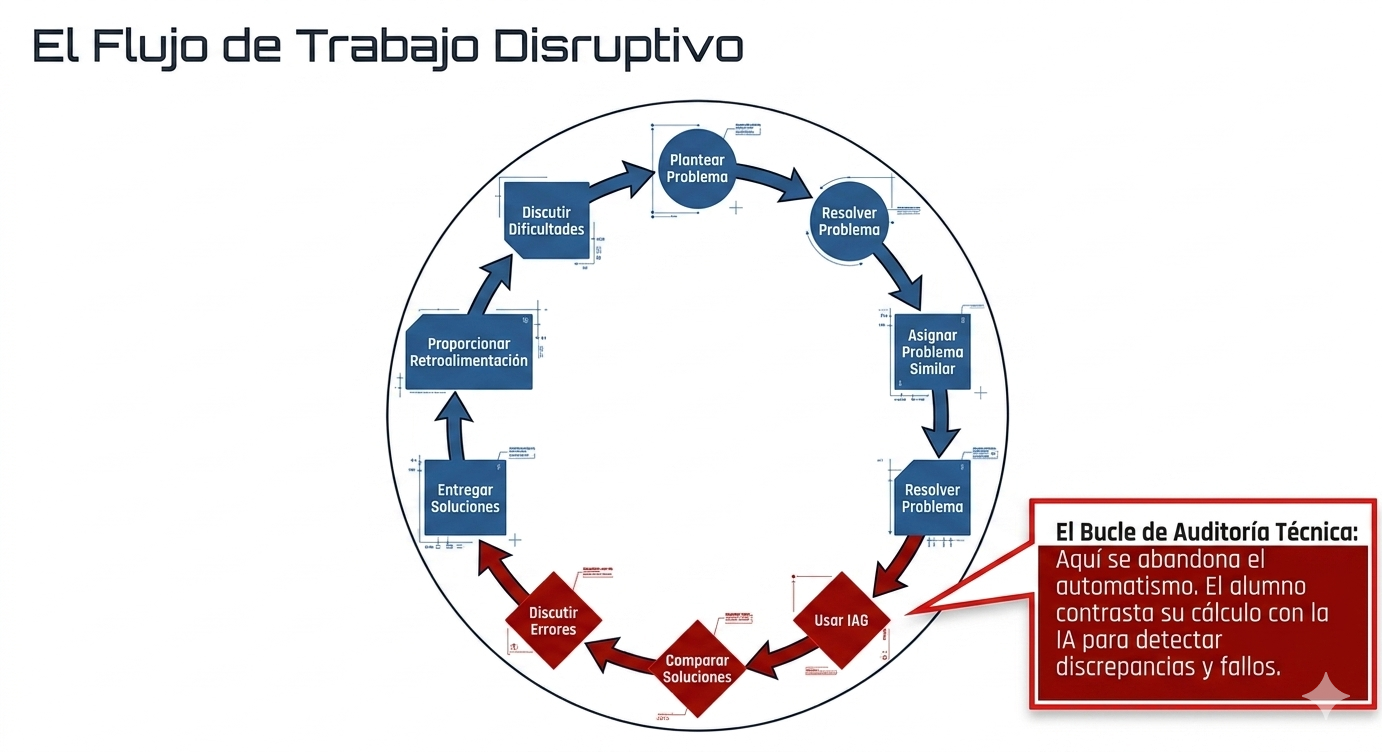

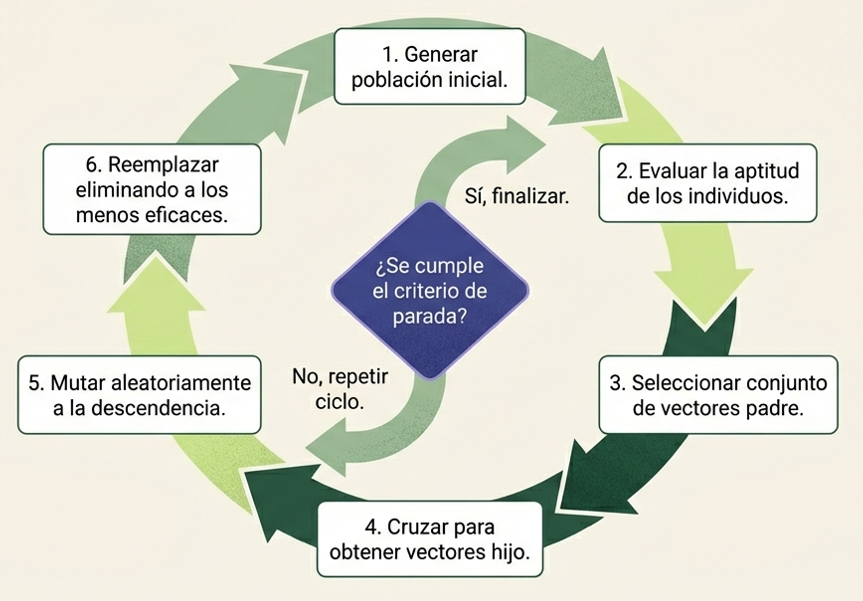

La innovación docente más potente consiste en utilizar la IA con un «sesgo deliberado hacia el error». En lugar de aceptar la respuesta de la IA como una verdad absoluta, el flujo de trabajo propuesto obliga al alumnado a realizar un «contraste crítico»: primero, deben resolver el problema manualmente y, después, interpelar a la IA para buscar activamente la «alucinación» o el fallo técnico.

Este enfoque es crucial desde el punto de vista estadístico. El ítem 4 (comparación entre la resolución manual y la IA) se identificó, mediante modelos de regresión múltiple, como uno de los tres predictores clave del éxito. Al buscar el fallo, el estudiante activa una reflexión metacognitiva, aprende a pensar sobre cómo piensa y fortalece su criterio técnico al corregir el algoritmo.

De las aulas al mercado laboral: la transferibilidad de la autorregulación.

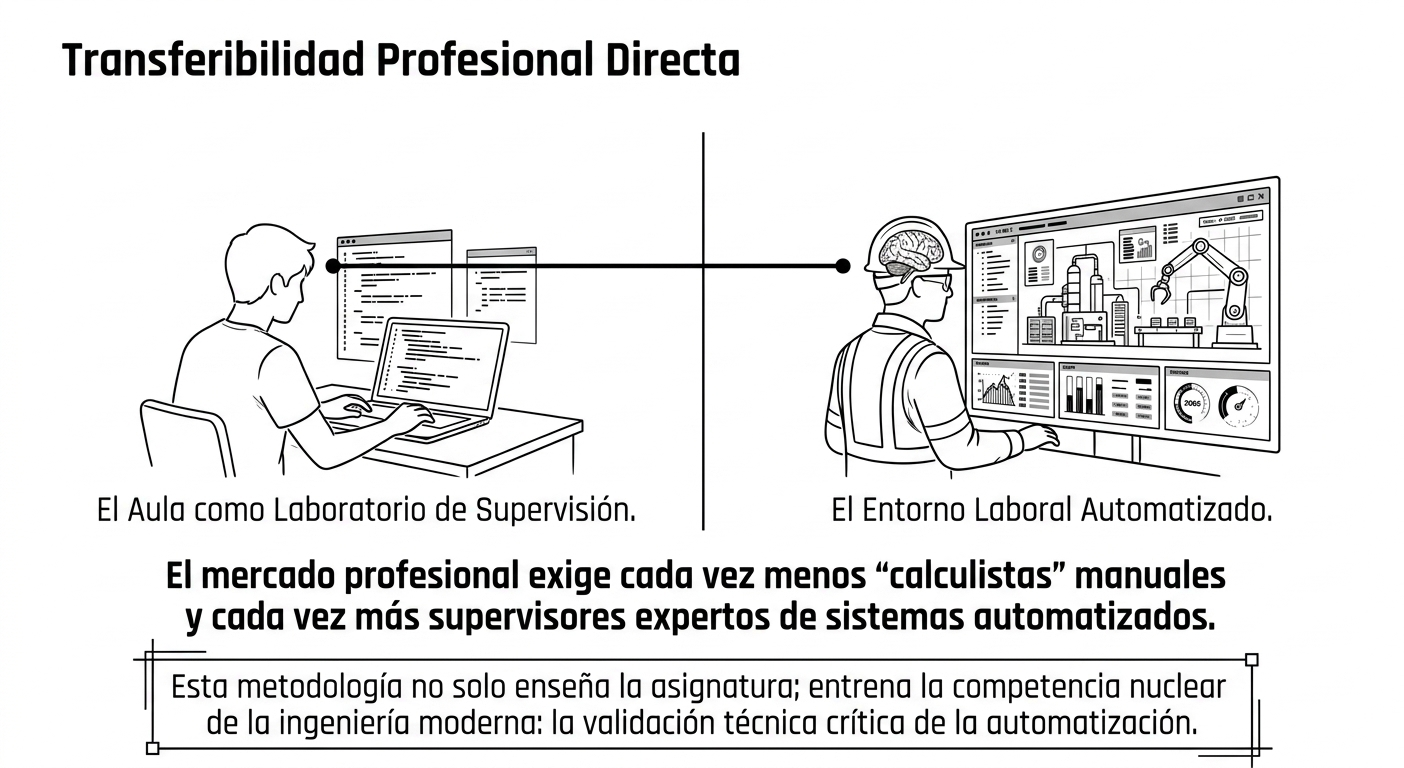

La relevancia de esta formación trasciende las calificaciones. Los datos son contundentes: la pregunta 9 («Las habilidades se pueden aplicar en contextos profesionales») obtuvo la puntuación más alta del cuestionario, 4,24. Los futuros ingenieros son conscientes de que la supervisión experta de sistemas automatizados ya es una competencia esencial en la industria moderna.

La solidez de este modelo se demuestra por su capacidad explicativa, ya que la valoración global de la IA (punto 10) se explica en un 37,7 % (R² corregida) por la combinación de tres factores: la capacidad de reformular el problema (punto 1), la detección de errores por contraste (punto 4) y la percepción de la transferibilidad profesional (punto 9).

«Esta metodología favorece la adquisición de competencias esenciales en entornos profesionales donde se requiere la supervisión experta de sistemas automatizados, y prepara al ingeniero para entornos de alta complejidad».

Conclusión: ingenieros de decisiones, no usuarios de software.

La inteligencia artificial, lejos de mermar el rigor científico, puede ser el mayor catalizador del aprendizaje profundo si se gestiona desde la «autorregulación crítica» (componente 1 del análisis factorial). El futuro de la ingeniería no pertenece a quienes saben usar herramientas, sino a quienes son capaces de enseñar, corregir y auditar a la máquina según criterios científicos y normativos.

En última instancia, nos enfrentamos a una pregunta que definirá la resiliencia de la profesión ante la obsolescencia tecnológica: en un contexto de automatización creciente, ¿estamos formando usuarios de software o educando a los ingenieros de las decisiones del mañana? La responsabilidad ética del ingeniero sigue siendo la última instancia de decisión, y esa carga no puede ni debe asumirla ningún algoritmo.

En esta conversación puedes escuchar las ideas más interesantes sobre el tema.

En este vídeo se resumen bien los conceptos vistos.

Referencia:

YEPES-BELLVER, L.; MARTÍNEZ-PAGÁN, P.; YEPES, V. (2026). Impacto de la inteligencia artificial en la formación técnica: aprendizaje profundo, metacognición y transferibilidad profesional. En libro de actas: XII Congreso de Innovación Educativa y Docencia en Red. Valencia, 9-10 de julio de 2026.

Esta obra está bajo una licencia de Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0 Internacional.