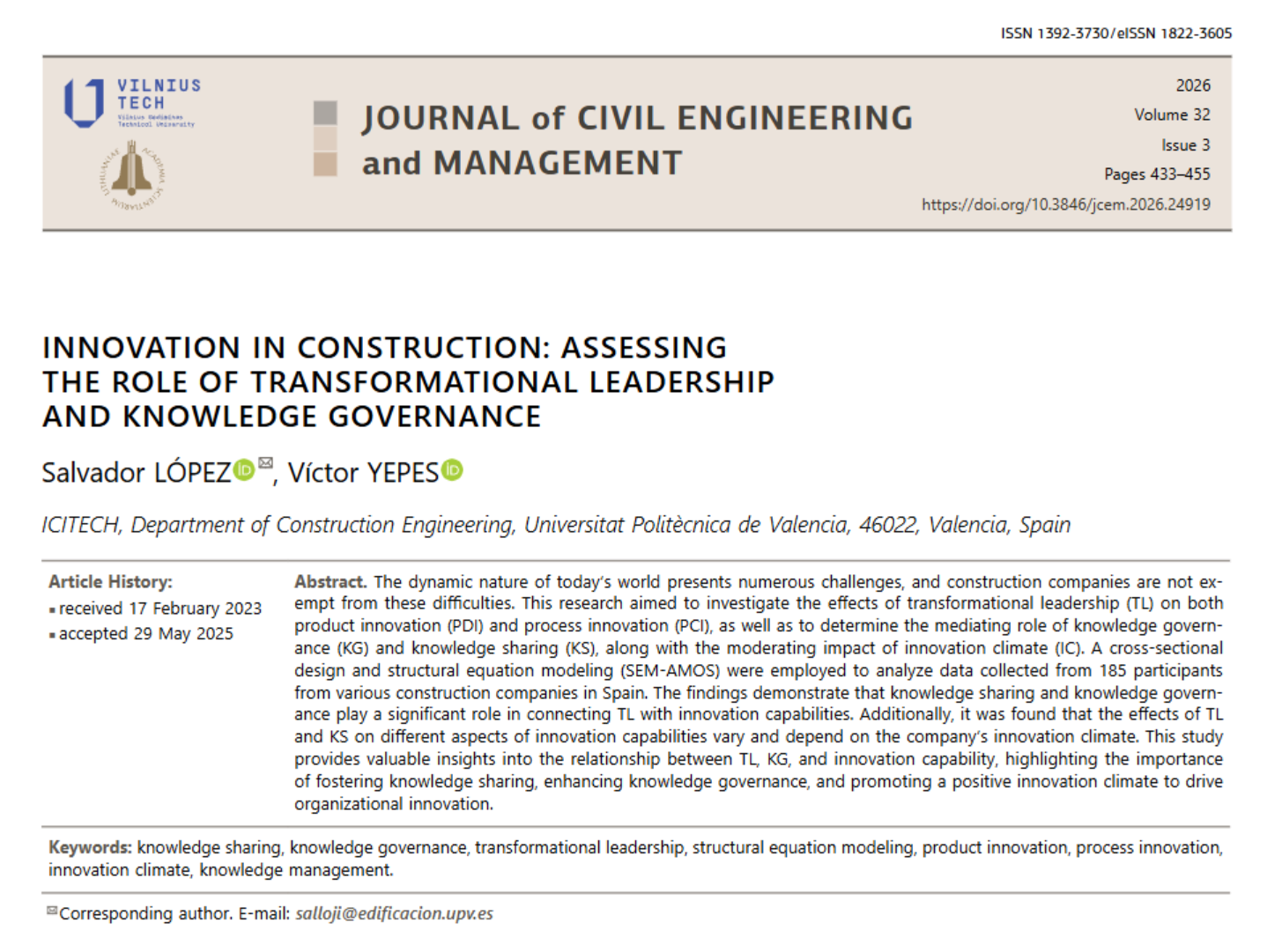

Acaban de publicar un artículo en el Journal of Civil Engineering & Management, una de las revistas ubicadas en el primer decil del JCR. Este documento técnico sintetiza los resultados de una investigación exhaustiva sobre los factores que impulsan la innovación en los sectores de la construcción y la consultoría en España.

Acaban de publicar un artículo en el Journal of Civil Engineering & Management, una de las revistas ubicadas en el primer decil del JCR. Este documento técnico sintetiza los resultados de una investigación exhaustiva sobre los factores que impulsan la innovación en los sectores de la construcción y la consultoría en España.

El estudio analiza la influencia del liderazgo transformacional (TL) en la innovación de producto (PDI) y la innovación de procesos (PCI), y evalúa el papel mediador de la gestión del conocimiento (KG) y el intercambio de conocimiento (KS), bajo el efecto moderador del clima de innovación (IC).

Los resultados, obtenidos mediante un análisis de ecuaciones estructurales (SEM-AMOS) con una muestra de 185 profesionales, revelan que:

- El liderazgo transformacional impacta directamente en la innovación de productos, pero su efecto en la innovación de procesos es indirecto y depende de las estructuras de gobernanza formal.

- La gestión del conocimiento es un factor crítico para la innovación de procesos en entornos jerárquicos.

- El clima de innovación actúa como un catalizador que potencia la capacidad del líder para fomentar el intercambio de conocimientos.

- En sectores conservadores como la construcción, la estructura organizativa y los sistemas de incentivos son tan importantes como el estilo de liderazgo para desbloquear el potencial innovador.

1. Contexto y desafíos del sector.

El sector de la construcción se caracteriza por ser tradicionalmente conservador, reactivo y resistente al cambio. Las empresas de este ámbito se enfrentan a desafíos multifacéticos derivados de:

- Volatilidad global: cambios acelerados y necesidades de los clientes en constante evolución.

- Disrupción tecnológica: necesidad estratégica de adoptar innovaciones para asegurar el éxito a largo plazo.

- Estructuras jerárquicas: la naturaleza de los proyectos y las culturas organizativas rígidas obstaculizan la proactividad en la innovación.

2. Marco teórico y variables del estudio.

La investigación se basa en la interconexión de cinco constructos principales, que se definen a continuación:

| Constructo | Descripción |

| Liderazgo transformacional | Estilo de gestión que motiva a los equipos hacia el cambio mediante la influencia idealizada, la motivación inspiracional, la estimulación intelectual y la consideración individualizada. |

| Gestión del conocimiento | Conjunto de mecanismos formales (estructuras, recompensas) e informales (redes, cultura) para optimizar el intercambio y uso del conocimiento. |

| Intercambio de conocimiento | Proceso mediante el cual individuos y equipos intercambian información, habilidades y experiencia. |

| Innovación de producto | Introducción de productos o servicios nuevos o mejorados para satisfacer las necesidades del mercado. |

| Innovación de procesos | Mejora de los procedimientos operativos internos y de la eficiencia organizativa. |

| Clima de innovación | Entorno percibido que apoya y fomenta la generación y la aplicación de ideas creativas. |

3. Análisis de resultados e impactos directos.

El estudio valida la mayoría de las hipótesis propuestas y destaca una divergencia significativa en la manera en que el liderazgo incide en los distintos tipos de innovación.

El impacto diferencial del liderazgo transformacional (TL)

- Sobre la innovación de producto (PDI): el TL muestra un efecto fuerte y significativo (β = 0,548, p < 0,001). Los líderes transformadores fomentan la creatividad individual y la seguridad psicológica, lo que facilita el desarrollo de nuevos materiales o diseños.

- Sobre la innovación de procesos (PCI): el efecto directo no es significativo (β = 0,102). Esto sugiere que, en el sector de la construcción, los cambios en los procesos dependen más de factores estructurales e inversión tecnológica que de la motivación inspiracional.

El papel de la gobernanza y el intercambio de conocimiento

- KG como motor de PCI: la gobernanza del conocimiento influye de manera significativa en la innovación de procesos (β = 0,508, p < 0,001), lo que subraya la importancia de la estandarización y de los sistemas formales de gestión.

- KS como motor de PDI: el intercambio de conocimiento impacta de manera moderada en el producto (β = 0,373, p < 0,001), lo que facilita la integración de conocimientos multidisciplinares.

4. Dinámicas de mediación y moderación.

La investigación profundiza en cómo las variables intermedias inciden en la eficacia del liderazgo.

Mediación de la gestión (KG) y del intercambio (KS).

- Efecto en el PCI: la relación entre el liderazgo transformacional y la innovación de procesos está totalmente mediada por la gobernanza del conocimiento. En contextos estructurados, el líder solo puede innovar en los procesos si primero reforma los sistemas de incentivos y de gobernanza.

- Efecto en PDI: el intercambio de conocimientos (KS) explica aproximadamente el 20 % de la relación entre el liderazgo y la innovación de producto. El 80 % restante se atribuye a mecanismos no medidos, como el empoderamiento o la visión estratégica.

El clima de innovación (IC) como catalizador.

El estudio demuestra que el clima de innovación no garantiza por sí solo el intercambio de conocimientos, sino que actúa como un moderador contingente.

- Interacción TL x IC: existe un efecto positivo moderado (β = 0,141, p < 0,1). En las organizaciones con un alto IC, el impacto del liderazgo transformacional en el intercambio de conocimientos se intensifica.

- Dato clave: un aumento de una desviación estándar en el liderazgo transformacional, en presencia de un clima innovador alto, genera un incremento del 14 % en el intercambio de conocimientos.

5. Metodología y perfil de la muestra

El estudio se basó en una metodología cuantitativa deductiva aplicada al sector de la construcción en España.

Datos de la muestra (N = 185):

- Profesiones principales: ingenieros de caminos, canales y puertos (33,5 %), ingenieros civiles (29,7 %) y arquitectos (21,1 %).

- Género: masculino (69,2 %), femenino (30,8 %).

- Nivel educativo: el 45,4 % posee un máster universitario.

- Antigüedad de las empresas: El 44,9 % de las empresas tiene más de 20 años de existencia.

- Tamaño de las empresas: Distribución equilibrada entre micro (24,3 %), pequeñas (34,6 %), medianas (23,8 %) y grandes (17,3 %).

6. Implicaciones prácticas para la gestión

Para los directivos de los sectores de la construcción y la consultoría, los resultados sugieren una hoja de ruta estratégica:

- Formación en liderazgo: implementar programas de mentoría y entrenamiento en habilidades transformadoras, orientados a desarrollar la capacidad de inspirar una visión compartida.

- Institucionalizar la gestión: para mejorar los procesos (PCI) implica invertir en repositorios de «lecciones aprendidas» y en sistemas de gestión del conocimiento que trasciendan la jerarquía formal.

- Incentivos a la innovación: establecer sistemas de recompensas que reconozcan comportamientos innovadores, como el intercambio de conocimientos técnicos en proyectos con restricciones complejas.

- Uso de tecnologías: adoptar herramientas como el Building Information Modeling (BIM) para facilitar los flujos de conocimiento y la colaboración interdepartamental.

7. Conclusiones y limitaciones

La investigación concluye que la innovación en el sector de la construcción no es un resultado automático del liderazgo, sino un proceso mediado por la estructura de gobernanza y potenciado por el clima organizativo. La integración del liderazgo transformacional con una gobernanza sólida es la forma más eficaz de mantener la ventaja competitiva.

Limitaciones identificadas:

- Datos autoinformados: el uso de escalas de Likert puede introducir sesgos de deseabilidad social.

- Diseño transversal: los datos se recopilaron en un único momento (septiembre-diciembre de 2022), lo que limita las inferencias causales definitivas.

- Contexto geográfico: los resultados están anclados en la realidad regulatoria y cultural de España.

Como el artículo está en acceso abierto, puedes descargarlo gratis pinchando directamente en el enlace de la referencia.

Referencia:

LOPEZ, S.; YEPES, V. (2026). Innovation in construction: Assessing the role of transformational leadership and knowledge governance. Journal of Civil Engineering and Management, 32(3), 433-455. DOI:10.3846/jcem.2026.24919

Esta obra está bajo una licencia de Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0 Internacional.