En este momento, estamos elaborando la justificación técnica y económica del proyecto de investigación RESILIFE. Los investigadores principales son Víctor Yepes y Julián Alcalá. El proyecto comenzó el 1 de septiembre de 2024 y se prevé que finalice a finales de 2027. Hemos hablado mucho de este proyecto en el blog.

En este momento, estamos elaborando la justificación técnica y económica del proyecto de investigación RESILIFE. Los investigadores principales son Víctor Yepes y Julián Alcalá. El proyecto comenzó el 1 de septiembre de 2024 y se prevé que finalice a finales de 2027. Hemos hablado mucho de este proyecto en el blog.

Se trata del proyecto PID2023-150003OB-I00, cuya denominación es: «Optimización resiliente del ciclo de vida de estructuras híbridas y modulares de alta eficiencia social y medioambiental bajo condiciones extremas».

En la fase intermedia del proyecto, se han publicado 25 artículos en revistas indexadas en el JCR, de los cuales 17 están en el primer cuartil y 8 en el segundo. Pero quizás sea importante destacar que de ellos, 13 se han publicado en revistas del primer decil. Entre ellos tenemos un Featured Paper Award de Engineering Structures. En las referencias, al final de esta entrada, tenéis los artículos y sus enlaces para su descarga.

Este esfuerzo ha sido fruto del trabajo de un buen número de investigadores de distintas nacionalidades. Han participado 22 autores: Yepes, Kripka, Sánchez-Garrido, Yepes-Bellver, Navarro, Negrín, Alcalá, Luque Castillo, Guaygua, Tres Junior, De Medeiros, Villalba, Fernández-Mora, Brun-Izquierdo, Martínez-Muñoz, Martí, Ruiz-Vélez, García, Partskhaladze, Vitorio Junior, Onetta y Chagoyén. Hay presencia internacional en países como Brasil, Chile, Ecuador, Perú, Georgia y Cuba.

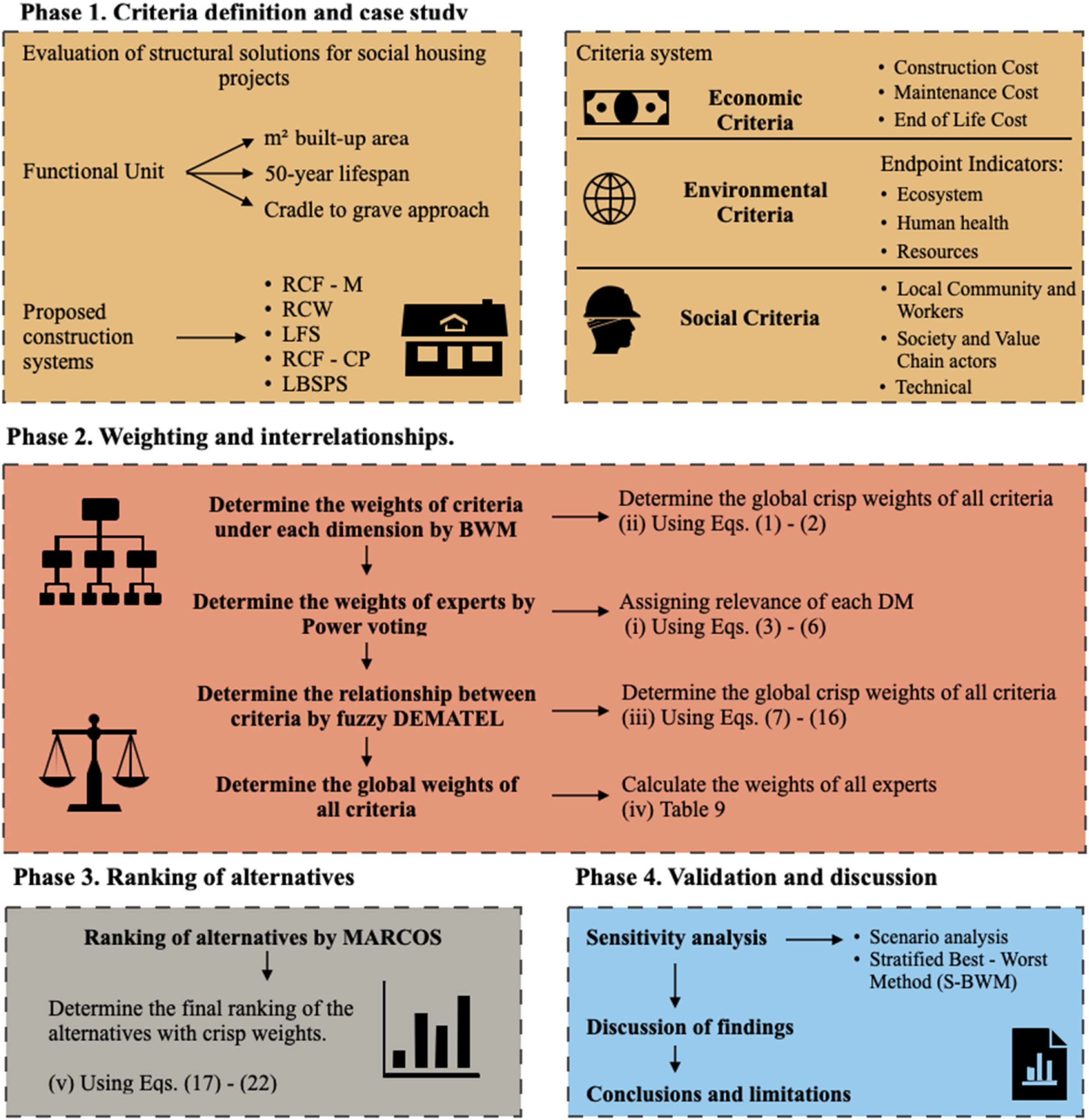

La investigación reciente en ingeniería civil y construcción, sintetizada en el proyecto RESILIFE y en estudios asociados, marca un cambio de paradigma hacia un enfoque de diseño integral. Este enfoque trasciende la mera eficiencia económica para integrar la resiliencia ante eventos extremos (incendios, sismos y colapsos progresivos), la sostenibilidad multidimensional (ambiental, social y económica) y la eficiencia operativa mediante la digitalización.

Avances en optimización multiobjetivo, sostenibilidad y resiliencia en la ingeniería estructural

Los hallazgos clave incluyen:

- Sistemas híbridos y modulares: las tipologías de acero y hormigón, así como los sistemas modulares prefabricados (PVMB), demuestran una superioridad técnica y medioambiental significativa. Por ejemplo, las vigas híbridas de sección transversal variable (THVS) pueden reducir los costes de fabricación hasta en un 70 % y las emisiones en un 32 %.

- Resiliencia integrada: la incorporación de la seguridad contra incendios y de un diseño robusto frente al colapso progresivo en las fases conceptuales no solo mejora la seguridad, sino que también puede optimizar costes (reducción de hasta el 21 % en pasarelas con requisitos de confort dinámico).

- Sostenibilidad social: el análisis del ciclo de vida social (S-LCA) emerge como un factor crítico, especialmente en viviendas sociales, donde los aspectos sociales representan casi el 40 % del peso en la toma de decisiones.

- Digitalización y modelado: el uso de BIM (herramientas como Endurify 2.0) y modelos subrogados (redes neuronales y Kriging) permite gestionar con precisión la vida útil remanente y optimizar la huella de carbono con errores predictivos mínimos.

1. Optimización multiobjetivo y resiliencia ante eventos extremos

La integración de factores de riesgo extremo como criterio principal de diseño permite desarrollar infraestructuras más seguras sin comprometer la viabilidad económica.

1.1 Resiliencia al fuego en pasarelas híbridas

- Enfoque integrado: se propone el rendimiento ante el fuego como motor de diseño, junto con el coste, el impacto ambiental y la comodidad del peatón.

- Configuraciones óptimas: se recomienda utilizar acero de menor resistencia en el alma y de mayor en las alas (una relación de límite elástico de aproximadamente 1,6).

- Compromisos de diseño: existe una dicotomía geométrica, ya que las vigas más compactas mejoran la seguridad frente a incendios, mientras que las geometrías esbeltas favorecen el rendimiento dinámico. Una inversión adicional del 23 % en el coste puede evitar el colapso durante 10 minutos de exposición al fuego.

1.2 Resistencia al colapso progresivo (PC) y sismos

- Marco OBDRPC: este marco integra principios de diseño resistente al colapso progresivo y de optimización basada en simulaciones, en los que se considera la interacción suelo-estructura (SSI).

- El impacto de la interacción suelo-estructura puede generar diferencias de hasta el 24,29 % en el uso de materiales de la superestructura si no se tiene en cuenta dicha interacción.

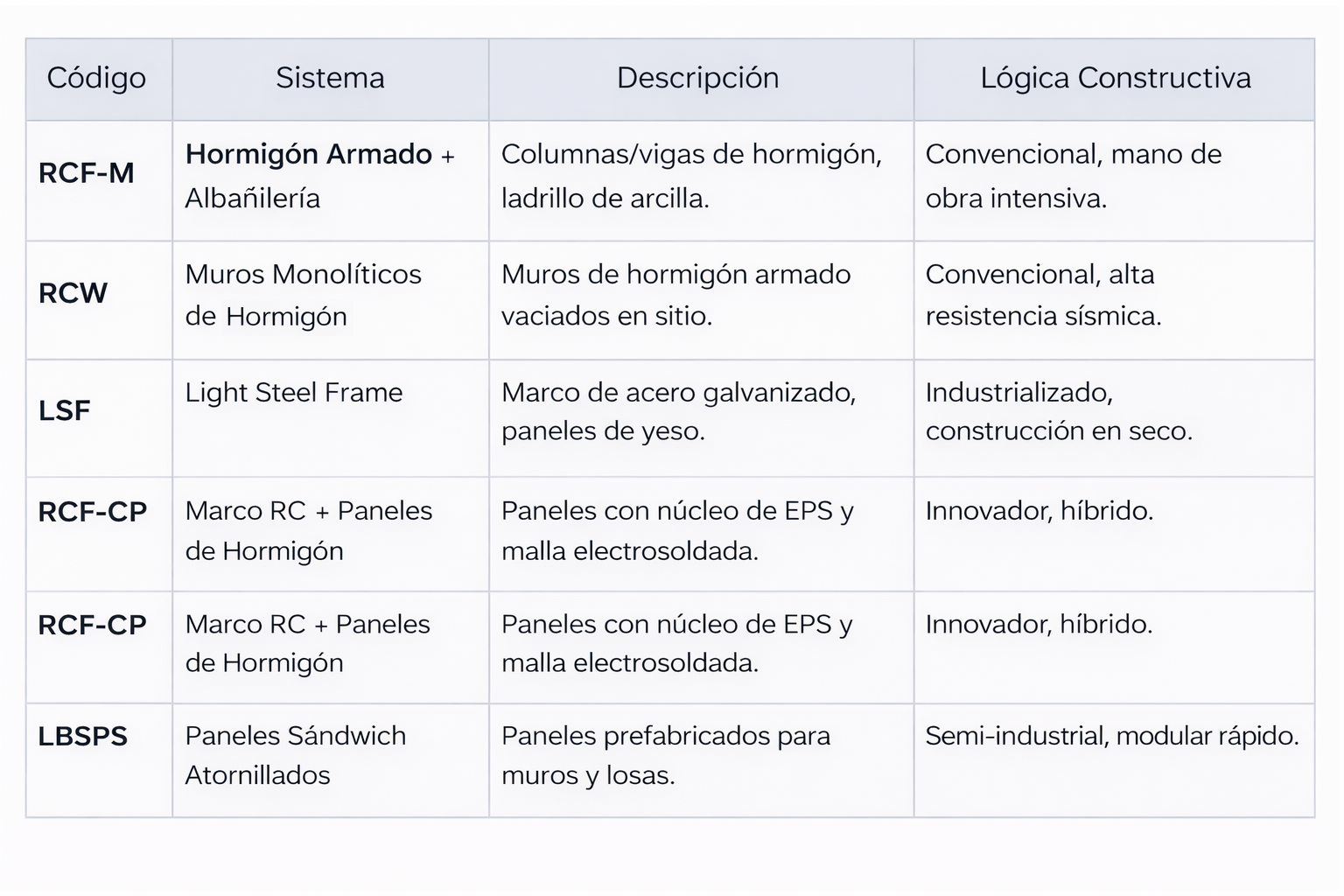

- Sistemas modulares en zonas sísmicas: en regiones como Quito, los sistemas modulares de acero laminado en caliente ofrecen el mejor rendimiento global, ya que reducen los tiempos de construcción y el impacto social, aunque los costes iniciales son más altos.

- Refuerzo sísmico: el uso de polímeros reforzados con fibra de carbono (CFRP) se identifica como la mejor alternativa para el refuerzo de las vigas de hormigón deficientes, debido a su menor impacto ambiental y social en comparación con el encamisado de acero o de hormigón.

2. Sostenibilidad y análisis del ciclo de vida (ACV)

La sostenibilidad se evalúa mediante un enfoque de «triple balance» que abarca las dimensiones económicas (LCC), ambientales (LCA) y sociales (S-LCA).

2.1. Descarbonización y eficiencia de materiales

- Puentes y pasarelas: la optimización de los pasos superiores de las carreteras puede reducir la huella de carbono en un 12 %. En los puentes de losa pretensados, se recomienda una relación de esbeltez de 1/28 y hormigón C-40 para maximizar la eficiencia energética.

- Economía circular: el uso de losas aligeradas con plástico reciclado reduce el consumo de hormigón y acero entre un 23 % y un 33 %, lo que se traduce en una disminución del 24 % del potencial de calentamiento global.

- Relación coste-emisiones: Se ha identificado una relación lineal: cada dólar ahorrado en la optimización de pasarelas reduce las emisiones de CO2 en aproximadamente 0,7727 kg por metro.

2.2 Dimensión social de la construcción

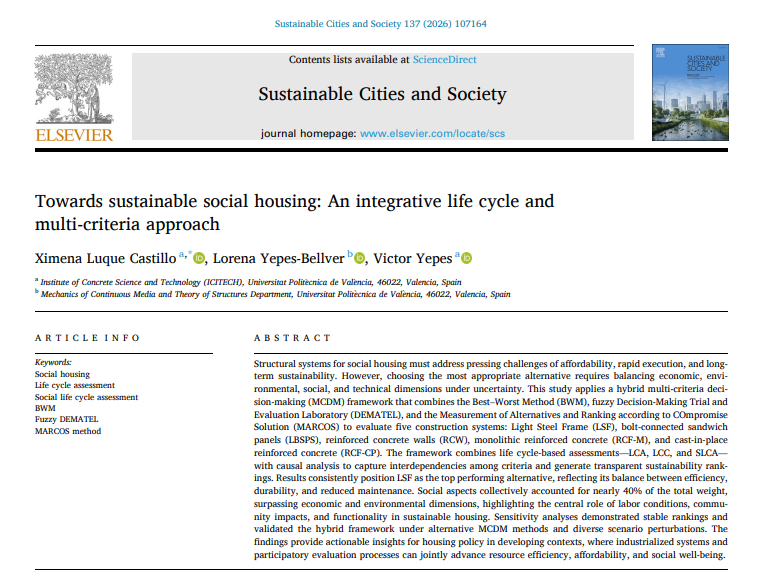

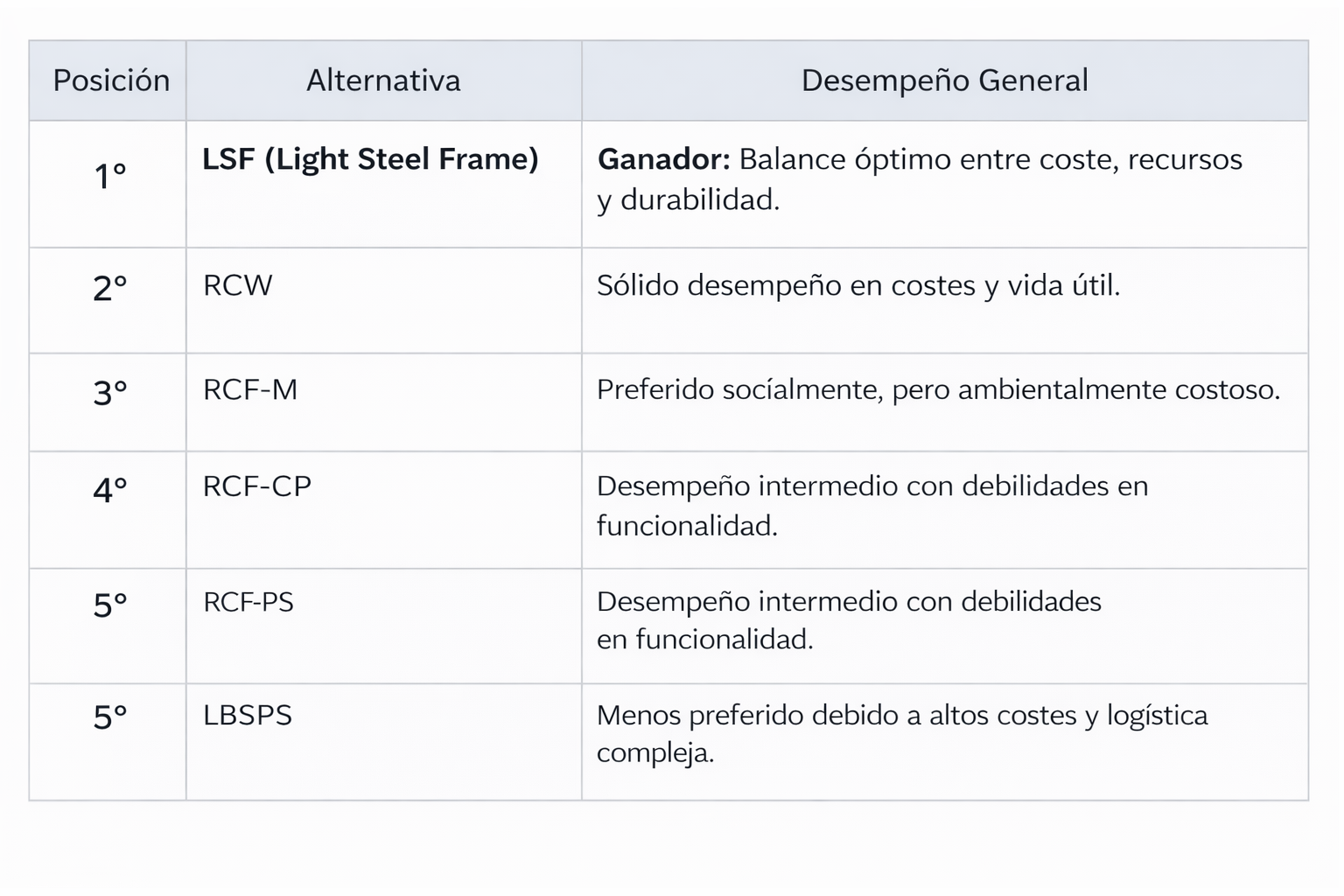

- Vivienda social: el sistema Light Steel Frame (LSF) destaca como la opción más favorable en contextos de desarrollo, ya que ofrece un buen equilibrio entre coste, durabilidad y menor mantenimiento.

- Riesgos sociales: la implementación de sistemas de construcción circular y modelos de optimización reduce los riesgos sociales hasta en un 20 % en las categorías de trabajadores y de la comunidad local.

3. Tipologías estructurales innovadoras.

El desarrollo de nuevas geometrías y combinaciones de materiales es fundamental para la eficiencia industrial.

| Tipología | Beneficios clave identificados |

| Vigas THVS (híbridas transversales de sección variable) | Reducción de costes de fabricación hasta el 70%; reducción de emisiones hasta el 32%; menor carga axial en columnas y cimientos debido a la reducción del peso propio. |

| Sistemas modulares (PVMB) | Despliegue más rápido, mayor resiliencia social y reducción de los impactos ambientales en comparación con los métodos convencionales in situ. |

| Estructuras MMC en costa | El uso de cemento sulforresistente, impregnación hidrofóbica y humo de sílice aumenta la calificación de sostenibilidad en un 86% frente a diseños base en ambientes marinos agresivos. |

| Almacenes de acero con cerramientos de acero | Menor impacto ambiental que el de los cerramientos de ladrillo o de bloques de hormigón, especialmente en escenarios de reciclaje al final de la vida útil. |

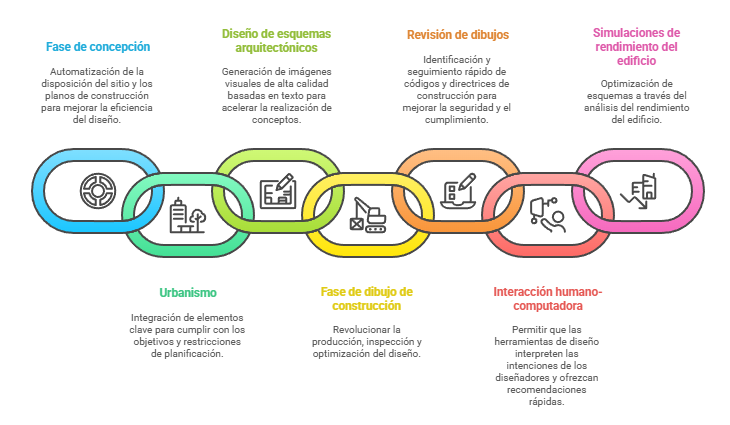

4. Digitalización y herramientas de decisión.

La complejidad de los criterios de competencia exige el uso de herramientas informáticas avanzadas.

4.1 BIM y gestión de la vida útil

- Endurify 2.0: este complemento para entornos BIM automatiza la planificación de la rehabilitación estructural y estima la vida útil remanente (RUL). Su aplicación reduce los costes totales en un 15 % y el impacto por proximidad en un 10 % en comparación con la planificación basada en expertos.

- Indicadores de daño: el sistema analiza cuatro indicadores críticos: carbonatación, fisuración transversal, fluencia y deflexión.

4.2. Modelos subrogados y algoritmos de optimización

- Precisión predictiva: las redes neuronales artificiales (ANN) y el modelo Kriging han demostrado ser muy precisos para optimizar la huella de carbono y la energía embebida, aunque tienden a sobreestimar ligeramente los valores observados.

- Algoritmos metaheurísticos: el uso de algoritmos como NSGA-III, CTAEA y SMS-EMOA permite equilibrar objetivos en conflicto (rendimiento estructural frente a la constructibilidad), siendo NSGA-III el que muestra la mayor convergencia hacia el frente de Pareto.

- Múltiples criterios (MCDM): se emplean métodos híbridos (BWM, TOPSIS, VIKOR y DEMATEL) para reducir la subjetividad del juicio experto y modelar las interdependencias causales entre los criterios de sostenibilidad.

5. Conclusiones y directrices de diseño

La síntesis de las fuentes permite establecer directrices prácticas para la infraestructura moderna:

- Priorizar la hibridación: El uso de secciones híbridas (de acero con distintos límites elásticos) y de sistemas mixtos de acero y hormigón ofrece las mayores ventajas económicas y medioambientales.

- Mantenimiento preventivo: en entornos agresivos (como las costas), la inversión inicial en materiales especiales (como el humo de sílice o las impregnaciones) compensa con creces la reducción de las intervenciones de mantenimiento reactivo.

- Enfoque holístico en la vivienda: la evaluación de los proyectos de vivienda social debe integrar obligatoriamente las dimensiones técnica y social, no solo la económica, para garantizar la resiliencia de la comunidad.

- Optimización desde el proyecto: La resiliencia al fuego y al colapso debe integrarse en la fase de diseño conceptual para evitar sobrecostes innecesarios en etapas avanzadas del proyecto.

Referencias:

- TRES JUNIOR, F.L.; DE MEDEIROS, G.F.; KRIPKA, M.; YEPES, V. (2026). Integrated Optimization Framework for Fire-Resilient and Sustainable Hybrid Steel-Concrete Composite Footbridges. Engineering Structures, 360, 122779. DOI:10.1016/j.engstruct.2026.122779

- GUAYGUA, B.; SÁNCHEZ-GARRIDO, A.; YEPES-BELLVER, L.; YEPES, V. (2026). A multi-criteria life-cycle decision framework for sustainable modular hospitals in seismic regions. Results in Engineering, 30, 110371. DOI:10.1016/j.rineng.2026.110371

- FERNÁNDEZ-MORA, V.; NAVARRO, I.J.; YEPES, V. (2026). Extending Building Lifespan: Integrating BIM and MCDM for Strategic Rehabilitation. Journal of Information Technology in Construction, 31:398-419. DOI:10.36680/j.itcon.2026.018

- LUQUE CASTILLO, X.; YEPES-BELLVER, L.; YEPES, V. (2026). Towards Sustainable Social Housing: An Integrative Life Cycle and Multi-Criteria Approach. Sustainable Cities and Society, 137, 107164. DOI:10.1016/j.scs.2026.107164

- SÁNCHEZ-GARRIDO, A.J.; NAVARRO, I.J.; YEPES, V. (2026). Multivariate Environmental and Social Life Cycle Assessment of Circular Recycled-Plastic Voided Slabs for Data-Driven Sustainable Construction. Environmental Impact Assessment Review, 118, 108297. DOI:10.1016/j.eiar.2025.108297

- SÁNCHEZ-GARRIDO, A.J.; NAVARRO, I.J.; YEPES, V. (2026). Optimizing reactive maintenance intervals for the sustainable rehabilitation of chloride-exposed coastal buildings with MMC-based concrete structure. Environmental Impact Assessment Review, 116, 108110. DOI:10.1016/j.eiar.2025.108110

- TRES JUNIOR, F.L.; DE MEDEIROS, G.F.; KRIPKA, M.; YEPES, V. (2025). Designing for Safety and Sustainability: Optimization of Fire-Exposed Steel-Concrete Composite Footbridges. Structural Engineering and Mechanics, 96 (4):337-350. DOI:10.12989/sem.2025.96.4.337

- NEGRÍN, I.; KRIPKA, M.; YEPES, V. (2025). Life-cycle environmental impact optimization of an RC-THVS composite frame for sustainable construction. Engineering Structures, 345, 121461. DOI:10.1016/j.engstruct.2025.121461 Featured Paper Award

- NEGRÍN, I.; KRIPKA, M.; YEPES, V. (2025). Manufacturing cost optimization of welded steel plate I-girders integrating hybrid construction and tapered geometry. International Journal of Advanced Manufacturing Technology, 140, 1601-1624. DOI:10.1007/s00170-025-16365-2

- NEGRÍN, I.; CHAGOYÉN, E.; KRIPKA, M.; YEPES, V. (2025). An integrated framework for Optimization-based Robust Design to Progressive Collapse of RC skeleton buildings incorporating Soil-Structure Interaction effects. Innovative Infrastructure Solutions, 10:446. DOI:10.1007/s41062-025-02243-z

- YEPES-BELLVER, L.; ALCALÁ, J.; YEPES, V. (2025). Predictive modeling for carbon footprint optimization of prestressed road flyovers. Applied Sciences, 15(17), 9591. DOI:10.3390/app15179591

- VILLALBA, P.; SÁNCHEZ-GARRIDO, A.; YEPES-BELLVER, L.; YEPES, V. (2025). A Hybrid Fuzzy DEMATEL–DANP–TOPSIS Framework for Life Cycle-Based Sustainable Retrofit Decision-Making in Seismic RC Structures. Mathematics, 13(16), 2649. DOI:10.3390/math13162649

- LUQUE CASTILLO, X.; YEPES, V. (2025). Multi-criteria decision methods in the evaluation of social housing projects. Journal of Civil Engineering and Management, 31(6), 608–630. DOI:10.3846/jcem.2025.24425

- LUQUE CASTILLO, X.; YEPES, V. (2025). Life Cycle Assessment of Social Housing Construction: A Multicriteria Approach. Building and Environment, 282:113294. DOI:10.1016/j.buildenv.2025.113294

- VITORIO JUNIOR, P.C.; YEPES, V.; ONETTA, F.; KRIPKA, M. (2025). Comparative Life Cycle Assessment of Warehouse Construction Systems under Distinct End-of-Life Scenarios. Buildings, 15(9), 1445. DOI:10.3390/buildings15091445

- NEGRÍN, I.; KRIPKA, M.; YEPES, V. (2025). Design optimization of a composite typology based on RC columns and THVS girders to reduce economic cost, emissions, and embodied energy of frame building construction. Energy and Buildings, 336:115607. DOI:10.1016/j.enbuild.2025.115607

- FERNÁNDEZ-MORA, V.; NAVARRO, I.J.; YEPES, V. (2025). Structural damage index evaluation in BIM environments. Structures, 74:108544. DOI:10.1016/j.istruc.2025.108544

- VILLALBA, P.; GUAYGUA, B.; YEPES, V. (2025). Optimal seismic retrofit alternative for shear deficient RC beams: a multiple criteria decision-making approach. Applied Sciences, 15(5):2424. DOI:10.3390/app15052424

- YEPES-BELLVER, L.; BRUN-IZQUIERDO, A.; ALCALÁ, J.; YEPES, V. (2025). Surrogate-assisted cost optimization for post-tensioned concrete slab bridges. Infrastructures, 10(2): 43. DOI:10.3390/infrastructures10020043.

- MARTÍNEZ-MUÑOZ, D.; MARTÍ, J.V.; YEPES, V. (2025). Game Theory-Based Multi-Objective Optimization for Enhancing Environmental and Social Life Cycle Assessment in Steel-Concrete Composite Bridges. Mathematics, 13(2):273. DOI:10.3390/math13020273

- NEGRÍN, I.; KRIPKA, M.; YEPES, V. (2025). Metamodel-assisted design optimization of robust-to-progressive-collapse RC frame buildings considering the impact of floor slabs, infill walls, and SSI implementation. Engineering Structures, 325:119487. DOI:10.1016/j.engstruct.2024.119487

- GUAYGUA, B.; SÁNCHEZ-GARRIDO, A.; YEPES, V. (2024). Life cycle assessment of seismic resistant prefabricated modular buildings. Heliyon, 10(20), e39458. DOI:10.1016/j.heliyon.2024.e39458

- YEPES-BELLVER, L.; BRUN-IZQUIERDO, A.; ALCALÁ, J.; YEPES, V. (2024). Artificial neural network and Kriging surrogate model for embodied energy optimization of prestressed slab bridges. Sustainability, 16(19), 8450. DOI:10.3390/su16198450

- RUIZ-VÉLEZ, A.; GARCÍA, J.; PARTSKHALADZE, G.; ALCALÁ, J.; YEPES, V. (2024). Enhanced Structural Design of Prestressed Arched Trusses through Multi-Objective Optimization and MCDM. Mathematics, 12(16), 2567. DOI:10.3390/math12162567

- SÁNCHEZ-GARRIDO, A.J.; NAVARRO, I.J.; YEPES, V. (2024). Sustainable preventive maintenance of MMC-based concrete building structures in a harsh environment. Journal of Building Engineering, 95:110155. DOI:10.1016/j.jobe.2024.110155

Esta obra está bajo una licencia de Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0 Internacional.