Para que una organización alcance los niveles de calidad esperados en sus productos o servicios, es imprescindible establecer formalmente los objetivos y las políticas de calidad. Los objetivos representan las metas tangibles y los resultados concretos que se deben alcanzar en plazos determinados, mientras que las políticas actúan como estrategias o líneas de acción para lograrlos.

Para que una organización alcance los niveles de calidad esperados en sus productos o servicios, es imprescindible establecer formalmente los objetivos y las políticas de calidad. Los objetivos representan las metas tangibles y los resultados concretos que se deben alcanzar en plazos determinados, mientras que las políticas actúan como estrategias o líneas de acción para lograrlos.

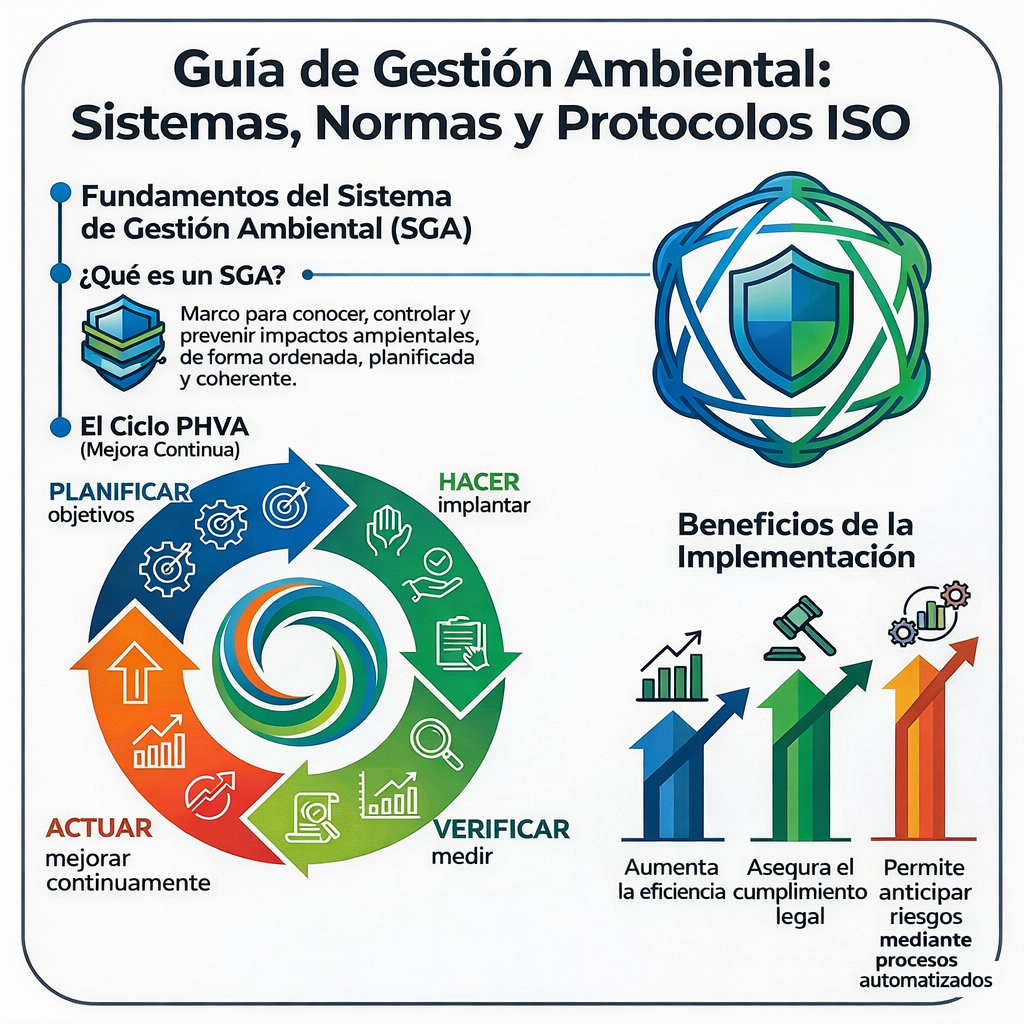

La implementación de estos elementos, debidamente documentados y aprobados por la alta dirección, permite a la empresa pasar de una gestión basada en crisis constantes a una operación planificada. Este documento sintetiza las definiciones, clasificaciones, fuentes de establecimiento y pautas críticas para la gestión efectiva de la calidad según los principios de la gestión por objetivos y las normativas de referencia.

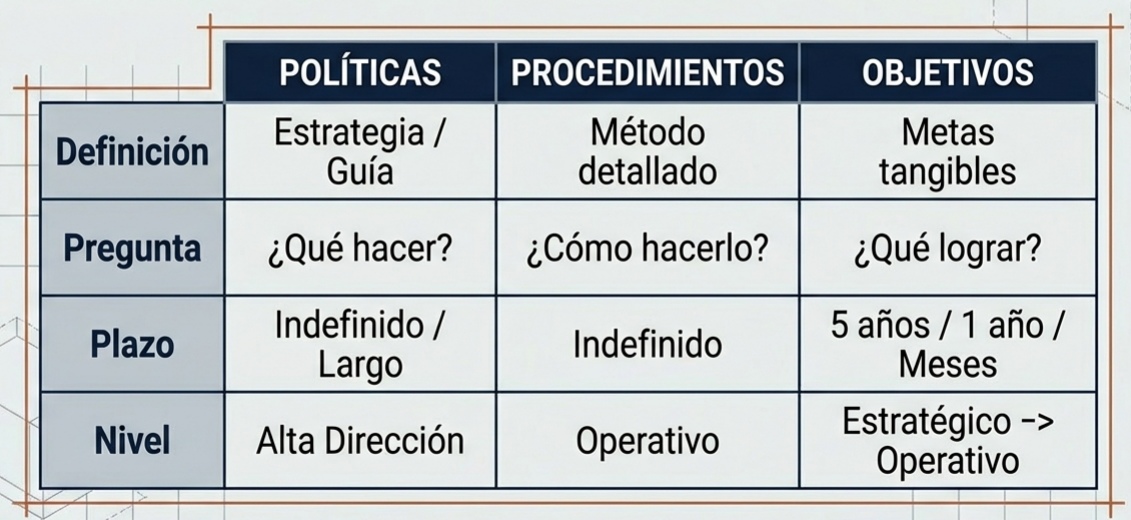

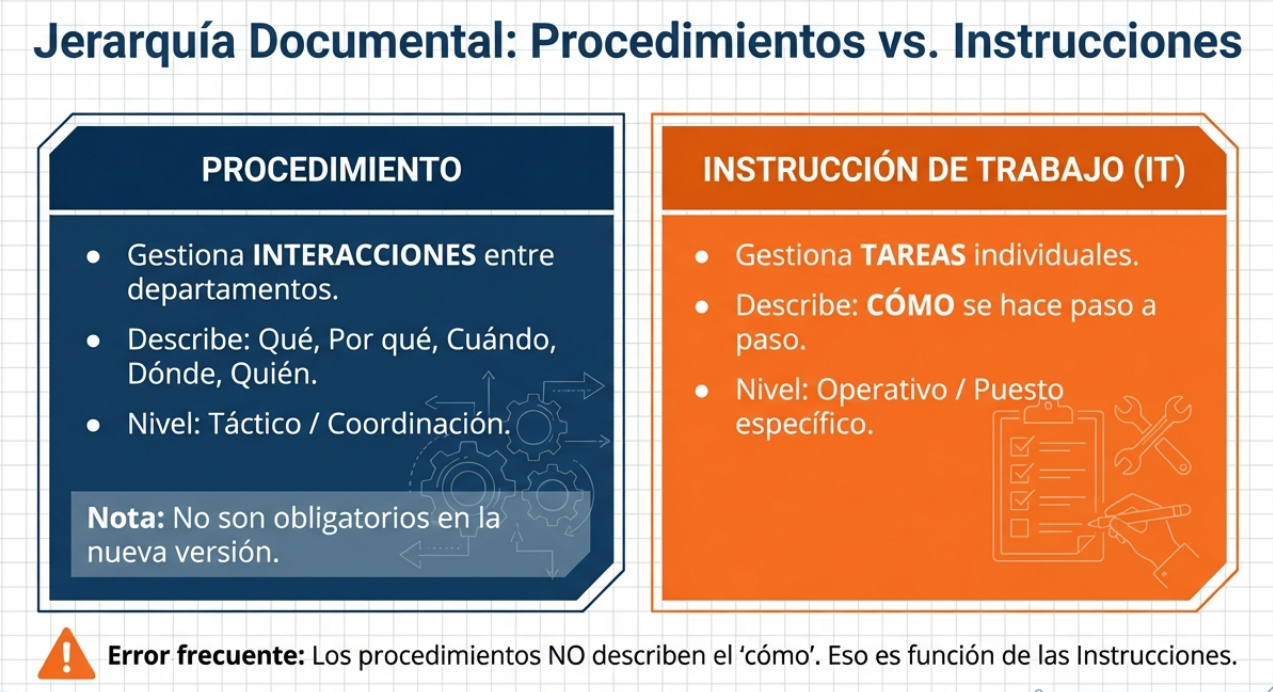

Distinción conceptual: objetivos, políticas y procedimientos.

Es fundamental diferenciar estos tres conceptos, ya que, aunque están relacionados, cumplen funciones distintas dentro del sistema de gestión.

- Objetivos de calidad: son propósitos, metas o resultados específicos que sirven de base para un plan de acción. Deben ser cuantitativos (o tangibles), estar por escrito y contar con un plazo de consecución definido.

- Políticas de calidad: representan el «qué hacer». Son las estrategias o líneas de acción generales. A diferencia de los objetivos (que son el resultado), la política es la guía para la actividad de gestión.

- Procedimientos: representan el «cómo hacerlo». Son las instrucciones detalladas para ejecutar las políticas.

«La política expresa «lo que hay que hacer» y el procedimiento «cómo hay que hacerlo«».

Características esenciales de los objetivos de calidad.

Para que un objetivo sea efectivo, debe cumplir los siguientes atributos:

- Medibilidad: deben ser cuantitativos para permitir la comparación posterior entre el resultado real y la meta.

- Viabilidad: deben ser alcanzables, económicos y merecer la pena el esfuerzo.

- Claridad: deben ser comprensibles, legítimos y debidamente redactados.

- Integralidad: deben cubrir todas las actividades y buscar la excelencia en los resultados globales.

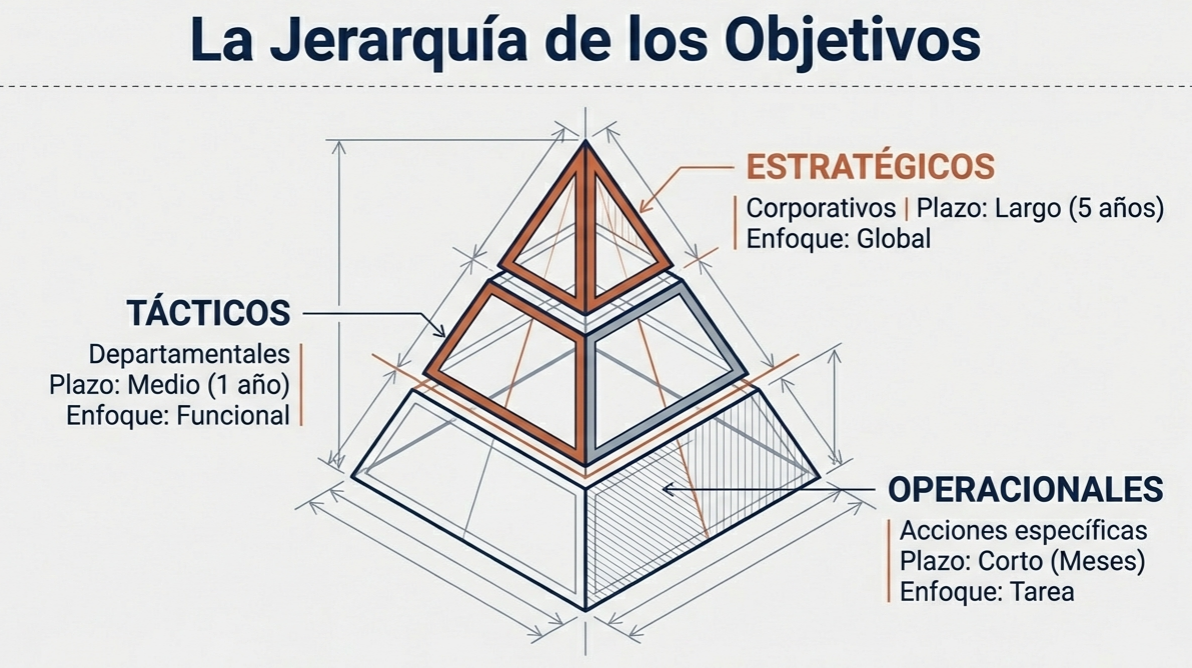

Clasificación de los objetivos.

Según su propósito y su horizonte temporal, los objetivos se dividen en:

| Tipo de objetivo | Horizonte temporal | Función principal |

| Estratégicos | Largo plazo (~5 años) | Metas corporativas globales de la organización. |

| Tácticos | Corto plazo (~1 año) | Definidos para áreas, departamentos o funciones concretas. |

| Operacionales | Meses | Metas inmediatas de ejecución. |

Además, se distinguen por su impacto en el estado actual.

- Objetivos de innovación: buscan cambiar el statu quo para mejorar los niveles actuales de actuación.

- Objetivos de control: buscan mantener el statu quo para impedir cambios no deseados en los niveles de actuación.

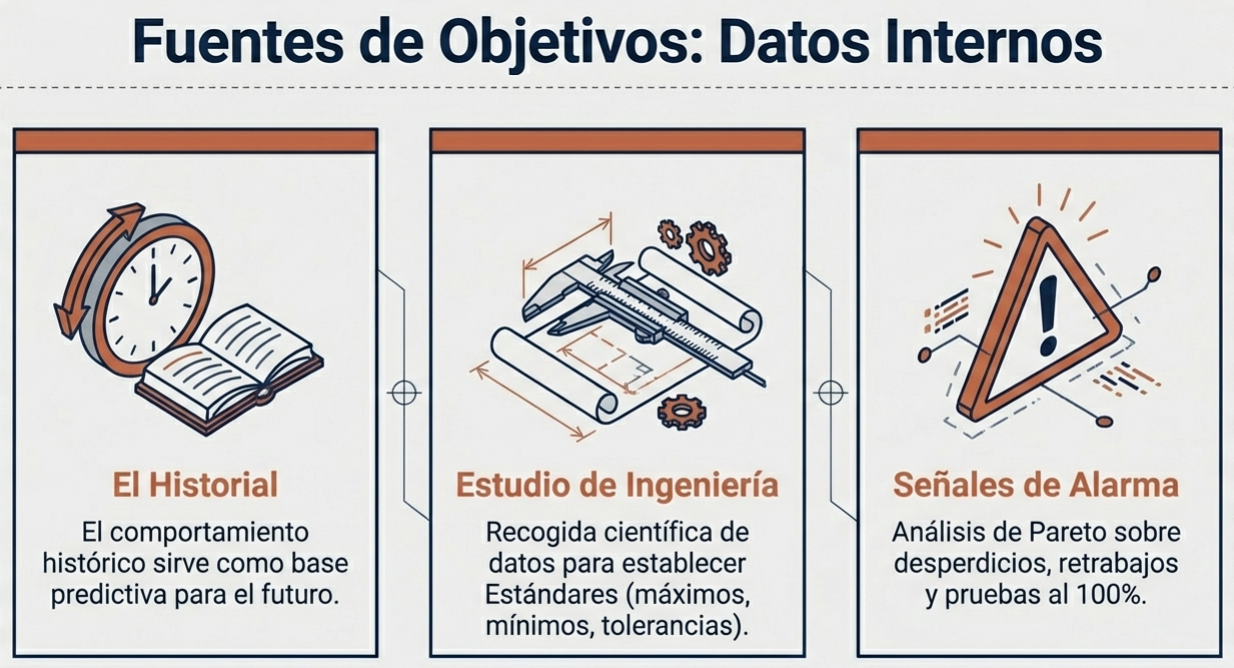

Establecimiento de objetivos: fuentes de información.

La definición de metas no debe ser arbitraria, sino basarse en datos científicos y de mercado.

- Historial y análisis técnico: utilizar el comportamiento histórico de la empresa y estudios de ingeniería (recolección y análisis científico de datos) para establecer estándares técnicos y tolerancias.

- Análisis de Pareto: identificación de señales de alarma repetitivas, tanto externas (reclamaciones, devoluciones) como internas (desperdicio, retrabajo).

- Referenciación externa: comportamiento del mercado competitivo, rendimiento de los productos de la competencia y opiniones de clientes, proveedores, prensa y laboratorios independientes.

- Aportaciones internas: propuestas del personal clave (gerentes, supervisores) y sugerencias de los trabajadores.

- Estándares decretados: requisitos impuestos por monopolios internos o por normativas gubernamentales, fuera del control de la empresa.

Políticas de calidad

Tipología de políticas:

- Corporativas: líneas de acción generales de la compañía (por ejemplo, no lanzar productos si su calidad no supera la de la competencia).

- Departamentales: directrices específicas para la calidad en un área determinada (por ejemplo, criterios de inspección de materiales recibidos).

Ventajas de la formalización por escrito:

- Legitimidad y claridad: minimiza las malas interpretaciones y comunica las intenciones de forma consistente.

- Toma de decisiones: obliga a los interesados a decidir sobre el rumbo estratégico y proporciona una base para dirigir según los objetivos convenidos.

- Prevención: facilita que las actividades se enfoquen en prevenir problemas en lugar de limitarse a detectarlos y corregirlos.

- Control: permite comparar objetivamente lo realizado con la política establecida.

Directrices para el establecimiento y la gestión.

Para establecer políticas de calidad sólidas, la organización debe tener en cuenta su posición en el mercado, la ética en sus relaciones con los clientes (veracidad en las garantías) y su capacidad para adaptarse a las necesidades de los usuarios.

- El papel de la alta dirección: La aprobación final de los objetivos y las políticas corresponde exclusivamente a ella. Su impulso legitima estas directrices para que se apliquen de manera efectiva en toda la organización.

- Documentación y accesibilidad: Tanto las políticas como los objetivos deben estar documentados y ser accesibles para todo el personal pertinente. El instrumento estándar para esta comunicación es el Manual de Calidad.

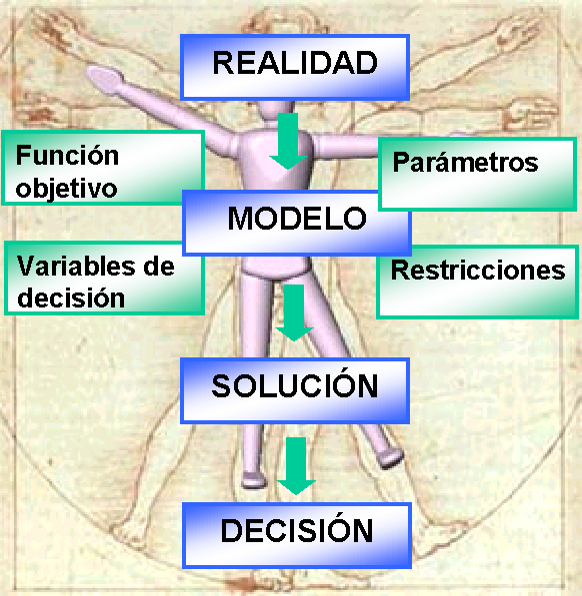

- Proceso de elaboración de políticas:

- Identificar los objetivos y las decisiones estratégicas (de productos y procesos).

- Analizar los problemas actuales o potenciales relacionados con el uso o la fabricación de productos.

- Redactar el documento incluyendo: título, justificación de la necesidad, declaración de la política, medidas de acción, responsabilidades y definiciones.

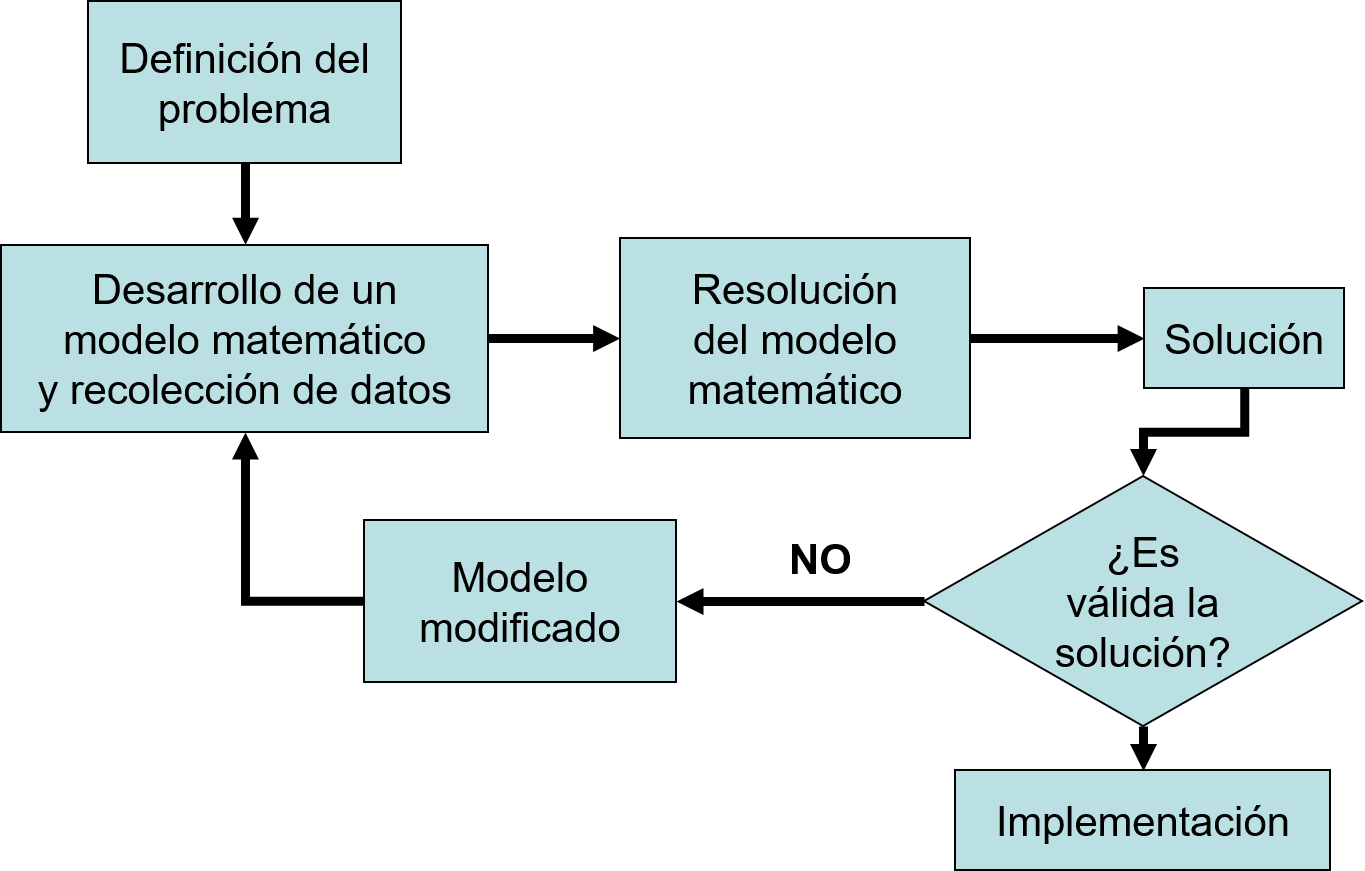

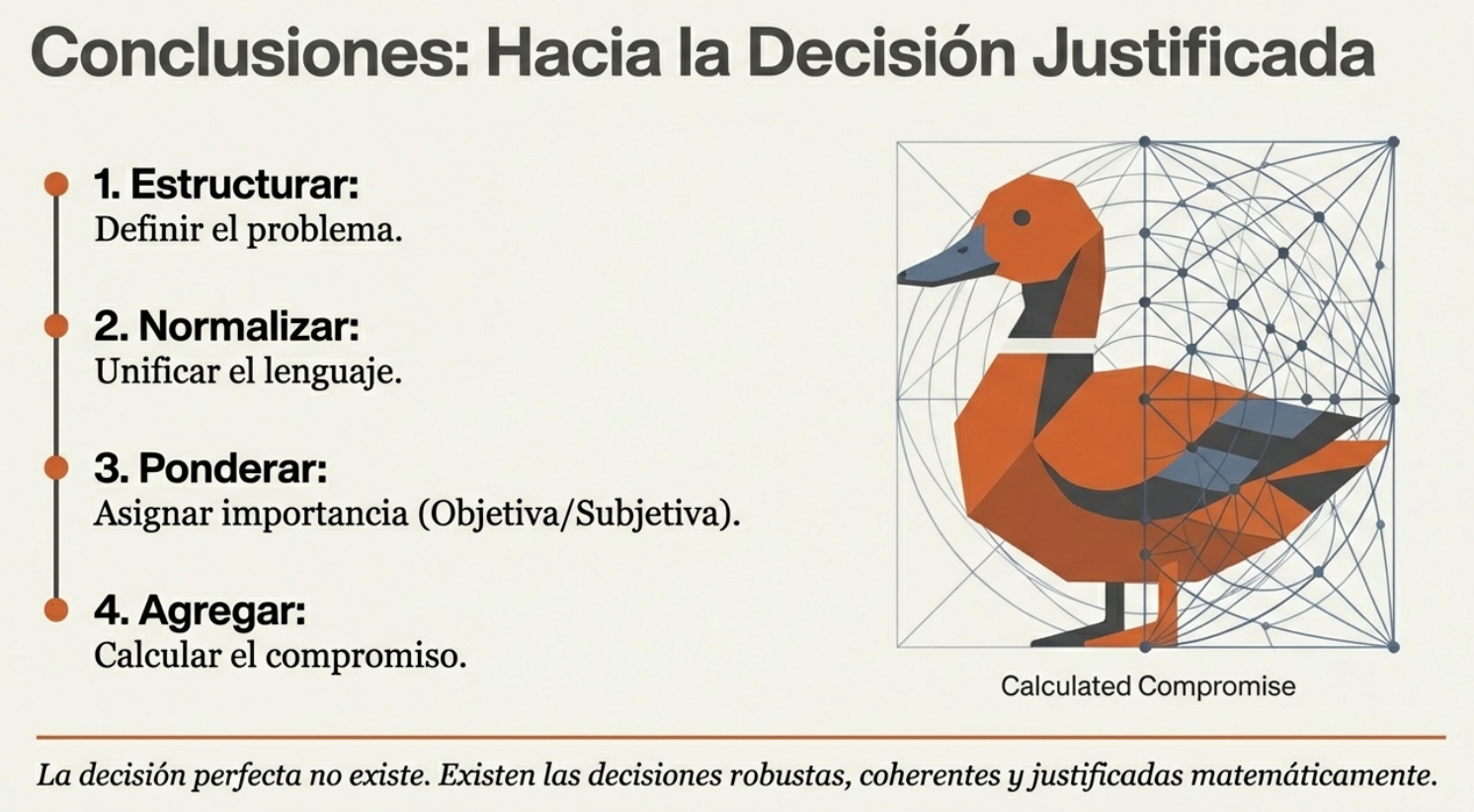

Conclusión: hacia una gestión planificada

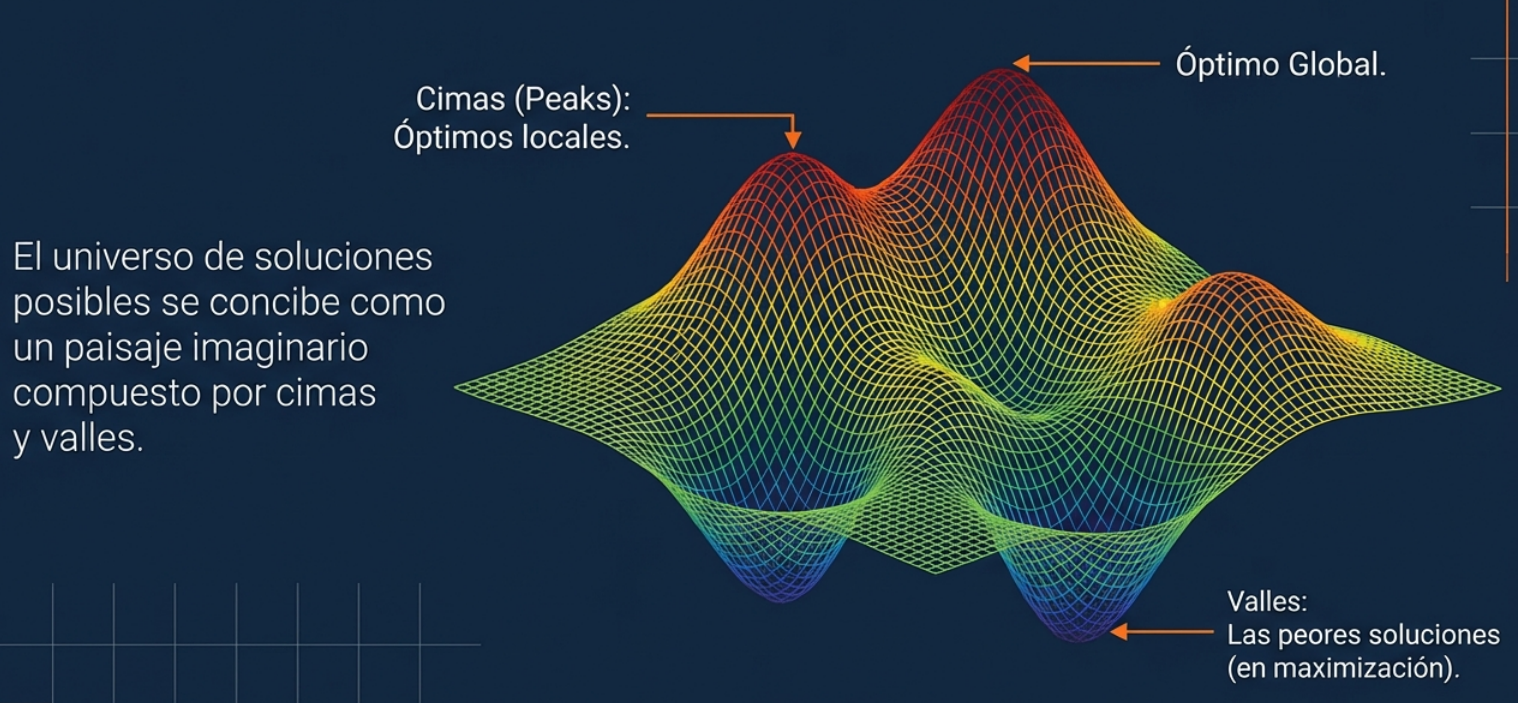

La transición de una gestión reactiva a otra basada en políticas y objetivos por escrito es el paso definitivo hacia la madurez empresarial. Al definir nuestros objetivos y las reglas bajo las cuales operaremos, convertimos la incertidumbre en un plan de acción ejecutable.

Le planteo un reto: revise sus metas actuales. ¿Son objetivos tangibles, con el desglose de cinco años, un año y meses, que su empresa necesita, o son simples aspiraciones que no resistirían un análisis de Pareto? Si no es capaz de documentar sus errores como señales de alarma, difícilmente podrá convertirlos en victorias de calidad. La excelencia comienza en el papel, pero se consolida con el rigor de la dirección.

En esta conversación puedes escuchar algunas de las ideas más importantes del tema.

El vídeo resume bien los conceptos más interesantes.

Strategic_Quality_Architecture

Esta obra está bajo una licencia de Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0 Internacional.