En las últimas décadas del siglo XIX, el desarrollo de los puentes ferroviarios de acero se convirtió en uno de los pilares fundamentales de la ingeniería civil moderna. Esta evolución estuvo estrechamente relacionada con la necesidad de estructuras capaces de soportar trenes más pesados y mayores luces, y a la vez fue catalizadora de avances decisivos en la producción y uso estructural del acero. Desde los primeros arcos hasta las grandes estructuras continuas en voladizo, los puentes de acero no solo respondieron a una necesidad funcional, sino que impulsaron la transformación de la tecnología de construcción a escala global.

El puente Eads: origen del acero en la ingeniería ferroviaria

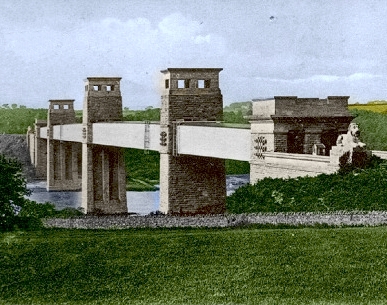

El primer uso del acero en un puente se produjo en 1828, durante la construcción de un puente colgante en Viena (Austria), en el que se incorporaron cadenas de suspensión de acero fabricadas mediante el proceso de horno de solera abierta. El primer empleo del acero en un puente ferroviario se produjo en la construcción del puente de St. Louis, posteriormente conocido como puente Eads, entre 1869 y 1874. Este puente, que cruza el río Misisipi en Misuri, constaba de dos vanos laterales de 152 m y un vano central de 158,5 m, y supuso un hito técnico sin precedentes. Diseñado por James B. Eads, incorporó por primera vez miembros tubulares huecos en los cordones de las armaduras y empleó el método de cajones neumáticos para cimentaciones profundas, algo revolucionario para la época. Este método de construcción de pilas también fue utilizado por Brunel en la construcción del puente Royal Albert en Saltash (Reino Unido) en 1859. Thomas Telford había propuesto este método en 1800 para un puente de hierro fundido que cruzaría el río Támesis en Londres, y Robert Stephenson lo utilizó en 1846 para construir un puente ferroviario de arco de hierro para evitar el uso de cimbra en el concurrido canal del estrecho de Menai. Eads utilizó principios desarrollados por Galileo en el siglo XVII para explicar a los escépticos los fundamentos de la construcción en voladizo de arcos. Eads no tenía una formación académica en ingeniería, pero contó con la ayuda de Charles Pfeiffer para el diseño y de Theodore Cooper para la construcción.

Eads rechazó el uso del puente colgante —considerado demasiado flexible para cargas ferroviarias— y propuso en su lugar un puente de arcos de hierro fundido, sobre los cuales se dispuso una armadura adicional que aumentaba la rigidez del tablero ferroviario. En 1864, John Roebling propuso un puente colgante para este emplazamiento. La estructura generó tanto escepticismo público y mediático que, antes de su apertura, Eads realizó pruebas de carga con catorce de las locomotoras más pesadas disponibles en el país. La magnitud del proyecto fue tan grande que prácticamente agotó los recursos de la incipiente industria siderúrgica estadounidense.

Expansión de la industria del acero y el papel del ferrocarril

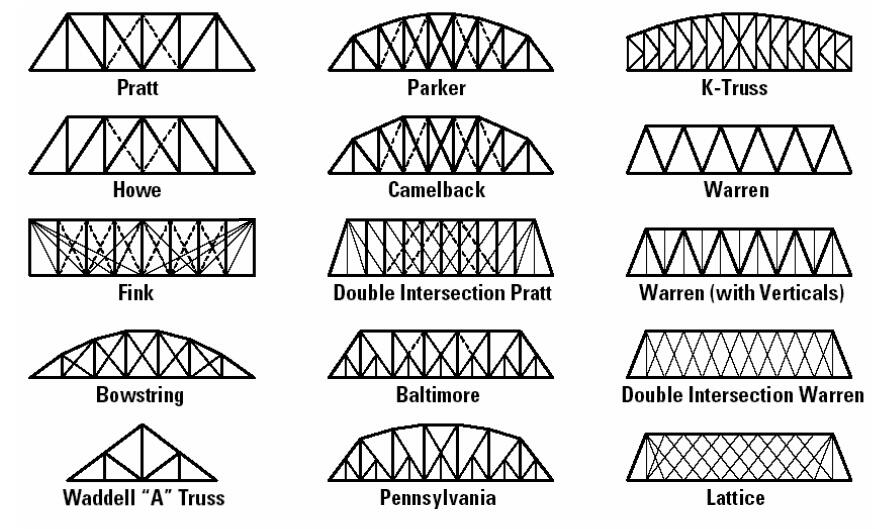

La demanda de puentes con mayores luces por parte de los ferrocarriles norteamericanos, junto con el aumento constante del peso de locomotoras y vagones, impulsó el crecimiento de la industria del acero. Figuras como Andrew Carnegie invirtieron decididamente en mejorar los procesos de producción del acero para conseguir materiales con mayor resistencia y ductilidad. Este impulso dio lugar, en 1879, a la construcción del primer puente ferroviario íntegramente de acero, con celosías tipo Whipple, por parte de la Chicago and Alton Railway en Glasgow, Misuri.

La transición del puente colgante al sistema en voladizos

Aunque algunos ingenieros estadounidenses siguieron diseñando puentes ferroviarios colgantes, la preocupación por su flexibilidad frente a cargas dinámicas y viento persistía. Aun así, el famoso puente de Brooklyn, finalizado en 1883, incluía dos líneas ferroviarias. Sin embargo, el aumento de la masa de las locomotoras y la necesidad de una mayor rigidez estructural provocaron el declive de los puentes colgantes como solución ferroviaria.

La solución técnica más eficaz se encontró en el diseño cantilever, o de avance en voladizo, que permitía construir grandes luces sin cimbra y con suficiente rigidez para cargas dinámicas. El primer puente ferroviario cantilever (también llamado tipo Gerber) construido en Estados Unidos fue el de la Cincinnati Southern Railway sobre el río Kentucky en 1877. En 1883, la Michigan Central and Canada South Railway completó un puente cantiléver de viga de tablero superior sobre el desfiladero del Niágara, paralelo al puente colgante ferroviario de Roebling de 1854. Poco después, en 1884, la Canadian Pacific Railway cruzó el río Fraser, en Columbia Británica, con el primer puente cantilever de acero completamente equilibrado de tablero superior.

Estas estructuras, con brazos en voladizo y tramos suspendidos, se convirtieron en la solución habitual para grandes luces, ya que permitían un diseño estáticamente determinado, rigidez adecuada frente a cargas móviles y la eliminación de la cimbra en el vano principal.

El impulso de Theodore Cooper y la estandarización del acero

En 1880, el ingeniero Theodore Cooper publicó un influyente artículo titulado The Use of Steel for Railway Bridges ante la Sociedad Americana de Ingenieros Civiles (ASCE), en el que promovía el uso exclusivo del acero para puentes ferroviarios. A raíz de ello, casi todos los puentes ferroviarios estadounidenses posteriores se construyeron con acero, y hacia 1895 este material también se utilizaba en otras tipologías de puentes. Para entonces, la producción de perfiles estructurales de acero para puentes ya estaba plenamente desarrollada en el país. Para 1895, las formas estructurales ya no se fabricaban en hierro, sino que se utilizaba acero de manera exclusiva.

El puente de Forth: el cantiléver monumental europeo

En el Reino Unido, el gobierno levantó la prohibición del uso del acero en puentes ferroviarios en 1877. Una década más tarde, el ingeniero Benjamin Baker, tras estudiar numerosos puentes cantiléver estadounidenses —especialmente los de la Canadian Pacific Railway—, propuso un diseño para el puente sobre el estuario del Forth, en Escocia. Antes de esto, Baker quizá no conocía el trabajo de los ingenieros C. Shaler Smith o C. C. Schneider, quienes ya habían diseñado y construido puentes ferroviarios en voladizo en Estados Unidos. El puente de Forth, completado en 1890, se convirtió en un hito de la ingeniería europea: un gigantesco puente cantiléver de acero con brazos de 207 m y un vano suspendido de 107 m.

Pese a las dudas de algunos ingenieros respecto a la fiabilidad del acero Bessemer por su posible fragilidad, Baker lo empleó en el proyecto. La estructura demostró una rigidez excepcional: la deflexión máxima medida con locomotoras pesadas fue de solo 90 mm, muy cerca del valor teórico previsto de 100 mm. También se sometió a pruebas con dos trenes de carbón largos y pesados en condiciones de viento extremas, con una deflexión inferior a 180 mm.

El puente de Quebec: tragedia, rediseño y récord mundial

La siguiente gran estructura cantiléver fue el puente de Quebec, sobre el río San Lorenzo. Con un vano central de 549 m, aún es en la actualidad el puente cantiléver de mayor luz del mundo. Sin embargo, su construcción estuvo marcada por dos catastróficos fallos: en 1907, un error en el cálculo de las tensiones de compresión durante la fase de voladizo provocó el colapso de la estructura. En la reconstrucción se utilizó acero con níquel como nuevo material. No obstante, en 1916, el vano suspendido cayó al ser izado. Finalmente, el puente se terminó y se abrió al tráfico ferroviario en 1917. Los proyectistas originales fueron Theodore Cooper y Peter Szlapka, de la empresa Phoenixville Bridge Company. Tras el colapso, H. E. Vautelet presentó un nuevo diseño, pero la remodelación del puente se licitó entre varias empresas constructoras y fue ejecutada por G. H. Duggan (St. Lawrence Bridge Company) bajo la dirección de C. C. Schneider, R. Modjeski y C. N. Monsarrat. El acero aleado con níquel se utilizó por primera vez en 1909 en el puente de Blackwell’s Island (hoy Queensboro), en Nueva York. El acero con níquel también fue empleado extensamente por J. A. L. Waddell en diseños de puentes ferroviarios de grandes luces. A. N. Talbot realizó ensayos de conexiones de acero con níquel para la reconstrucción del puente de Quebec.

Puentes de tramo continuo: una opción limitada en América

Mientras que en Europa los puentes de tramo continuo se hicieron más frecuentes, en América del Norte se evitaban por su carácter estáticamente indeterminado. Una excepción fue el puente ferroviario de la Canadian Pacific Railway en Montreal, construido en 1886 con tramos principales de 124,5 m. Se utilizó un método cantiléver para su construcción, controlando cuidadosamente las deformaciones en los cordones inferiores mediante tensores y tornillos ajustables. Estos vanos fueron reemplazados en 1912 debido a las preocupaciones sobre su comportamiento bajo cargas ferroviarias más pesadas. El extremo principal de las cerchas de reemplazo del vano simple se apoyó mediante cimbras sobre una barcaza móvil durante su instalación en un trazado adyacente.

El primer gran puente ferroviario de acero de Francia fue el Viaducto del Viaur, que se construyó en 1898. Este puente de arco en celosía tipo cantilever es inusual, ya que no tiene un vano suspendido, por lo que la estructura es estáticamente indeterminada. Muchos ingenieros consideran que el diseño no era apropiado para cargas ferroviarias.

La consolidación de nuevas técnicas: roblonado y acero de alto carbono

A principios del siglo XX, muchas estructuras de hierro y acero fueron sustituidas debido al aumento de peso de las locomotoras. El peso típico de las locomotoras era de aproximadamente 40 t en 1860, 70 t en 1880, 100 t en 1890, 125 t en 1900 y 150 t en 1910. Aunque el roblonado era común en Europa, en Estados Unidos no se estandarizó en puentes de gran luz hasta alrededor de 1915. El roblonado se utilizaba en vanos de menor luz a principios del siglo XX.

Uno de los primeros ejemplos destacados fue el Hell Gate Bridge en Nueva York, una estructura de arco de acero de 298 m completada en 1916 para soportar cuatro vías ferroviarias. Fue erigido sin cimbra y empleó por primera vez acero con alto contenido en carbono, principalmente, debido al alto coste del acero aleado.

Ese mismo año, la Chesapeake & Ohio Railroad terminó el puente de Sciotoville, en Ohio, con dos tramos continuos de 236,5 m, el más largo de su tipo hasta hoy.

Un legado de 80.000 puentes

En 1910 se estimaba que había unos 80 000 puentes de hierro y acero en Estados Unidos, que sumaban un total de 2250 kilómetros sobre una red de 300 000 km de vías. La mayoría de los puentes eran de construcción de acero a principios del siglo XX. El ferrocarril, en su rápida expansión tras la Guerra Civil, se convirtió en el principal motor de innovación estructural, propiciando el paso de la madera y la mampostería al hierro y, finalmente, al acero.

El desarrollo de procesos como el Bessemer (1856) y el horno Siemens-Martin (1867) permitió la producción económica del acero. Así, los puentes ferroviarios de acero se convirtieron en una respuesta ingenieril al desafío logístico de la era industrial, marcando el inicio de la ingeniería estructural moderna.