Acaban de publicar nuestro artículo en la revista Buildings, de la editorial Elsevier, indexada en el JCR. El trabajo se realiza un exhaustivo análisis comparativo, basado en la metodología de Análisis de Ciclo de Vida (LCA) «de la cuna a la tumba», de tres soluciones de cerramiento para naves industriales de acero (chapas de acero, combinación de acero y ladrillo de arcilla y combinación de acero y bloque de hormigón) bajo dos escenarios de fin de vida (vertedero y reciclaje). Partiendo de una unidad funcional de 500 m² de envolvente lateral y utilizando el método ReCiPe 2016 Midpoint en 18 categorías de impacto, se desglosan detalladamente los inventarios de materiales, factores de reposición, procesos de extracción y fabricación, así como las repercusiones de distintas rutas de gestión de residuos. El estudio identifica los puntos críticos en las fases preoperativa, operativa y postoperativa, cuantifica las ventajas ambientales del reciclaje frente al vertido y evidencia que, pese a la preponderancia del acero, los indicadores de toxicidad humana y ecotoxicidad superan ampliamente la huella de carbono en importancia relativa. Por último, se discuten las limitaciones, se destacan las conclusiones clave y se proponen líneas de actuación futuras para enriquecer la sostenibilidad en el diseño y la gestión de las naves industriales.

Acaban de publicar nuestro artículo en la revista Buildings, de la editorial Elsevier, indexada en el JCR. El trabajo se realiza un exhaustivo análisis comparativo, basado en la metodología de Análisis de Ciclo de Vida (LCA) «de la cuna a la tumba», de tres soluciones de cerramiento para naves industriales de acero (chapas de acero, combinación de acero y ladrillo de arcilla y combinación de acero y bloque de hormigón) bajo dos escenarios de fin de vida (vertedero y reciclaje). Partiendo de una unidad funcional de 500 m² de envolvente lateral y utilizando el método ReCiPe 2016 Midpoint en 18 categorías de impacto, se desglosan detalladamente los inventarios de materiales, factores de reposición, procesos de extracción y fabricación, así como las repercusiones de distintas rutas de gestión de residuos. El estudio identifica los puntos críticos en las fases preoperativa, operativa y postoperativa, cuantifica las ventajas ambientales del reciclaje frente al vertido y evidencia que, pese a la preponderancia del acero, los indicadores de toxicidad humana y ecotoxicidad superan ampliamente la huella de carbono en importancia relativa. Por último, se discuten las limitaciones, se destacan las conclusiones clave y se proponen líneas de actuación futuras para enriquecer la sostenibilidad en el diseño y la gestión de las naves industriales.

Este trabajo se enmarca dentro del proyecto de investigación RESILIFE, que dirijo como investigador principal en la Universitat Politècnica de València, y es fruto de la colaboración internacional con investigadores de la Universidad Tecnológica Federal de Paraná (Universidade Tecnológica Federal do Paraná, UTFPR), de Brasil.

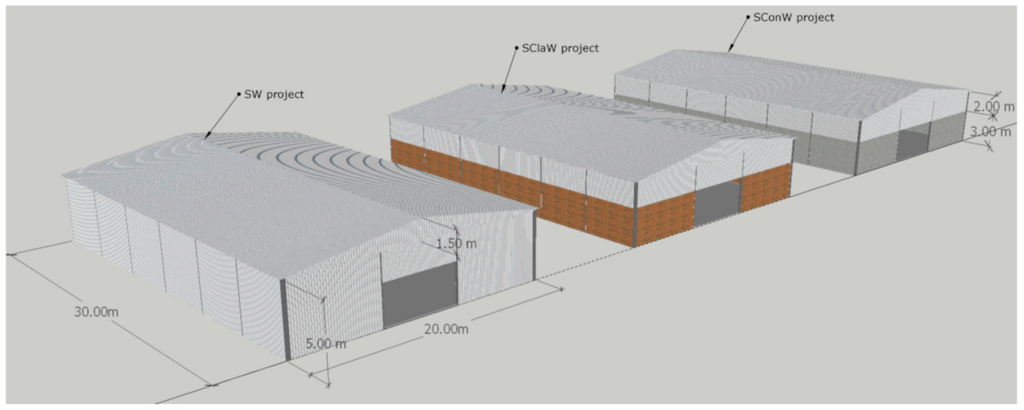

En el sector de la construcción existe una fuerte demanda de sustituir las técnicas tradicionales por sistemas más sostenibles que cuantifiquen y reduzcan sus impactos ambientales más allá de las simples emisiones de CO₂ o la energía incorporada. Sin embargo, son escasos los estudios comparativos de LCA en naves industriales de acero que contrasten diversas opciones de cerramiento y analicen simultáneamente distintos escenarios de fin de vida. Este trabajo compara tres sistemas de cerramiento en naves de acero (SW: paneles de acero, SClaW: acero + ladrillo de arcilla y SConW: acero + bloque de hormigón) bajo dos rutas de fin de vida (vertedero frente a reciclaje), evaluando su desempeño en 18 categorías de impacto del método ReCiPe 2016 Midpoint. El objetivo es determinar qué combinaciones de materiales y gestión de residuos ofrecen el menor impacto ambiental global y, en consecuencia, orientar futuras decisiones de diseño y gestión.

Siguiendo la norma ISO 14040/44, se define el alcance como el ciclo completo de vida de las naves (extracción de materias primas, producción, construcción, uso y fin de vida). La unidad funcional elegida es 500 m² de cerramiento lateral equivalente a la envolvente de dos muros completos de la nave (superficie total: 600 m², 30 m × 20 m × 5 m). Se excluyó el tratamiento de los residuos generados en la obra y en el mantenimiento por falta de datos fiables y para garantizar la comparabilidad entre los tres diseños.

Las naves comparten estructura de perfiles de acero (ASTM A36 y A572 Gr. 50) y techo de chapa trapezoidal galvanizada de 0,5 mm de espesor y una pendiente del 5 %. Los cerramientos varían únicamente:

- SW: chapa de acero (2500,78 kg).

- SClaW: chapa (1190,85 kg) + ladrillo de arcilla (17 503,33 kg) + mortero (10 860,95 kg).

- SConW: chapa (1190,85 kg) + bloque de hormigón (51 102,57 kg) + mortero (11 235,08 kg).

Para la etapa de uso, se asumió una vida útil de la nave de 50 años y de 40 años para el cerramiento (ABNT NBR 15575), por lo que se calculó un factor de reposición RF = 50/(40−1) = 0,25. Es decir, durante la explotación se sustituyó el 25 % de los materiales del cerramiento.

Se empleó SimaPro 9.6.0.1 con la base de datos Ecoinvent 3.10 y el método ReCiPe 2016 Midpoint (perspectiva jerárquica), con el que se caracterizaron 18 categorías: desde el «potencial de calentamiento global» o GWP hasta la toxicidad humana y la ecotoxicidad (terrestre, dulce y marina), pasando por la eutrofización, el agotamiento de recursos y el consumo de agua. El análisis abarca las fases preoperacional, operativa (incluido el RF) y postoperativa (vertederos inertes/sanitarios según la norma CONAMA 307/2002 frente a rutas de reciclaje).

Resultados: fases preoperativa y operativa

- SW presenta los mayores impactos en seis categorías clave (eutrofización, ecotoxicidad y toxicidad humana), debido a la extracción y procesamiento intensivos del acero, con liberación de metales pesados y compuestos que elevan la eutrofización de las aguas continentales, la eutrofización marina, la ecotoxicidad terrestre, la ecotoxicidad de las aguas continentales, la eutrofización marina y la toxicidad carcinógena humana.

- SClaW es el más perjudicial en otras seis categorías (escasez de recursos fósiles, escasez de recursos minerales, GWP, formación de partículas finas, radiación ionizante y toxicidad no carcinógena humana) debido al alto consumo de combustibles fósiles y materias primas en la cocción de ladrillos.

- SConW lidera las 6 categorías restantes (ozonación, ozonización humana y terrestre, acidificación terrestre, consumo de agua, uso del suelo), atribuibles a la producción de cemento y hormigón (SO₂, NO_x, consumo de áridos y agua).

El impacto operativo equivale a un 25 % del preoperacional en todas las categorías, debido al RF uniforme, por lo que se suma directamente para el análisis conjunto.

Resultados: fase postoperativa

- En el Escenario 1 (vertedero), SW arroja los mayores impactos en GWP, escasez de recursos fósiles, toxicidad y consumo de agua al verter acero (100 % reciclable) en un vertedero sanitario, lo que aumenta la demanda de material virgen y las emisiones asociadas.

- En el Escenario 2 (reciclaje), todos los impactos se reducen drásticamente para los tres proyectos; la magnitud de esta reducción es mayor en SW debido a su alta proporción de acero, lo que penaliza severamente su perfil ambiental en el vertedero.

Este contraste evidencia que la estrategia de gestión de residuos (vertedero frente a reciclaje) tiene un efecto igual o más importante que la elección del material de cerramiento.

Resultados: ciclo de vida completo y comparativa cuantitativa.

En el ciclo de vida completo bajo el escenario 2, el SW + reciclaje obtiene el mejor desempeño ambiental en 9 de las 18 categorías. Por ejemplo, en GWP registra 7 823,752 kg CO₂ eq, con el SClaW al 98,34 % y el SConW al 72,66 % de ese valor; en Ozone Depletion es 0,00126 kg CFC11 eq (SClaW al 78,62 %, SConW al 176,45 %); en Ionizing Radiation registra 221,576 kBq Co-60 eq (33,85 % y −4,54 % respectivamente).

En contraste, el SW + vertedero es la peor alternativa en siete categorías (ecotoxicidad terrestre y acuática, carcinogenicidad y eutrofización), lo que subraya el impacto negativo de no reciclar el acero.

La normalización revela que las categorías de ecotoxicidad (terrestre, dulce y marina) y toxicidad no carcinógena para los humanos dominan el impacto total, superando ampliamente a la de GWP. Esto indica que existen riesgos locales y laborales por exposición a contaminantes pesados y compuestos tóxicos, que a menudo quedan fuera de los debates centrados únicamente en el cambio climático.

Discusión de los resultados

- La opción más favorable en la mitad de las categorías ambientales evaluadas es la elección de chapas de acero reciclables, combinada con un programa de reciclaje efectivo.

- El estudio demuestra la relevancia de ampliar el alcance de los indicadores más allá del CO₂, ya que categorías como la ecotoxicidad y la toxicidad humana pueden ser hasta 20 veces más significativas en términos normalizados.

- La disposición de materiales reciclables (acero, ladrillo, hormigón) en vertederos supone un «punto caliente» que puede anular parcialmente las ventajas de un diseño ligero o materialmente eficiente.

Limitaciones y futuras líneas de investigación

Los autores reconocen que el estudio presenta varias limitaciones derivadas del ámbito de los datos y del alcance metodológico. En primer lugar, se ha excluido del inventario la generación de residuos durante las fases de construcción y mantenimiento, debido a la falta de datos fiables y específicos para proyectos de naves industriales. Además, la dependencia de procesos y materiales modelados en la base de datos genérica Ecoinvent, sin tener en cuenta los inventarios locales brasileños, puede afectar a la representatividad regional de los resultados y sesgar las conclusiones. Por último, el análisis se ha centrado exclusivamente en indicadores ambientales, dejando fuera las dimensiones económica y social, como los costes de ciclo de vida y el impacto social, así como aspectos operativos clave, como el confort térmico y la eficiencia energética durante el uso de las naves.

Para superar estas limitaciones y enriquecer la sostenibilidad de futuros estudios, se proponen una serie de recomendaciones. En primer lugar, se sugiere incorporar inventarios primarios locales que reflejen de manera más precisa los procesos y materiales de cada región, especialmente en contextos como el brasileño. En segundo lugar, se debe ampliar el abanico de sistemas constructivos analizados, incluyendo soluciones con aislantes y materiales híbridos que puedan ofrecer mejores prestaciones ambientales. En tercer lugar, se debe avanzar hacia un análisis integrado de costes y aspectos sociales mediante una metodología LCSA (Life Cycle Sustainability Assessment), que combine las dimensiones económica, ambiental y social. Por último, se debe evaluar el rendimiento en uso de las naves y relacionar los resultados de la LCA ambiental con parámetros de eficiencia energética y confort térmico para ofrecer una visión más completa del ciclo de vida del edificio.

Referencia:

VITORIO JUNIOR, P.C.; YEPES, V.; ONETTA, F.; KRIPKA, M. (2025). Comparative Life Cycle Assessment of Warehouse Construction Systems under Distinct End-of-Life Scenarios. Buildings, 15(9), 1445. DOI:10.3390/buildings15091445

Como el artículo está publicado en abierto, lo dejo para su descarga.