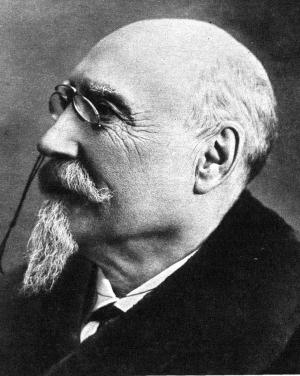

Josef Melan fue un ingeniero austríaco ampliamente reconocido por su destacado papel en el desarrollo de la construcción de puentes de hormigón armado a finales del siglo XIX. Se le acredita la invención del Sistema Melan, un método innovador para la construcción de puentes reforzados. A diferencia de los enfoques previos, su sistema no incorporaba barras de hierro dentro de la estructura de hormigón armado, sino que empleaba arcos de celosía rígidos de hierro como elemento de refuerzo.

En 1898, Melan alcanzó un reconocimiento significativo tras la construcción de un puente de 42,4 m de luz en Steyr, caracterizado por un arco de altura reducida. En su momento, esta obra representó el mayor puente de hormigón armado a nivel mundial. Entre sus proyectos más notables se encuentra el Puente del Dragón en Liubliana, una de las primeras estructuras de gran escala en emplear su innovador sistema constructivo.

Nacido el 18 de noviembre de 1853 en Viena, entonces parte del Imperio austrohúngaro, Melan falleció el 6 de febrero de 1941 en Praga, en la anterior Checoslovaquia. Inició sus estudios de ingeniería civil en la Universidad Técnica de Viena en 1869 y los completó en 1874. Posteriormente, tras su graduación, se desempeñó como asistente de Emil Winkler en la cátedra de Ingeniería Ferroviaria y Construcción de Puentes, marcando así el inicio de su destacada trayectoria académica y profesional.

En 1880, presentó su tesis de habilitación sobre la teoría de puentes y ferrocarriles en la misma universidad, donde ejerció como docente hasta 1886. Durante este período, además de su labor académica, desarrolló actividades profesionales en los departamentos de diseño de la empresa de construcción de puentes Ignaz Gridl y junto al contratista Gaertner, ambos con sede en Viena. En 1880, fue nombrado profesor asociado de mecánica estructural y estática gráfica en la Universidad Técnica Alemana de Brno, y en 1890 ascendió a catedrático en la misma especialidad. Posteriormente, en 1895, asumió la Cátedra de Construcción de Puentes, y en 1902 pasó a ocupar el mismo cargo en la Universidad Técnica Alemana de Praga (fundada en 1717), donde trabajó hasta su jubilación en 1923.

Durante su estancia en Viena, Melan inició el desarrollo de cálculos relacionados con la deformación estática en grandes puentes colgantes, con el propósito de optimizar su diseño y reducir costes. En 1888, Melan publicó los resultados de sus investigaciones, lo que atrajo la atención de su antiguo compañero de estudios, Gustav Lindenthal, quien le encargó la revisión estructural del Williamsburg Bridge de Nueva York, el puente colgante más grande del mundo en aquella época.

Paralelamente, ese mismo año, el ingeniero Victor Brausewetter, en colaboración con el fabricante de cemento Adolf Pittel, fundó la empresa Pittel & Brausewetter y promovió la creación de una asociación dedicada a la realización de ensayos comparativos de carga sobre estructuras abovedadas. Estos ensayos abarcaban desde bóvedas de fábrica en hormigón simple hasta elementos de hormigón armado. Desde 1886, la empresa de Gustav Adolf Waysse ya había construido estructuras basadas en la patente de Joseph Monier, con refuerzo de malla de acero en ambas direcciones. No obstante, tras un exhaustivo análisis de los ensayos mencionados, Melan expresó su escepticismo respecto al sistema, manifestando reservas en cuanto a la resistencia de los alambres empleados.

En 1892, presentó su propio y revolucionario sistema estructural, basado en un refuerzo longitudinal rígido para bóvedas, que sentó las bases de la arquitectura moderna. Para estructuras de menor luz, se utilizaron vigas en L dobladas, mientras que para las de mayor envergadura se emplearon cerchas metálicas. Gracias a su mayor capacidad portante, este método fue rápidamente adoptado en la construcción de techos en almacenes, fábricas y grandes naves industriales. Una innovación notable fue la posibilidad de suspender el encofrado del propio refuerzo y hormigonar los arcos sin necesidad de cimbras de anillos. Pittel & Brausewetter realizó pruebas de este sistema entre 1893 y 1895 en edificaciones de menor escala, aunque lamentablemente ninguna de ellas ha perdurado hasta nuestros días.

Uno de sus discípulos, Fritz Emperger, desempeñó un papel fundamental en la difusión del método de Melan. En 1893, fundó en la ciudad de Nueva York la Melan Arch Construction Company, que en 1894 se encargó del diseño y la construcción de dos puentes en Rock Rapids (Iowa) y Cincinnati (Ohio). Antes de que finalizara el siglo, su empresa había construido veintisiete puentes más, entre ellos el puente sobre el río Kansas en Topeka (Kansas), edificado entre 1896 y 1897, con cinco arcos de 30 metros de luz cada uno.

A pesar del éxito de su sistema en Estados Unidos, la comunidad técnica europea mantuvo una actitud escéptica hasta que Melan diseñó en 1896 un puente en Steyr, construido bajo la supervisión de Victor Brausewetter en 1898. Esta estructura, ubicada en la ciudad de Steyr, Alta Austria, cruzaba un brazo del río homónimo mediante un arco de tres vanos, con una luz máxima de 42,4 m y una flecha extremadamente reducida de 1:16. Ese mismo año, Melan diseñó lo que probablemente sea el puente de hormigón armado más antiguo de las tierras checas, ubicado en Veveří, cuyo diseño se inspiró en el puente medieval original que cruzaba el foso del castillo. En 1901 se finalizó la construcción del Puente del Dragón de Liubliana, cuya estructura de hormigón visto combinada con revestimientos de bronce fue diseñada por el arquitecto dálmata Jurij Zaninović.

Simultáneamente, Melan resultó adjudicatario de un concurso público para el diseño de un puente vial en Lausana, destinado a conectar los distritos de Chauderon y Montbenon. Posteriormente, en 1912, Melan proyectó un puente de hormigón armado en Le Sépey, ubicado en el sur de Suiza.

Su labor académica en Praga tuvo un impacto significativo en el desarrollo de la oficina técnica de Pittel & Brausewetter, que se convirtió en un centro de formación para sus estudiantes. Entre 1908 y 1912, Konrad Kluge (1878-1945), uno de sus alumnos más distinguidos, diseñó varios puentes con arcos rígidos reforzados con vigas en L, ubicados en Debrny, Jihlava, Přísečnice (hoy desaparecida), česká Třebová y Oloví.

En 1920, recibió el título de doctor honoris causa de la Escuela Técnica Superior de Aquisgrán en reconocimiento a su labor como profesor y científico en el campo de la ingeniería de puentes, así como por sus avances como inventor de un nuevo tipo de puente de hormigón armado.

A pesar de su avanzada edad, Melan mantuvo una constante actividad profesional. En julio de 1928, Melan diseñó un puente de arco metálico en Ústí nad Labem, basado en una propuesta de Ernst Krob, director de la Autoridad de Construcción de la ciudad. La construcción de la obra se llevó a cabo entre 1934 y 1936, consolidando de este modo su legado en el ámbito de la ingeniería estructural.

Melan se erigió como una de las figuras más influyentes en la teoría y práctica de la construcción de puentes en Austria durante la transición desde la fase de formación disciplinar hasta el período de consolidación de la teoría de estructuras. Su innovación más destacada, el Sistema Melan, introdujo una metodología pionera que combinaba de manera innovadora acero y hormigón en la construcción de puentes. A partir de la década de 1890, este sistema fue ampliamente aceptado en Europa y Estados Unidos, posicionándose como una de las soluciones constructivas más avanzadas de su época. Su impacto fue reconocido con la medalla de oro en la Exposición Universal de París en 1900.

En 1893, Melan publicó sus estudios sobre arcos de hormigón reforzado con estructuras de hierro, lo que marcó un hito en la construcción mixta. Su prestigio internacional experimentó un notable incremento en 1898, con la construcción de un puente de 42,4 m de luz en Steyr, considerado el puente de hormigón armado más extenso de su época. En este caso, el arco metálico inicial se ejecutó mediante voladizos sucesivos con un atirantamiento provisional.

Más allá de sus aportes en la construcción mixta, Melan dejó una huella indeleble en la ingeniería de puentes metálicos. En 1888, Melan fue pionero en cuantificar los efectos de la teoría de segundo orden, un avance crucial en la modelización estructural. Sus tratados sobre puentes recibieron un reconocimiento internacional destacado, y en 1913, su obra sobre puentes en arco y colgantes fue traducida al inglés por el ingeniero estadounidense David B. Steinman.

Además de su labor teórica, Melan ejerció una influencia decisiva en el desarrollo de la ingeniería de grandes puentes en Estados Unidos. Colaboró con el Departamento de Puentes de Nueva York en la verificación de los cálculos del Williams Bridge y en la evaluación del Hell Gate Bridge, diseñado por la oficina del ingeniero Gustav Lindenthal. Su impacto en la construcción de puentes en Estados Unidos durante las dos primeras décadas del siglo XX fue sin precedentes.

Principales contribuciones a la teoría de estructuras

Josef Melan realizó importantes aportaciones a la teoría de estructuras a lo largo de su carrera, plasmadas en diversas publicaciones de referencia. Entre sus primeros trabajos destacan Beitrag zur Berechnung eiserner Hallen-Gespärre (1883), en el que abordó el cálculo de cerchas metálicas en naves industriales, y Ueber den Einfluss der Wärme auf elastische Systeme (1883), donde analizó los efectos térmicos en sistemas elásticos. Posteriormente, en Beitrag zur Berechnung statisch unbestimmter Stabsysteme (1884), se centró en la resolución de sistemas de barras estáticamente indeterminados.

Su obra Theorie der eisernen Bogenbrücken und der Hängebrücken (1888) estableció las bases para el diseño de puentes en arco de hierro y puentes colgantes, consolidando su prestigio en la ingeniería estructural. Años más tarde, en Theorie des Gewölbes und des Eisenbetongewölbes im besonderen (1908), amplió su estudio al análisis de bóvedas, con especial énfasis en las estructuras de hormigón armado.

Durante su etapa en la Universidad Técnica Alemana de Praga, Melan publicó Der Brückenbau, una serie de volúmenes basados en sus conferencias impartidas entre 1910 y 1917. Su influencia trascendió el ámbito europeo con la publicación en inglés de Theory of Arches and Suspension Bridges (1913) y Plain and Reinforced Concrete Arches (1915), obras que consolidaron su impacto en la ingeniería de puentes a nivel internacional.