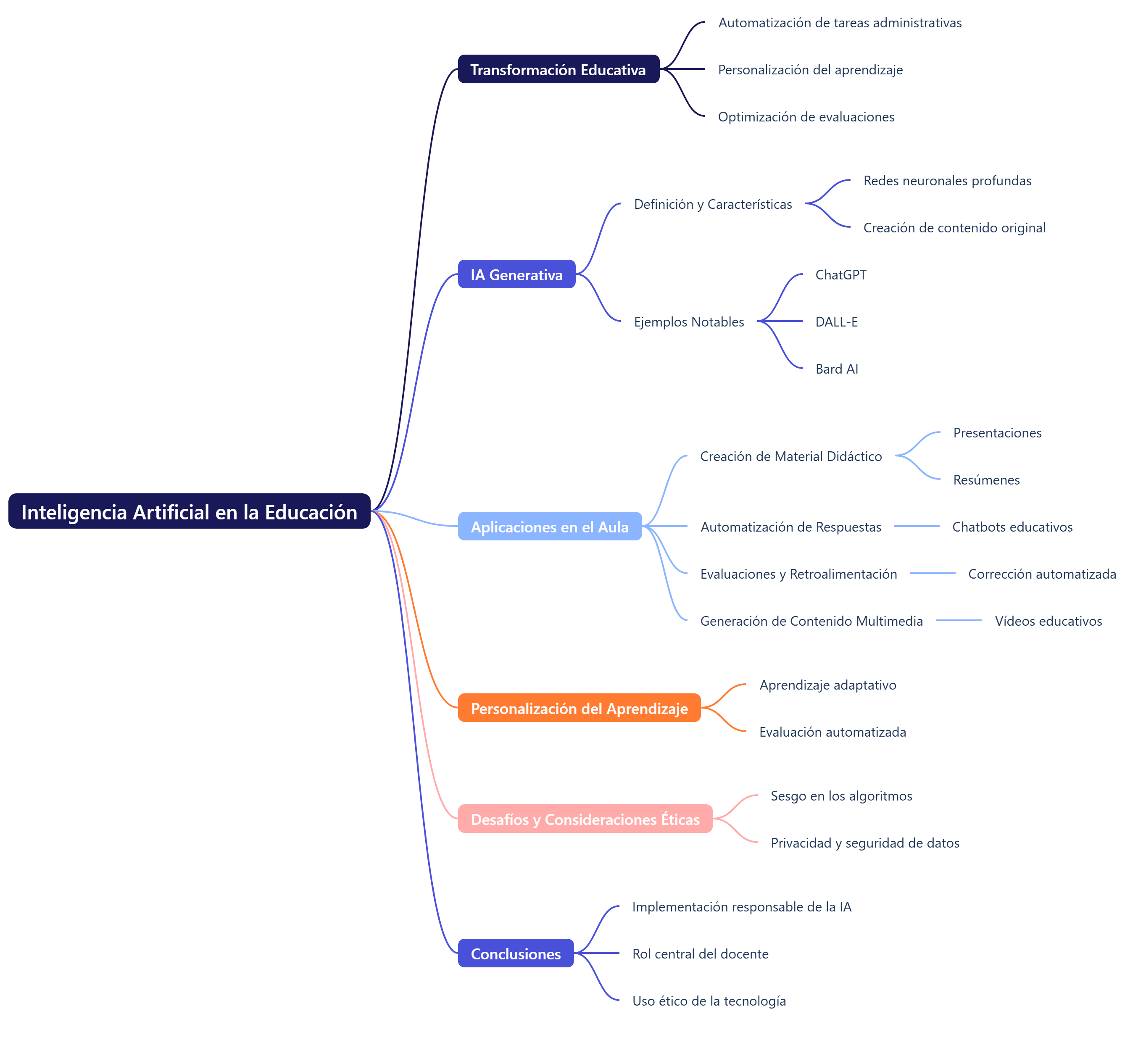

La formación en ingeniería está experimentando una transformación profunda, impulsada por desafíos globales como el cambio climático, la revolución digital y la creciente brecha entre la enseñanza académica y las exigencias del mercado laboral. A continuación, analizamos el trabajo de Hadgraft y Kolmos (2020), donde se explora cómo la educación en ingeniería está evolucionando para hacer frente a estos retos mediante cuatro tendencias clave: el aprendizaje centrado en el estudiante, el aprendizaje contextual, la digitalización de la enseñanza y el desarrollo de competencias profesionales. A partir de estas líneas de cambio, se propone que la educación futura debe pasar de un enfoque en disciplinas individuales a currículos integrados que aborden problemas complejos y promuevan trayectorias de aprendizaje personalizadas. En última instancia, se hace hincapié en la necesidad de un cambio sistémico en el diseño curricular para preparar a los ingenieros para un futuro laboral en constante cambio.

La formación en ingeniería está experimentando una transformación profunda, impulsada por desafíos globales como el cambio climático, la revolución digital y la creciente brecha entre la enseñanza académica y las exigencias del mercado laboral. A continuación, analizamos el trabajo de Hadgraft y Kolmos (2020), donde se explora cómo la educación en ingeniería está evolucionando para hacer frente a estos retos mediante cuatro tendencias clave: el aprendizaje centrado en el estudiante, el aprendizaje contextual, la digitalización de la enseñanza y el desarrollo de competencias profesionales. A partir de estas líneas de cambio, se propone que la educación futura debe pasar de un enfoque en disciplinas individuales a currículos integrados que aborden problemas complejos y promuevan trayectorias de aprendizaje personalizadas. En última instancia, se hace hincapié en la necesidad de un cambio sistémico en el diseño curricular para preparar a los ingenieros para un futuro laboral en constante cambio.

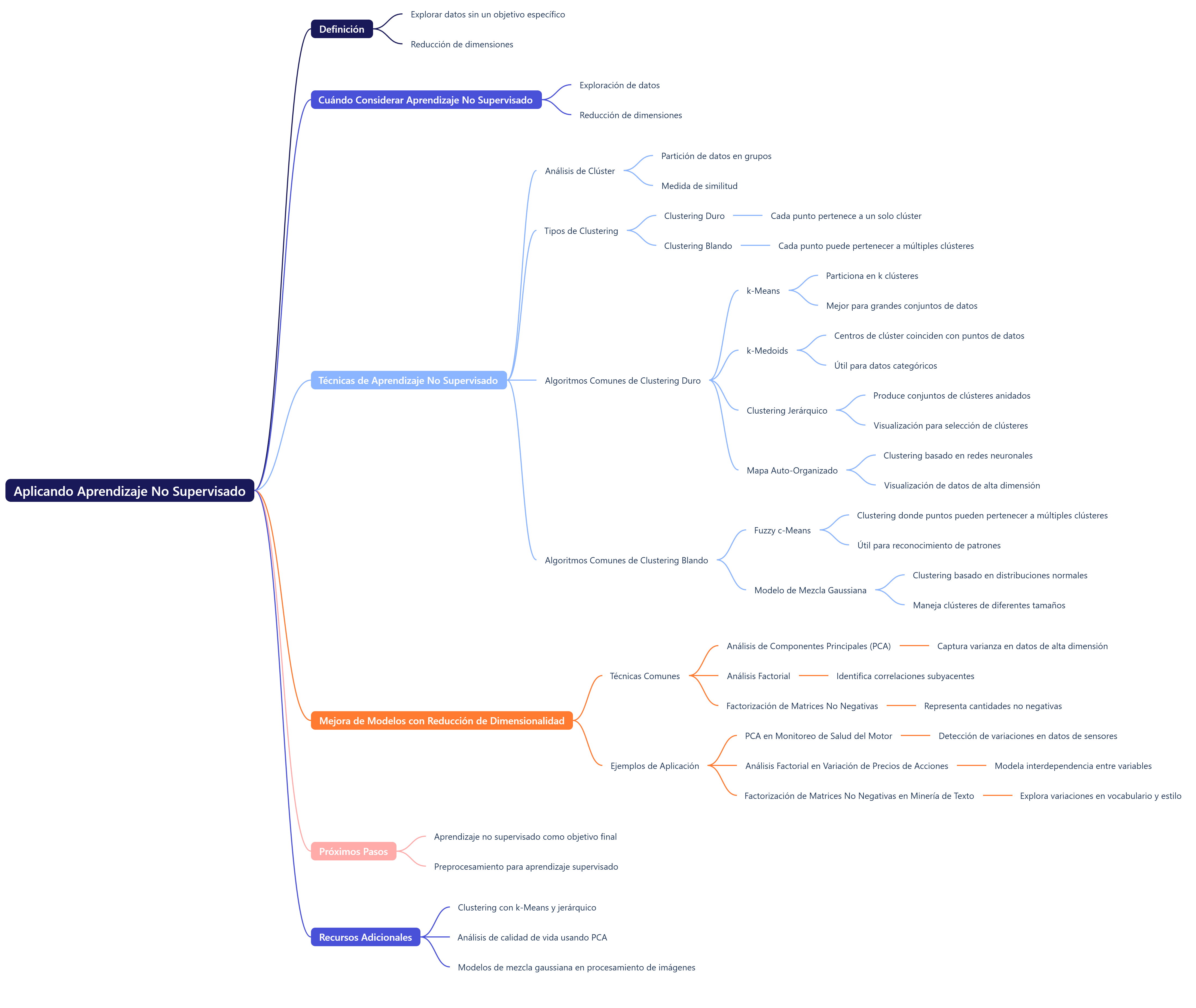

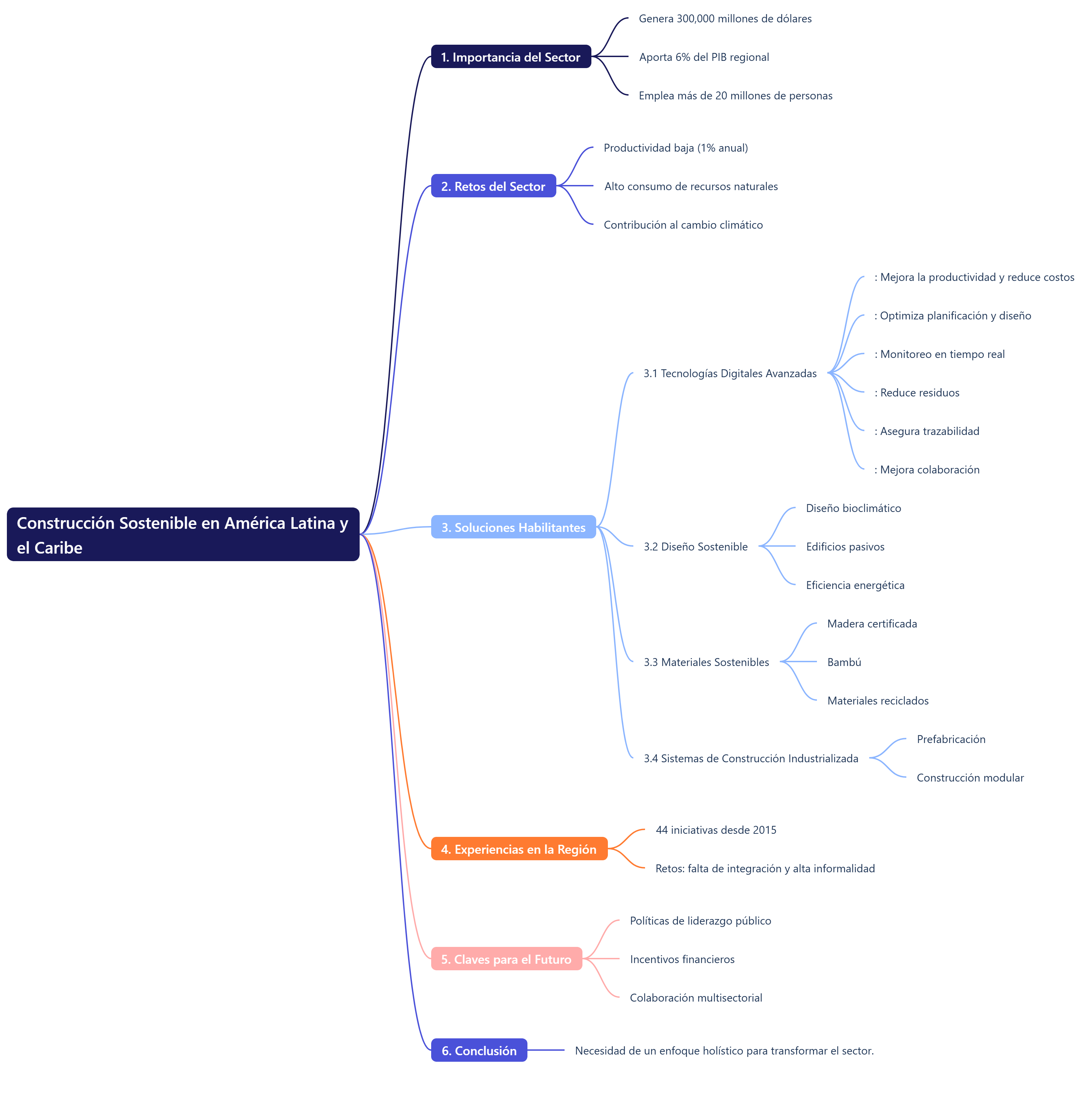

La educación en ingeniería se enfrenta a tres desafíos fundamentales: la sostenibilidad y el cambio climático, la Cuarta Revolución Industrial (Industria 4.0) y la empleabilidad de los graduados. Estos desafíos exigen que los ingenieros del futuro posean habilidades transdisciplinares, pensamiento sistémico y contextual, y la capacidad de actuar en situaciones complejas y caóticas. Para responder a estas necesidades, la educación en ingeniería ha evolucionado hacia un enfoque centrado en el estudiante, la integración de la teoría y la práctica, el aprendizaje digital y en línea, y el desarrollo de competencias profesionales. A largo plazo, se tenderá a modelos curriculares más personalizados y centrados en proyectos que permitan a los estudiantes construir sus propias trayectorias de aprendizaje y documentar sus competencias para el aprendizaje a lo largo de la vida.

1. Desafíos clave para la educación en ingeniería

Se identifican tres desafíos principales que están impulsando la necesidad de transformar la educación en ingeniería:

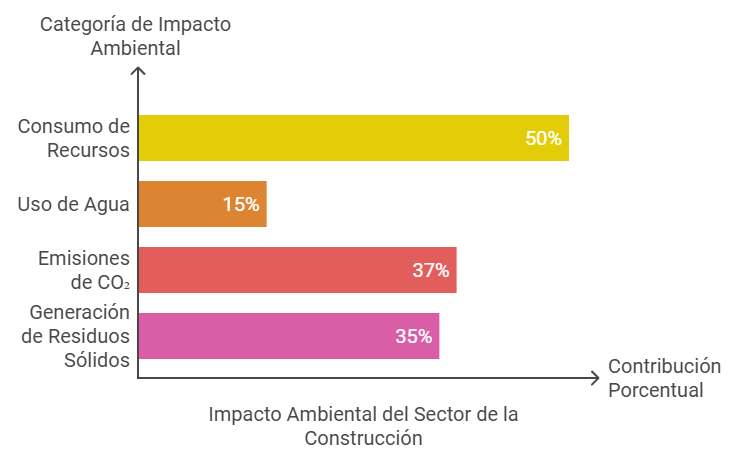

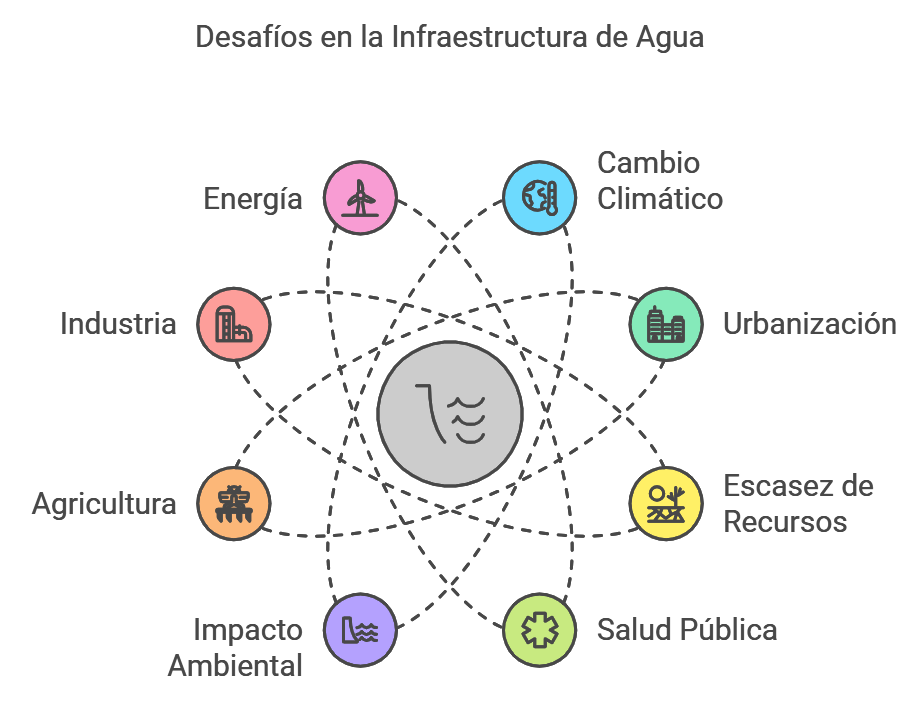

- Sostenibilidad y cambio climático: la ingeniería es fundamental para abordar los 17 Objetivos de Desarrollo Sostenible (ODS) de la ONU, especialmente en lo que respecta a la pobreza, el hambre, la salud, el agua, la energía, el crecimiento económico y la acción climática. La educación en ingeniería debe preparar a los graduados para responder a estos desafíos humanitarios, sociales y económicos.

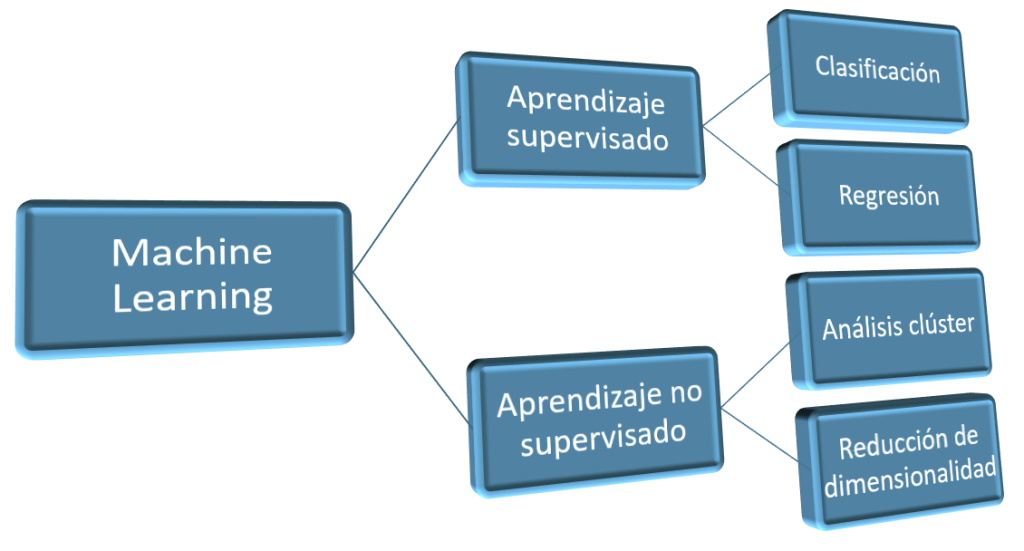

- Cuarta Revolución Industrial (Industria 4.0): Esta revolución implica la integración generalizada de tecnologías como la automatización, el internet de las cosas (IoT), la inteligencia artificial (IA), la robótica y la fabricación aditiva. Tradicionalmente, la ingeniería no se ha enseñado de manera integradora, pero el éxito de la Industria 4.0 depende de la interacción y la integración de estas tecnologías. Esto requiere una mayor colaboración interdisciplinaria entre diferentes programas y disciplinas universitarias, como informática, análisis de datos, robótica, automatización, producción, gestión, electrónica y materiales. La segunda revolución industrial, que está en la agenda política e industrial, implica la integración generalizada de tecnologías como la automatización, el IoT, la IA, la robótica, los materiales avanzados, la fabricación aditiva, la impresión multidimensional, las bio-, nano- y neurotecnologías, y las realidades virtuales y aumentadas.

- Empleabilidad y competencias de innovación: a pesar de la creciente importancia de habilidades como el emprendimiento y el pensamiento de diseño, aún existe una brecha entre la formación en ingeniería y la preparación para el mundo laboral. La integración de la teoría y la práctica mediante pasantías, proyectos en colaboración con el sector y laboratorios de aprendizaje son soluciones parciales. El aprendizaje basado en problemas o proyectos (PBL) se presenta como un mecanismo para abordar este desafío. La brecha entre la educación en ingeniería y la preparación para el trabajo sigue existiendo, por lo que se deben integrar la teoría y la práctica mediante un enfoque centrado en la empleabilidad y la colaboración con la industria mediante pasantías, proyectos de asociación y laboratorios de aprendizaje.

Estos tres desafíos exigen, en conjunto, un mayor énfasis en la responsabilidad social, la integración del contexto social y la interdisciplinariedad, combinados con habilidades digitales y genéricas.

2. Respuestas actuales y tendencias emergentes

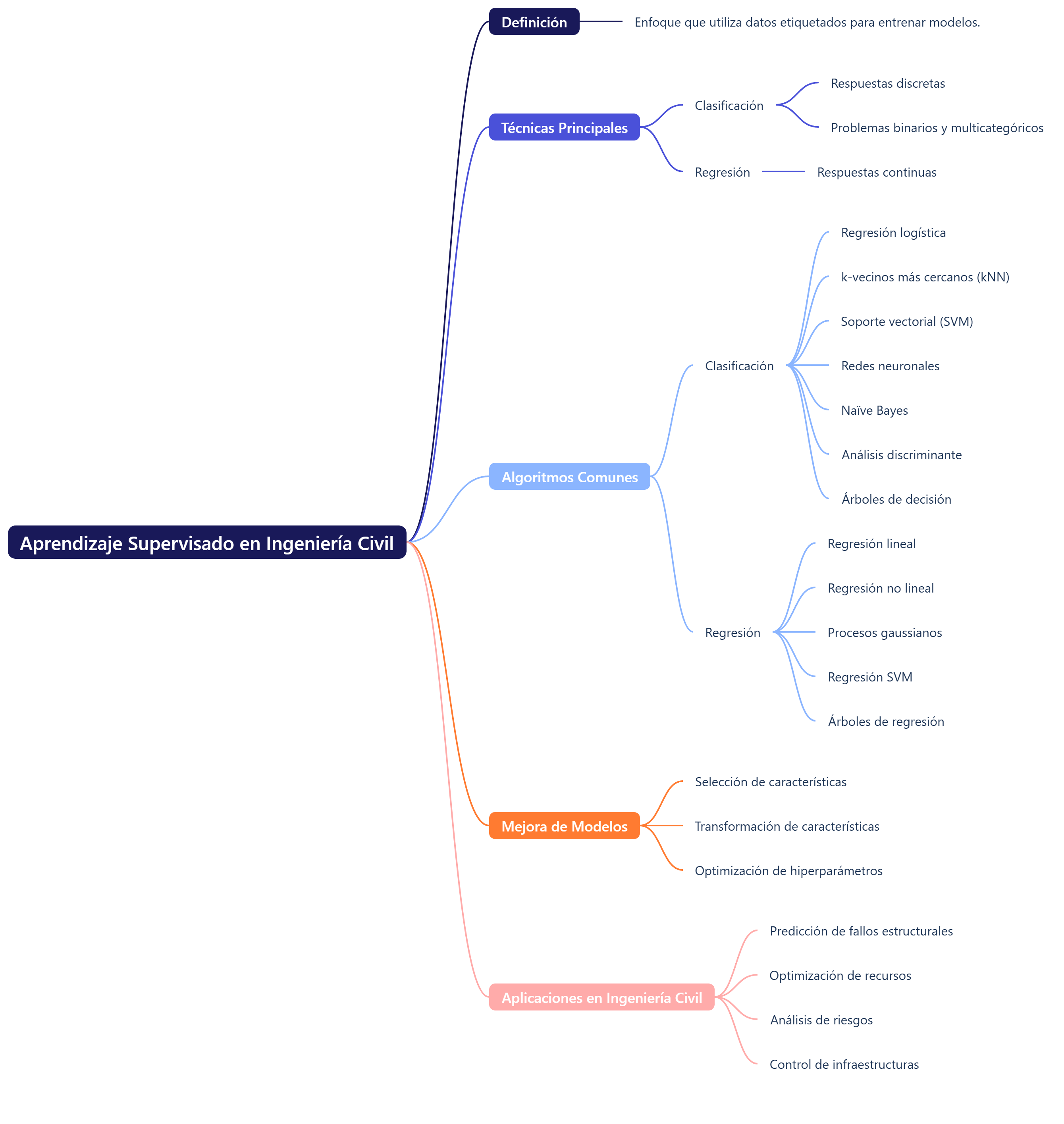

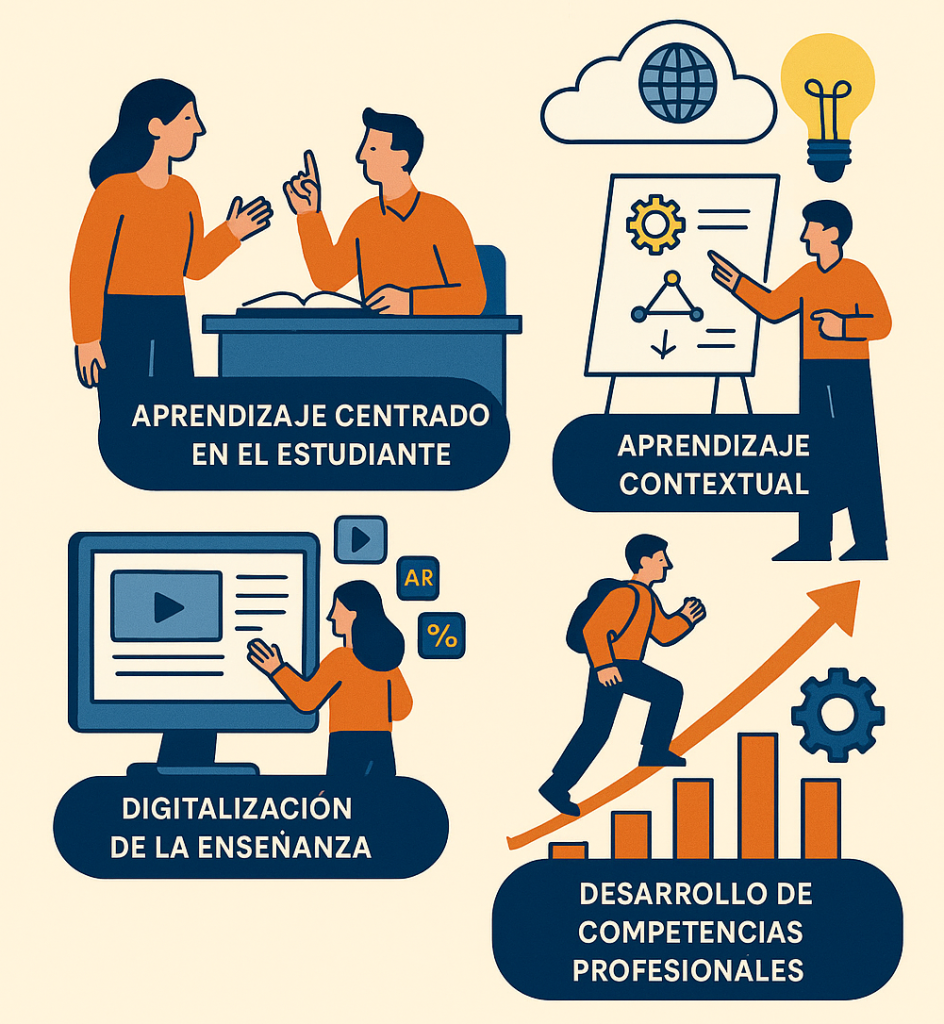

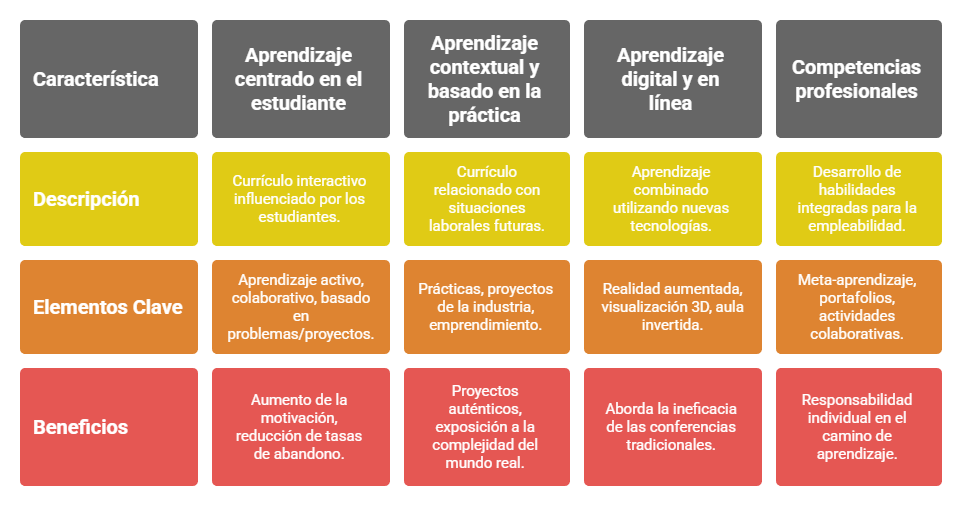

La educación en ingeniería ha respondido a estos desafíos con cuatro tendencias principales que se materializarán a corto plazo:

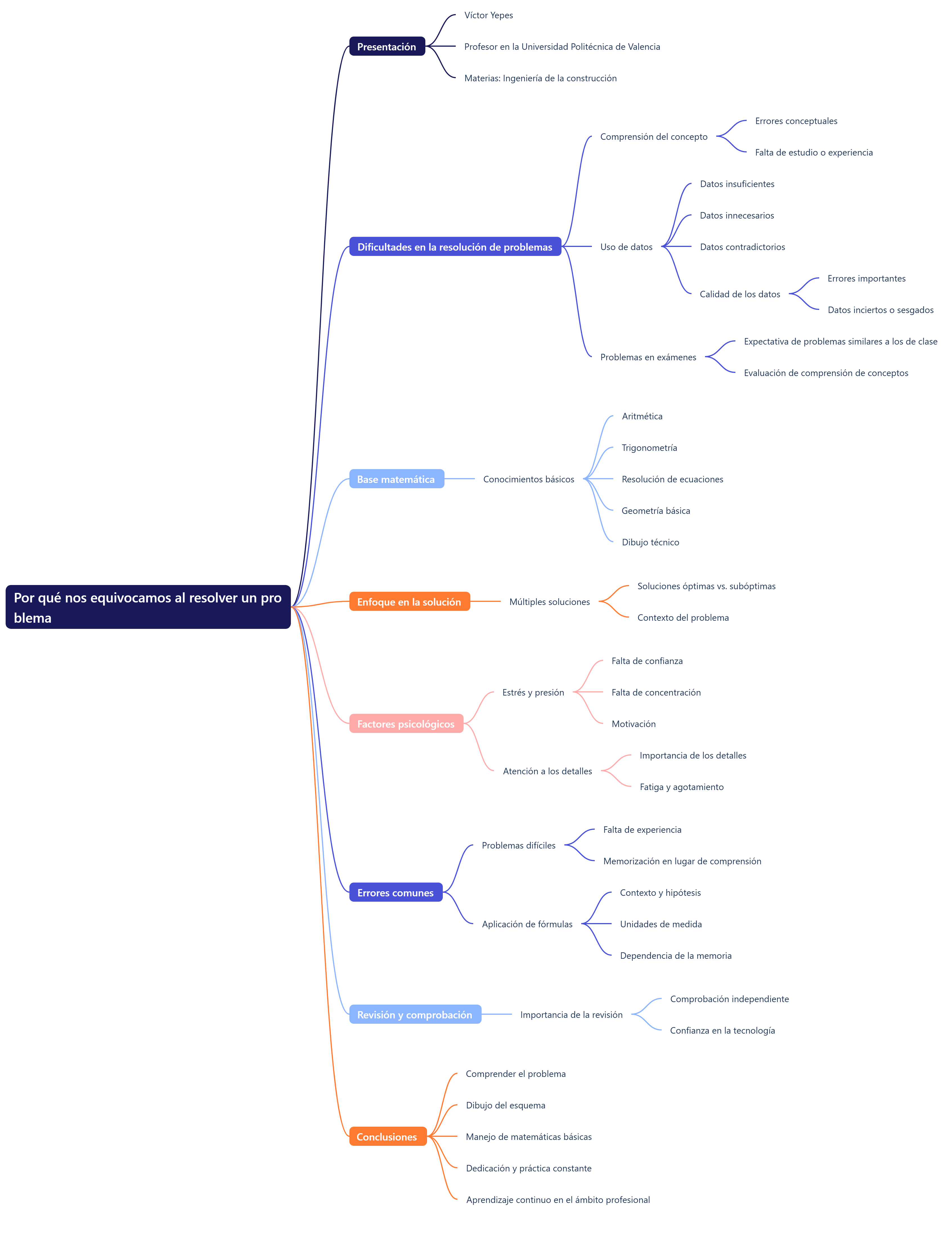

- Aprendizaje centrado en el estudiante: Un cambio significativo de la enseñanza tradicional (el profesor da la clase, los estudiantes escuchan) a un currículo más interactivo donde los estudiantes influyen en la dirección de su propio aprendizaje. Esto incluye metodologías como el aprendizaje activo, el aprendizaje colaborativo, el aprendizaje basado en equipos, el aprendizaje basado en el diseño, el aprendizaje basado en la investigación y, en particular, el aprendizaje basado en problemas y proyectos (PBL). El PBL ha demostrado su eficacia para aumentar la motivación, reducir las tasas de abandono y desarrollar competencias, y constituye una respuesta clave a la necesidad de un aprendizaje más complejo. El aprendizaje centrado en el estudiante es un área bien investigada. Los estudios sobre aprendizaje activo, aprendizaje basado en la investigación, aprendizaje basado en el diseño y aprendizaje basado en desafíos muestran efectos positivos en los resultados del aprendizaje. La motivación aumenta cuando los estudiantes inician proyectos, en los que identifican problemas y tienen un alto grado de influencia en la dirección del proyecto.

- Aprendizaje contextual y basado en la práctica: Incorporación de elementos curriculares relacionados con situaciones laborales futuras, como pasantías, proyectos de la industria, emprendimiento y centros de innovación. Los proyectos iniciados externamente (por empresas o la comunidad) son particularmente valiosos porque son auténticos y exponen a los estudiantes a la complejidad del mundo real. Junto con la tendencia del aprendizaje centrado en el estudiante, existe una tendencia de aprendizaje contextual y relacionado con la práctica, en la que los estudiantes cuentan con elementos del currículo relacionados con situaciones laborales posteriores, como pasantías, proyectos de la industria, emprendimiento y centros de innovación.

- Aprendizaje digital y en línea: Evolución del aprendizaje a distancia a estrategias de aprendizaje combinado (blended learning) que utilizan nuevas tecnologías como la realidad aumentada y la visualización 3D. El modelo del «aula invertida» (flipped classroom) es un ejemplo destacado, en el que los estudiantes se preparan con contenido en línea antes de clase y utilizan el tiempo en el aula para actividades interactivas y resolución de problemas. Este enfoque es una respuesta a la ineficacia de las clases magistrales tradicionales para los niveles superiores de la taxonomía de Bloom y los aspectos complejos del marco Cynefin. En la actualidad, el aprendizaje digital se centra en las estrategias de aprendizaje combinado. La digitalización es más que ofrecer plataformas y entornos de aprendizaje en línea como Blackboard o Moodle; consiste en usar nuevas tecnologías para el aprendizaje, como la realidad aumentada, la visualización 3D, etc. El modelo de «aula invertida», como enfoque centrado en el estudiante, es una respuesta a la metodología de enseñanza y aprendizaje más extendida en la educación en ingeniería, que consiste en un aprendizaje instructivo basado en libros de texto organizado como conferencias, tutoriales y laboratorios, combinado con la resolución de pequeños ejercicios.

- Competencias profesionales: Reconocimiento de la creciente importancia de desarrollar competencias profesionales integradas para la empleabilidad en el siglo XXI. Esto incluye el «aprendizaje meta» para que los estudiantes identifiquen y desarrollen sus propias competencias de manera personalizada, a menudo a través de portafolios que les permitan articular su aprendizaje y trayectoria profesional. Se enfatiza la responsabilidad individual en la construcción de la trayectoria de aprendizaje, combinada con la participación en actividades colaborativas. Otro aspecto emergente en la educación en ingeniería es la creciente importancia del aprendizaje integrado de competencias profesionales. Los portafolios desempeñarán un papel fundamental en este proceso, ya que ayudarán a los estudiantes a presentar su aprendizaje a sí mismos, a sus mentores académicos y a futuros empleadores en una entrevista de trabajo.

3. La complejidad y los sistemas en la educación en ingeniería

Los desafíos del futuro requieren que los ingenieros operen en situaciones de complejidad creciente. El marco Cynefin se utiliza para clasificar las situaciones en simples, complicadas, complejas y caóticas, y prescribe diferentes enfoques para cada una:

- Simple: Comportamiento bien entendido, «mejores prácticas» definidas. Se aplica el método «sentir, categorizar y responder» (ej. fundamentos de ingeniería, problemas de examen tipo fórmula).

- Complicado: Requiere comportamiento experto, múltiples respuestas correctas. Se aplica «sentir, analizar y responder» (ej. diseño de puentes o teléfonos móviles; proyectos de diseño de estudiantes). La ingeniería de sistemas proporciona un marco estructurado.

- Complejo: No hay una solución clara o única; surgen soluciones. Se aplica «probar, sentir y responder». Estos son los «problemas complejos» (wicked problems), caracterizados por no tener una formulación definitiva, no tener una mejor solución única, no tener un punto final claro, y donde cada intento de solución impacta el sistema. El diseño de sistemas de transporte para grandes ciudades es un ejemplo.

- Caótico: Resultado de desastres, requiere acción inmediata para estabilizar antes de aplicar otros enfoques. No suelen ser el foco directo de un grado de ingeniería, excepto en la ética de la ingeniería, aprendiendo de desastres pasados.

Los currículos de ingeniería deben incluir formación para afrontar situaciones simples, complicadas y, crucialmente, complejas. Se necesitan currículos de ingeniería que incluyan la complejidad y lo complicado. Además, para educar a los estudiantes del futuro, deben tener la posibilidad de aprender tanto disciplinas específicas como la transdisciplinariedad, así como conocimientos y habilidades técnicos simples y complicados, y la complejidad que implica la comprensión del contexto, los sistemas, la sostenibilidad y los valores.

4. Modelos curriculares futuros e integrados

La evolución de las respuestas educativas muestra una transición de lo «dirigido por el profesor» a lo «dirigido por el estudiante» y de «módulos únicos» a «modelos de currículo completo».

- Cambio a nivel de sistema: Existe una tendencia emergente a diseñar currículos a nivel de sistema, coordinando todos los elementos curriculares en lugar de simplemente agregar o modificar cursos individuales. Este enfoque sistémico es crucial para el aprendizaje de la complejidad. Pero, en términos generales, definitivamente ha habido un cambio de un entorno de aprendizaje dirigido por el profesor a otro mucho más dirigido por el estudiante. Además, está surgiendo la tendencia a desarrollar currículos a nivel de sistema, lo que implica coordinar todos los elementos del currículo.

- Proyectos como núcleo: Los proyectos constituyen un elemento central en los modelos curriculares emergentes, especialmente aquellos iniciados por entidades externas (industria, comunidad). Estos proyectos permiten el desarrollo de habilidades técnicas, sociales y ambientales (comunicación, trabajo en equipo, ética, sostenibilidad) y de diseño y resolución de problemas (pensamiento de diseño, ingeniería de sistemas). También facilitan la consideración de perspectivas multidisciplinares y la comprensión de problemas en contexto, con múltiples puntos de vista y sistemas de valores.

- Ejemplos de modelos emergentes:

- University College London (UCL) – Integrated Engineering Program (IEP): Dedica una semana de cada cinco a un proyecto integrado. Esto permite a los estudiantes ver las conexiones entre diferentes módulos y disciplinas.

- Charles Sturt University (CSU): Programa radicalmente diferente con tres semestres orientados a proyectos, donde los estudiantes aprenden «justo a tiempo» a través de módulos en línea y pasan la mitad de su tiempo en proyectos. Luego realizan cuatro pasantías de un año.

- Swinburne University: Enfoque similar al de CSU, con proyectos de seis semanas patrocinados por la industria realizados en la universidad, operando como una empresa de ingeniería.

- Iron Range Engineering: Los estudiantes trabajan en proyectos de empresa y reflexionan continuamente sobre su aprendizaje.

Estos ejemplos muestran cómo las instituciones combinan el aprendizaje basado en proyectos, el aprendizaje digital/en línea y el uso de portafolios para apoyar las trayectorias de aprendizaje personalizadas.

5. Perspectivas y conclusiones

La educación en ingeniería se dirige hacia un futuro en el que la combinación de trayectorias de aprendizaje personales, competencias profesionales y capacidad de abordar la complejidad será la tendencia dominante. Esto implica lo siguiente:

- Currículos sistémicos: Es necesario un enfoque más sistémico y holístico en el diseño curricular, en lugar de modificaciones aisladas a nivel de curso. Los modelos tradicionales centrados en cursos individuales a menudo dejan la tarea de integrar el conocimiento al estudiante.

- Aprendizaje para la complejidad: La educación debe preparar a los estudiantes para manejar problemas complejos, que requieren integrar conocimientos disciplinarios e interdisciplinarios, teoría y práctica, comprensión contextual y abstracta, y construcción de conocimiento individual y colaborativa.

- Habilidades del Siglo XXI: La automatización de cálculos técnicos significa que los ingenieros futuros necesitarán comprender los requisitos sociales, ambientales y económicos de la tecnología y su aplicación.

- Aprendizaje a lo largo de la vida: Los ingenieros serán cada vez más responsables de sus propias rutas de aprendizaje personales y necesitarán saber cómo construir su crecimiento individual dentro de comunidades de aprendizaje colaborativas. El acceso al conocimiento en línea (MOOCs) aumentará, pero la clave será cómo los estudiantes desarrollan competencias para el aprendizaje a lo largo de la vida, incluida la reflexión crítica y el pensamiento sistémico, normativo y anticipatorio.

En resumen, la educación en ingeniería debe evolucionar de un enfoque basado en la transmisión de conocimientos técnicos simples a otro que fomente la capacidad de los estudiantes para navegar y resolver problemas complejos, multidisciplinares y contextualizados, preparándolos para ser aprendices activos de por vida en un mundo en constante cambio.

Referencia:

Hadgraft, R.G.; Kolmos, A. (2020). «Emerging learning environments in engineering education«, Australasian Journal of Engineering Education, 25:1, 3-16, DOI: 10.1080/22054952.2020.1713522

Glosario de términos clave

- Aprendizaje centrado en el estudiante: Un enfoque pedagógico en el que el estudiante se convierte en el centro del proceso de aprendizaje, con métodos como el aprendizaje activo, colaborativo, basado en problemas y proyectos, donde los estudiantes tienen una influencia significativa en la dirección de su aprendizaje.

- Aprendizaje contextual y basado en la práctica: Un enfoque de aprendizaje que integra situaciones del mundo real y experiencias prácticas en el currículo, incluyendo pasantías, proyectos industriales y hubs de innovación, para conectar la teoría con la futura situación laboral.

- Aula invertida (Flipped Classroom): Una metodología de aprendizaje semipresencial donde la instrucción directa se mueve de la clase a un espacio individual (generalmente en línea), y el tiempo en clase se transforma en un entorno de aprendizaje dinámico e interactivo donde el educador guía a los estudiantes a aplicar conceptos.

- CDIO (Concebir, Diseñar, Implementar, Operar): Un marco curricular para la educación en ingeniería que enfatiza el desarrollo de habilidades profesionales y un enfoque holístico e integrado del currículo, desde la concepción de una idea hasta su operación.

- Competencias profesionales: Conjunto de conocimientos, habilidades y aptitudes (tanto técnicas como genéricas, como la comunicación, el trabajo en equipo y la ética) que se espera que los ingenieros adquieran para desempeñarse eficazmente en el lugar de trabajo.

- Complejidad (en el marco Cynefin): Un dominio de situaciones donde la relación causa-efecto solo puede discernirse en retrospectiva, y las soluciones emergen del sondeo y la experimentación. Se caracteriza por problemas «perversos» sin soluciones únicas o definitivas.

- Complicado (en el marco Cynefin): Un dominio de situaciones que requieren experiencia y análisis para encontrar múltiples respuestas correctas, pero donde la relación causa-efecto es clara, aunque puede no ser obvia para todos. La resolución de problemas implica «sentir, analizar y responder».

- Cuarta Revolución Industrial (Industria 4.0): Un término que describe la tendencia actual de automatización e intercambio de datos en las tecnologías de fabricación, incluyendo sistemas ciberfísicos, el Internet de las Cosas (IoT), la computación en la nube y la inteligencia artificial (IA).

- Currículo sistémico/integral: Un enfoque de diseño curricular que coordina todos los elementos de un programa educativo a nivel de sistema, en lugar de centrarse solo en módulos o asignaturas individuales, buscando una progresión y coherencia holísticas en los resultados del aprendizaje.

- Cynefin Framework: Un modelo conceptual creado por Dave Snowden que ayuda a la toma de decisiones al categorizar los problemas en diferentes dominios (simple, complicado, complejo, caótico y desorden) basados en la naturaleza de su relación causa-efecto.

- Diseño centrado en el usuario (User Experience – UX): Se refiere a la experiencia general que tiene un usuario al interactuar con un producto o sistema. En ingeniería, implica diseñar soluciones que realmente satisfagan los requisitos del cliente, el usuario y la comunidad.

- Diseño de sistemas (Systems Design): Un enfoque estructurado para el diseño de sistemas complejos que considera las interacciones entre los componentes y el entorno, y busca satisfacer un conjunto de requisitos funcionales y no funcionales.

- Pensamiento de diseño (Design Thinking): Una metodología de resolución de problemas centrada en el ser humano que implica fases como empatizar, definir, idear, prototipar y probar, común en muchas disciplinas de diseño, incluida la ingeniería.

- Emergencia: En el contexto de los entornos de aprendizaje, se refiere a cómo las estructuras, patrones y comportamientos de aprendizaje se vuelven visibles a través de las interacciones entre elementos más pequeños, como estudiantes y recursos, indicando posibles direcciones futuras en la educación.

- Habilidades blandas/genéricas: Habilidades no técnicas pero igualmente importantes, como la comunicación, el trabajo en equipo, la ética, el pensamiento crítico y la resolución de problemas, que son aplicables en una amplia gama de contextos profesionales.

- Internet de las Cosas (IoT): Una red de objetos físicos equipados con sensores, software y otras tecnologías que les permiten conectarse e intercambiar datos con otros dispositivos y sistemas a través de Internet.

- PBL (Aprendizaje Basado en Problemas y Proyectos): Un enfoque pedagógico centrado en el estudiante donde los alumnos aprenden sobre un tema trabajando en un problema abierto o un proyecto complejo, desarrollando habilidades de resolución de problemas, trabajo en equipo e investigación.

- Portafolio: Una colección de trabajos de los estudiantes que demuestra su aprendizaje, habilidades y crecimiento a lo largo del tiempo. En ingeniería, se utiliza para articular las trayectorias de aprendizaje individuales y las competencias profesionales a mentores y futuros empleadores.

- Simple (en el marco Cynefin): Un dominio de situaciones donde la relación causa-efecto es obvia para todos, y las «mejores prácticas» pueden aplicarse. La resolución de problemas implica «sentir, categorizar y responder», como la aplicación de fórmulas fundamentales de ingeniería.

- Sostenibilidad (ODS): La capacidad de satisfacer las necesidades del presente sin comprometer la capacidad de las futuras generaciones para satisfacer sus propias necesidades. Los ODS (Objetivos de Desarrollo Sostenible) son una colección de 17 objetivos globales interconectados establecidos por las Naciones Unidas.

- Sistemas (Pensamiento sistémico): La capacidad de comprender cómo los componentes de un sistema interactúan entre sí y con el entorno para producir un comportamiento determinado, en lugar de analizar los componentes de forma aislada.

- Trayectorias de aprendizaje personalizadas: Rutas de aprendizaje adaptadas a las necesidades, intereses y aspiraciones profesionales individuales de los estudiantes, permitiéndoles configurar y documentar su propio desarrollo de competencias como parte de una estrategia de aprendizaje a lo largo de toda la vida.