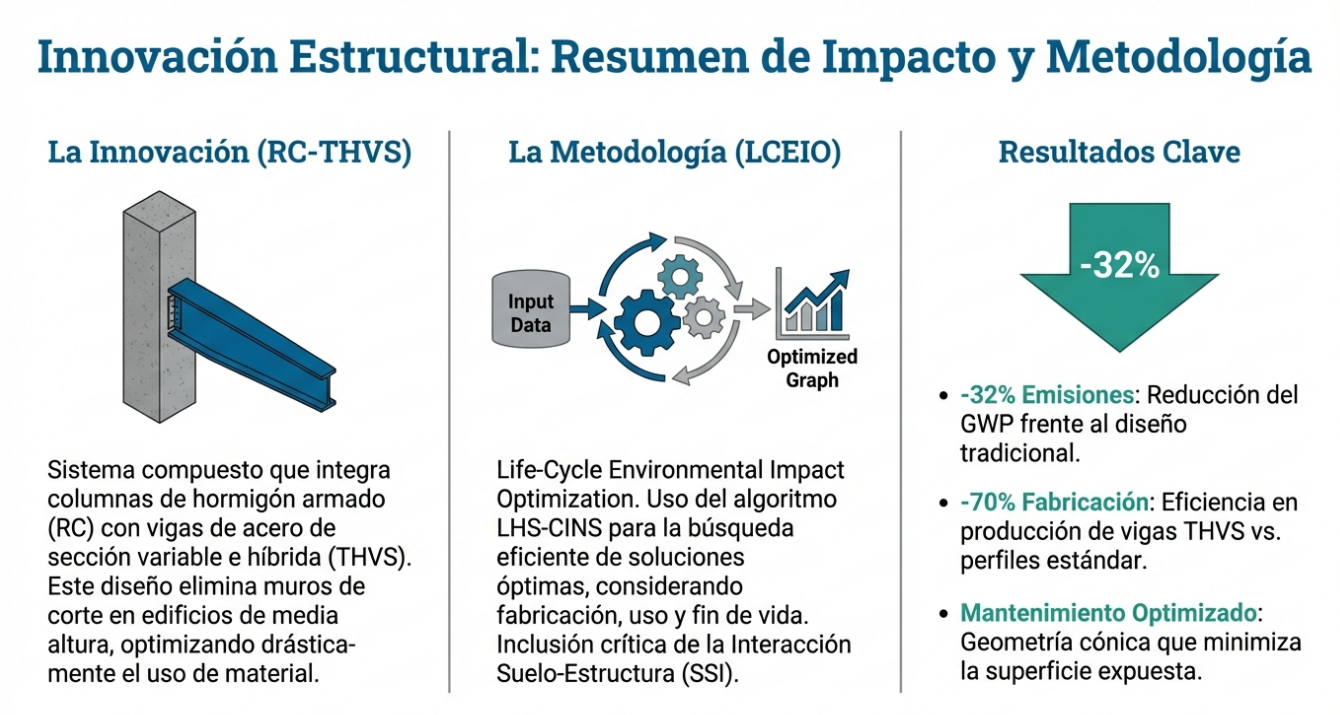

Este documento sintetiza los resultados de un estudio sobre la optimización del impacto ambiental del ciclo de vida (LCEIO) en ingeniería estructural, centrado en una tipología de estructura compuesta innovadora de hormigón armado y acero (RC-THVS) como alternativa sostenible para la construcción de edificios porticados. El sistema RC-THVS integra columnas de hormigón armado con vigas de acero híbridas de sección transversal variable (THVS).

Este documento sintetiza los resultados de un estudio sobre la optimización del impacto ambiental del ciclo de vida (LCEIO) en ingeniería estructural, centrado en una tipología de estructura compuesta innovadora de hormigón armado y acero (RC-THVS) como alternativa sostenible para la construcción de edificios porticados. El sistema RC-THVS integra columnas de hormigón armado con vigas de acero híbridas de sección transversal variable (THVS).

Los resultados clave demuestran que la aplicación de la LCEIO reduce significativamente el impacto ambiental, ya que se logra una disminución de hasta un 32 % en las emisiones de potencial de calentamiento global (GWP) en comparación con los edificios diseñados tradicionalmente. La mejora más sustancial se observa en la fase de fabricación, puesto que las vigas THVS reducen las emisiones hasta en un 70 % en comparación con los perfiles I convencionales. Además, los impactos del mantenimiento se reducen en un 45 % gracias a la geometría optimizada de las vigas.

Al comparar las soluciones optimizadas, la tipología compuesta con uniones rígidas (Comp F) supera sistemáticamente a los sistemas de hormigón armado (RC) en entornos de baja agresividad, con una reducción de aproximadamente el 30 % en las emisiones del ciclo de vida. En entornos altamente agresivos, la ventaja se mantiene, aunque disminuye al 21 % debido al mayor impacto del mantenimiento del acero. Otra ventaja del sistema RC-THVS es que reduce el peso estructural, lo que disminuye las cargas axiales en las columnas y en las cimentaciones. Cuando se integran elementos rigidizadores, como losas y muros, en la superestructura, la eficiencia del sistema aumenta y se pueden reducir las emisiones hasta en un 42 %, lo que posiciona la configuración con uniones articuladas (Comp P) como la opción óptima para grandes luces. El estudio concluye que la combinación de LCEIO y las configuraciones compuestas RC-THVS ofrece una estrategia escalable y eficiente para diseñar soluciones edificatorias más sostenibles y respetuosas con el medio ambiente.

Introducción y contexto

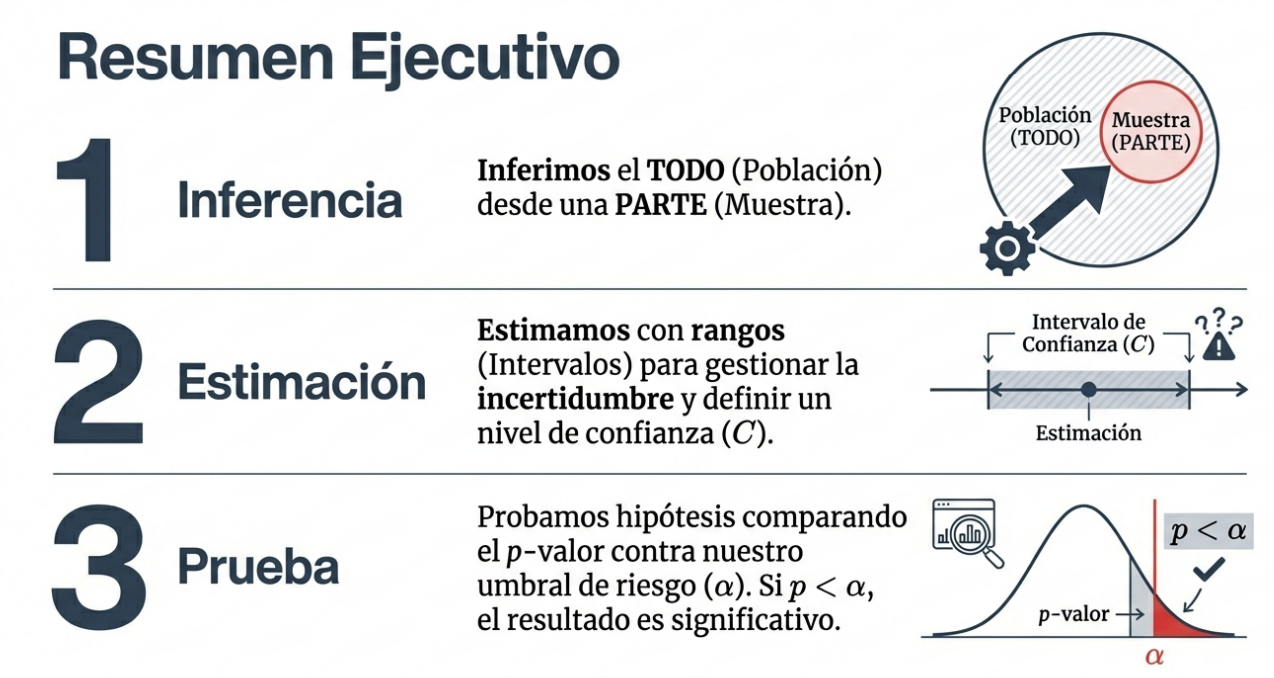

La industria de la construcción es una de las principales causantes de la degradación medioambiental, por lo que es necesario transformarla para que adopte prácticas más sostenibles. La optimización estructural surge como una herramienta esencial para este propósito, ya que automatiza el diseño, controla el tipo y la cantidad de material utilizado y fomenta tipologías innovadoras. Aunque la investigación se ha centrado tradicionalmente en la optimización de estructuras convencionales de hormigón armado, existe una necesidad creciente de integrar tipologías compuestas e híbridas en marcos de evaluación del ciclo de vida completo.

Las estructuras compuestas, que combinan materiales como el acero y el hormigón, ofrecen un mejor rendimiento estructural y una mayor sostenibilidad. Sin embargo, su integración con técnicas de optimización ha sido limitada, centrándose a menudo en componentes aislados y obviando el rendimiento a largo plazo. Este estudio aborda estas limitaciones aplicando un marco LCEIO a la nueva tipología RC-THVS y comparándola directamente con un sistema de hormigón armado convencional. La investigación tiene en cuenta factores críticos como la interacción suelo-estructura (SSI), el envejecimiento de los materiales y los escenarios de mantenimiento en diversas condiciones ambientales, y utiliza un algoritmo de optimización eficiente (LHS-CINS) para superar los altos costes computacionales asociados a las simulaciones de alta fidelidad.

Metodología de optimización

Sistemas estructurales y casos de estudio

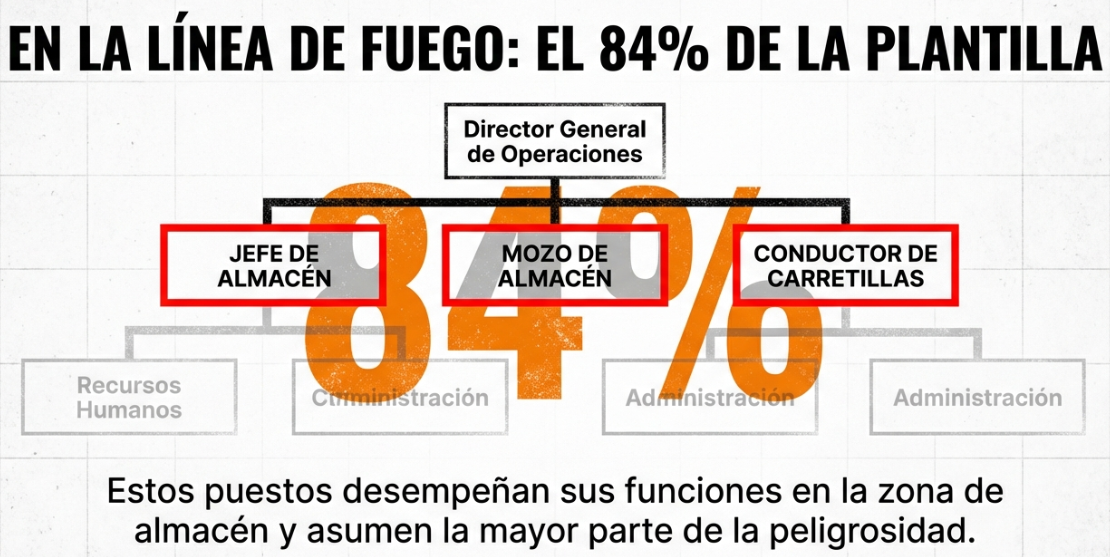

El estudio evalúa una tipología compuesta (RC-THVS) y otra tradicional de hormigón armado (RC).

- Tipología RC tradicional: compuesta por vigas, columnas y cimentaciones de hormigón armado con uniones rígidas.

- Tipología Compuesta RC-THVS: Integra columnas y cimentaciones de RC con vigas de acero THVS. Se analizan dos variantes de conexión viga-columna:

- Comp F: Conexiones rígidas.

- Comp P: Conexiones articuladas.

El rendimiento de estas tipologías se evalúa en tres casos de estudio de edificios porticados que varían en altura y en dimensiones del vano, como se muestra en la Figura 1 del documento fuente. El modelado, el análisis y el diseño se han realizado con el programa informático SAP2000 y las verificaciones de las vigas THVS se han procesado mediante una rutina personalizada en MATLAB.

| Cargas consideradas | Valor |

| Carga muerta en plantas inferiores | 4,80 kN/m² |

| Carga muerta en cubierta | 5,40 kN/m² |

| Carga viva en plantas inferiores (oficinas) | 3,00 kN/m² |

| Carga viva en cubierta | 0,80 kN/m² |

| Carga de viento extrema | Presión positiva variable de 0,92 a 1,50 kN/m², presión negativa variable de 0,50 a 0,83 kN/m². |

Formulación del problema de optimización

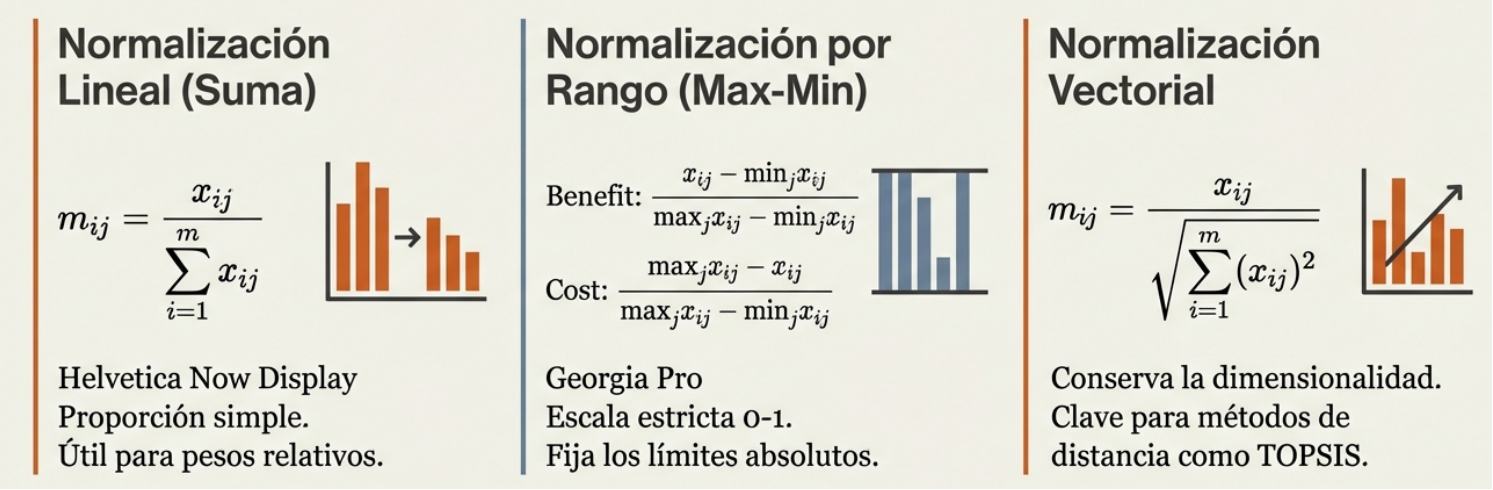

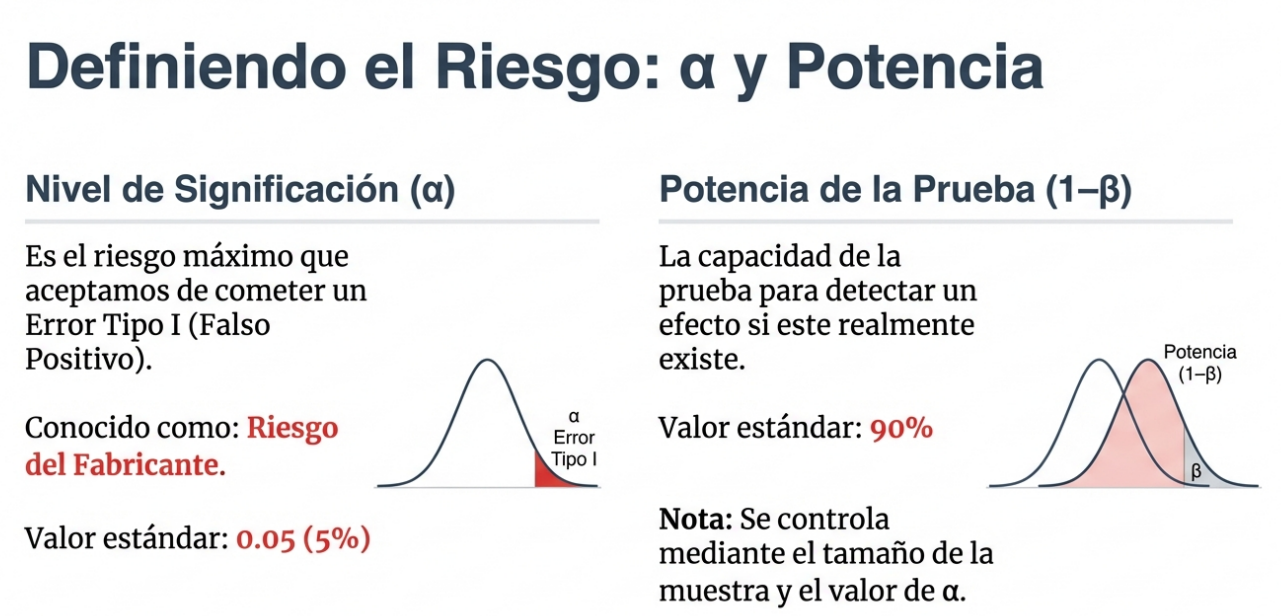

Función objetivo: impacto ambiental del ciclo de vida

La función objetivo a minimizar es el potencial de calentamiento global (GWP), medido en kg de CO₂ equivalente (kg CO₂ eq), evaluado a lo largo de un ciclo de vida de 100 años. Se consideran dos escenarios de exposición ambiental: baja agresividad y alta agresividad (marina).

GWP = Σ (elcaj × mj)

Donde elcaj es el impacto ambiental unitario de cada proceso j en cada etapa del ciclo de vida i, y mj es la medida que cuantifica dicho proceso.

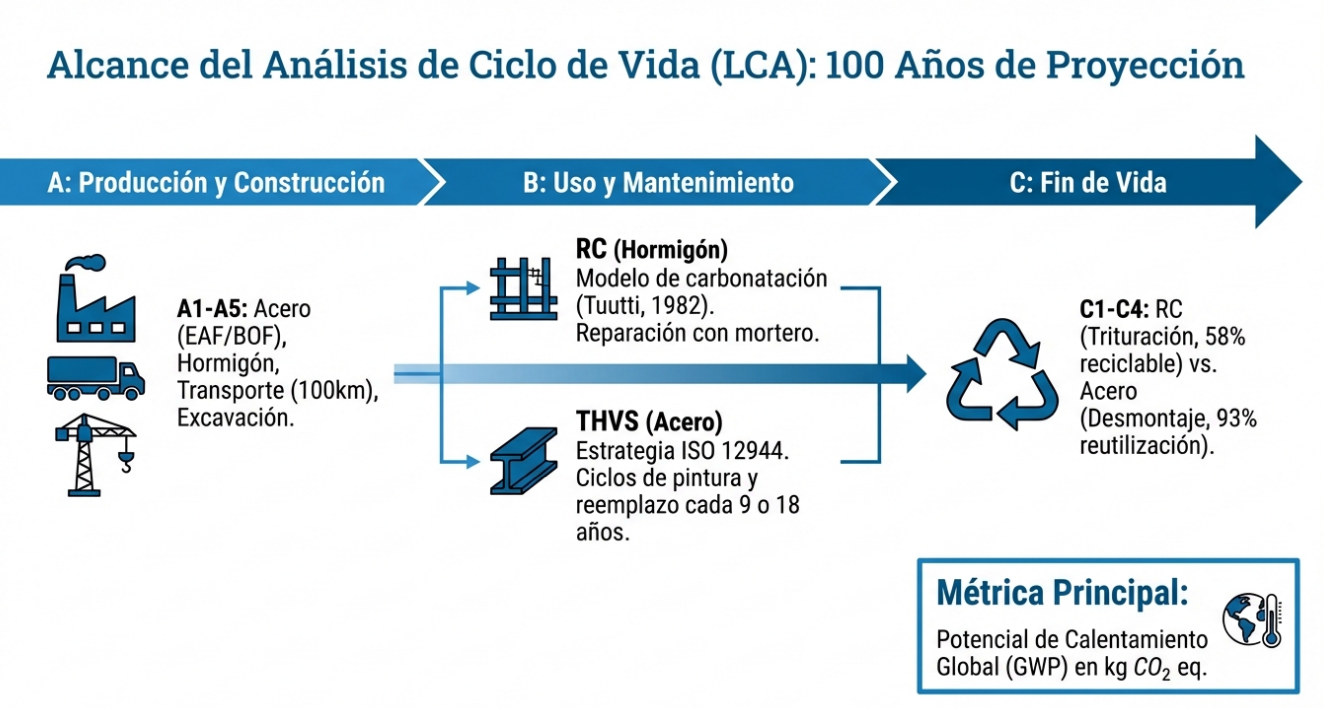

Análisis del ciclo de vida (ACV)

El ACV incluye cuatro etapas principales, modeladas con el software OpenLCA y datos de Ecoinvent v3.7.1 y BEDEC (2016):

- Fabricación: Incluye la producción de hormigón, acero de refuerzo y vigas THVS. Para estas últimas, se consideran los procesos de corte, soldadura y pintura (pintura alquídica).

- Construcción: Abarca el transporte de materiales (100 km) y el consumo de energía de la maquinaria para la manipulación, el montaje y los trabajos de cimentación (excavación y relleno).

- Uso y mantenimiento:

- Elementos RC: La vida útil se calcula con el modelo de Tuutti (1982), considerando la carbonatación y la penetración de cloruros. Las reparaciones (46,58 kg CO₂ eq/m²) se realizan si la vida útil es inferior a 100 años. Se contabiliza la absorción de CO₂ mediante la carbonatación.

- Vigas THVS: El mantenimiento se realiza conforme a la norma ISO 12944:2018. El ciclo de mantenimiento del sistema de recubrimiento protector se extiende por 18 años en entornos de baja agresividad y por 9 años en entornos de alta agresividad e incluye retoques, repintado completo y reemplazo total del recubrimiento.

- Fin de vida: Incluye la demolición, el desmontaje, la trituración del hormigón y el reciclaje. Se asume una tasa de reutilización/reciclaje del 93 %/7 % para el acero estructural y del 42 %/58 % para los elementos de RC.

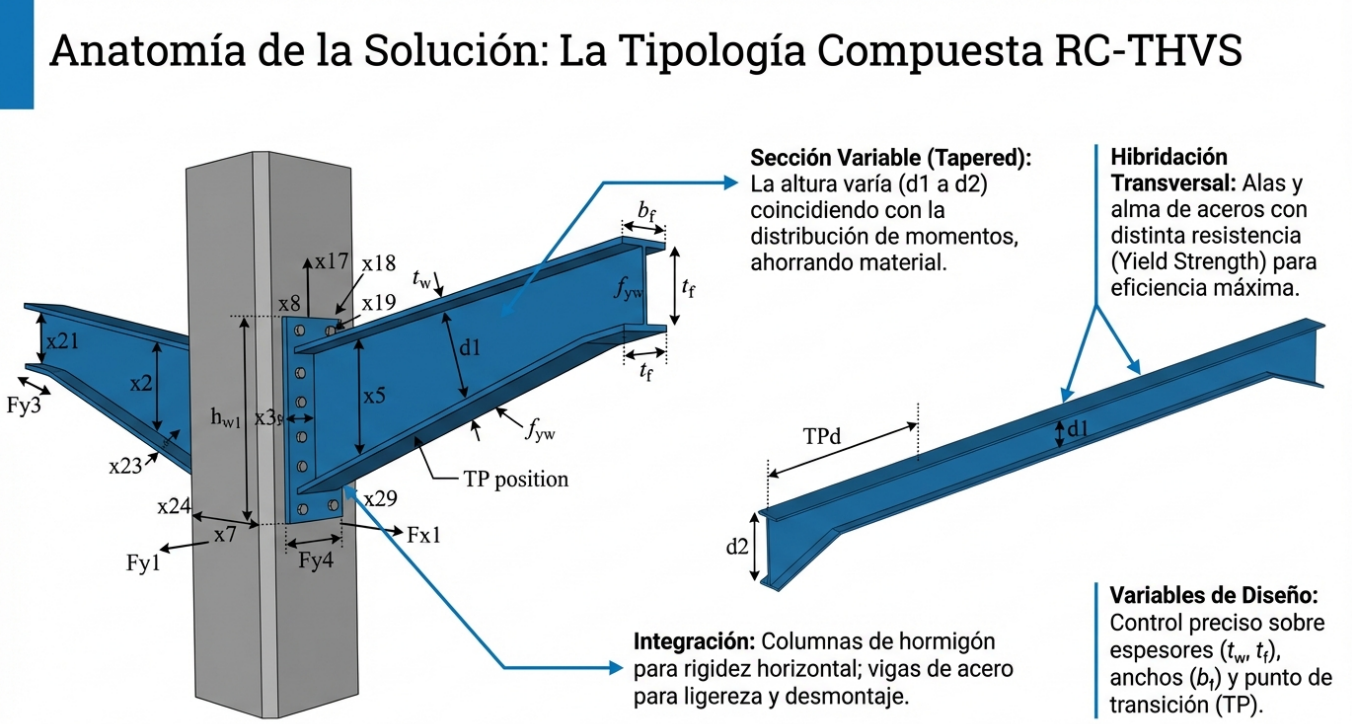

Variables de diseño

El problema de optimización utiliza variables discretas.

- Tipología RC (19 variables): dimensiones de vigas (4), dimensiones de columnas (8), rectangularidad de las cimentaciones (4) y tipo de hormigón (3).

- Tipología Compuesta (30 variables): se reemplazan las 5 variables de las vigas RC por 16 variables para las vigas THVS, que definen:

- Alturas de la sección central y de los extremos (hw1, hw2).

- Espesor del alma (tw) y de las alas (tf).

- Ancho del ala (bf).

- Posición del punto de transición (TP).

- Calidad del acero para el alma (fyw) y las alas (fyf), con 8 grados de calidad disponibles (S235 a S600).

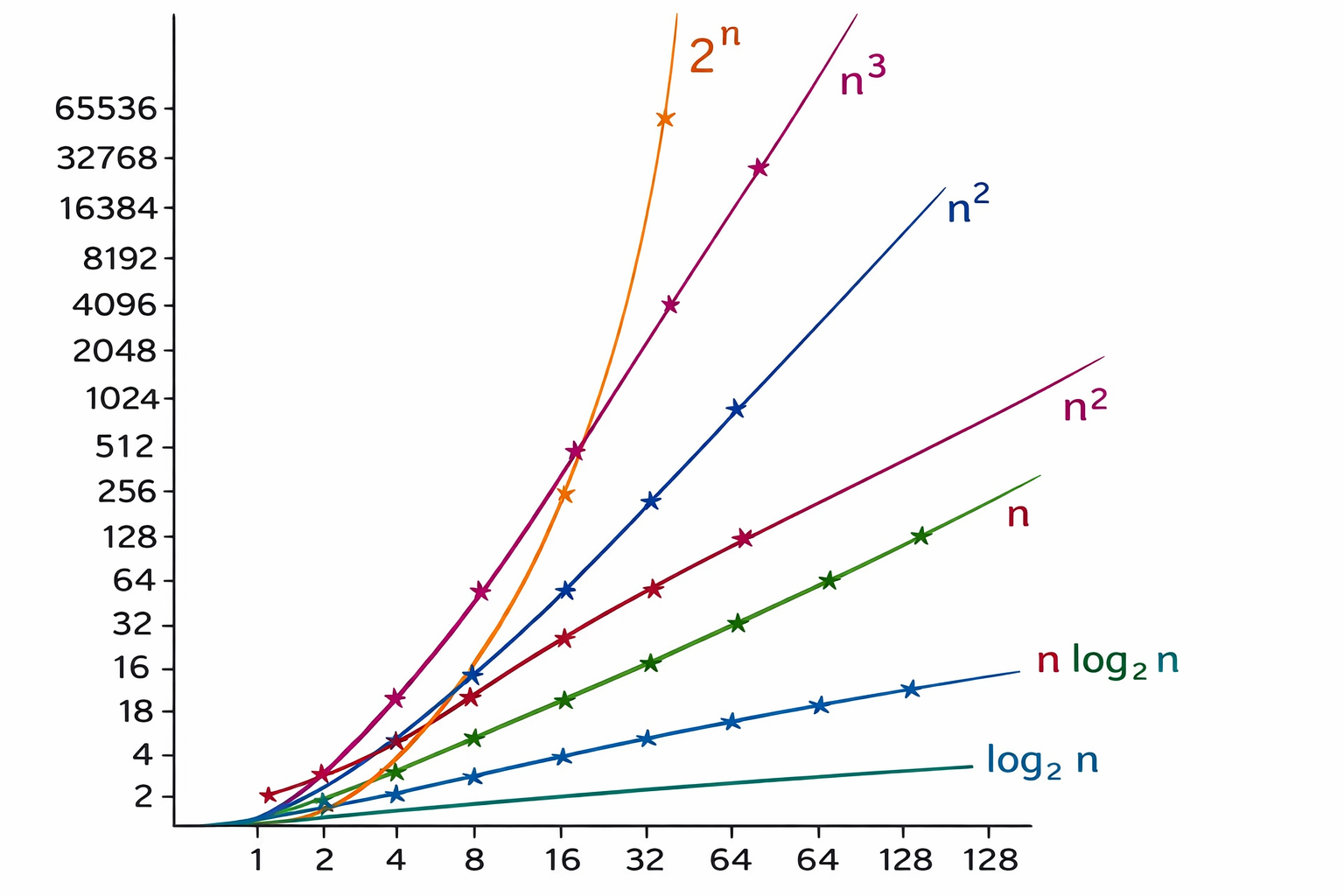

Algoritmo de solución: LHS-CINS

Para abordar el alto coste computacional de las Simulaciones de Alta Fidelidad (HFS), se utiliza un método híbrido:

- Muestreo de Hipercubo Latino (LHS): Genera un conjunto inicial de 100 soluciones bien distribuidas en el espacio de diseño.

- Muestreo Iterativo de Vecindad Restringido (CINS): Un algoritmo de búsqueda local mejorado basado en la mejor solución encontrada mediante LHS. CINS explora el vecindario de la solución actual y combina inteligentemente las mejoras para acelerar la convergencia y escapar de óptimos locales.

Esta estrategia LHS-CINS demostró ser significativamente más rápida, requiriendo un 53 % menos de HFS que los algoritmos heurísticos tradicionales, como el Biogeography-Based Optimization (BBO), para alcanzar una solución de alta calidad.

Resultados clave y análisis

Impacto de la LCEIO en el diseño

La optimización estructural reduce drásticamente el impacto ambiental en comparación con un enfoque de diseño tradicional.

- Diseños RC: La LCEIO reduce el impacto en un ~15 %.

- Sistemas compuestos: La LCEIO reduce el impacto en más del 30 % (hasta un 32 % en la configuración con uniones rígidas, Comp F).

- A nivel de elementos: Las vigas THVS optimizadas muestran una reducción del impacto entre el 47 % y el 55 % en comparación con los perfiles W de acero utilizados en el diseño tradicional.

La mayor ventaja de las vigas THVS se observa en las fases de fabricación (reducciones de hasta el 74 %) y de mantenimiento (~45 %), gracias a su eficiencia en materiales y a su geometría cónica.

Ventajas de la tipología compuesta optimizada

Entornos de baja agresividad

- Rendimiento global: La tipología Comp F es la más eficiente, reduciendo el GWP total en un 30,50 % (CS-1), un 27,17 % (CS-2) y un 27,49 % (CS-3) en comparación con la tipología RC optimizada.

- Rendimiento de las vigas: Las vigas THVS superan a las de RC, con reducciones de emisiones de ~56 % en vanos de 4 m y de ~44 % en vanos de 8 m.

- Beneficios sistémicos: La reducción del peso de las vigas THVS disminuye las emisiones de columnas (hasta un 16,31 %) y de cimentaciones (hasta un 12,12 %).

La tipología Comp P, a pesar del buen rendimiento individual de sus vigas, presenta un impacto global mayor debido a su menor rigidez, lo que se traduce en mayores solicitaciones en las columnas.

Entornos de alta agresividad

- Rendimiento global: La tipología Comp F sigue siendo superior a la RC, pero su ventaja se reduce a un promedio del 21 % (por ejemplo, un 19,65 % en CS-1 y un 14,55 % en CS-3).

- Impacto del mantenimiento: El principal factor de esta reducción es el fuerte aumento de las emisiones de mantenimiento de los elementos de acero. Para la tipología compuesta, el impacto de la fase de uso y mantenimiento pasa del 7 % al 28 % del de la fase de fabricación.

A pesar de ello, los beneficios fundamentales, como la reducción de la carga axial en las columnas (hasta un 17 %), se mantienen.

Estudio paramétrico de diseños óptimos

- Vigas THVS:

- Geometría: Las soluciones optimizadas presentan geometrías cónicas eficientes. En entornos de alta agresividad, las secciones tienden a ser más robustas para reducir la superficie expuesta y, por tanto, el impacto del mantenimiento.

- Material: Predominan las configuraciones híbridas (Rh > 1,0). Se observa una tendencia al uso de acero de menor grado (S235) para las almas de las vigas exteriores, combinado con aceros de mayor resistencia para las alas.

- Columnas y Cimentaciones:

- Columnas: Se observa una rectangularidad estratégica para mejorar la rigidez frente a las cargas de gravedad. Las columnas exteriores se diseñan con mayores dimensiones en el eje principal de flexión. Se favorece el uso de hormigón de alta resistencia (35-40 MPa) para mejorar la capacidad portante y la durabilidad.

- Cimentaciones: La mayoría de las zapatas tienden a ser cuadradas o de baja rectangularidad. Se prefiere el uso de hormigón de menor impacto ambiental (25 MPa), ya que no está expuesto a la carbonatación y sus solicitaciones son principalmente de flexión.

Influencia de elementos rigidizadores adicionales

La inclusión de losas de 12 cm y muros de mampostería en el modelo estructural mejora significativamente el rendimiento de las tipologías compuestas, mitigando la desventaja de la menor rigidez del pórtico.

- Tipología Comp P: Se beneficia enormemente, con una reducción del impacto total de casi el 42 % en CS-2. Para edificios de grandes vanos (CS-3), la tipología Comp P resulta la solución óptima, con una reducción del GWP superior al 30 %.

- Tipología Comp F: Mantiene su ventaja en edificios de vanos pequeños, aunque con mejoras más modestas.

Estos resultados indican que, para pórticos desnudos, las tipologías compuestas pueden ser un 25-30 % menos contaminantes, y esta cifra puede aumentar al 40-50 % en edificios donde todos los componentes contribuyen a la rigidez global.

Discusión y perspectivas futuras

El estudio confirma que el uso de algoritmos de inteligencia artificial como herramientas de diseño supera a los enfoques tradicionales, logrando reducciones globales de impacto de más del 30 %. La tipología compuesta RC-THVS con uniones rígidas se establece como una solución superior en la mayoría de los escenarios, no solo por la eficiencia de las vigas, sino también por los beneficios en cascada en las columnas y las cimentaciones.

El análisis paramétrico revela cómo el algoritmo de optimización equilibra el rendimiento inicial con la durabilidad a largo plazo, por ejemplo, seleccionando aceros de mayor calidad en el alma para reducir el área de superficie expuesta y las futuras demandas de mantenimiento.

Líneas de investigación futuras:

- Robustez estructural: Aplicar la optimización para mejorar la resistencia al colapso progresivo o al fuego.

- Configuraciones complejas: Extender el marco a edificios de gran altura o con plantas irregulares y evaluar el comportamiento bajo escenarios multi-riesgo (sismos, fuego).

- Soluciones alternativas: Utilizar la plataforma de optimización para explorar otros sistemas, como vigas híbridas con aberturas en el alma o sistemas de madera de ingeniería.

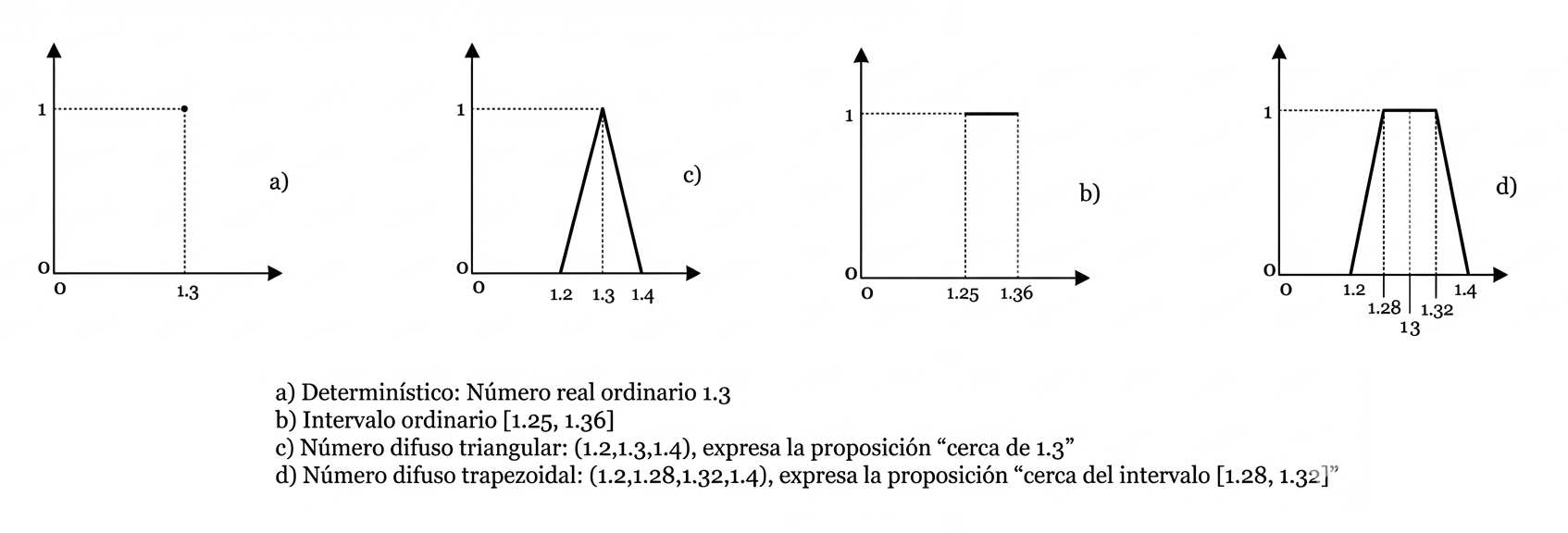

- Precisión del modelo ACV: Incorporar enfoques basados en la incertidumbre (p. ej., optimización basada en la fiabilidad) para modelar la variabilidad de las tasas de degradación, las propiedades de los materiales y los intervalos de mantenimiento.

- Optimización multiobjetivo: Formular problemas que aborden simultáneamente la constructibilidad, la seguridad y el impacto ambiental.

Conclusiones finales

La aplicación de la Optimización del Impacto Ambiental del Ciclo de Vida (LCEIO) a la tipología compuesta RC-THVS aporta beneficios sustanciales para la construcción sostenible de edificios porticados.

- Reducción significativa del impacto: Los sistemas compuestos optimizados reducen el impacto del ciclo de vida hasta en un 32 % en comparación con diseños convencionales, con reducciones de hasta el 70 % en la fase de fabricación y del 45 % en la de mantenimiento.

- Superioridad sobre el hormigón armado: En comparación con los sistemas de RC optimizados, la configuración compuesta con uniones rígidas logra una reducción de emisiones del 30 % en entornos de baja agresividad y mantiene una ventaja del 21 % en entornos de alta agresividad.

- Eficiencia sistémica: Las vigas THVS, al reducir el peso estructural, disminuyen las solicitaciones y el impacto ambiental de las columnas y las cimentaciones.

- Flexibilidad de diseño: La inclusión de elementos rigidizadores, como losas y muros, puede hacer que la configuración con uniones articuladas sea la más sostenible para edificios de grandes vanos, lo que demuestra la adaptabilidad del sistema.

En conjunto, los hallazgos confirman que la combinación de LCEIO con la tipología RC-THVS representa una alternativa altamente sostenible y eficiente frente a los pórticos tradicionales de hormigón armado.

Referencia:

NEGRÍN, I.; KRIPKA, M.; YEPES, V. (2025). Life-cycle environmental impact optimization of an RC-THVS composite frame for sustainable construction. Engineering Structures, 345, 121461. DOI:10.1016/j.engstruct.2025.121461 Featured Paper Award

Como se trata de un artículo publicado en abierto, os dejo un enlace para su descarga.

1-s2.0-S0141029625018528-main (3)

Esta obra está bajo una licencia de Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0 Internacional.