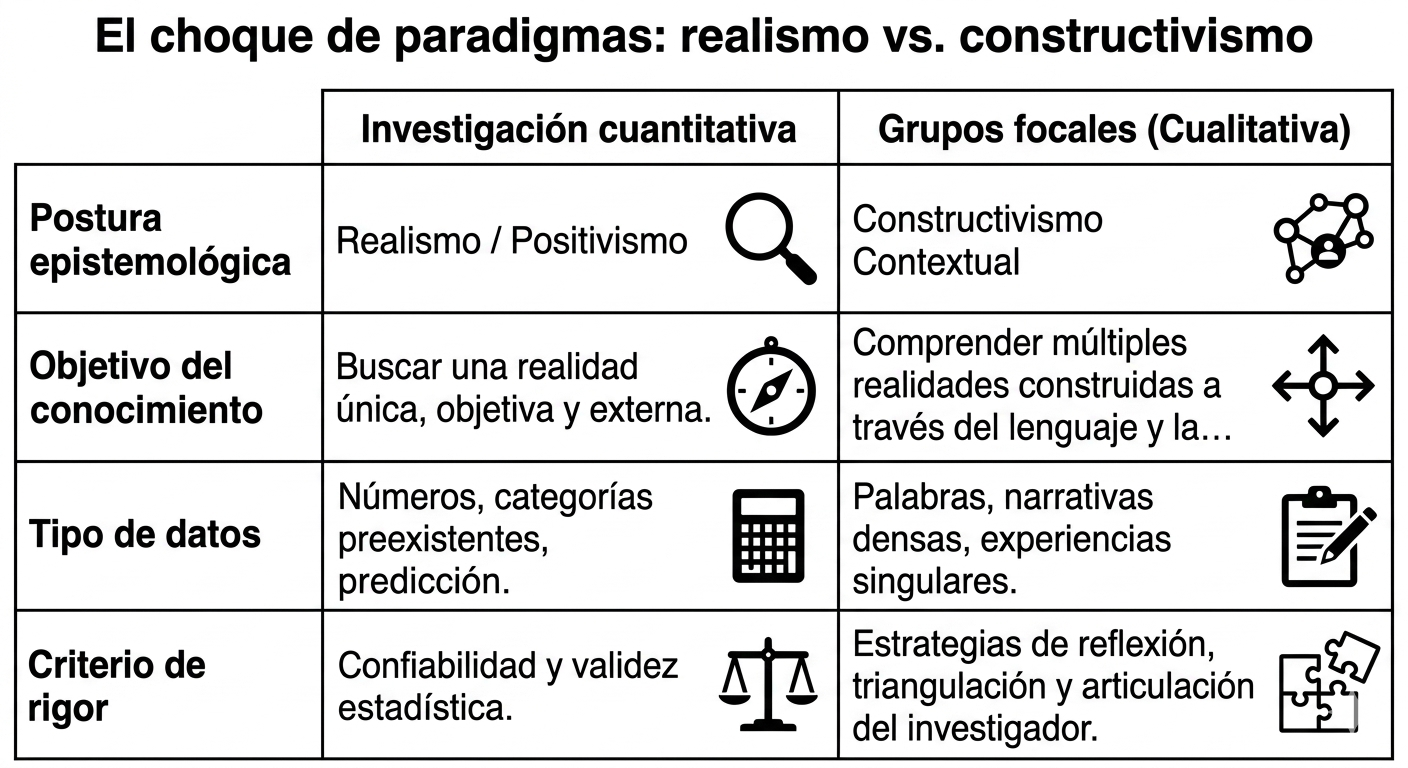

¿Por qué, a pesar de tener todas las estadísticas y los gráficos sobre la mesa, a veces fracasamos en nuestro intento de entender el comportamiento humano? En una era obsesionada con el Big Data, tendemos a olvidar que los números solo muestran una parte de la realidad. Las decisiones estratégicas, desde la optimización de un servicio oncológico hasta el cambio de modelo de negocio, exigen descifrar el «porqué» que se esconde detrás de cada dato. Aquí es donde surgen los grupos focales, no como un trámite académico árido, sino como una ventana táctica a la subjetividad. Esta técnica capta cómo piensan, sienten y viven las personas a través de la interacción grupal y revela verdades incómodas o sutiles que una encuesta estandarizada no puede detectar. No se trata solo de recopilar información, sino de ponerse en la piel del otro para transformar la gestión organizativa.

¿Por qué, a pesar de tener todas las estadísticas y los gráficos sobre la mesa, a veces fracasamos en nuestro intento de entender el comportamiento humano? En una era obsesionada con el Big Data, tendemos a olvidar que los números solo muestran una parte de la realidad. Las decisiones estratégicas, desde la optimización de un servicio oncológico hasta el cambio de modelo de negocio, exigen descifrar el «porqué» que se esconde detrás de cada dato. Aquí es donde surgen los grupos focales, no como un trámite académico árido, sino como una ventana táctica a la subjetividad. Esta técnica capta cómo piensan, sienten y viven las personas a través de la interacción grupal y revela verdades incómodas o sutiles que una encuesta estandarizada no puede detectar. No se trata solo de recopilar información, sino de ponerse en la piel del otro para transformar la gestión organizativa.

Un origen inesperado: de la propaganda de guerra a la empatía moderna.

Aunque hoy los asociamos con el marketing o la salud, los grupos focales surgieron de una necesidad estratégica de supervivencia. La técnica, originalmente bautizada como «entrevista focal» (Merton, 1987), fue desarrollada en la década de los cuarenta en la Universidad de Columbia por Paul Lazarsfeld y Robert Merton. Su objetivo inicial era analizar las respuestas de la audiencia ante la propaganda y las transmisiones de radio durante la Segunda Guerra Mundial.

Resulta fascinante observar que, a pesar de su potencial, la técnica fue prácticamente ignorada en la investigación académica formal hasta finales de la década de 1970, un período de «renacimiento» en el que se comprendió que lo que servía para el control de masas podía ser la herramienta definitiva para la empatía. Lo que comenzó como un instrumento para analizar la propaganda evolucionó hacia una metodología para «dar voz» al ciudadano, lo que permitió humanizar sistemas que, de otro modo, habrían permanecido ciegos al factor humano.

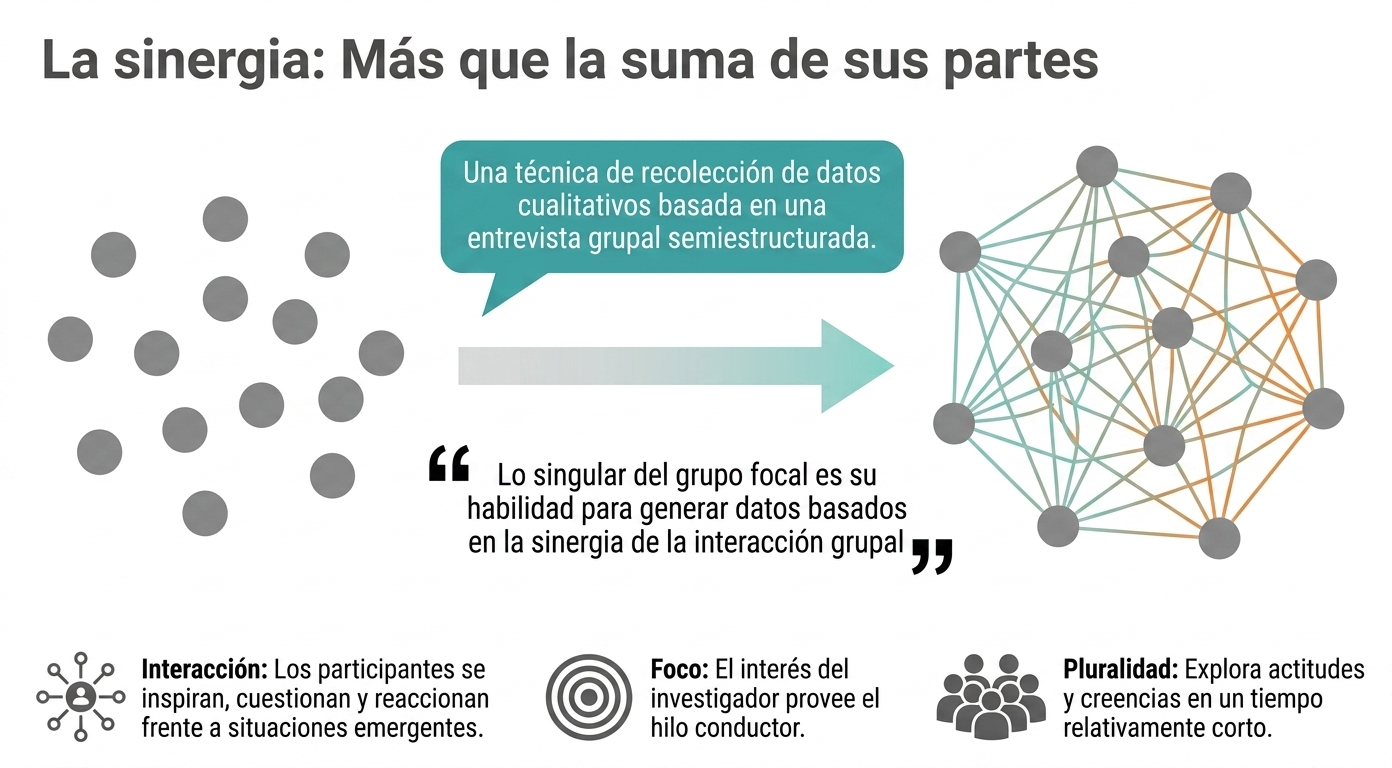

La «sinergia»: cuando 1 + 1 es mucho más que 2.

A diferencia de la entrevista individual, el grupo focal es un método colectivista. Su valor estratégico no radica en la suma de opiniones, sino en la energía que el grupo genera. La interacción actúa como un catalizador: un comentario ajeno activa recuerdos, las inhibiciones se disuelven y surgen temas tabú que nadie se atrevería a mencionar en soledad.

«El grupo focal es un método de investigación colectivista, más que individualista, que se centra en la pluralidad y la variedad de las actitudes, experiencias y creencias de los participantes en un tiempo relativamente corto». — Martínez-Miguélez.

Nota de rigor técnico: es vital distinguir entre método y técnica. El método es el proceso macro para alcanzar una meta, mientras que el grupo focal es, técnicamente, una técnica: un conjunto específico de directrices y recursos diseñados para llevar a cabo una estrategia de escucha profunda.

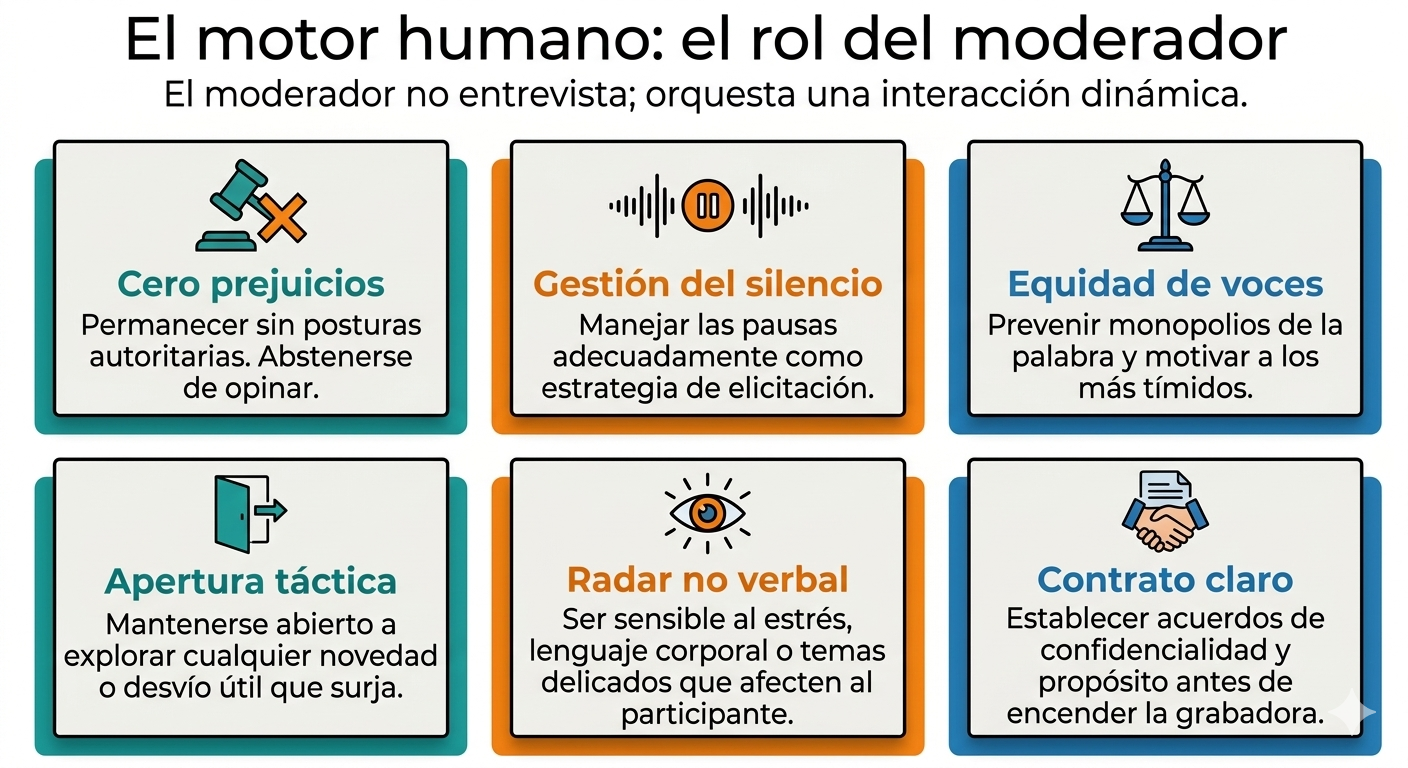

El moderador: un director de orquesta invisible.

El éxito de esta técnica no depende de los participantes, sino de la habilidad del moderador. No es una autoridad, sino un facilitador que convierte la amabilidad en una herramienta técnica de precisión.

Habilidades tácticas de moderación:

- Manejo del silencio: entender el vacío no como un error, sino como una invitación para que el participante profundice en sus ideas.

- Cuidado de las relaciones interpersonales: exigencia técnica orientada a generar seguridad psicológica y a obtener datos auténticos.

- Ausencia de posturas autoritarias: el moderador debe «focalizar» la conversación sin sesgarla con sus propios prejuicios, manteniendo una escucha activa y sensible.

- Sencillez lingüística: adaptar el registro al «mundo de vida» del entrevistado para eliminar barreras jerárquicas.

El «número mágico» y el límite del cansancio.

Para que la sinergia no se convierta en caos, la logística debe ser milimétrica. La eficiencia operativa de un grupo focal se rige por estas reglas de oro:

- Participantes: el rango ideal es de 6 a 10 colaboradores. Con menos de seis, se limita el pensamiento colectivo; con más de diez, se diluye la profundidad y se complica la labor del moderador.

- Duración óptima: entre 60 y 90 minutos. Este es el tiempo necesario para crear un clima de confianza y agotar la hoja de ruta (questioning route).

- El límite crítico: las dos horas, que marcan el «límite físico y psicológico». Superar este umbral genera fatiga cognitiva y reduce la calidad y la veracidad de los testimonios.

Del caos al orden: el desafío de analizar la subjetividad.

Convertir las horas de conversación en hallazgos aplicables requiere un rigor metodológico casi artesanal. El análisis no es una cuestión de intuición, sino un proceso de triangulación en el que se «tejen» los testimonios con teorías previas y marcos bibliográficos para otorgar validez científica a la subjetividad.

El proceso se divide en dos niveles críticos de codificación:

- Codificación abierta: exploración inicial de los datos para crear conceptos y categorías desde cero (descubrimiento).

- Codificación axial: identificación de conexiones y relaciones lógicas entre los códigos creados (la estructura).

Fases del análisis temático:

- Familiarización: Inmersión total en las transcripciones literales.

- Generación de códigos: Etiquetado de conceptos clave.

- Búsqueda de temas: Agrupación de códigos en patrones de significado.

- Revisión: Asegurar que los temas representen fielmente el diálogo original.

- Definición: Refinar la esencia de cada categoría.

- Redacción: Construcción de una narrativa coherente que responda a los objetivos estratégicos.

Conclusión: un futuro basado en la escucha.

En un mundo saturado de algoritmos e inteligencia artificial, la herramienta más disruptiva sigue siendo la conversación humana dirigida. Implementar una cultura de escucha activa mediante grupos focales no es un lujo académico, sino una ventaja competitiva que humaniza las organizaciones y valida la experiencia individual.

¿Cómo cambiaría su entorno laboral si, por un momento, silenciara los cuadros de mando de datos para crear un espacio diseñado solo para escuchar? En última instancia, el valor de la subjetividad es que nos permite ver aquello que los números, por sí solos, prefieren callar.

En esta conversación podéis escuchar las ideas más interesantes sobre esta técnica de investigación cualitativa.

Este vídeo resume bien los principales conceptos de los grupos focales.

Esta obra está bajo una licencia de Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0 Internacional.