¿Cuáles son los objetivos principales del mantenimiento de la maquinaria y cómo se clasifica?

¿Cuáles son los objetivos principales del mantenimiento de la maquinaria y cómo se clasifica?

El mantenimiento de la maquinaria de construcción tiene como objetivos fundamentales maximizar su disponibilidad al mínimo coste, optimizar su rendimiento y garantizar unas condiciones óptimas de operatividad y seguridad. Esto se traduce en la reducción de costes debidos a paradas accidentales, minimizando las pérdidas de producción y los gastos propios del mantenimiento, así como en la limitación del deterioro de la maquinaria para evitar la disminución de la calidad del producto.

Las tareas de mantenimiento se clasifican en niveles según la importancia de la obra y sus misiones específicas. Por ejemplo, en una empresa constructora típica, el primer escalón (conductoras y conductores) se encarga del mantenimiento diario, semanal o quincenal (limpieza, repostaje, engrase y reparaciones de urgencia). El segundo escalón (equipos de obra) se encarga del mantenimiento mensual, trimestral o semestral, que incluye revisiones, ajustes ligeros y localización de averías. Los escalones superiores (el tercero y el cuarto, talleres móviles y fijos) se dedican a reparaciones más complejas, a la sustitución de piezas y a grandes reconstrucciones.

¿Qué tipos de políticas de mantenimiento existen y cuál es el más beneficioso a largo plazo?

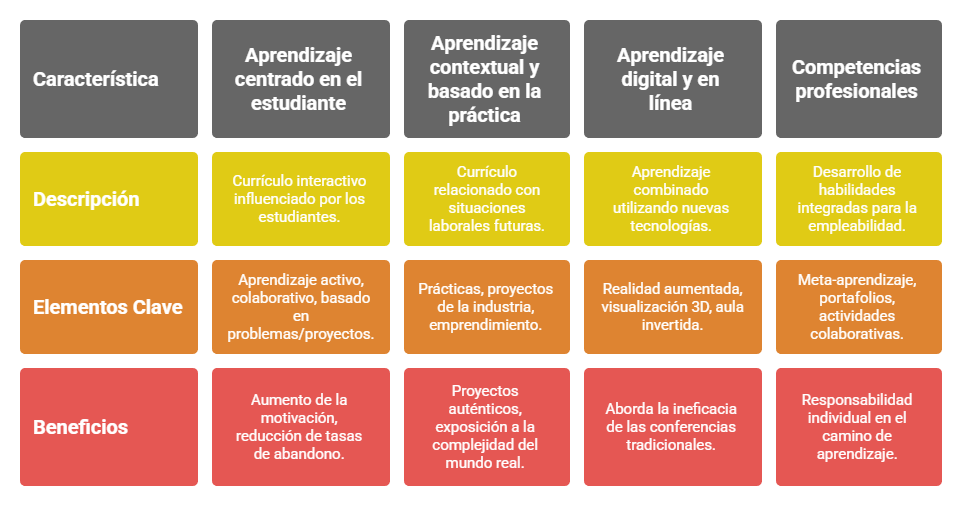

No existe una clasificación rígida de los sistemas de mantenimiento y cada empresa debe elegir el más adecuado para cada máquina. Sin embargo, pueden clasificarse principalmente en:

- Corrección por avería: Se permite que los equipos funcionen hasta que fallen, y luego se reparan lo antes posible. Aunque a corto plazo puede parecer económico, a medio y largo plazo puede generar costes elevados debido a la imposibilidad de programar las paradas y al riesgo de fallos graves, lo que disminuye la eficiencia del servicio. Solo se justifica en contadas ocasiones o cuando se trata de muchas máquinas iguales y hay capacidad de sobra.

- Mantenimiento rutinario: Se establecen instrucciones generales para el mantenimiento de grupos homogéneos de máquinas, basado en la experiencia, para prevenir fallos. Es de bajo costo y puede resolver muchas averías antes de que ocurran.

- Mantenimiento preventivo planificado: Se establecen ciclos de revisiones y sustituciones de componentes importantes según las instrucciones del fabricante y el uso de la máquina. Esto permite registrar averías y prever la vida útil de los elementos. Aunque es más costoso a corto plazo, resulta más ventajoso a medio y largo plazo, ya que permite programar los tiempos de inactividad y evitar fallos catastróficos, lo que aumenta la eficacia general. El objetivo es reparar antes de que se produzca una avería importante, lo que resulta más rápido y económico.

En resumen, el mantenimiento preventivo planificado es el más ventajoso a medio y largo plazo, ya que permite anticiparse a los problemas, reducir los costes y los tiempos de reparación, y aumentar la eficacia del servicio.

¿Cómo se distribuye el tiempo de permanencia de una máquina en obra y qué implicaciones tiene para los costos?

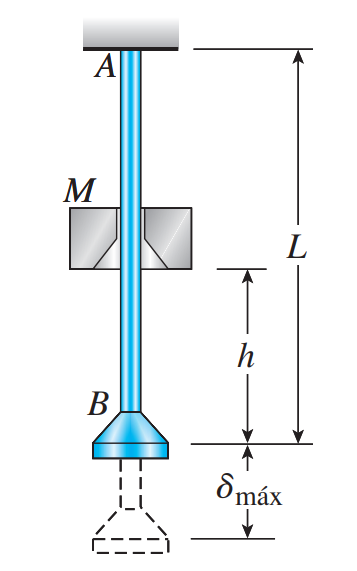

El tiempo que una máquina permanece en obra se divide en varias categorías, lo que afecta directamente el costo horario y la producción.

- Tiempo de calendario laborable (fondo horario bruto): Horas reconocidas por la legislación laboral y la organización para trabajar.

- Tiempo laborable real (fondo horario operacional): Horas de presencia efectiva de la máquina en obra, descontando circunstancias fortuitas como fenómenos atmosféricos, huelgas o catástrofes. Incluye horas extraordinarias.

- Tiempo de máquina en disposición (fondo horario de explotación): Horas en las que la máquina está operativa y lista para trabajar, excluyendo paradas menores a 15 minutos.

- Tiempo fuera de disposición: Horas en las que la máquina no está operativa, divididas en:

- Mantenimiento: Tareas previsibles.

- Averías: Reparaciones imprevisibles.

- Parada por organización de obra: Tiempo de inactividad por causas ajenas a la máquina (falta de tajo, suministros, averías de otras máquinas, etc.).

- Tiempo de trabajo útil: Horas netas donde la máquina produce, incluyendo trabajo productivo y trabajo no productivo o complementario.

Esta distribución temporal implica que el coste horario de una máquina varía en función de la referencia. Para el propietario, el coste se evalúa en relación con la hora de utilización, mientras que, en el caso de un alquiler, se refiere a la hora laborable real. Ampliar la jornada laboral para aumentar las horas útiles puede disminuir el coste horario fijo y acortar los plazos, pero hay que sopesarlo con inconvenientes como el aumento de costes por horas extra del operario, su fatiga y la dilución de responsabilidades si hay varios conductores, lo que puede incrementar las averías.

¿Cómo se calcula la fiabilidad de un equipo de construcción y cuáles son las fases de su vida útil según la «curva de la bañera»?

La fiabilidad se define como la probabilidad de que una unidad funcione correctamente en un intervalo de tiempo determinado sin interrupciones debidas a fallos de sus componentes, en condiciones establecidas. Está relacionada con el tiempo medio entre fallos (TMEF), que es la relación entre las horas de funcionamiento y el número de averías sufridas en ese período.

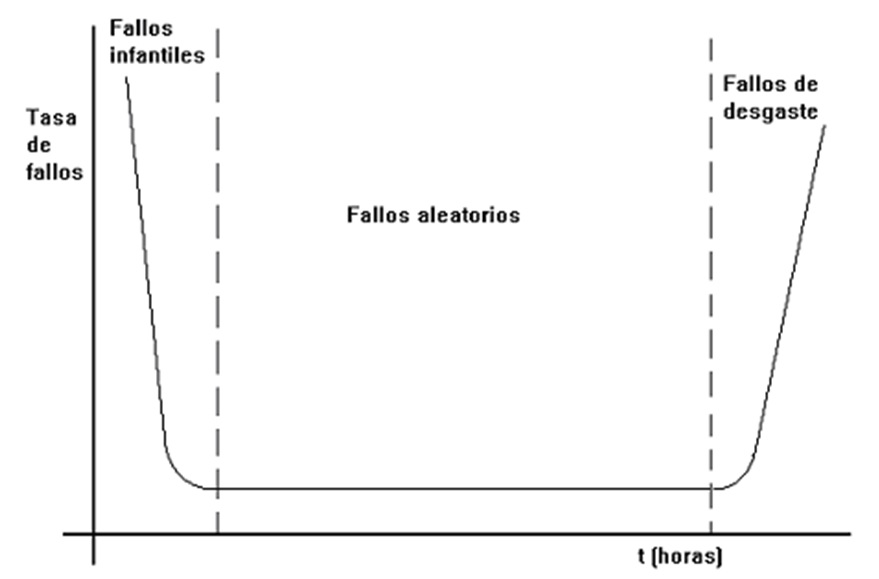

La «curva de la bañera» describe la evolución de la tasa de fallos de una máquina a lo largo del tiempo y se divide en tres fases:

- Período de mortalidad infantil o fallos prematuros: Caracterizado por una alta tasa de fallos que disminuye rápidamente. Las causas suelen ser errores de diseño, fabricación o uso. Estos fallos ocurren en la fase de rodaje y, una vez resueltos, no suelen repetirse.

- Período de tasa de fallos constante o vida útil: Los fallos aparecen de forma aleatoria y accidental, debidos a limitaciones de diseño, percances por uso o mal mantenimiento. Es el período ideal de utilización de la máquina.

- Período de desgaste: La tasa de fallos aumenta con el tiempo debido a la vejez y el fin de la vida útil. En esta fase, se recomienda el reemplazo preventivo de componentes o incluso la renovación completa del equipo para evitar incidentes catastróficos.

Para alargar su vida útil, se puede aplicar el envejecimiento preventivo (funcionamiento preliminar para detectar fallos prematuros) y la sustitución preventiva (reemplazo de unidades al finalizar su vida útil para evitar fallos).

¿Cómo se modela la fiabilidad de una máquina y qué técnicas de prevención de fallos se utilizan en el diseño?

La fiabilidad de una máquina puede modelarse mediante la distribución exponencial cuando la tasa de fallos es constante durante el período de vida útil. Esto implica que la ocurrencia de un fallo es imprevisible e independiente de la vida útil del equipo. Una generalización de este modelo es la función de Weibull, que se utiliza cuando la tasa de fallos es variable y permite tener en cuenta las fases de fallos precoces y de envejecimiento.

En lo que respecta a las técnicas de prevención de fallos en el diseño de equipos, las empresas se centran en maximizar la fiabilidad del producto. Algunas metodologías clave son:

- Despliegue de la Función de Calidad (QFD): Permite traducir los requisitos de calidad del cliente en características técnicas del producto, utilizando matrices para analizar necesidades, competencia y nichos de mercado.

- Análisis Modal de Fallos y Efectos (AMFE): Una metodología estructurada para identificar y prevenir modos de fallo potenciales y sus causas en un producto o sistema.

- Análisis del valor: Busca reducir el coste del producto sin eliminar las características esenciales demandadas por los clientes, identificando cambios que aumenten el valor sin un incremento desproporcionado del coste.

¿Cómo influyen las condiciones climáticas y otros imprevistos en la planificación del tiempo de trabajo en una obra de construcción?

Las condiciones climáticas y otros imprevistos son factores cruciales que influyen en el plazo de ejecución de una obra. La planificación del tiempo de trabajo disponible se basa en datos históricos del clima y en el calendario laboral.

El método de la Dirección General de Carreteras, por ejemplo, utiliza coeficientes de reducción aplicados al número de días laborables de cada mes para estimar los días efectivamente trabajados. Estos coeficientes tienen en cuenta:

- Temperatura límite: Por debajo de la cual no se pueden ejecutar ciertas unidades de obra (ej., 10 ºC para riegos bituminosos, 5 ºC para mezclas bituminosas, 0 ºC para manipulación de materiales húmedos).

- Precipitación límite diaria: Se definen valores como 1 mm/día para trabajos sensibles a lluvia ligera y 10 mm/día para la mayoría de los trabajos, donde una protección especial sería necesaria.

Los días utilizables netos de cada mes se calculan multiplicando los días laborables por los coeficientes reductores por climatología adversa y por los días no laborables, que dependen de festivos y convenios laborales. La reducción de días representa la probabilidad de que un día del mes sea favorable desde el punto de vista climático y laborable. Estos cálculos permiten elaborar un plan de obra lo más ajustado posible, minimizando las desviaciones de plazo, aunque la evolución del tiempo atmosférico es impredecible en la práctica.

¿Qué se entiende por «disponibilidad» de una máquina en obra y cómo se calcula?

La disponibilidad de una máquina se refiere a su estado operativo, es decir, al tiempo en el que se encuentra disponible. Se pueden distinguir dos tipos principales de disponibilidad:

- Disponibilidad en obra o factor de disponibilidad: Se define como el cociente entre el tiempo en que una máquina se encuentra en estado operativo y el tiempo laborable real. En otras palabras, es la relación entre las horas brutas de disponibilidad y las horas que la máquina ha estado presente en la obra. Valores bajos de este factor pueden indicar una mala conservación, reparaciones lentas o falta de repuestos.

- Disponibilidad intrínseca: Se define como el cociente entre el tiempo de utilización y el tiempo laborable real, sin tener en cuenta las paradas ajenas a la máquina por tiempo disponible no utilizado (mala organización de la obra, etc.). Estadísticamente, se define como la probabilidad de que una máquina funcione correctamente en un momento determinado o de que no presente averías irreparables en un tiempo máximo.

Las máquinas se clasifican en «principales» (se requiere alta disponibilidad, ya que su fallo paraliza la producción de un conjunto de máquinas) y «secundarias» o «de producción trabajando solas».

¿Cómo se calcula la disponibilidad de un conjunto de máquinas trabajando en cadena y en paralelo?

La disponibilidad de un sistema de máquinas varía significativamente en función de si trabajan en serie o en paralelo.

- Máquinas trabajando en cadena (serie): Si n máquinas trabajan en cadena, y el fallo de una paraliza a las demás, la disponibilidad intrínseca del conjunto es el producto de las disponibilidades individuales. Esto significa que la disponibilidad general disminuye rápidamente al aumentar el número de máquinas en serie. Si se admiten acopios intermedios suficientemente grandes, la disponibilidad del equipo sería el mínimo de las disponibilidades individuales, lo que amplía la disponibilidad respecto a no tener acopios.

- Máquinas trabajando en paralelo: Si n máquinas iguales trabajan en paralelo y la inoperatividad de una no detiene completamente el proceso (ya que otras pueden seguir trabajando), la probabilidad de que x máquinas se encuentren en disposición sigue una distribución binomial. En este caso, la disponibilidad del conjunto aumenta al tener más unidades en paralelo, ya que el sistema puede continuar operando incluso si algunas máquinas fallan.

En un caso general de máquinas principales en paralelo y auxiliares en paralelo que luego trabajan en serie, la disponibilidad del conjunto se calcula combinando las fórmulas de disponibilidad en serie y en paralelo.

Referencias:

PELLICER, E.; YEPES, V.; TEIXEIRA, J.C.; MOURA, H.P.; CATALÁ, J. (2014). Construction Management. Wiley Blackwell, 316 pp. ISBN: 978-1-118-53957-6.

YEPES, V. (1997). Equipos de movimiento de tierras y compactación. Problemas resueltos. Colección Libro Docente nº 97.439. Ed. Universitat Politècnica de València. 256 pág. Depósito Legal: V-4598-1997. ISBN: 84-7721-551-0.

YEPES, V. (2022). Gestión de costes y producción de maquinaria de construcción. Colección Manual de Referencia, serie Ingeniería Civil. Editorial Universitat Politècnica de València, 243 pp. Ref. 442. ISBN: 978-84-1396-046-3

YEPES, V. (2023). Maquinaria y procedimientos de construcción. Problemas resueltos. Colección Académica. Editorial Universitat Politècnica de València, 562 pp. Ref. 376. ISBN 978-84-1396-174-3

Curso:

Curso de gestión de costes y producción de la maquinaria empleada en la construcción.

Esta obra está bajo una licencia de Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0 Internacional.