El aumento o la disminución de la temperatura en las estructuras ocasiona cambios de volumen que deben tenerse en cuenta. En el caso de un pavimento, la pequeña relación entre el espesor y el área superficial implica un incremento de longitud más que evidente. Si dicho elemento se encuentra confinado, aumentan los esfuerzos de compresión y pueden ocasionar efectos como alabeo en las placas o introducir esfuerzos en las estructuras adyacentes. Un efecto similar ocurre en el caso de la retracción y la fluencia del hormigón, por lo que muchas veces se estudian conjuntamente estos efectos con los cambios térmicos. Es por ello que se suele dejar una separación estructural que permita los movimientos diferenciales, tanto horizontales como verticales. A este tipo de juntas se les denomina «juntas de expansión», «juntas de dilatación» o «juntas de aislamiento». ¿Pero son absolutamente necesarias?

El tipo de estructura, su geometría y dimensiones, los materiales utilizados o las circunstancias ambientales, entre otros factores, influyen en el comportamiento que tenga la estructura ante las variaciones térmicas. Incluso la presencia de agua, si se congela, puede incrementar de forma significativa la acción expansiva.

La omisión de este tipo de juntas de dilatación provoca daños en los elementos estructurales (zapatas, muros de sótano, pavimentos, fábricas de ladrillo, etc.). Es por ello que las juntas de dilatación deben considerarse desde el mismo momento del proyecto de la estructura. Normalmente se usan elementos tales como cintas de espuma impregnada para sellar las juntas de dilatación, aunque también se pueden dejar abiertas.

El rango de movimiento de una junta se puede calcular multiplicando el coeficiente de dilatación del material por la dimensión inicial del elemento y por la diferencia esperada de temperaturas. No obstante, el Código Técnico de Edificación (CTE SE-AE 3.4) establece que, en los edificios habituales con elementos estructurales de hormigón o acero, pueden no considerarse las acciones térmicas cuando se dispongan juntas de dilatación de forma que no existan elementos continuos de más de 40 m de longitud, aunque la experiencia nos dice que si son menos de 40 m, mejor. En el caso de edificios de hasta 4 plantas, en zona no sísmica, la junta puede tener 2,5 cm; debiéndose calcular cuando se dan otras condiciones. Para edificios de planta rectangular y estructura a base de fábrica de ladrillo la distancia entre juntas debe ser menor de 30 m. Si la planta tiene alas en forma de “L” o “U”, de longitud mayor a 15 m (50% de 30 m), el CTE (SE-F, 2.2 Juntas de movimiento) establece que se debe disponer de juntas de dilatación cerca de sus líneas de encuentro.

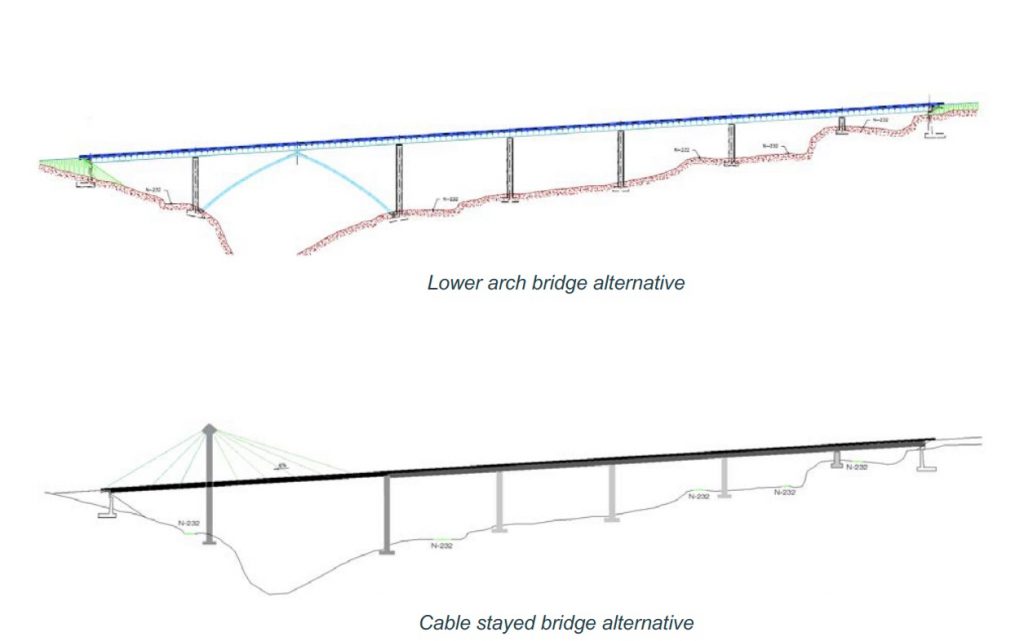

Con todo, hay estudios que demuestran que se pueden superar distancias mayores a las indicadas en el CTE siempre que se cuiden los detalles constructivos de los elementos no estructurales. De hecho, la técnica permite incluso construir edificios de hasta 300 m sin este tipo de juntas. En el caso de estructuras en obras civiles, por ejemplo en puentes, es habitual ver tramos de luces mucho mayores a los 40 m del CTE sin establecer ningún tipo de junta. Incluso en el ámbito de los ferrocarriles, ya está superado el uso de la barra largo soldada, sin juntas. Pero hay que recordar que se deben tener en cuenta en el cálculo los efectos de la temperatura.

Además, no hay que olvidar que cualquier tipo de junta en una estructura supone un problema, tanto en la ejecución, como en el mantenimiento. Un argumento más para considerar los efectos térmicos, de retracción y fluencia en el cálculo estructural e intentar evitar este tipo de juntas. El problema es la dificultad de encontrar herramientas comerciales que permitan el análisis de los efectos termohigrométricos (fluencia, retracción y cambios térmicos) junto con la fisuración, lo que lleva a que muchos técnicos se decanten por cumplir los requerimientos expuestos en el CTE.

Pero creo que lo mejor es que veáis esta clase de Juan Carlos Arroyo, que seguro, os aclarará muchas de vuestras dudas. Incluso tiene un curso sobre el tema por si a alguno le interesa: https://ten.ingenio.xyz/p/masterclass-juntas-de-dilatacion-en-estructuras