Pocas cosas simbolizan mejor la estabilidad que los cimientos de una construcción. Representan la frontera entre la arquitectura y la tierra firme. Sin embargo, bajo esa aparente solidez se esconde un enemigo persistente y silencioso: los suelos expansivos.

Lejos de ser una masa inerte, el suelo es un sistema vivo y dinámico que responde a los cambios de humedad con una energía capaz de fracturar losas, deformar zapatas y arruinar viviendas enteras.

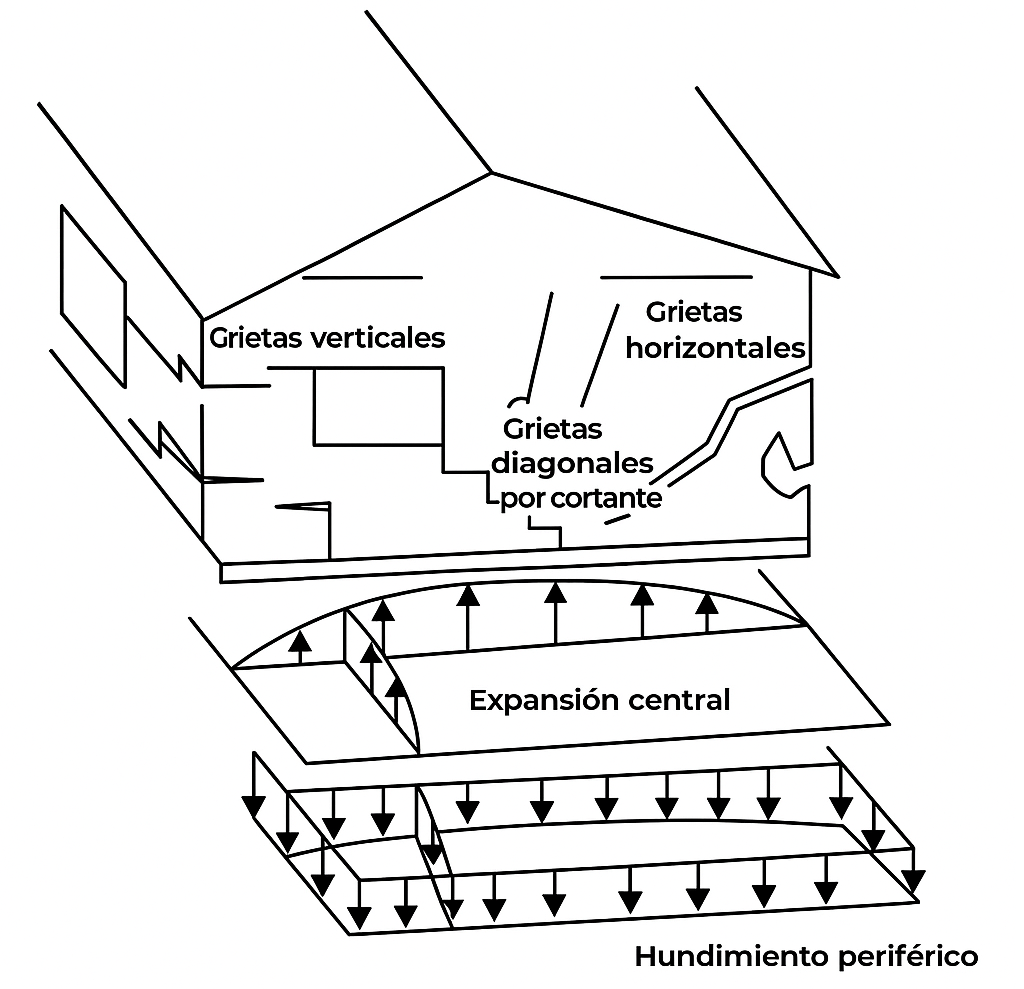

Estos suelos, ricos en minerales arcillosos activos (principalmente montmorillonita o esmectita), pueden aumentar de volumen cuando se humedecen y contraerse al secarse, lo que provoca movimientos verticales y horizontales que, en muchos casos, superan la resistencia de las estructuras apoyadas sobre ellos. La magnitud de estos cambios depende de la mineralogía, la fracción de arcilla, la capacidad de intercambio catiónico y la succión matricial, es decir, la tensión negativa del agua en los poros del suelo.

Su comportamiento, descrito con precisión en la teoría de los suelos no saturados por Fredlund y Rahardjo (1993), convierte a estas arcillas en uno de los materiales más complejos y peligrosos de la ingeniería civil.

1. Un desastre oculto, más costoso que los terremotos.

Los suelos expansivos no acaparan titulares, pero su impacto económico es asombroso. Según Jones y Holtz (1973), este tipo de suelos causa más daños estructurales anuales que todos los demás fenómenos naturales combinados, incluidos los terremotos y las inundaciones. Krohn y Slosson estimaron que, solo en Estados Unidos, las pérdidas anuales ascendían a 7000 millones de dólares, una cifra que no ha dejado de crecer con la expansión urbana.

La causa de esta devastación radica en la naturaleza progresiva y acumulativa del fenómeno. Mientras que un seísmo actúa en segundos, la expansión del suelo opera día a día, modificando lentamente las condiciones de apoyo. Su carácter insidioso le ha valido el apodo de «el desastre oculto».

El daño estructural comienza con movimientos diferenciales de pocos milímetros, que al principio son imperceptibles, pero que con el tiempo se transforman en grietas en los muros, inclinaciones de losas o puertas que ya no cierran. Lo más preocupante es que estos síntomas suelen interpretarse como defectos de construcción, cuando en realidad son la manifestación visible de un proceso geotécnico profundo.

2. La paradoja de la ligereza: las casas pequeñas son las más afectadas.

Resulta sorprendente que las estructuras ligeras se vean más afectadas por este fenómeno. Uno podría pensar que los edificios más pesados son los más susceptibles al movimiento del terreno, pero ocurre lo contrario.

Los suelos expansivos ejercen presiones de hinchamiento considerables, pero los proyectos a gran escala suelen incluir estudios de mecánica de suelos, pruebas de laboratorio (como las de hinchamiento libre o de volumen constante, según ASTM D4546) y diseños de cimentación apropiados. En cambio, las viviendas unifamiliares y las edificaciones ligeras, al considerarse de carga reducida, se construyen con escasa o nula investigación geotécnica y, a menudo, se basan en prácticas empíricas.

Fredlund (1993) señala que las estructuras que sufren mayores daños son precisamente aquellas que tuvieron un diseño de ingeniería menor antes de la construcción. A esto se suma un factor económico: los ingenieros geotécnicos suelen mostrarse reacios a intervenir en proyectos residenciales porque los honorarios son bajos en comparación con el alto riesgo de litigio. El resultado es un círculo vicioso: casas mal cimentadas sobre suelos hiperactivos que, con el tiempo, se deforman de forma irremediable.

3. La trampa de la compactación: cuando «mejorar» el terreno lo empeora.

A primera vista, compactar un suelo parece una acción positiva. En la mayoría de los casos, aumenta la densidad y la capacidad portante. Sin embargo, en los suelos expansivos, la compactación puede ser una trampa técnica.

Holtz y Gibbs (1956) demostraron que una compactación a alta densidad y bajo contenido de humedad incrementa significativamente el potencial de hinchamiento. Las partículas de arcilla, con carga negativa, se acercan tanto que acumulan una gran energía potencial de repulsión electrostática. Cuando posteriormente penetra agua, las moléculas se insertan entre las láminas cristalinas y las separan bruscamente, lo que provoca una expansión volumétrica explosiva.

El mismo estudio reveló que compactar por encima del contenido óptimo de agua reduce el potencial de expansión. En otras palabras, la práctica tradicional de buscar la máxima densidad seca puede resultar contraproducente. Comprender esta paradoja es esencial para la ingeniería moderna: no todos los suelos deben compactarse de la misma manera y, en algunos casos, un exceso de «mejora» puede acarrear un fracaso futuro.

4. Soluciones que desafían la lógica: cómo responde la ingeniería al suelo.

El reto de los suelos expansivos no consiste en vencer su fuerza, sino en comprender su dinámica. Por ello, las soluciones más efectivas no buscan resistir el movimiento del terreno, sino controlar la humedad o aislar la estructura de sus variaciones.

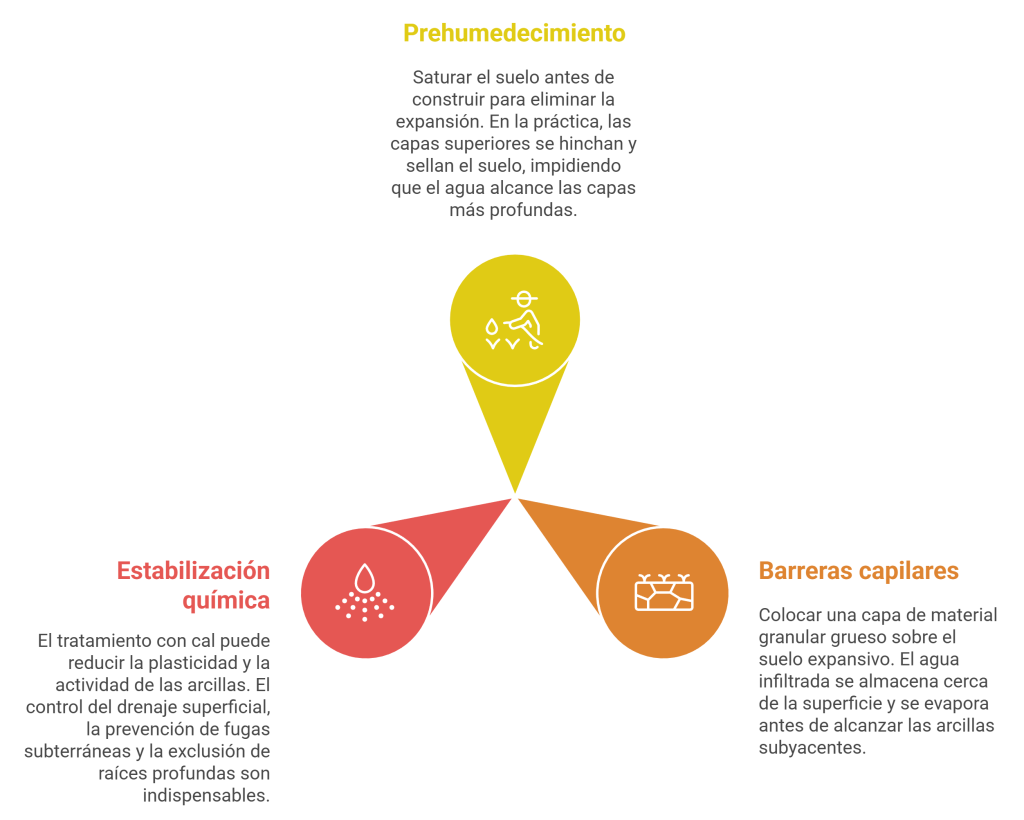

Entre las estrategias más estudiadas se encuentran:

- Prehumedecimiento, una idea fallida: En teoría, saturar el suelo antes de construir debería eliminar su capacidad de expansión. En la práctica, esto rara vez funciona. Fredlund (1993) advierte que, durante el prehumedecimiento, las capas superiores se hinchan y sellan el suelo, impidiendo que el agua alcance los estratos más profundos. El resultado es una expansión parcial y una falsa sensación de seguridad, ya que el suelo parece estable hasta que, años después, las capas profundas se hidratan lentamente y la estructura comienza a levantarse.

- Barreras capilares, el poder de una paradoja: Una de las técnicas más elegantes es la barrera capilar, que consiste en colocar sobre el suelo expansivo una capa de material granular grueso, como grava o arena. A simple vista parece absurdo: ¿cómo se puede proteger una arcilla del agua cubriéndola con un material permeable? Sin embargo, la física de los suelos no saturados demuestra que, cuando la grava se mantiene con baja saturación, su capacidad de transmisión capilar disminuye drásticamente y el agua infiltrada se almacena cerca de la superficie. Así, la humedad se evapora antes de llegar a las arcillas subyacentes. En palabras de Fredlund y Rahardjo (1993), esta técnica «reduce significativamente el flujo descendente de agua y estabiliza el régimen de humedad del perfil».

- Estabilización química y control ambiental: El tratamiento con cal puede reducir la plasticidad y la actividad de las arcillas, convirtiéndolas en materiales prácticamente inertes. Asimismo, son indispensables el control del drenaje superficial, la prevención de fugas subterráneas y la exclusión de raíces profundas. No se trata solo de una cuestión estructural, sino también de una cuestión hidrológica y ambiental: la humedad del suelo debe mantenerse lo más constante posible.

Conclusión: hay que escuchar al suelo antes de construir.

El suelo no es un enemigo, sino un sistema natural que exige ser comprendido. Su comportamiento responde a leyes físico-químicas y climáticas que la ingeniería puede medir, modelar y respetar. Ignorarlas es, literalmente, construir sobre terreno inestable. El fenómeno de los suelos expansivos nos recuerda una verdad fundamental: no hay cimiento sólido sobre un terreno mal entendido. Cada grieta que aparece en una pared, cada losa que se levanta, es la voz del subsuelo que nos recuerda que el diseño estructural comienza mucho antes de colocar el primer ladrillo; comienza con el conocimiento del terreno.

Referencias

-

Fredlund, D. G., & Rahardjo, H. (1993). Soil mechanics for unsaturated soils. John Wiley & Sons.

-

Fredlund, D. G. (1983). Prediction of ground movements in swelling clays. En 31st Annual ASCE Soil Mechanics and Foundation Engineering Conference (Ponencia). Minneapolis, MN, Estados Unidos.

-

Holtz, W. G., & Gibbs, H. J. (1956). Engineering properties of expansive soils. Transactions of the American Society of Civil Engineers, 121, 641–663.

-

Jones, D. E., Jr., & Holtz, W. G. (1973). Expansive soils — The hidden disaster. Civil Engineering (ASCE), 43(8), 49–51.

-

Krohn, J. P., & Slosson, J. E. (1980). Assessment of expansive soils in the United States. En D. J. Miller (Ed.), Proceedings of the Fourth International Conference on Expansive Soils (pp. 596–608). ASCE.

-

Nelson, J. D., & Miller, D. J. (1992). Expansive soils: Problems and practice in foundation and pavement engineering. John Wiley & Sons.

-

Van der Merwe, D. H. (1964). The prediction of heave from the plasticity index and percent fraction of soils. Civil Engineering in South Africa, 6(6), 103–107.

-

Skempton, A. W. (1953). The colloidal activity of clays. En Proceedings of the 3rd International Conference on Soil Mechanics and Foundation Engineering (Vol. 1, pp. 57–61). International Society for Soil Mechanics and Foundation Engineering.

-

Hamilton, J. J. (1969). Effects of environment on the performance of shallow foundations. Canadian Geotechnical Journal, 6(1), 65–80.

Cursos:

Curso de compactación superficial y profunda de suelos en obras de ingeniería civil y edificación.

En este audio tenéis una conversación sobre este tema tan relevante.

Un vídeo que resume el contenido del tema, con carácter divulgativo, lo tenéis aquí:

Aquí también tenéis un vídeo sobre cómo identificar estas arcillas expansivas en el laboratorio de suelos.

Os dejo un documento técnico de la empresa Geopier. Espero que os resulte de interés.

Esta obra está bajo una licencia de Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0 Internacional.