La aparición del Código Estructural, aprobado por el Real Decreto 470/2021, de 29 de junio, supone ciertas novedades en el ámbito de la construcción de nuestro país. Independientemente de la pertinencia de esta nueva norma en un momento donde deberíamos converger rápidamente hacia los Eurocódigos, lo cierto es que permite integrar en un solo documento los aspectos relacionados con el hormigón estructural, el acero y las estructuras mixtas. En este nuevo contexto, vamos a revisar de forma somera cómo se trata la calidad de las estructuras. Para ello tengamos en cuenta que el Código Estructural presenta cuatro títulos: Bases generales, Estructuras de hormigón, Estructuras de Acero y Estructuras mixtas; además de 32 Anejos, un total de 1789 páginas del Boletín Oficial del Estado.

La aparición del Código Estructural, aprobado por el Real Decreto 470/2021, de 29 de junio, supone ciertas novedades en el ámbito de la construcción de nuestro país. Independientemente de la pertinencia de esta nueva norma en un momento donde deberíamos converger rápidamente hacia los Eurocódigos, lo cierto es que permite integrar en un solo documento los aspectos relacionados con el hormigón estructural, el acero y las estructuras mixtas. En este nuevo contexto, vamos a revisar de forma somera cómo se trata la calidad de las estructuras. Para ello tengamos en cuenta que el Código Estructural presenta cuatro títulos: Bases generales, Estructuras de hormigón, Estructuras de Acero y Estructuras mixtas; además de 32 Anejos, un total de 1789 páginas del Boletín Oficial del Estado.

La palabra «calidad» aparece en el nuevo código un total de 458 veces, frente a las 213 apariciones que tuvo en la anterior Instrucción de Hormigón Estructural (EHE-08). Este aumento se debe a la inclusión de las estructuras de acero y mixtas en el nuevo código. No obstante, conviene recordar que el concepto de calidad no se circunscribe exclusivamente a lo que se entiende como «control de calidad», ya sea de recepción o de proceso, sino que va más allá, incluyendo aspectos relacionados con el aseguramiento de la calidad de las organizaciones. Con todo, si entendemos como calidad el enfoque técnico de Crosby como el cumplimiento de las especificaciones de un producto o servicio, entonces todo el Código sería objeto del concepto de calidad. Es por ello que vamos a restringir la perspectiva a aquellos aspectos al que la nueva norma se refiere cuando aparece el término calidad en su articulado.

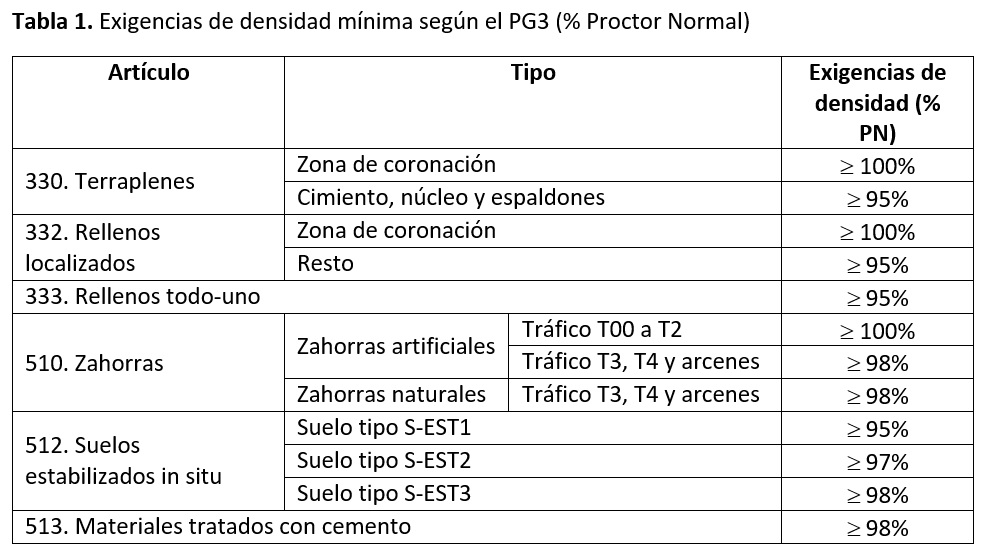

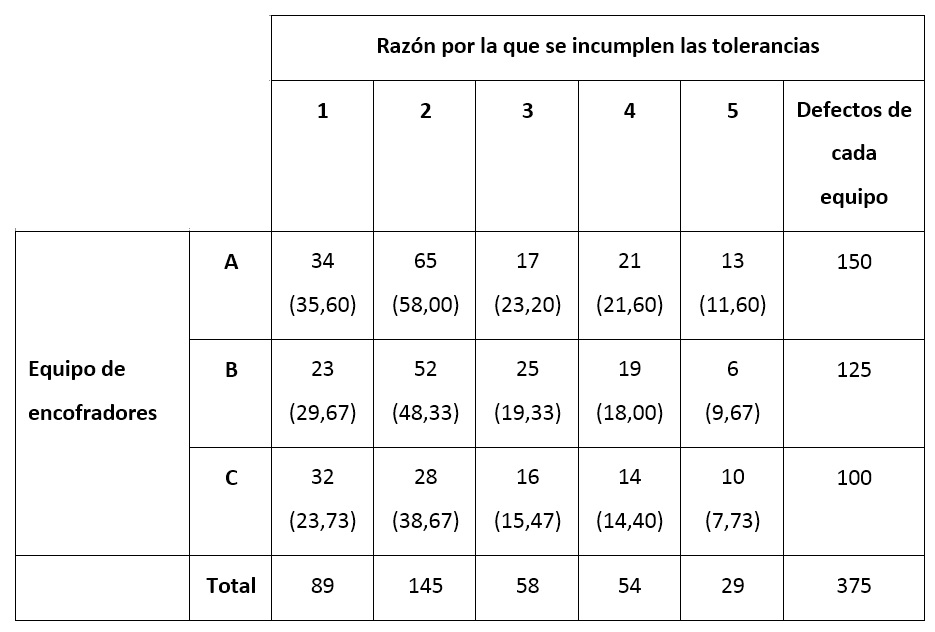

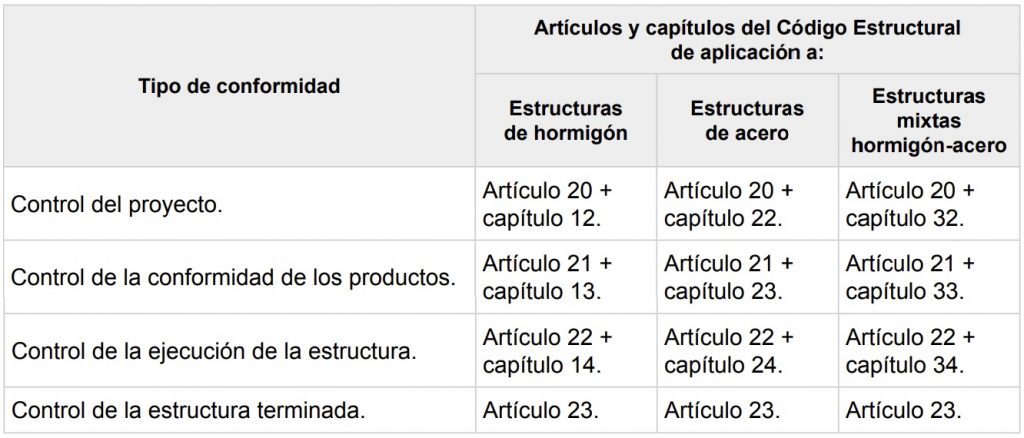

Una lectura en diagonal del Código ya nos indica que hay una gran dispersión de los conceptos relacionados con la calidad. Nos encontramos aspectos relacionados con exigencias de calidad medioambiental en la ejecución mezclados con otros relacionados con las condiciones de suministro, las garantías de calidad y el control de la recepción. Se intercalan aspectos relacionados con la responsabilidad en la gestión de la calidad con otros relacionados con el control. Resulta evidente la confusión de conceptos como «gestión de la calidad», «garantía de la calidad» o «control de la calidad» a lo largo del texto. Hubiera sido interesante aclarar estos conceptos en el Capítulo 5 Bases generales para la gestión de la calidad de las estructuras. De todas formas, la Tabla 17.1 nos ilumina con cierto orden, al menos, en lo relacionado con la conformidad en el control del proyecto, de los productos, de la ejecución de la estructura y de la estructura terminada.

Sin entrar en más detalles, sí que se detecta un cambio en el control de calidad de la ejecución respecto a la EHE-08. Mejora la trazabilidad, modifica las condiciones de fabricación y armoniza diversas nomenclaturas españolas a las europeas. Estos cambios afectan a los propios lotes, los lotes de ensayos de resistencia, las unidades de inspección y su frecuencia, etc. Los cambios tratan de diferenciar mejor los elementos estructurales y sistemas constructivos. Destaca asimismo la diferencia de los puentes respecto al resto de estructuras y una atención especial a las estructuras de baja complejidad. Cabe destacar el Anejo 4 Documentación de suministro y control de los productos recibidos directamente en obra, que explica muy claramente toda la documentación para los productos recepcionados en obra antes, durante y al finalizar su suministro.

Por otra parte, se sustituyen las menciones a la Directiva 89/106/CEE del Consejo, de 21 de diciembre de 1988, relativas a la aproximación de las disposiciones legales, reglamentarias y administrativas de los Estados miembros sobre los productos de construcción, que se contenían en la reglamentación vigente, por las del Reglamento (UE) nº 305/2011 del Parlamento Europeo y del Consejo, de 9 de marzo de 2011, por el que se establecen condiciones armonizadas para la comercialización de productos de construcción y se deroga la Directiva 89/106/CEE del Consejo. También desaparece el concepto de idoneidad al uso de los productos con marcado CE y se sustituye por la presunción de veracidad de la declaración de prestaciones del producto por parte del fabricante. La declaración de prestaciones deberá cumplir las especificaciones del citado Reglamento (UE) nº 305/2011.

Resulta también de interés el refuerzo que hace el Código respecto a las consideraciones que deben aplicarse para los productos controlados en fábrica, entre los que se encuentran los prefabricados, con el añadido de la existencia de un organismo certificador externo que lo valide. Asimismo, se avanza en la posibilidad de que el fabricante pueda obtener de forma voluntaria un Distintivo de Calidad Oficialmente Reconocido (DCOR) que implique el cumplimiento de una serie de requisitos adicionales a los que establecen las normas armonizadas. Ello permite ventajas que ya venían de la EHE-08, entre las que destacan la máxima reducción posible de los coeficientes de seguridad de los materiales, hasta 1,35 en hormigón y hasta 1,10 en acero. Esto es de gran interés, por ejemplo, para prefabricados de hormigón certificados con un DCOR, siempre que se cumplan además otra serie de consideraciones.

Otro aspecto destacable es la estrecha relación que existe entre este nuevo Código Estructural y el Real Decreto 163/19, por el que se aprueba la Instrucción Técnica para la realización del control de producción de los hormigones fabricados en central, de forma que existe ahora una correcta correlación entre la producción y la puesta en obra del hormigón.

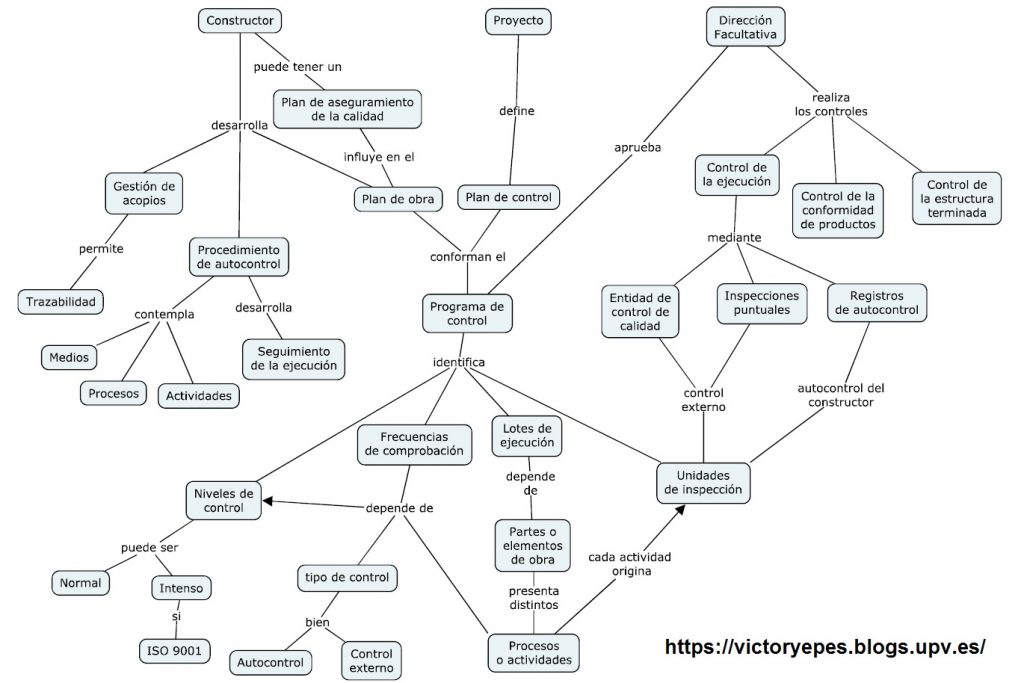

Os dejo a continuación una mapa conceptual, que utilizo yo en mis clases, y que simplifica de alguna forma los aspectos relacionados con la calidad de las estructuras.

Os dejo un vídeo que os he grabado al respecto.

También os dejo unos vídeos explicativos del Colegio de Ingenieros Técnicos de Obras Públicas de Aragón sobre el tratamiento de la calidad en el nuevo Código Estructural. Espero que os sean de utilidad.

Esta obra está bajo una licencia de Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0 Internacional.;