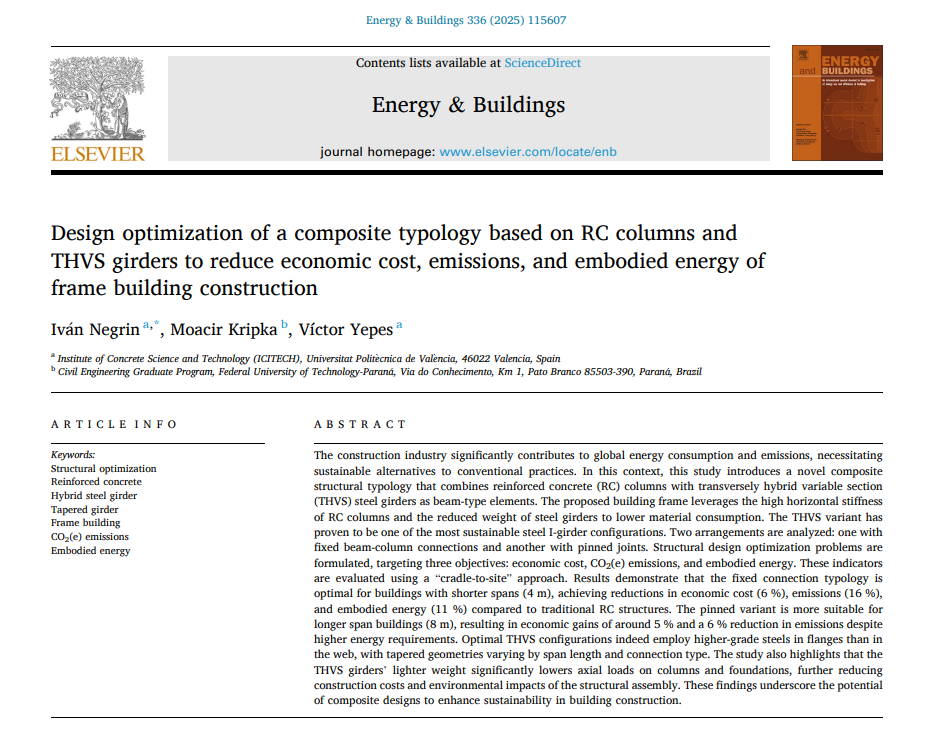

Acaban de publicar nuestro artículo en la revista Energy and Buildings, de la editorial Elsevier, indexada en D1 del JCR. El estudio presenta una tipología estructural compuesta que combina columnas de hormigón armado con vigas de acero de sección variable híbrida transversal (THVS) para optimizar el coste económico, las emisiones de CO₂ y la energía incorporada en la construcción de edificios.

Acaban de publicar nuestro artículo en la revista Energy and Buildings, de la editorial Elsevier, indexada en D1 del JCR. El estudio presenta una tipología estructural compuesta que combina columnas de hormigón armado con vigas de acero de sección variable híbrida transversal (THVS) para optimizar el coste económico, las emisiones de CO₂ y la energía incorporada en la construcción de edificios.

Este trabajo se enmarca dentro del proyecto de investigación RESILIFE, que dirijo como investigador principal, junto con el profesor Julián Alcalá, en la Universitat Politècnica de València.

El estudio plantea la siguiente pregunta de investigación: ¿en qué medida la optimización del diseño estructural de edificios en marco mediante el uso de una tipología compuesta con columnas de hormigón armado y vigas de sección variable transversamente híbridas (THVS) contribuye a la reducción del coste económico, de las emisiones de CO₂ y de la energía incorporada en la construcción?

Esta formulación permite abordar de manera precisa la problemática del impacto ambiental y económico del sector de la construcción, orientando la investigación hacia la identificación de configuraciones estructurales que minimicen estos factores mediante metodologías de optimización. La pregunta define claramente el problema central: la búsqueda de una alternativa estructural más eficiente que las tipologías tradicionales de hormigón armado.

Metodología

El estudio adopta un enfoque de optimización estructural basado en la combinación de Biogeography-Based Optimization (BBO) y Constrained Deterministic Local Iterative Search (CDLIS). Este enfoque permite buscar de manera eficiente soluciones en un espacio de diseño altamente complejo. Se analizan tres tipologías estructurales:

- Estructura tradicional de hormigón armado: Se optimizan las dimensiones de vigas, columnas y cimentaciones, así como la calidad del hormigón utilizado.

- Estructura compuesta con vigas THVS y uniones rígidas: Se sustituyen las vigas de hormigón armado por vigas THVS con conexiones fijas a las columnas.

- Estructura compuesta con vigas THVS y uniones articuladas: Similar a la anterior, pero con conexiones articuladas.

Las funciones objetivo optimizadas incluyen:

- Coste económico: Calculado con base en los precios unitarios de materiales y procesos constructivos.

- Emisiones de CO₂(e): Evaluadas según un enfoque «cradle-to-site», considerando la extracción de materias primas, fabricación y construcción.

- Energía incorporada: Calculada en términos de consumo energético total en las fases de producción y construcción.

Se tienen en cuenta restricciones estructurales y de servicio según las normativas de diseño. Además, se implementa la interacción suelo-estructura mediante un modelo de tipo Winkler para evaluar los asentamientos diferenciales y su efecto en el diseño estructural.

Aportaciones relevantes

- La tipología compuesta con vigas THVS y conexiones rígidas logra una reducción del 6 % en costes económicos, del 16 % en emisiones de CO₂ y del 11 % en energía incorporada para edificios con luces de 4 m.

- Para edificios con luces de 8 m, la configuración con uniones articuladas permite reducir los costos económicos y las emisiones en un 5 % y un 6 %, respectivamente, aunque con un mayor consumo de energía.

- Se demuestra que la menor carga axial transmitida por las vigas THVS reduce las solicitaciones en columnas y cimentaciones, lo que optimiza su diseño y reduce su impacto ambiental.

- Se comprueba que el uso de acero de mayor calidad en las alas de las vigas THVS en comparación con el alma mejora la eficiencia estructural, con razones de hibridación (Rh) entre 1,2 y 2,0.

Discusión de resultados

El análisis de los resultados revela diferencias significativas entre las configuraciones estructurales. En los edificios con luces reducidas (4 m), las vigas THVS con uniones rígidas ofrecen el mejor rendimiento en términos de coste y sostenibilidad. En cambio, en edificios con luces mayores (8 m), las conexiones articuladas permiten un mejor aprovechamiento del material, aunque con una menor rigidez global.

Cabe destacar que la consideración de elementos de rigidización adicionales, como muros y losas, mejora notablemente el comportamiento de la tipología articulada, reduciendo su impacto ambiental en un 45 % y disminuyendo en un 60 % la carga axial sobre las columnas.

Líneas futuras de investigación

- Perfeccionamiento del proceso de fabricación de vigas THVS, abordando aspectos como soldadura, control de calidad y optimización de ensamblaje.

- Desarrollo de conexiones híbridas entre vigas THVS y columnas de hormigón armado, mejorando la eficiencia de transferencia de cargas.

- Exploración de configuraciones mixtas de soporte, optimizando la selección de conexiones fijas o articuladas según las características del edificio.

- Evaluación del comportamiento ante cargas dinámicas y sísmicas, considerando efectos de fatiga y estabilidad estructural.

- Implementación de metamodelos para optimización computacional, reduciendo el tiempo de cálculo en simulaciones de alta fidelidad.

Conclusión

La optimización del diseño estructural de edificios en marco mediante el uso de vigas THVS permite reducir costes y mejorar la sostenibilidad ambiental. Las configuraciones con conexiones rígidas son particularmente eficientes en luces cortas, mientras que las conexiones articuladas son una alternativa viable en luces mayores cuando se combinan con elementos de rigidización adicionales. Estos hallazgos abren nuevas líneas de investigación en la aplicación y mejora de sistemas estructurales compuestos en ingeniería civil.

Referencia:

NEGRÍN, I.; KRIPKA, M.; YEPES, V. (2025). Design optimization of a composite typology based on RC columns and THVS girders to reduce economic cost, emissions, and embodied energy of frame building construction. Energy and Buildings, 336:115607. DOI:10.1016/j.enbuild.2025.115607