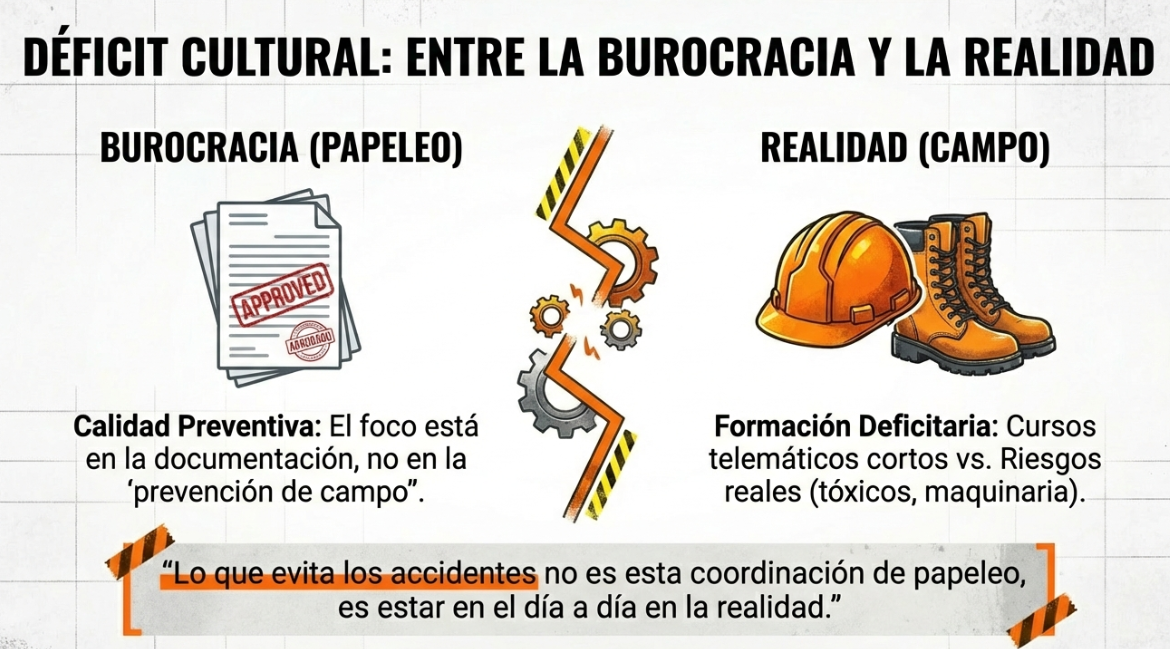

Durante años, la norma ISO 9001 ha sido víctima de una mala interpretación sistémica. En muchas salas de juntas, la palabra «calidad» no evoca excelencia, sino una imagen lúgubre de estanterías llenas de manuales que nadie lee y de una burocracia asfixiante que ralentiza cada decisión. A esto es a lo que yo llamo «la muerte por papel»: un estado en el que la organización trabaja para el sistema en lugar de ser el sistema quien trabaje para la organización.

Durante años, la norma ISO 9001 ha sido víctima de una mala interpretación sistémica. En muchas salas de juntas, la palabra «calidad» no evoca excelencia, sino una imagen lúgubre de estanterías llenas de manuales que nadie lee y de una burocracia asfixiante que ralentiza cada decisión. A esto es a lo que yo llamo «la muerte por papel»: un estado en el que la organización trabaja para el sistema en lugar de ser el sistema quien trabaje para la organización.

Sin embargo, si eliminamos el cumplimiento superficial, lo que queda no es un obstáculo reglamentario, sino un sistema de inteligencia estratégica de alto nivel. La ISO 9001, entendida desde la perspectiva de la madurez organizacional, es, en realidad, el «sistema operativo» de los negocios modernos. Si tu certificación se siente como un lastre y no como una palanca para aumentar el retorno de la inversión (ROI), es probable que estés cometiendo los errores que separan a las empresas que solo «tienen el sello» de las que dominan su mercado.

A continuación, expongo cinco verdades disruptivas extraídas de la esencia técnica de la norma que obligarán a cualquier líder a replantearse su modelo de gestión.

1. El gran pecado de la burocracia autoimpuesta.

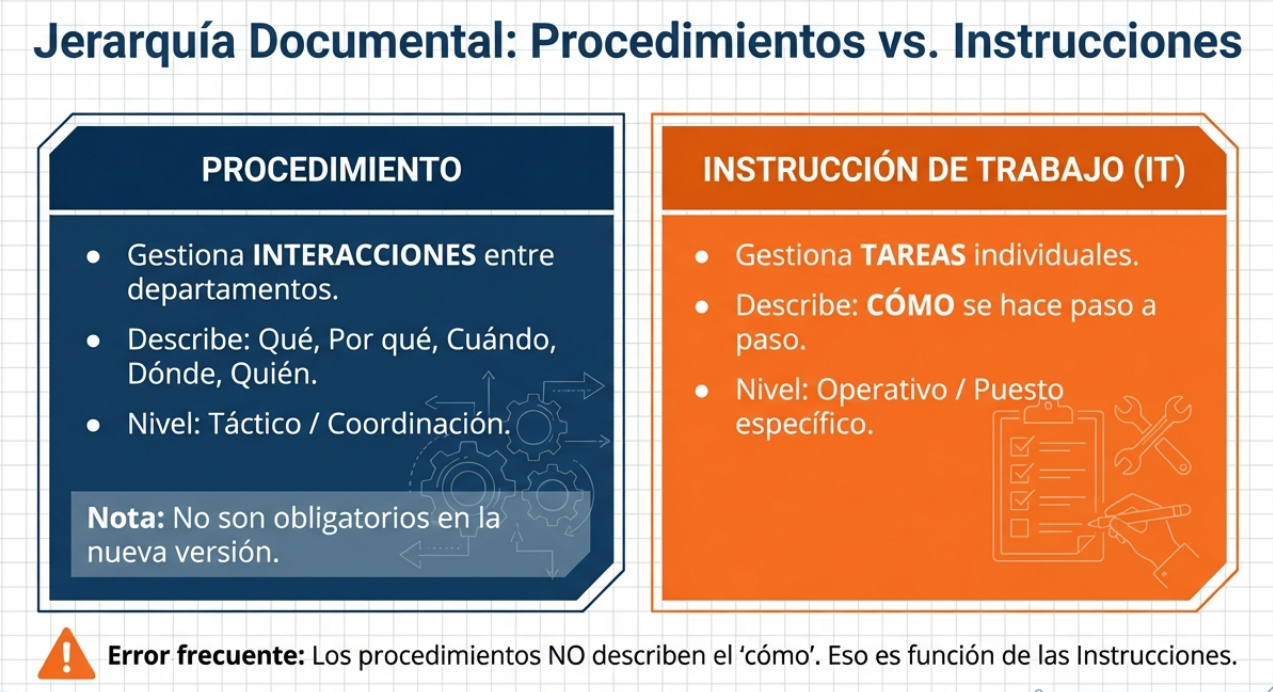

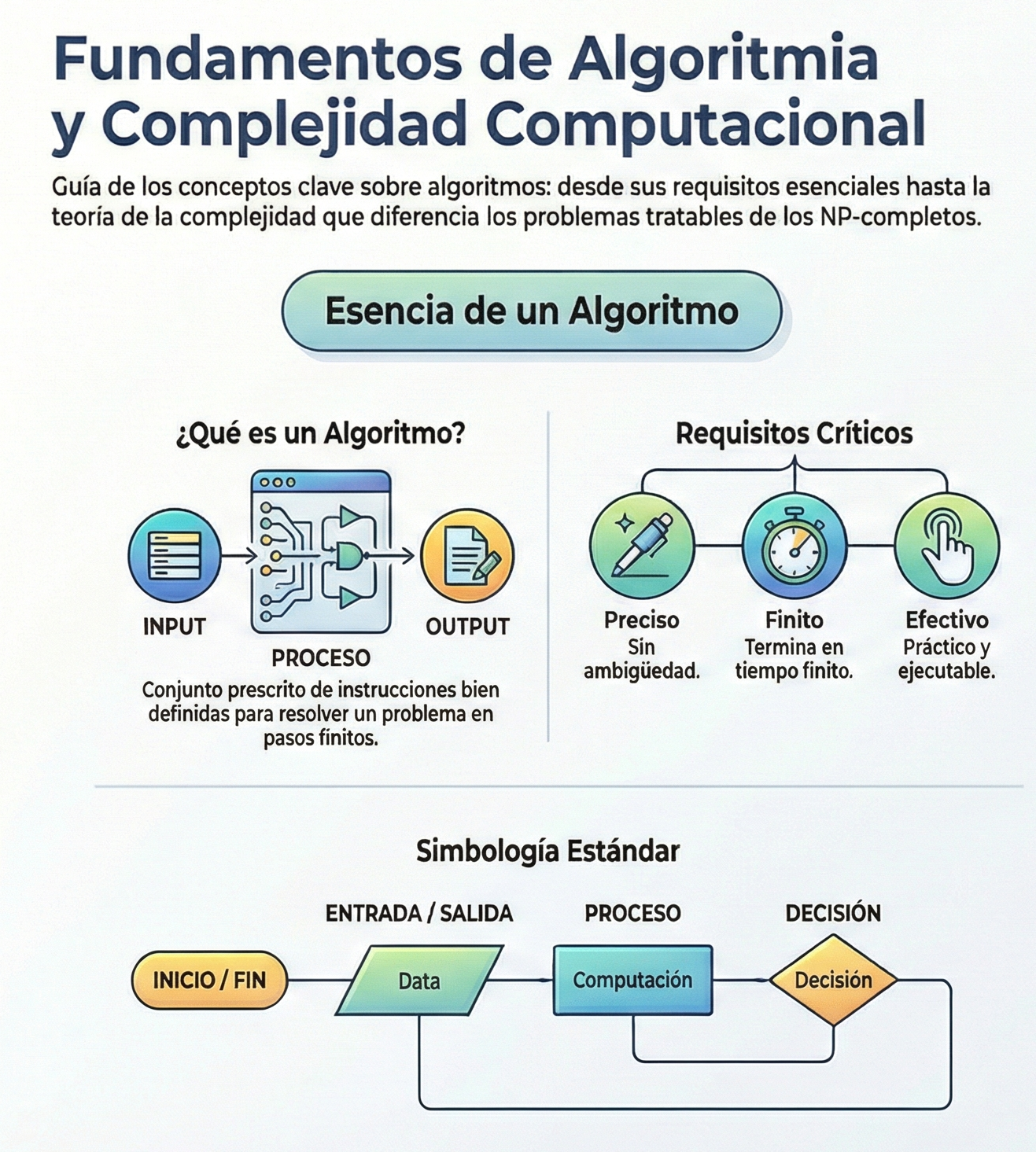

La principal fuente de fricción operativa es la confusión entre procedimientos e instrucciones de trabajo. Muchas empresas documentan cada paso de cada tarea en «procedimientos» densos, creando una red de la que es imposible escapar. El consultor sénior sabe que el procedimiento describe el qué, el porqué y quién es el responsable, mientras que el cómo detallado pertenece exclusivamente a las instrucciones de trabajo.

Sin embargo, la verdad más sorprendente, que la mayoría de los gestores ignora, es la siguiente:

Los procedimientos del sistema de gestión de la calidad, según la norma ISO 9001, describen la implementación de dicho sistema. No son obligatorios.

Así es. La norma no te obliga a tener esa montaña de procedimientos. Si tu sistema es burocrático, es por decisión interna, no por exigencia del estándar. La agilidad se recupera cuando se entiende que la ISO busca resultados, no literatura.

2. La estructura de alto nivel.

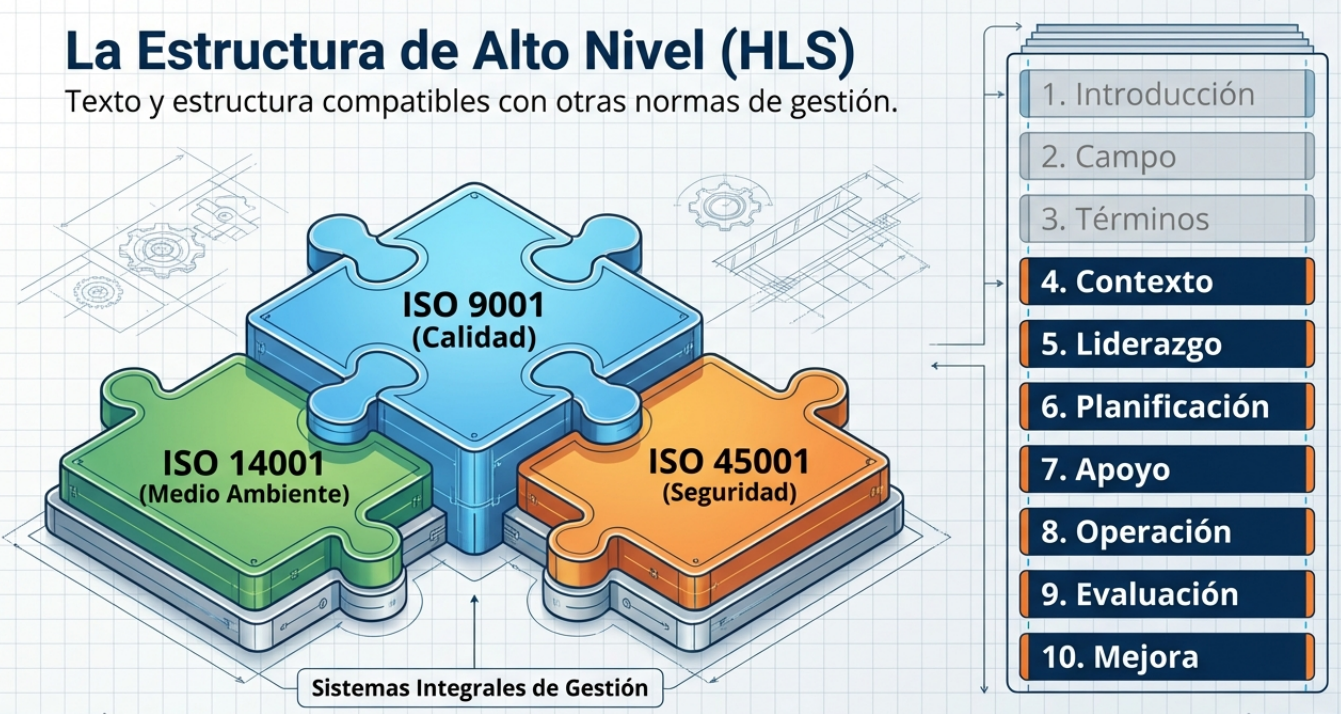

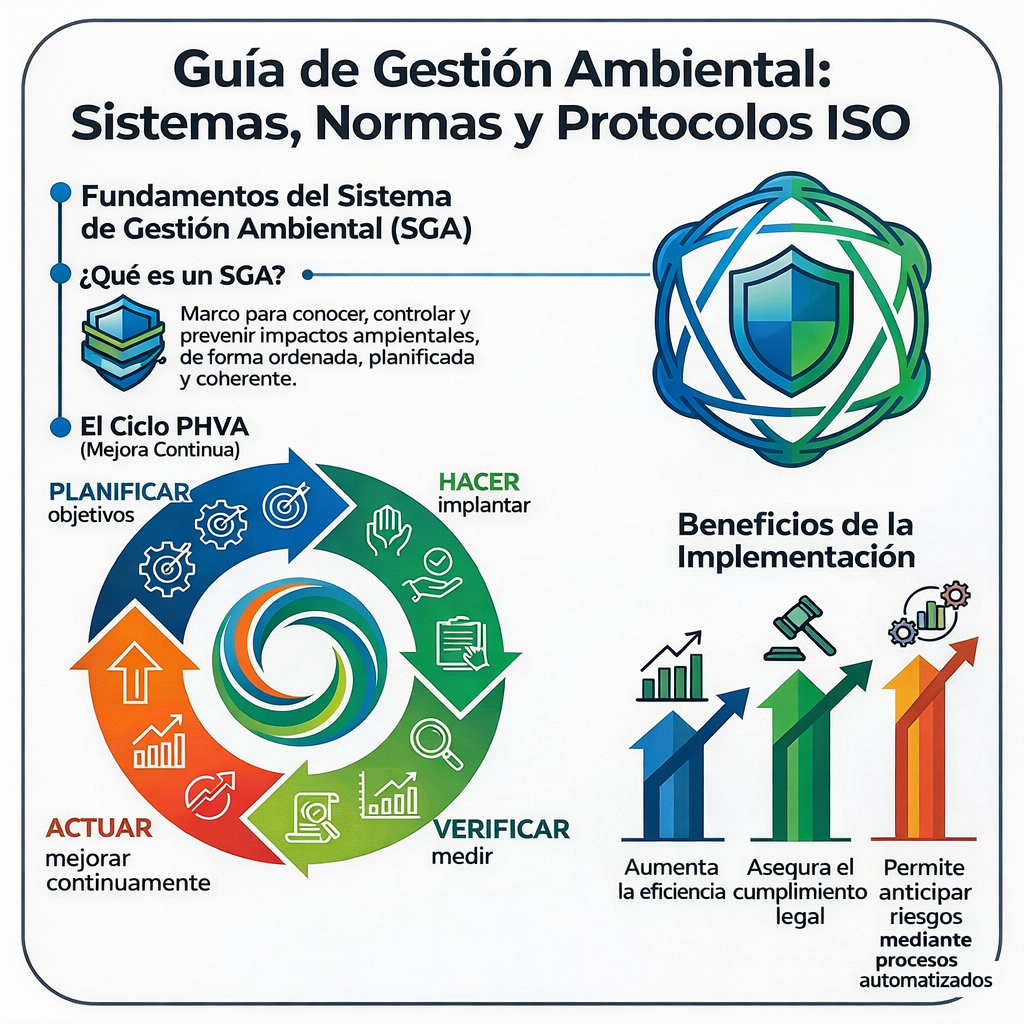

La ISO 9001 ya no es una isla. Gracias a su Estructura de Alto Nivel, ahora utiliza un lenguaje universal compatible con otros estándares. Esto no es solo un detalle técnico, sino la base para crear sistemas integrales de gestión.

En lugar de tener departamentos estancos que gestionan por separado los riesgos ambientales, de seguridad o de calidad, esta estructura permite integrarlos.

- ISO 14001: Gestión Ambiental.

- ISO 45001: Seguridad y salud en el trabajo.

Esta compatibilidad transforma el sistema de gestión en un tronco común que optimiza los recursos de auditoría y, lo que es más importante, elimina la redundancia de datos, de modo que la dirección tenga una visión única de la resiliencia corporativa.

3. El riesgo invisible: de la expectativa voluntaria al requisito legal.

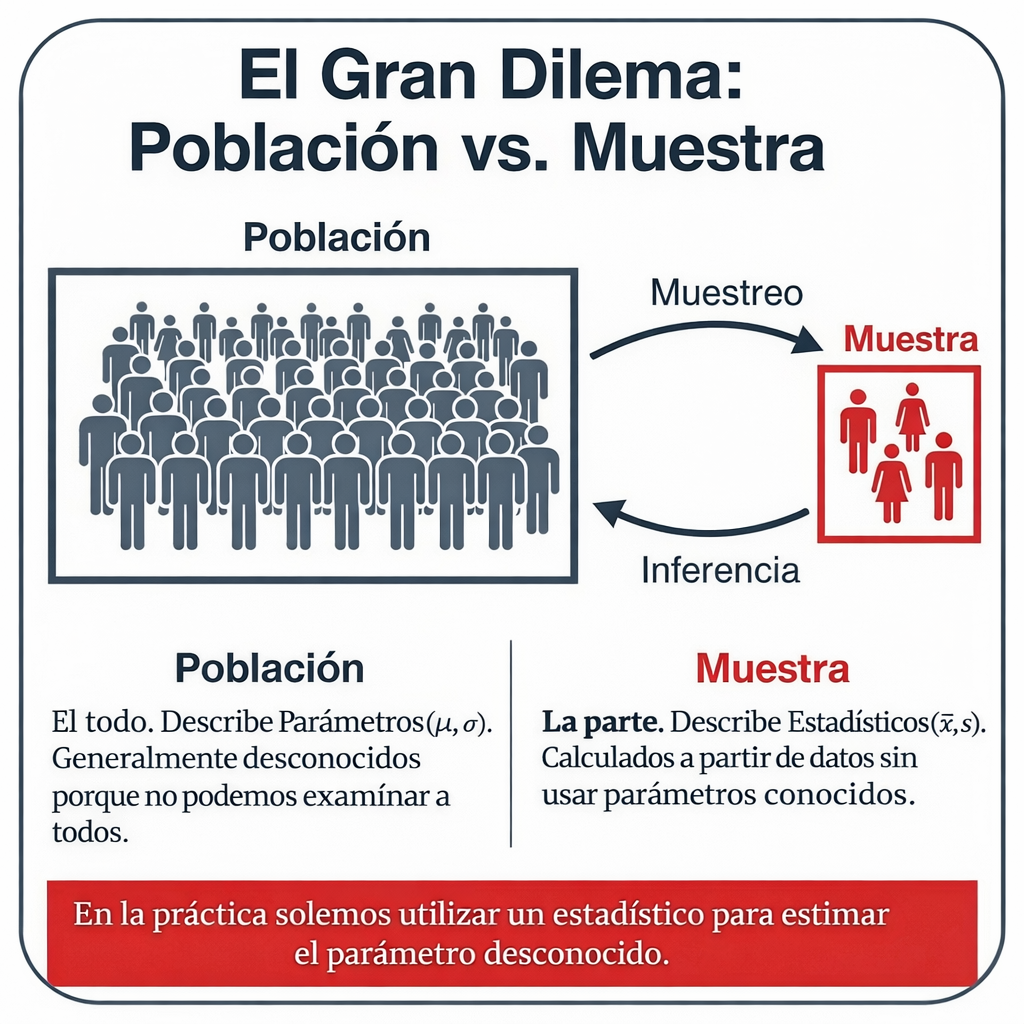

Muchos gestores limitan su visión al cliente final. La norma, sin embargo, exige un enfoque de 360 grados respecto de las partes interesadas. Pero cuidado: el análisis de sus necesidades no es un ejercicio de relaciones públicas, sino una trampa de cumplimiento si no se gestiona con inteligencia estratégica.

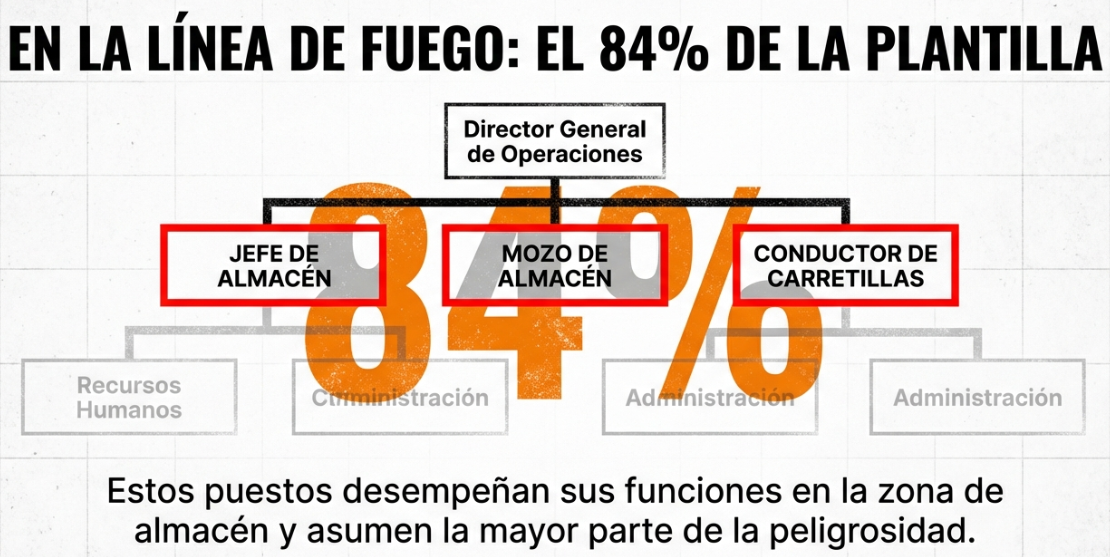

Tomemos como ejemplo una empresa de transporte de mercancías. Para un inversor, la «calidad» no solo consiste en que el camión llegue a tiempo, sino que también abarca la imagen de la reputación y el control de riesgos económicos. Para un trabajador, son el reconocimiento y la participación. Lo verdaderamente crítico es que la organización puede decidir aceptar voluntariamente estas expectativas (por ejemplo, mediante un contrato o una promesa de marca).

Muchos se sorprenden al descubrir que una vez que la organización adopta voluntariamente un requisito de una parte interesada, este se convierte automáticamente en un requisito obligatorio del sistema de gestión. Un compromiso contractual con un proveedor sobre plazos de pago o una promesa de sostenibilidad para la sociedad se vuelve tan auditable y legalmente vinculante para tu sistema de calidad como la entrega del producto mismo.

4. Verificación frente a validación: la diferencia entre cumplir y satisfacer.

En la alta dirección, confundir estos términos es una receta para el desastre financiero. La diferencia es sutil, pero vital para garantizar el valor real:

- Verificación: Confirmación, mediante inspección, de que se han cumplido los requisitos especificados. Se trata de una comprobación frente al plano o al diseño.

- Validación: Comprobación, mediante ensayo, de que el producto cumple su aplicación específica prevista en el mundo real.

Un producto puede estar perfectamente verificado (cumplir todas las especificaciones técnicas) y ser un fracaso total si no ha sido validado (no sirve para lo que el usuario necesitaba). Un gestor estratégico no se detiene en la inspección, sino que busca el ensayo que demuestre su utilidad real.

5. El liderazgo como eje del PDCA.

El ciclo PDCA (Planificar, Hacer, Verificar, Actuar) suele representarse como un círculo estático. Es un error. En el modelo real de la ISO 9001, el liderazgo no es un paso más del ciclo, sino el eje central que mantiene todos los procesos en órbita y en armonía. Sin liderazgo, el ciclo se fragmenta.

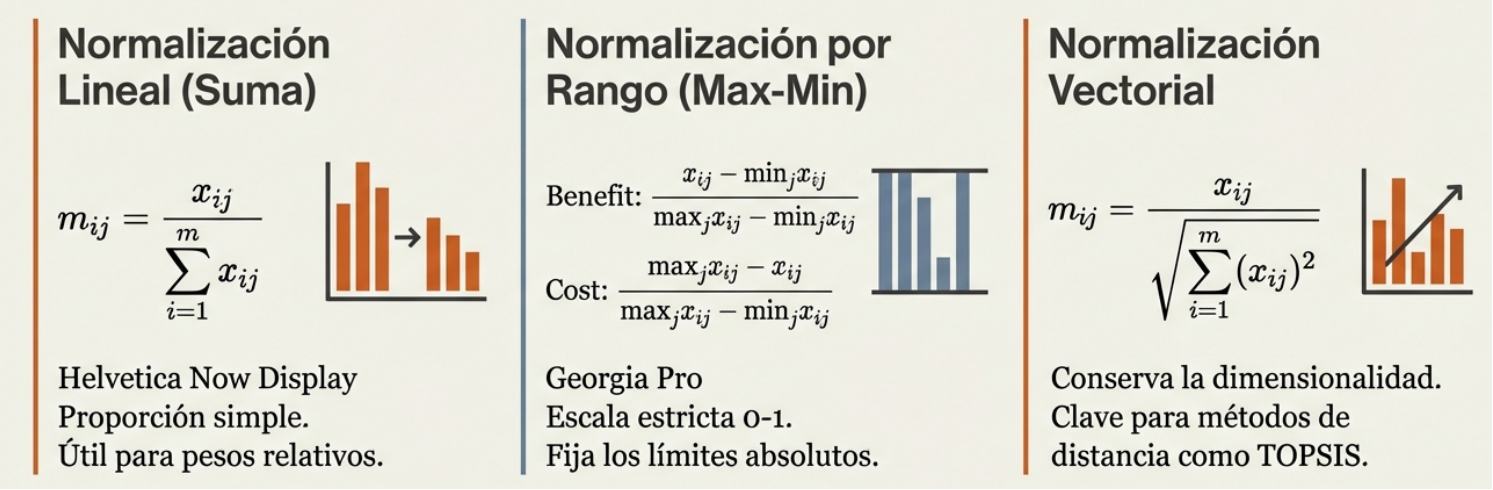

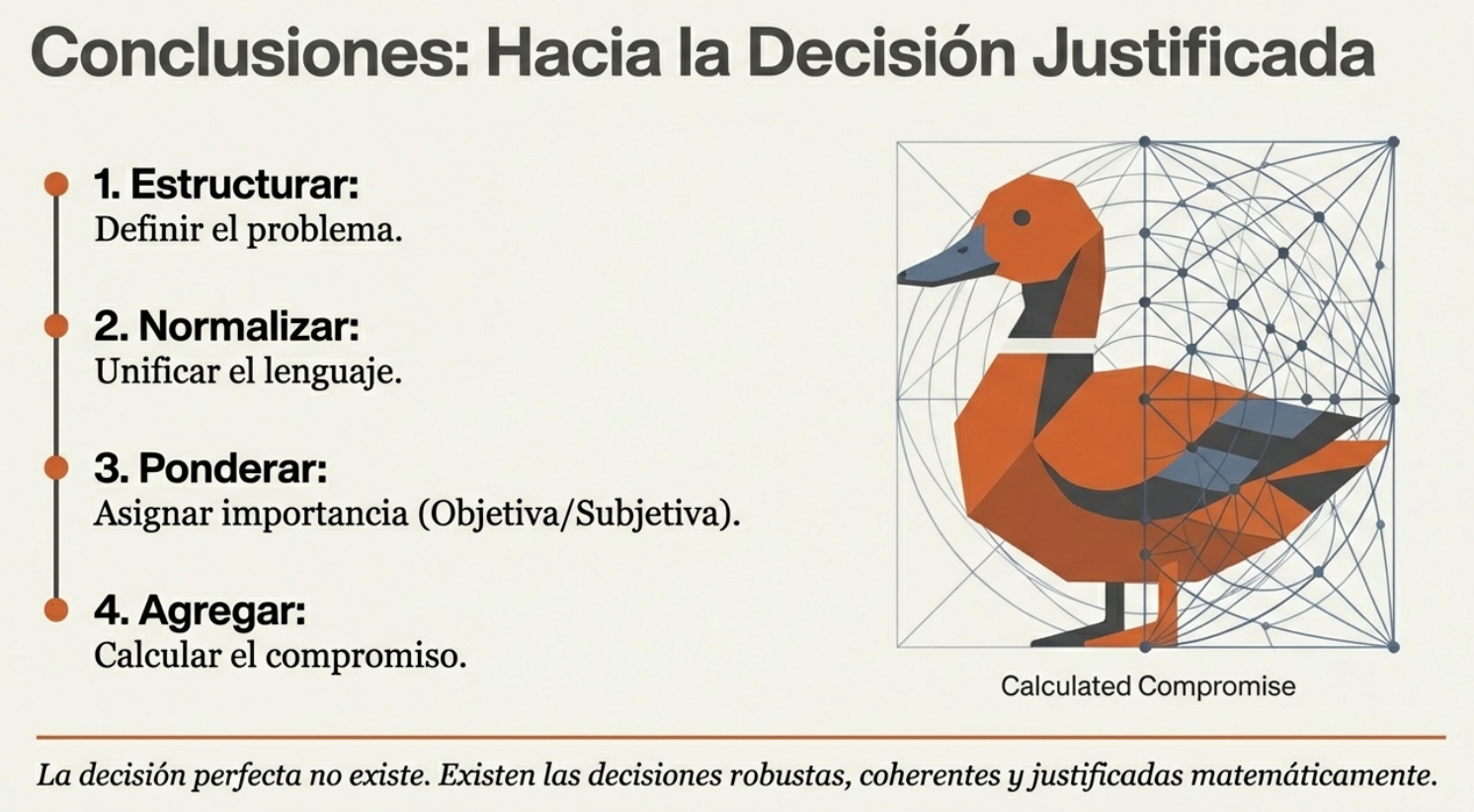

Para que este motor genere mejora continua y no solo «mantenimiento», debe nutrirse de la toma de decisiones basada en la evidencia. La norma es el antídoto contra la gestión por intuición. En la fase de «Actuar», el sistema no solo busca corregir el fallo, sino también eliminar su causa raíz para que no vuelva a ocurrir. Esto solo es posible si los líderes utilizan los datos del sistema para abordar riesgos y oportunidades, en lugar de reaccionar visceralmente ante las crisis diarias.

Conclusión: ¿activo estratégico o certificado decorativo?

La calidad no es un destino, sino una cultura de mejora continua que debe reflejar la salud de tu dirección estratégica. Si analizamos el contexto de una empresa de transporte mediante un análisis DAFO, veremos que factores externos como la fluctuación del precio del combustible o las nuevas regulaciones medioambientales no son «problemas de logística», sino variables de calidad.

En última instancia, tu sistema de gestión de la calidad debería poder responder a las preguntas más difíciles de tu análisis estratégico: ¿por qué un cliente potencial compra a tu competencia y no a ti? ¿Qué le falta a tu servicio para ser verdaderamente superior?

Si tu sistema no te ayuda a responder estas preguntas, no tienes un sistema de gestión, sino un certificado en la pared. La verdadera ISO 9001 es una plataforma para potenciar tus fortalezas y mitigar amenazas antes de que se conviertan en crisis. La pregunta es: ¿estás listo para dejar de «cumplir» y empezar a competir?

En esta conversación puedes escuchar algunas de las ideas más interesantes del tema.

En el vídeo se sintetizan algunos de los aspectos más relevantes de la norma ISO 9001.

ISO_9001_Logistics_and_Transport

Esta obra está bajo una licencia de Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0 Internacional.