En el campo de la ingeniería civil, el concepto de «diseño de experimentos» resulta extraño. Lo asociamos al campo del control de calidad y de los laboratorios, pero no tenemos en cuenta que muchas herramientas avanzadas de productividad, mejora de procesos, toma de decisiones y productividad empresarial se basan en el control estadístico de la calidad. Veamos en esta entrada una breve aproximación al concepto.

En el campo de la ingeniería civil, el concepto de «diseño de experimentos» resulta extraño. Lo asociamos al campo del control de calidad y de los laboratorios, pero no tenemos en cuenta que muchas herramientas avanzadas de productividad, mejora de procesos, toma de decisiones y productividad empresarial se basan en el control estadístico de la calidad. Veamos en esta entrada una breve aproximación al concepto.

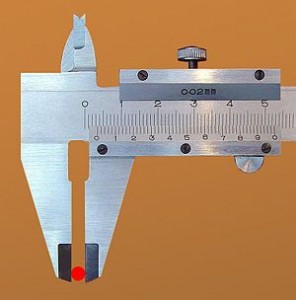

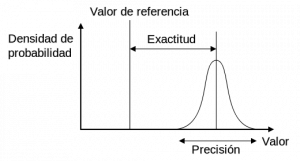

El diseño de experimentos (DOE) es una técnica estadística que permite identificar y cuantificar las causas de un efecto en un estudio experimental, de modo que, con el mínimo número de pruebas, se extraiga información útil para obtener conclusiones que permitan optimizar la configuración de un proceso o producto.

Aunque el diseño de experimentos comenzó a aplicarse en el campo de la agricultura, hoy en día tiene muchas aplicaciones en otros ámbitos, como la ingeniería civil. Por ejemplo, en el control de calidad, en el diseño de productos y de procesos industriales y en todo tipo de ciencias experimentales. Se puede decir que el diseño de experimentos desempeña un papel crucial tanto en la industria como en la investigación experimental en la actualidad.

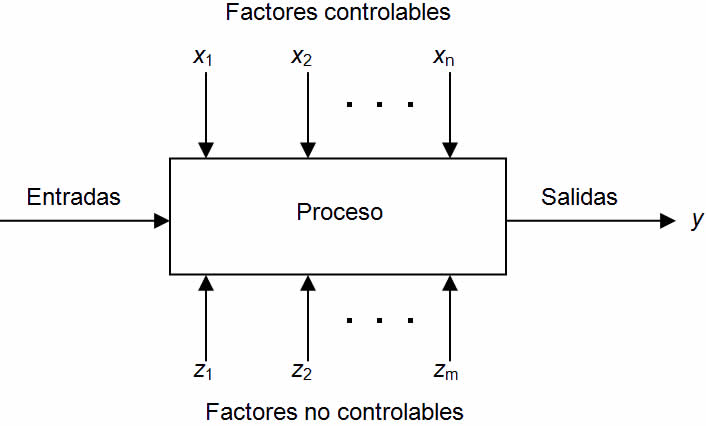

En un diseño experimental se manipulan deliberadamente una o más variables, vinculadas a las causas, para medir el efecto que tienen en otra variable de interés. El diseño experimental prescribe una serie de pautas relativas a qué variables hay que manipular, de qué manera, cuántas veces hay que repetir el experimento y en qué orden, para poder establecer, con un grado de confianza predefinido, la necesidad de una presunta relación de causa-efecto.

Los pasos básicos a seguir en el diseño de experimentos son los siguientes:

- Fijar un cronograma que defina la lista de pruebas a realizar. También debemos definir nuestros objetivos, los cuales deben ser claros y acordes con una realidad alcanzable.

- Escoger los factores a analizar, es decir, aquellos parámetros que van a afectar tanto directa como indirectamente a nuestra actividad (el proceso o producto que queremos optimizar), siendo estos los que nos van a marcar los límites alcanzables.

- Diseñar el plan de pruebas: este variará en función del número de factores que hayamos considerado. En este punto hay que ser ambicioso y no descartar ningún experimento posible, por raro que parezca, pues puede que algunos de ellos estén comunicados entre sí y que su interacción deba considerarse a la hora de tomar decisiones.

Una vez realizadas las pruebas, los resultados obtenidos permiten extraer conclusiones sobre qué factores influyen más en los resultados y cómo debe configurarse nuestra actividad para alcanzar los objetivos propuestos. Además, si utilizamos herramientas informáticas, podremos obtener una función de regresión que relacione los resultados de la actividad con los factores considerados. Gracias a ella, podremos hacer interpolaciones y calcular virtualmente qué resultado tendrá nuestra actividad para cualquier combinación de factores posible.

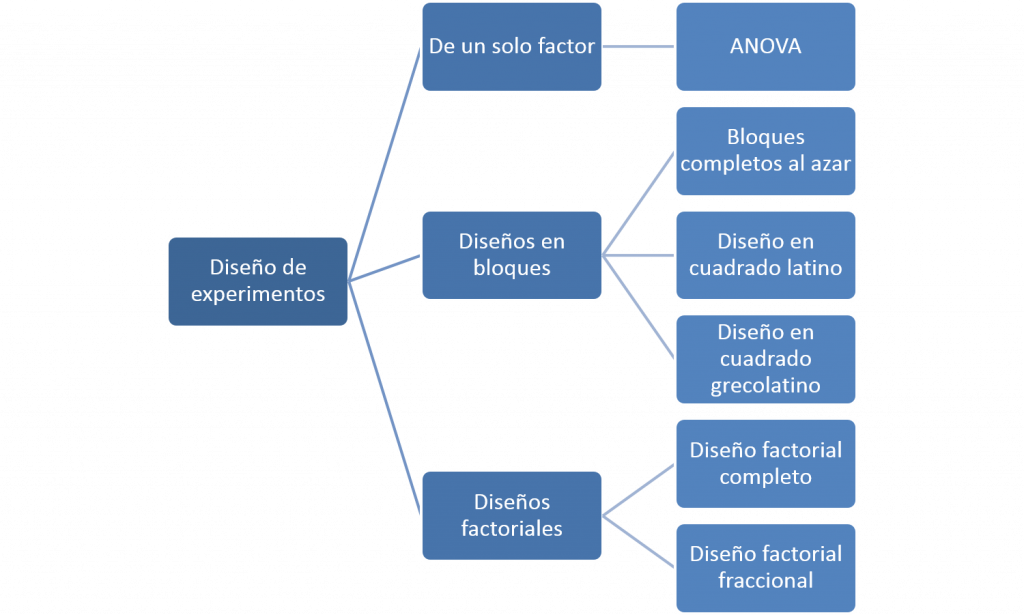

Algunos de los tipos de diseños de experimentos son los siguientes:

- Diseño unifactorial

- Diseño por bloques aleatorizados

- Diseño por cuadrados latinos

- Diseños factoriales

- Diseños anidados

- Diseños cruzados anidados

- Diseños factoriales 2^k

Esta obra está bajo una licencia de Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0 Internacional.