En este artículo tratamos con aspectos relacionados con la precisión y la exactitud que deben tener las magnitudes que manejamos los ingenieros. A veces se confunden estos conceptos y otras no tenemos claro qué es un error. Vamos, pues, a dar unas pequeñas definiciones y enlaces que permitan divulgar estas ideas.

En este artículo tratamos con aspectos relacionados con la precisión y la exactitud que deben tener las magnitudes que manejamos los ingenieros. A veces se confunden estos conceptos y otras no tenemos claro qué es un error. Vamos, pues, a dar unas pequeñas definiciones y enlaces que permitan divulgar estas ideas.

Se puede definir la Metrología como la ciencia de la medida. Esta ciencia comprende la totalidad de los métodos sistemáticos de los que nos servimos para cuantificar características de calidad.

Medir es comparar una cantidad con su respectiva unidad, con el fin de determinar cuántas veces la primera contiene a la segunda.

Los procedimientos de medida de una magnitud física consisten en la caracterización del estado o intensidad de la misma, de manera repetible y suficientemente precisa, mediante un valor que permite elevarlo por encima de la mera percepción subjetiva.

Un aparato de medida es cualquier instrumento capaz de facilitar indicaciones dentro de su campo de medida y división de escala, cuando se aplica sobre mesurando concretos.

Pero, ¿qué es el error de medición?

Cualquier medición de una magnitud difiere respecto al valor real, produciéndose una serie de errores que se pueden clasificar en función de las distintas fuentes donde se producen. El error experimental siempre va a existir y depende básicamente del procedimiento elegido y la tecnología disponible para realizar la medición.

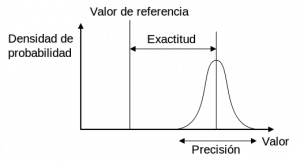

El error de exactitud es la desviación existente entre la media de los valores observados y el valor real. Es un error sistemático que puede ser positivo o negativo, equivaliendo al valor que hay que corregir para calibrar el equipo, o sea ajustarlo a su valor verdadero.

El error de precisión se calcula partiendo de la realización de un número de mediciones en una misma pieza o patrón, las cuales variarán entre ellas, siendo por tanto este error de tipo aleatorio. Esta dispersión es inherente a todos los equipos de medida, debido a las holguras de sus mecanismos, variaciones en la fuente de alimentación de un circuito eléctrico, etc. Se suele dar en función de la desviación típica, por lo cual se necesita efectuar un mínimo de mediciones para que tenga un nivel de confianza.

Una vez efectuadas las correcciones de exactitud, las medidas se deben dar con su incertidumbre, es decir, con el margen probable de error dentro de cuyos límites se estima que se encuentra el valor exacto. Según el acuerdo adoptado por EAL (European cooperation for Accreditation of Laboratories), se ha decidido emplear un intervalo de incertidumbre de dos desviaciones típicas, que en el caso de una distribución normal corresponde a un nivel de confianza del 95,44%.

Los errores pueden tener diversas fuentes que pueden ser conocidas, tales como la influencia del operador, la variación entre operadores, las diferencias entre las piezas a medir, variación del equipo de medición y del método seguido, e incluso la variación entre laboratorios. Las medidas observadas son resultado de todas las variaciones.

El error total puede calcularse en función de los tipos de errores que influyen en la medición. Si los errores son independiendientes entre sí, la varianza del error combinado será la suma de las varianzas de las variables de los errores parciales. Si hay influencia entre ellos, habría que añadir sumandos teniendo en cuenta los coeficientes de correlación correspondientes.

Para entender estos conceptos y otros relacionados como el de fiabilidad y validez de los datos, os dejo el siguiente vídeo de la Universidad de Murcia. Espero que os guste.

Esta obra está bajo una licencia de Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0 Internacional.