Más allá del GPS: por qué la ruta más corta no siempre es la más rentable.

Más allá del GPS: por qué la ruta más corta no siempre es la más rentable.

Para cualquier responsable de operaciones, la intuición dicta una regla aparentemente infalible: cuanto menos kilómetros se recorren, mayores son los márgenes. Sin embargo, ante la complejidad de la última milla contemporánea, esta lógica resulta peligrosamente incompleta. El ahorro en combustible suele verse compensado por penalizaciones por entregas tardías, ineficiencias en el uso de la capacidad de carga o por el coste oculto de ignorar las regulaciones laborales.

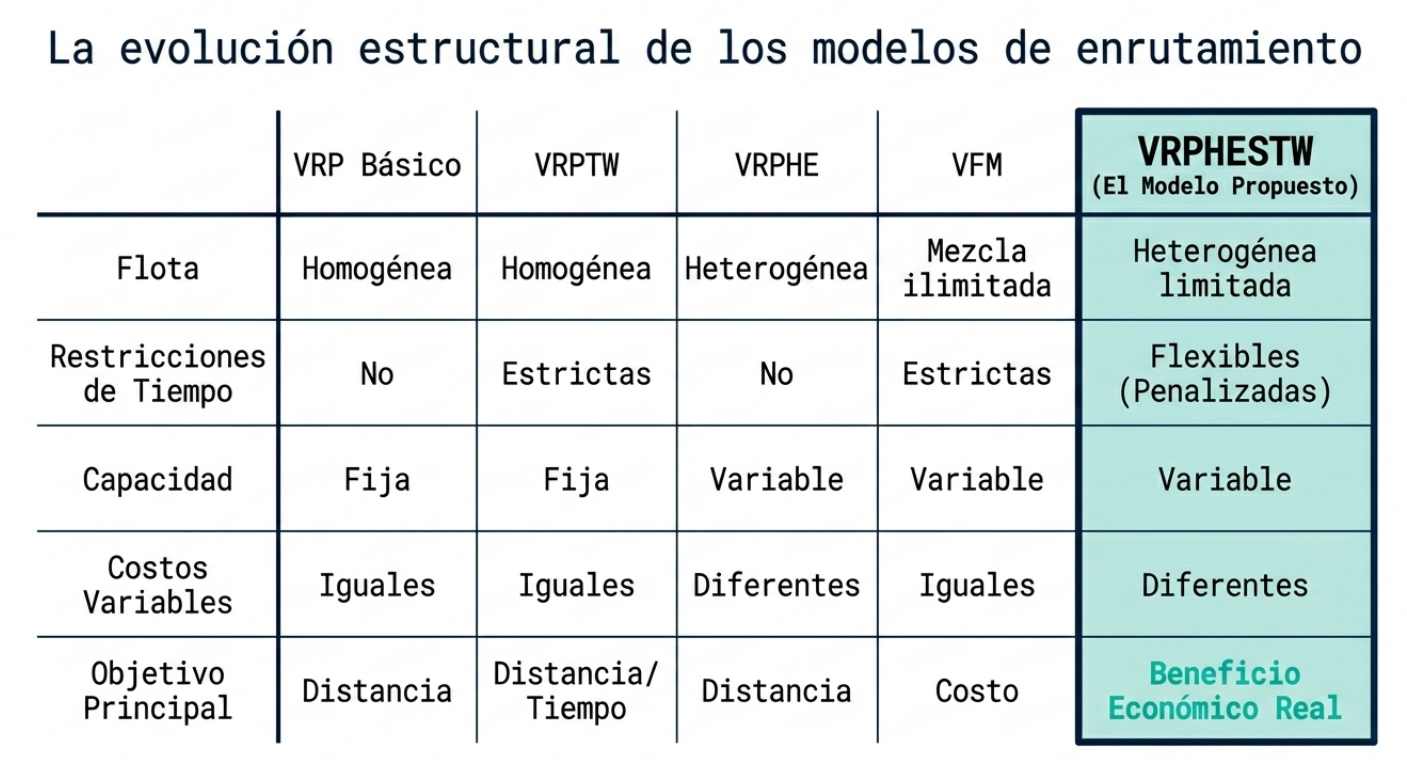

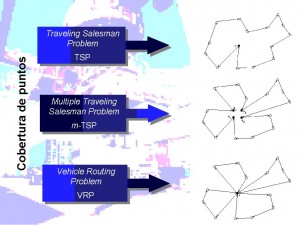

El éxito no consiste en reducir la distancia de forma simplista, sino en maximizar la rentabilidad operativa. Es aquí donde el problema de las rutas de vehículos con flotas heterogéneas y ventanas de tiempo flexibles (VRPHESTW, Vehicle Routing Problem with Heterogeneous Fleet and Soft Time Windows) surge como la respuesta científica al caos logístico. Este modelo trasciende el mapa al integrar variables económicas, humanas y temporales en una única ecuación estratégica. Este artículo se basa en uno de los resultados más importantes de mi tesis doctoral, publicada en un trabajo que podéis encontrar al final de las referencias (Yepes y Medina, 2006).

La rentabilidad total sobre la distancia total recorrida: la nueva métrica de éxito.

El enfoque tradicional se limita a minimizar el consumo de kilómetros. No obstante, la logística de alto nivel exige una función con un objetivo económico que considere la operación como un centro de beneficios y no solo de costes. La fórmula es clara:

Beneficio = Ingresos Totales – Costes Operativos – Costes de Penalización por Ventanas de Tiempo.

En este modelo, los ingresos no son una cifra estática, sino que se consideran dos tasas: una fija por servicio y otra variable en función de la distancia y del volumen de la mercancía. La gran innovación es que la satisfacción del cliente se convierte en un activo negociable. Al monetizar los retrasos mediante penalizaciones, el algoritmo decide de forma autónoma si resulta más rentable aceptar una pequeña desviación en el horario de entrega o invertir en un vehículo adicional. La logística moderna, por tanto, no busca el «cumplimiento a cualquier precio», sino el equilibrio óptimo entre el servicio y el margen.

El poder estratégico de una flota «mixta».

Una de las mayores ventajas competitivas del transporte radica en la heterogeneidad. El modelo demuestra que una flota uniforme tiende a ser ineficiente. El algoritmo realiza un arbitraje constante entre distintos tipos de vehículos para encontrar la combinación que minimiza el coste total de propiedad y operación.

En este análisis, la selección de vehículos (categorizados como k = 1, 2 o 3) no solo se basa en el volumen de carga, sino también en un equilibrio sofisticado entre:

- Capacidad y velocidad: desde el vehículo pequeño y ágil (k = 1), ideal para zonas urbanas densas, hasta el «pesado» (k = 3), con gran capacidad, pero mayor coste fijo y menor velocidad de maniobra.

- Estructura de costes laborales: el sistema evalúa el impacto financiero de pasar de la remuneración por hora legal a las horas extraordinarias y, finalmente, a las severas penalizaciones económicas derivadas del exceso de jornada laboral, protegiendo así la rentabilidad y la seguridad jurídica de la empresa.

Como señala el estudio:

«Los problemas de rutas de vehículos en el mundo real requieren una función objetivo económica para medir la calidad de las soluciones».

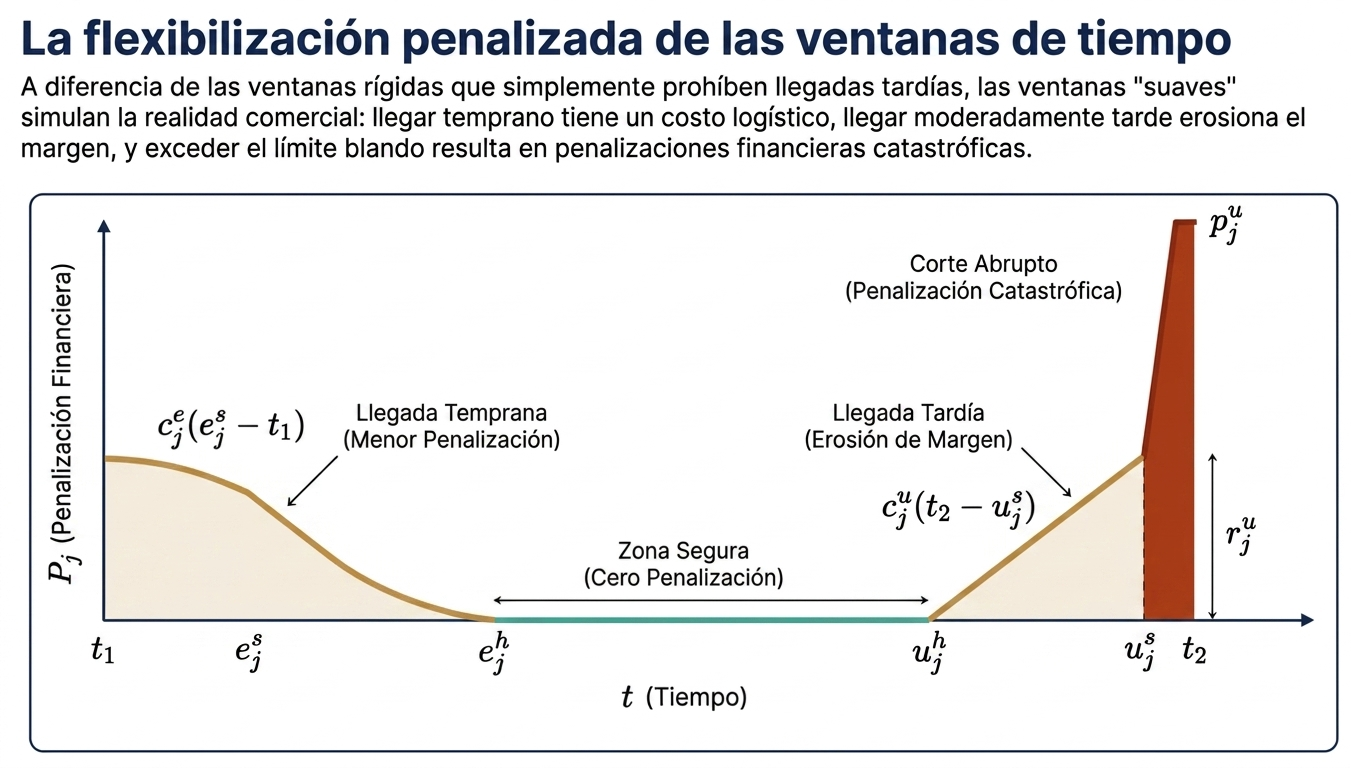

Ventanas de tiempo flexibles: el tiempo como variable económica elástica.

En la logística convencional, una ventana de tiempo es un muro infranqueable: llegar un minuto tarde se considera un fallo del sistema. El concepto de «soft time windows» (ventanas de tiempo flexibles) revoluciona esta noción al considerar el tiempo como una variable económica elástica.

En lugar de prohibir las entregas fuera de horario, el modelo establece una penalización económica escalonada en función de la antelación o el retraso. Esta flexibilidad calculada permite que el sistema de optimización identifique rutas que, aunque «incumplen» ligeramente el horario, logran una consolidación de carga tan eficiente que el beneficio neto final es muy superior al de una ruta de cumplimiento rígido. Se pasa así de una logística de obediencia a una logística de resultados.

El hallazgo sorprendente: el valor estratégico del sesgo.

El descubrimiento más disruptivo de la investigación consiste en distinguir entre la función «objetivo» (el beneficio real que queremos obtener) y la función «guía» (las instrucciones que le damos al algoritmo para explorar el mapa).

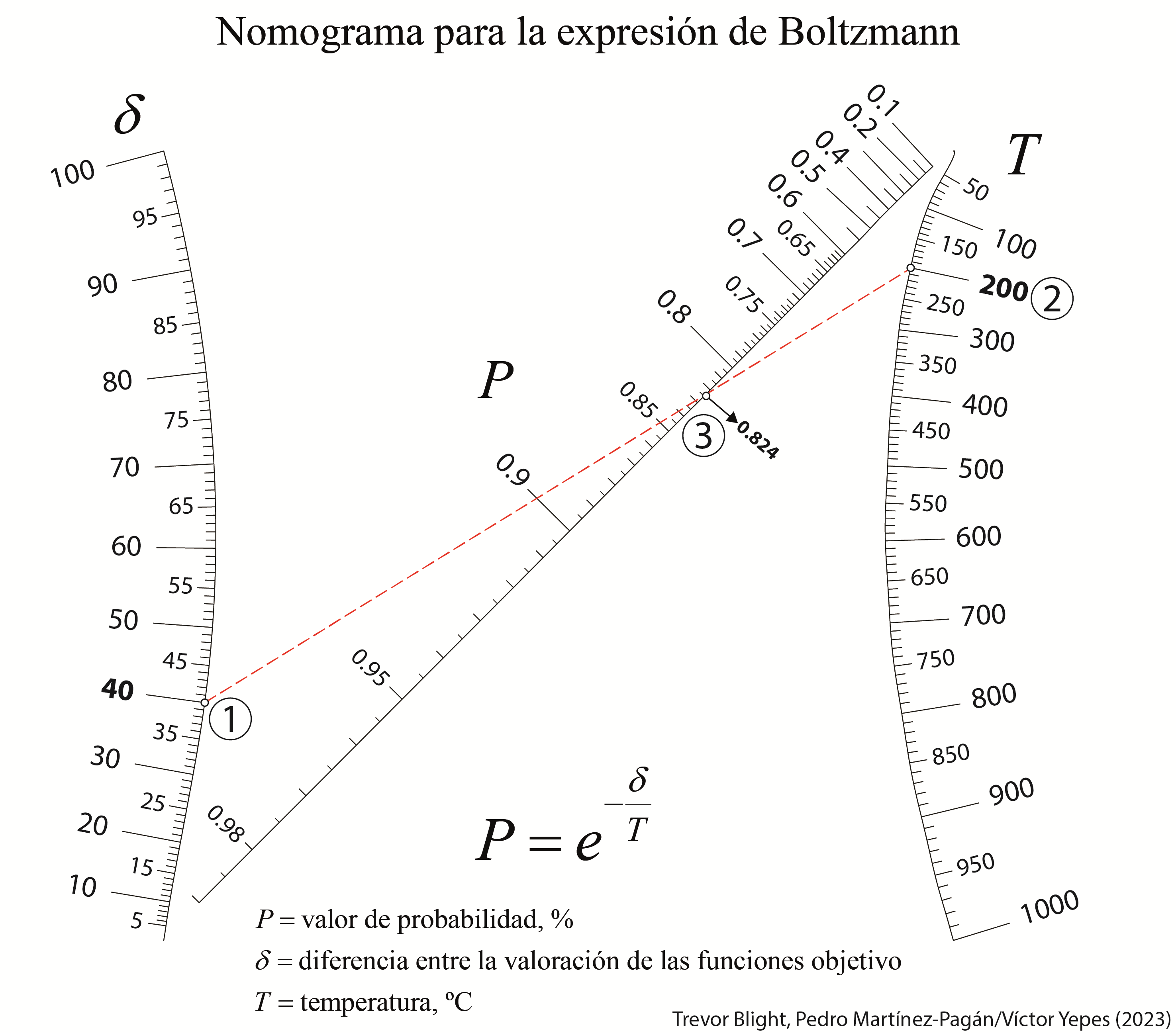

En un experimento revelador, los investigadores «engañaron» al algoritmo aumentando artificialmente en un 10 % los costes de distancia en la función guía (escenario HES-B). Al evaluar la ruta resultante con los costes reales (escenario HES-A), el beneficio neto aumentó un 6,4 %.

¿Por qué funciona este sesgo estratégico? Al sobreponderar el coste de la distancia durante la fase de búsqueda, se obliga al algoritmo a encontrar clústeres de clientes extremadamente compactos y rutas más robustas que el peso económico estándar pasaría por alto. Este fenómeno demuestra que, para escapar de los «óptimos locales» (soluciones que parecen buenas, pero no lo son), a veces es necesario alterar la topología del problema para forzar al sistema a encontrar la excelencia global.

Un marco de tres pilares para la implementación.

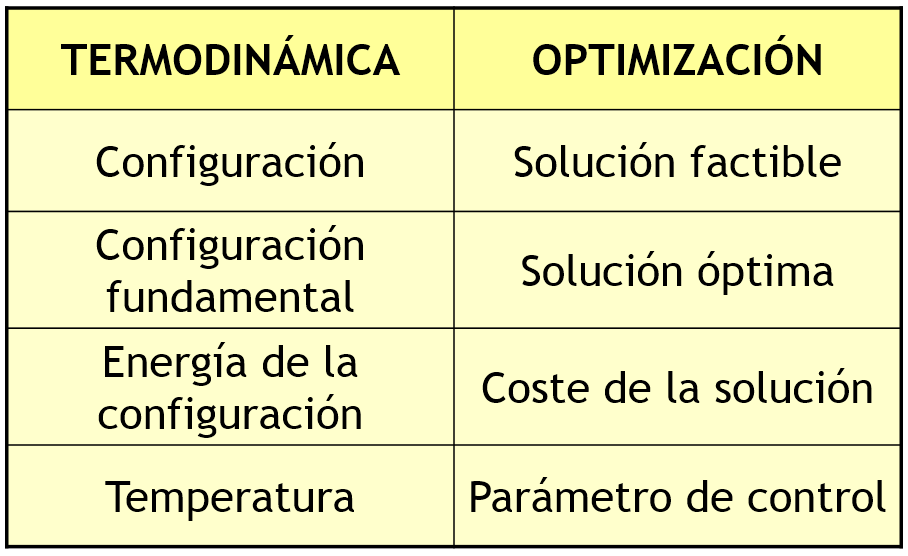

Para ejecutar esta estrategia, se propone un marco de optimización híbrido que integra la exploración creativa y el rigor matemático.

- Fase de construcción inteligente (GRASP): no se generan rutas al azar, sino que se inicia el proceso seleccionando clientes «semilla» según criterios de alta rentabilidad y dificultad logística, lo que asegura un punto de partida sólido.

- Fase de diversificación global (VNS): el sistema utiliza una «búsqueda de vecindario variable» para desafiar las rutas establecidas. En esta fase se introduce variedad para evitar que la operación se estanque en las soluciones obvias.

- Fase de intensificación de precisión (algoritmo de umbral): un pulido final que somete cada ruta a un escrutinio de costes extremo, aceptando incluso soluciones ligeramente peores temporalmente para alcanzar el máximo céntimo de beneficio potencial.

Conclusión: hacia una logística con visión de negocio.

La optimización de rutas ha dejado de ser un problema geográfico para convertirse en una disciplina puramente estratégica de economía. El uso de algoritmos avanzados que integran flotas heterogéneas y ventanas de tiempo flexibles permite a las empresas navegar por la volatilidad de los costes y las exigencias del mercado con una precisión quirúrgica.

Optimizar no consiste solo en llegar antes, sino en comprender el coste exacto de cada minuto y cada kilómetro para decidir, basándose en datos, qué configuración de flota garantiza el crecimiento sostenible del negocio.

Pregunta para reflexionar: En su operación actual, ¿está optimizando para que sus vehículos recorran menos distancia o para que su balance de situación sea más robusto?

Puedes escuchar en esta conversación algunas de las ideas más interesantes sobre este tema.

Este vídeo resume bien los conceptos básicos tratados.

Maximizing_Logistics_Profitability

Referencia:

YEPES, V.; MEDINA, J.R. (2006). Economic Heuristic Optimization for Heterogeneous Fleet VRPHESTW. Journal of Transportation Engineering, 132(4): 303-311. DOI: 10.1061/(ASCE)0733-947X(2006)132:4(303)

Esta obra está bajo una licencia de Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0 Internacional.