1. Introducción: El espejismo del resultado idéntico.

1. Introducción: El espejismo del resultado idéntico.

Para cualquier líder de operaciones, existe una frustración que roza lo existencial: el espejismo de un resultado idéntico. A pesar de contar con manuales de procedimientos exhaustivos y formación constante, la realidad se impone con una tozudez estadística.

Como veremos, la variabilidad es la fuerza invisible que define el éxito o el fracaso de una organización. Comprender que la perfección no es una meta, sino una asíntota, es el primer paso para pasar de una gestión basada en la intuición a otra basada en la excelencia estratégica.

2. La inevitabilidad de la diferencia: «Nunca dos salidas de un proceso son iguales».

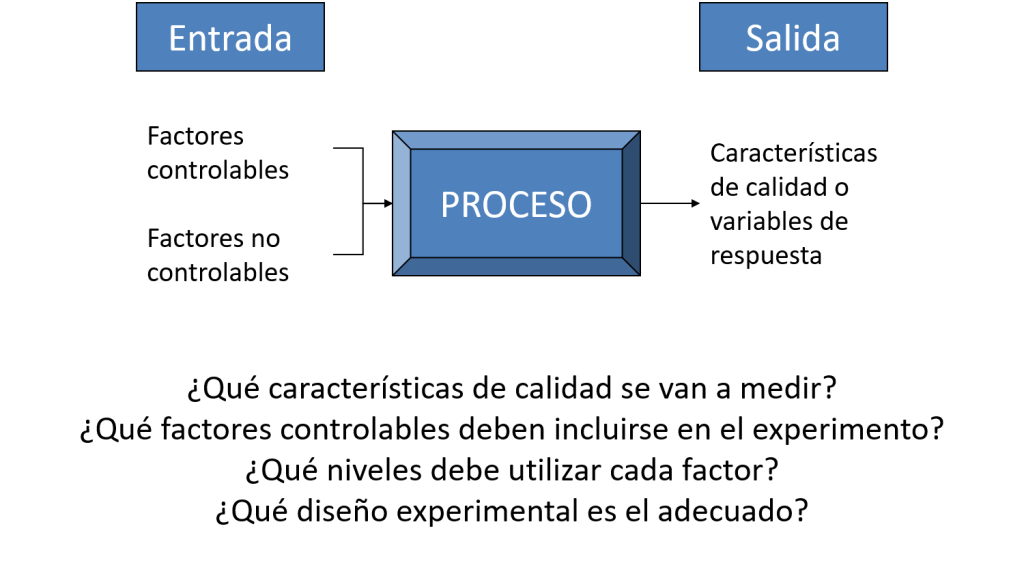

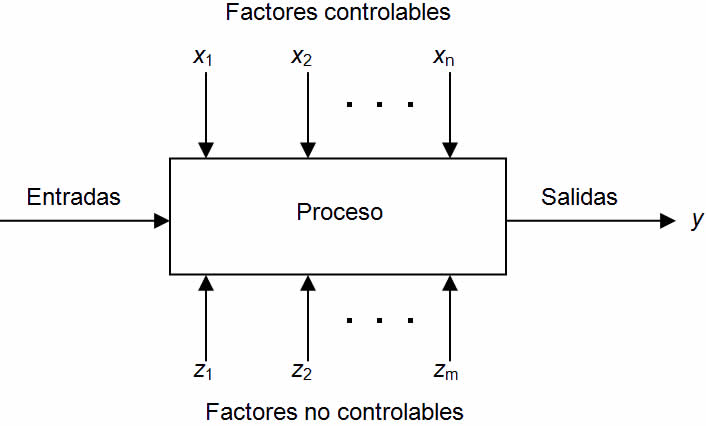

La variabilidad no es un error del sistema, sino su huella dactilar. Un proceso es un conjunto de actividades interrelacionadas en las que interactúan los métodos, la mano de obra, las máquinas, la materia prima y el entorno. En esta danza de variables, la uniformidad absoluta es físicamente imposible.

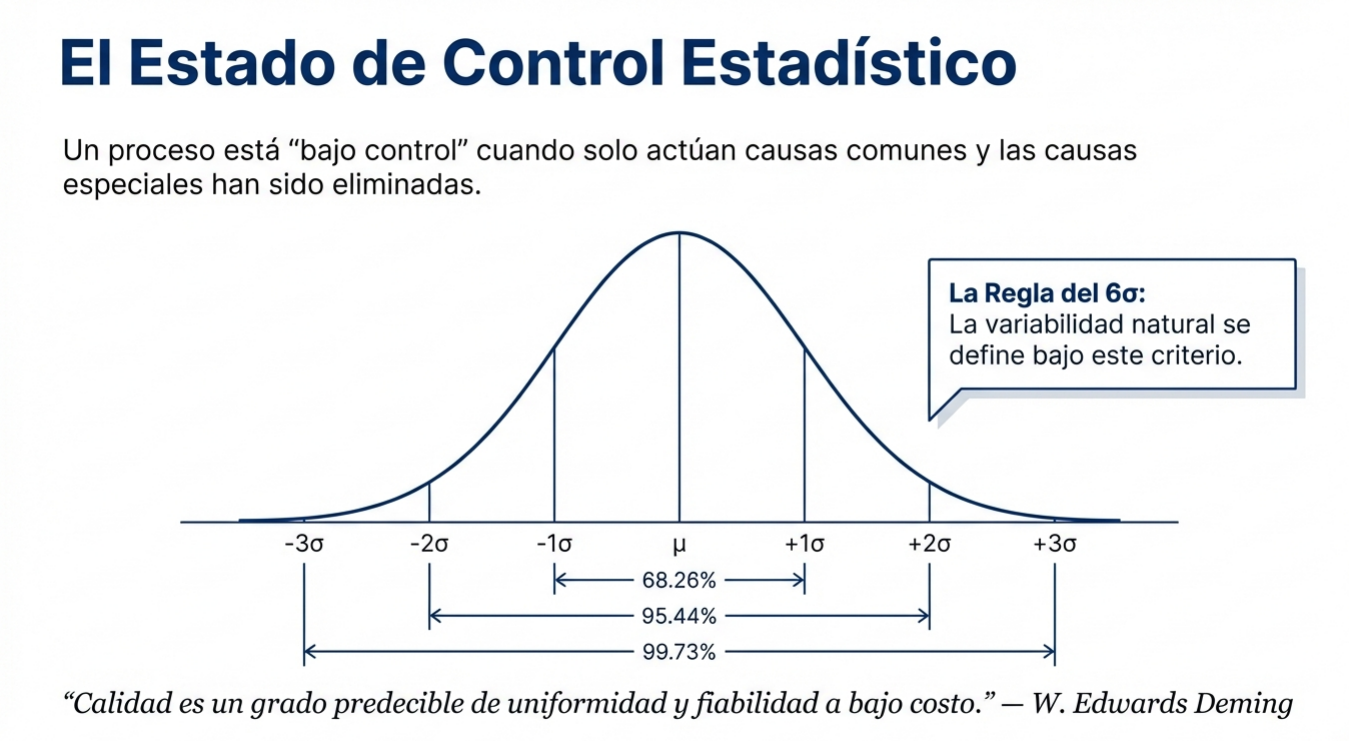

Desde la perspectiva de W. Edwards Deming, la calidad no es una aspiración abstracta, sino «un grado predecible de uniformidad y fiabilidad, a bajo coste y adecuado a las necesidades del mercado». Desde esta óptica, el objetivo no es eliminar la variabilidad de forma ingenua, sino reducirla para aumentar la predictibilidad.

Es crucial distinguir aquí los llamados «procesos especiales», es decir, aquellos en los que no es posible verificar fácilmente y a un precio asequible la conformidad del resultado. En estos casos, la excelencia no se mide en el producto final, sino en un control férreo y anticipado de las entradas (especialmente de los métodos y la mano de obra), ya que cualquier desviación conlleva un riesgo financiero latente.

«Nunca dos resultados son exactamente iguales».

3. La regla del 90/10: ¿de quién es realmente la culpa?

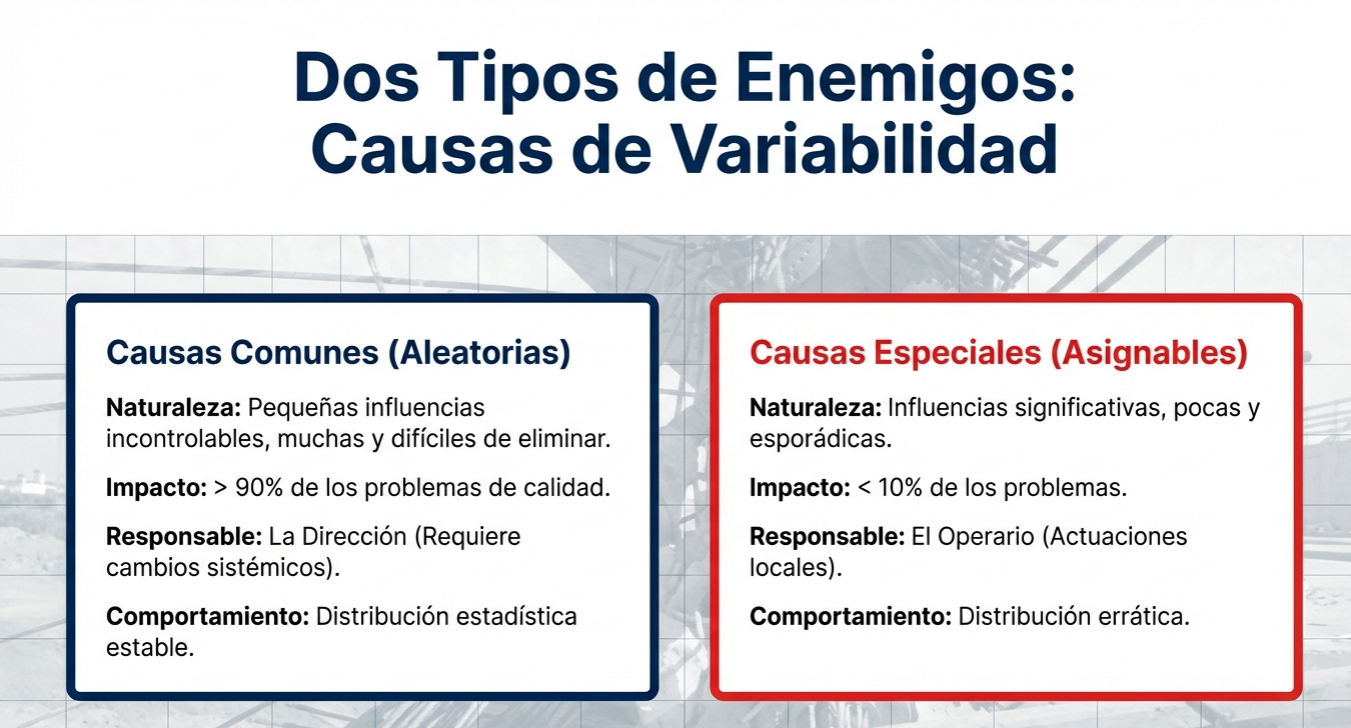

Uno de los errores más costosos y moralmente desgastantes en la gestión es malinterpretar el origen de las desviaciones. Para liderar con integridad, es imperativo distinguir entre:

- Causas comunes (o aleatorias): representan más del 90 % de los problemas de calidad. Se manifiestan de forma estable y son inherentes al diseño del sistema. Su corrección es responsabilidad exclusiva de la dirección, ya que requiere cambios estructurales. Intentar corregirlas mediante acciones locales es, matemáticamente, un ejercicio de futilidad.

- Causas especiales (o asignables): representan menos del 10 % de los fallos. Tienen una distribución errática y esporádica. Estas causas sí corresponden al operario, quien debe actuar para devolver el proceso a su estado normal.

Culpar a un trabajador por un fallo derivado de una causa común es una injusticia estadística. Si el diseño del proceso es deficiente, ningún esfuerzo individual podrá rescatarlo.

4. Control frente a la capacidad: no basta con ser estable.

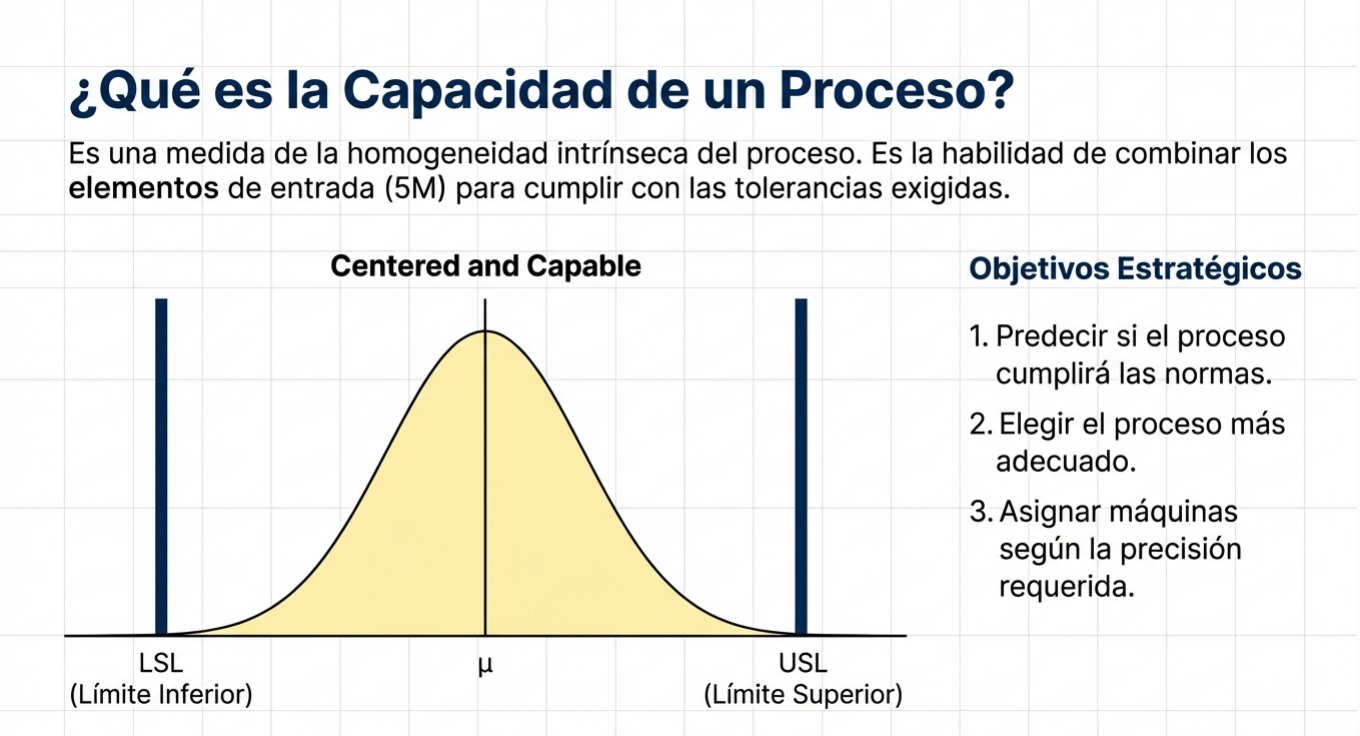

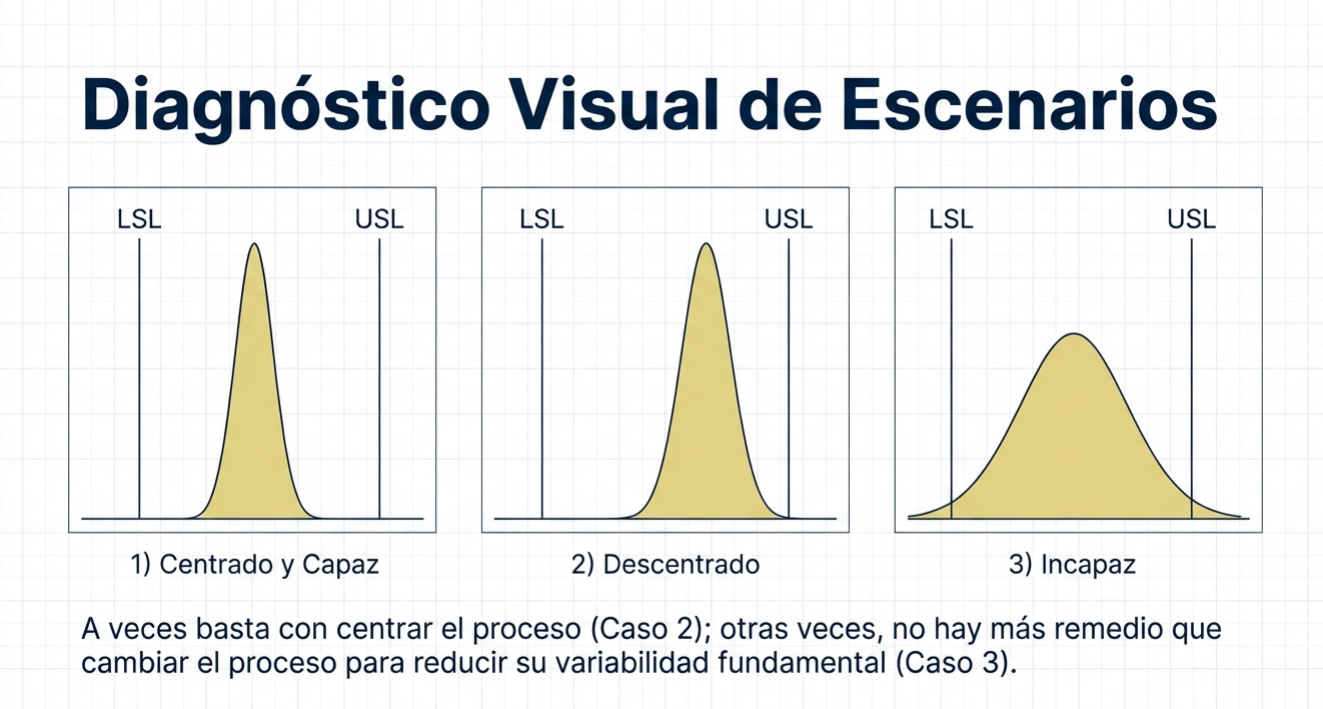

Un proceso puede ser perfectamente predecible y, al mismo tiempo, completamente inútil para el mercado. La estabilidad es una métrica interna, mientras que la capacidad es una métrica externa de supervivencia.

- La realidad del proceso (6 sigma): representa lo que el sistema «sabe hacer». Se trata de su variabilidad natural bajo control estadístico, operando dentro de un modelo probabilístico predecible.

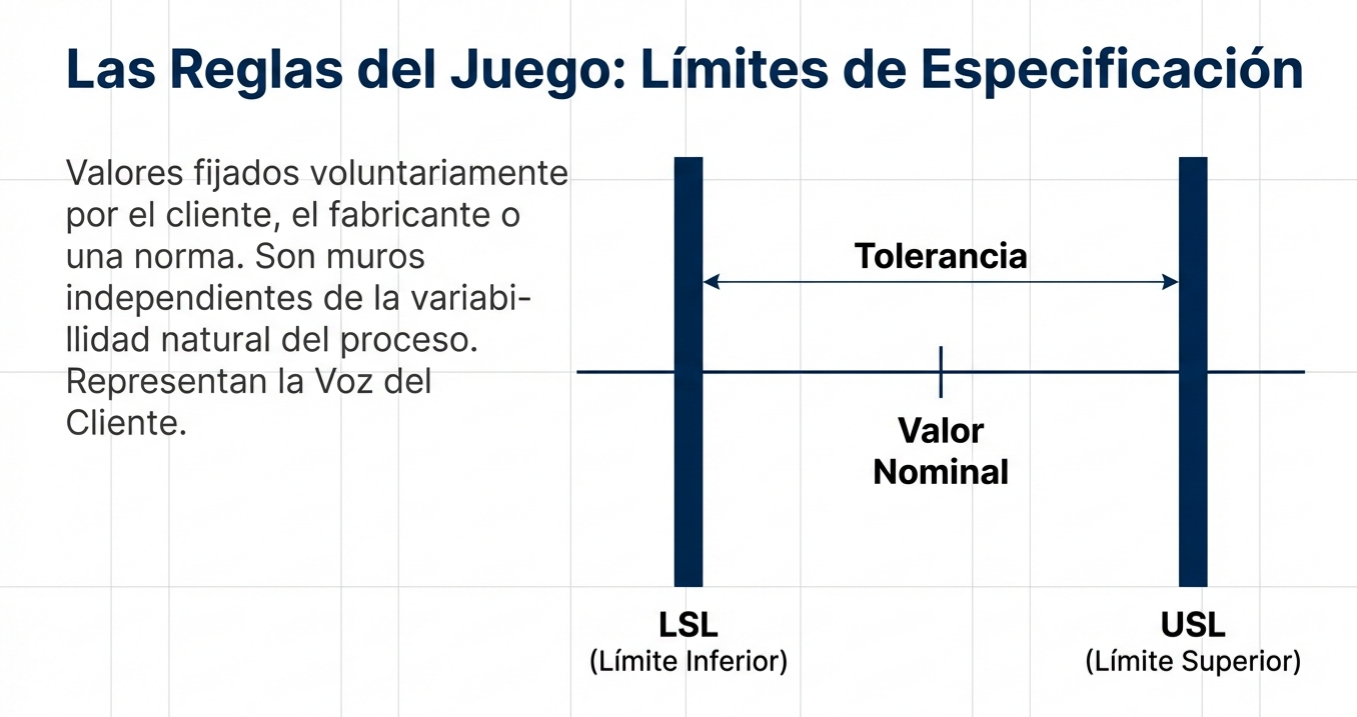

- Las especificaciones son los límites (USL y LSL) que el mercado o la norma establece de forma voluntaria. Representa lo que el cliente está dispuesto a pagar.

La estabilidad es solo la mitad del camino. Un proceso estable, pero descentrado, o con una dispersión mayor que la especificada, es, en términos empresariales, una fábrica de desperdicios.

5. El arte de centrar: la solución más económica.

Ante un proceso «incapaz», la reacción visceral de muchos comités de dirección es aprobar inversiones masivas en nueva maquinaria. Sin embargo, el análisis de capacidad nos ofrece una alternativa estratégica: el centrado.

A menudo, un proceso no es eficaz porque sea errático, sino porque su valor medio no se alinea con el valor nominal del cliente. Identificar un proceso con baja variabilidad, pero descentrado, es como encontrar una mina de oro, ya que permite cumplir los requisitos con ajustes técnicos mínimos en lugar de recurrir a costosas adquisiciones de capital. La diferencia radica en gestionar con base en suposiciones o en datos.

6. Los números hablan: el veredicto del Cp y el Cpk.

Los índices de capacidad no son simples números, sino el veredicto financiero sobre la viabilidad de su operación. Convierten la estadística en decisiones de inversión:

- Cp (capacidad potencial): revela lo que el proceso podría ser si estuviera perfectamente centrado. Mide si el «ancho» de su proceso se ajusta al del cliente.

- Cpk (capacidad real): es el indicador honesto y pesimista. Tiene en cuenta el centrado actual y nos indica qué ocurre en este momento.

El análisis de estos índices dicta el camino a seguir.

- Si el índice es < 1, el proceso es incapaz. Es un drenaje financiero; genera defectos sistemáticos y requiere un cambio estructural inmediato o la compra de nuevos equipos.

- Si el índice es = 1, el proceso es justamente capaz. Es un equilibrio precario en el que cualquier mínima perturbación generará pérdidas.

- Si el índice es > 1, el proceso es capaz. Existe un margen de seguridad que garantiza la fiabilidad y el cumplimiento a bajo coste.

7. Conclusión: hacia una cultura de la variabilidad controlada.

La mejora de la calidad consiste, en esencia, en reducir de manera metódica la variabilidad. La estadística nos otorga el poder de la profecía, ya que nos permite garantizar el cumplimiento de las promesas hechas al cliente antes incluso de que la primera unidad salga de la línea de producción.

Como líderes, debemos aceptar que la variabilidad es inevitable, pero su descontrol es opcional. La próxima vez que su operación falle, antes de buscar un culpable en la planta, analice las cifras.

¿Está fallando su proceso por un error puntual o está simplemente diseñado para no poder ganar nunca?

En esta conversación puedes escuchar los conceptos más interesantes sobre este tema.

Este vídeo resume bien los aspectos relacionados con la capacidad de los procesos.

Esta obra está bajo una licencia de Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0 Internacional.